Материалы по тегу: hardware

|

16.10.2025 [13:39], Руслан Авдеев

Унификация, стандартизация, совместимость: Google призвала создавать взаимозаменяемые компоненты для ИИ ЦОДВ ходе мероприятия OCP Summit компания Google выступила с общеотраслевой инициативой «переосмысления» архитектуры ЦОД, оптимизированных для эпохи ИИ. В рамках сообщества Open Compute Project (OCP) предлагается создать рабочее направление по разработке «гибких, взаимозаменяемых ЦОД», сообщает пресс-служба компании. Google подчеркнула, что скорость внедрения и неоднородность ИИ-технологий растёт, что затрудняет создание общей системы, проектирования, развёртывания и обслуживания ЦОД. Представленный Google проект предусматривает создание модульных, совместимых друг с другом решений для ЦОД, позволяющих легко адаптироваться к стремительному развитию ИИ и изменению рабочих нагрузок. Говорится о «начале революции» в сфере ИИ — мир радикально изменился и необходимо создавать дата-центры, способные меняться не менее быстро. По данным компании, за последние 24 месяца использование ИИ-ускорителей внутри Google увеличилось в 15 раз, объём хранилищ для машинного обучения Hyperdisk ML — в 37 раз, а количество обработанных токенов — до двух квадрлн/мес. В Google сравнивают исследователей ИИ с исследователями космоса, а участников OCP, строителей инфраструктуры — со строителями ракет. Сама инфраструктура компании, как утверждается, поддерживает ИИ-трансформацию на всех уровнях экосистемы, от пользовательских приложений (на основе Gemini) до корпоративных сервисов и научных изысканий в самых разных областях. Особое внимание уделяется обеспечению взаимозаменяемости и гибкости: модульные компоненты, спроектированные различными участниками отрасли, должны быть совместимы с компонентами и системами других поколений и вендоров, причём принципы унификации должны применяться ко всем компонентам ЦОД, включая электропитание, охлаждение, вычислительное оборудование, сетевые технологии и др. Стратегия самой Google строится вокруг т.н. ИИ-гиперкомпьютера — комплексной архитектуры, в которой все компоненты от чипов до электросетей разработаны с учётом общих особенностей системы для обеспечения максимальной эффективности. Благодаря использованию собственных TPU, оптических коммутаторов и СЖО, компания добилась роста энергоэффективности и снижения затрат в 10–100 раз за последние 10 лет. Google уже развернула мегаваттами инфраструктуры с жидкостным охлаждением. Компания вместе с партнёрами организовала в рамках OCP рабочую группу, целью которой является создание единых стандартов обеспечения модульности и совместимости компонентов, а также общих интерфейсов в области вычислений, сетей, хранилищ, безопасности и устойчивости. В частности, участники OCP договорились о разработке гибких систем электропитания для современных ЦОД. Речь идёт о стандартизации 400-В архитектур и модульных системах Mt. Diablo с использованием твердотельных преобразователей. Также ведутся работы в сфере микросетей и аккумуляторных хранилищ. Всё вместе это позволит сглаживать пики потребления энергии, характерные для обучения ИИ, а в перспективе и возвращать излишки энергии обратно в энергосети. Охлаждение также переосмысливается в эпоху ИИ. В начале 2025 года OCP представлено современное решение для жидкостного охлаждения Project Deschutes. Теперь оно получит широкое распространение среди вендоров, включая поставщиков жидкостного охлаждения вроде Boyd, CoolerMaster, Delta, Envicool, Nidec, nVent и Vertiv. Сообщество работает над унификацией интерфейсов охлаждения, новых теплообменников. Важную роль играет стандартизация компонентов и интерфейсов в колокейшн- и сторонних ЦОД. Наконец, Google подчёркивает необходимость унификации физических стандартов: высоты, ширины, глубины и даже грузоподъёмности стоек; ширины и планировки проходов, интерфейсов стоечного и сетевого оборудования. Также требуются единые стандарты для телеметрии и мехатроники, которые лягут в основу строительства и эксплуатации дата-центров следующего поколения. Совместно с партнёрами по OCP ведутся работы над стандартизацией интеграции телеметрии для сторонних дата-центров. Помимо физической инфраструктуры, по словам Google, необходимо внедрение открытых стандартов для обеспечения масштабируемости и безопасности систем:

Для измерения воздействия на окружающую среду предложена методология измерения потребления энергии, воды и подсчёта выбросов в ходе ИИ-нагрузок. В частности, с их помощью выяснилось, что медианный промпт Gemini тратит менее 5 капель воды и электричество в объёме, достаточном для просмотра телевизора в течение менее девяти секунд. Эти методы подсчёта касаются и других, совместных с OCP проектов, включая выпуск экобезопасного бетона, чистой резервной энергии и др. Google приглашает принять участие в инициативе OCP Open Data Center for AI Strategic для разработки общих стандартов. Наконец, сообщество OCP призвали работать над проектами «ИИ для ИИ» — использованием искусственного интеллекта для разработки ИИ-систем следующего поколения. Так, проект AlphaChip предусматривает использование ИИ для размещения компонентов чипов, что уже позволило улучшить показатели мощности, производительности и др., одновременно сократив время проектирования. Предполагается, что создание ИИ систем с помощью ИИ, от полупроводников до программного обеспечения, позволит достигнуть нового уровня эффективности технологий.

16.10.2025 [12:12], Руслан Авдеев

Группа инвесторов, включающая NVIDIA, под руководством Macquarie Asset Management купит Aligned Data Centers за $40 млрд — это одна из крупнейших сделок на рынке ЦОДГруппа AI Infrastructure Partnership (AIP), фонд MGX из ОАЭ и Global Infrastructure Partners (GIP) под руководством Macquarie Asset Management намерены приобрести техасского оператора ЦОД Aligned Data Centers за $40 млрд. Сделка заключена в рамках более широкого проекта по развитию ИИ-инфраструктуры, сообщает пресс-служба Macquaire, и станет одной из крупнейших на рынке ЦОД. Ожидается, что сделка будет закрыта в I полугодии 2026 года. AIP включает NVIDIA, BlackRock, Microsoft, xAI, Global Infrastructure Partners (GIP, принадлежит BlackRock) и государственную инвесткомпанию (создана при участии Mubadala и G42) из ОАЭ. AI Infrastructure Partnership была сформирована в 2024 году с целью ускорения инвестиций в ИИ-инфраструктуру нового поколения. По словам BlackRock, благодаря инвестициям в Aligned будет обеспечено создание инфраструктуры, необходимой для будущих ИИ-проектов. Aligned располагает 50 дата-центрами и 5 ГВт доступной мощности. Помимо США Aligned имеет серьёзный бизнес в Латинской Америке — компания приобрела OData, владеющей объектами в Бразилии, Чили, Колумбии и Мексике в мае 2023 года. Также она является инвестором канадского оператора ЦОД QScale SEC.

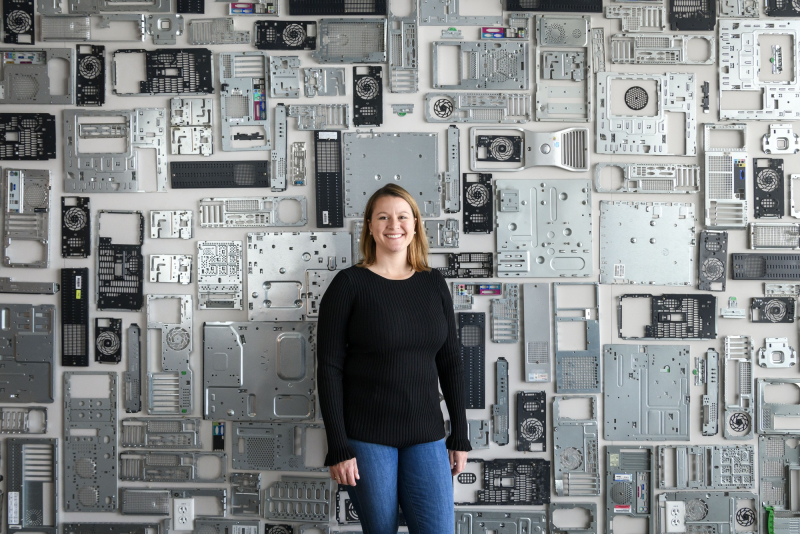

Источник изображения: Aligned Data Centers Как сообщает Datacenter Knowledge, в последние месяцы IT-гиганты тратили миллиарды долларов на создание достаточной для удовлетворения спроса инфраструктуры ЦОД на фоне нарастающего интереса бизнеса к ИИ. В UBS утверждают, что мировые инвестиции в искусственный интеллект могут составить в 2025 году $375 млрд, а к 2026 году — $500 млрд. Руководство Aligned Data Centers заявило, что новое партнёрство будет способствовать ускоренному выполнению миссии по созданию инфраструктуры, обеспечивающей будущее цифровой экономики. Компания утверждает, что готова к более активному масштабированию, дальнейшим инновациям и переосмыслению возможностей устойчивой инфраструктуры ЦОД. Руководителем Aligned останется Эндрю Шаап (Andrew Schaap), а компания сохранит штаб-квартиру в Далласе (Техас).

16.10.2025 [10:11], Сергей Карасёв

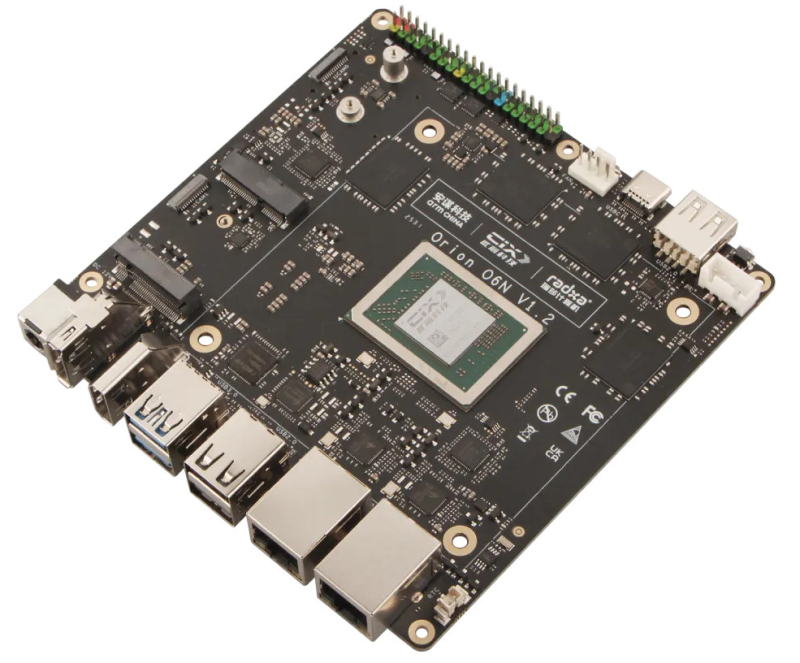

Одноплатный компьютер Radxa Orion O6N обеспечивает ИИ-производительность до 45 TOPSКомпания Radxa, как сообщает ресурс CNX Software, пополнила ассортимент одноплатных компьютеров моделью Orion O6N в форм-факторе Nano-ITX. Новинка предназначена для создания различных устройств с ИИ-функциями. В основу положен процессор Cix P1 (CD8160), который объединяет 12 ядер Arm в конфигурации 4 × Cortex-A720 с тактовой частотой до 2,6 ГГц, 4 × Cortex-A720 с частотой 2,4 ГГц и 4 × Arm Cortex-A520 с частотой 1,8 ГГц. Имеется графический ускоритель Arm Immortalis G720 MC10 с поддержкой Vulkan 1.3, OpenGL ES 3.2, OpenCL 3.0. Встроенный VPU-блок обеспечивает возможность декодирования материалов 8Kp60 AV1, H.265, H.264, VP9, VP8, H.263, MPEG-4 и MPEG-2, а также кодирования 8Kp30 H.265, H.264, VP9 и VP8. В состав чипа входит нейропроцессорный модуль (NPU) с производительностью до 30 TOPS (заявлена поддержка операций INT4/INT8/INT16, FP16/BF16, TF32). Общее ИИ-быстродействие Cix P1 достигает 45 TOPS. Изделие изготавливается по 6-нм технологии TSMC. Одноплатный компьютер может нести на борту от 8 до 64 Гбайт оперативной памяти LPDDR5-5500 (вариант с 32 Гбайт стоит около $200). Есть два коннектора M.2 M-Key для SSD с интерфейсом PCIe 4.0 x4 (NVMe) и разъём UFS. Кроме того, предусмотрены слот M.2 E-Key (PCIe 4.0 x2 + USB) для адаптера Wi-Fi 7/6E и Bluetooth, а также слот M.2 B-Key для модема 4G/5G. Присутствует двухпортовый сетевой контроллер 2.5GbE. Допускается вывод изображения одновременно на три монитора через интерфейсы HDMI 2.0 (до 4Kp60), DisplayPort 1.4 (до 4Kp120) и USB Type-C (DisplayPort Alt Mode; до 4Kp60). Упомянуты два интерфейса MIPI CSI (4 линии) и 40-контактная колодка GPIO с поддержкой 3 × UART, 2 × I2C, 2 × I2S, 2 × PWM, 1 × SPI и пр. В число доступных разъёмов входят два гнезда RJ45 для сетевых кабелей, три порта USB 2.0 Type-A, два порта USB 3.2 Gen2 Type-A, разъём USB 3.2 Gen2 Type-C. Питание (12 В) подаётся через DC-коннектор (5,5/2,5 мм). Габариты составляют 120 × 120 мм. Есть 4-контактный разъём для подсоединения вентилятора охлаждения с ШИМ-управлением. Заявлена совместимость с Debian/Ubuntu Linux.

16.10.2025 [00:33], Владимир Мироненко

От мВт до МВт: Arm и Meta✴ объявили о стратегическом партнёрство в области ИИArm Holdings и Meta✴ Platforms объявили о стратегическом партнёрстве, направленном на «масштабирование эффективности ИИ на каждом уровне вычислений, охватывающем ПО и инфраструктуру ЦОД». Как отмечено в пресс-релизе, сотрудничество позволит использовать ИИ в различных типах вычислений, рабочих нагрузках и процессах, которые лежат в основе глобальных платформ Meta✴, а также объединить «лидерство Arm в области энергоэффективных вычислений на базе ИИ с инновациями Meta✴ в области продуктов, инфраструктуры и открытых технологий на базе ИИ для достижения значительного повышения производительности и эффективности». «От взаимодействия с нашими платформами до создаваемых нами устройств, ИИ меняет способы взаимодействия и творчества людей. Партнёрство с Arm позволяет нам эффективно масштабировать эти инновации для более чем 3 млрд пользователей приложений и технологий Meta✴», — заявил руководитель глобальной инфраструктуры Meta✴. Сообщается, что в рамках сотрудничества системы ранжирования и рекомендаций Meta✴ на основе ИИ, играющие ключевую роль в поиске и персонализации в таких сервисах, как Facebook✴ и Instagram✴, будут использовать платформы Arm Neoverse для обеспечения более высокой производительности и более низкого энергопотребления по сравнению с x86-системами. Решения британского разработчика также позволят Meta✴ улучшить показатель производительности на Вт, что подчёркивает эффективность и масштабируемость Arm для гиперскейлеров, отметила Arm. Сделка с Meta✴ станет важным подтверждением эффективности архитектуры Arm, которая конкурирует с устоявшейся архитектурой x86, используемой Intel и AMD, отметило агентство Reuters. Новое соглашение позволит углубить сотрудничество в области оптимизации ПО для ИИ-технологий в рамках фреймворка МО PyTorch, движка выполнения периферийных вычислений ExecuTorch и движка инференса vLLM, а также обеспечит дальнейшее совершенствование платформы Executorch, оптимизированной с помощью Arm KleidiAI. Также компании отметили, что сотрудничество позволит упростить развёртывание ИИ-моделей и повысить производительность ИИ-приложений от периферии до облака.

Источник изображения: Meta✴ Сообщается, что проекты с открытым исходным кодом играют ключевую роль в стратегии Meta✴ в области ИИ, позволяя разрабатывать и внедрять различные решения: от рекомендаций до разговорного интеллекта. Компании подтвердили намерение расширять в дальнейшем возможности оптимизации этих проектов с открытым исходным кодом, позволяя миллионам разработчиков по всему миру создавать и запускать ИИ-решения на базе Arm. Работа над открытым исходным кодом будет способствовать более широкому внедрению Arm-архитектуры за счет повышения совместимости ПО, что является ключевым препятствием для её более широкого использования, пишет Reuters. Как отметил ресурс TechCrunch, Arm и Meta✴ не обмениваются долями собственности или элементами инфраструктуры, что отличает это соглашение о сотрудничестве от ряда недавних сделок на рынке ИИ-инфраструктуры. Доля Arm на рынке серверных процессоров стремительно выросла за последние годы, во многом благодаря ИИ-платформам NVIDIA. По данным The Register, пока речь идёт как раз об оптимизации ПО для уже развёрнутых Arm-платформ, а не о создании кастомного CPU.

15.10.2025 [23:05], Владимир Мироненко

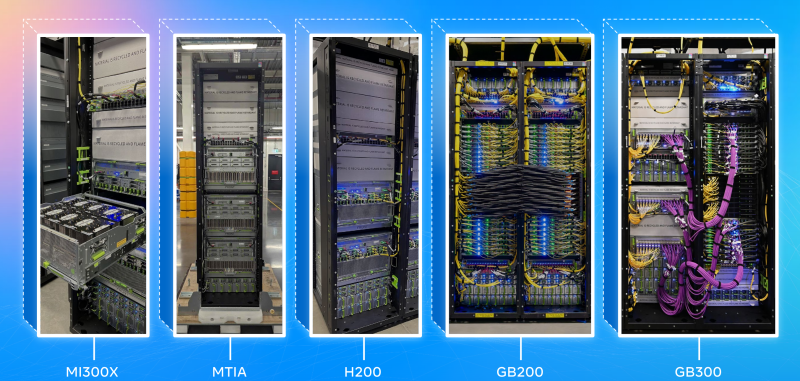

Microsoft арендует у Nscale ещё 116 тыс. ускорителей NVIDIA GB300Nscale и Microsoft заключили расширенное соглашение о предоставлении гиперскейлеру ИИ-инфраструктуры в США и Европе — 116,6 тыс. ускорителей на базе платформы NVIDIA GB300, сообщил Data Center Dynamics. Microsoft, как и другие крупные технологические компании, нуждается в увеличении вычислительных мощностей для удовлетворения растущего спроса на ИИ-технологии. С учётом более ранних контрактов Microsoft получит от Nscale почти 200 тыс. ускорителей. Nscale развернёт в течение следующих 12–18 мес. около 104 тыс. ускорителей в ЦОД Cedarvale в Барстоу (Barstow, шт. Техас), который она арендует у биткоин-майнера Ionic Digital в рамках десятилетнего соглашения стоимостью $2 млрд. На начальном этапе мощность инфраструктуры составит 240 МВт (хотя в пресс-релизе Ionic указано 234 МВт), а поэтапное предоставление её услуг Microsoft начнётся в III квартале 2026 года, сообщила Nscale. Nscale планирует в дальнейшем постепенно увеличить мощность объекта до 1,2 ГВт, при этом у Microsoft есть опцион на вторую фазу мощностью 700 МВт, начиная с конца 2027 года. В рамках соглашения Nscale также предоставит Microsoft для использования вычислительные мощности на базе до 12,6 тыс. ускорителей в кампусе Start Campus в Синише (Sines, Португалия). Монтаж оборудования здесь начнётся в I квартале 2026 года. На данный момент в эксплуатации находится один дата-центр кампуса, введённый в строй в январе 2025 года — SIN01. Сейчас ведётся строительство объекта SIN02 мощностью 180 МВт. Суммарно кампус будет включать шесть ЦОД. Nscale и Microsoft не назвали точную стоимость последних сделок, но исходя из аналогичной стоимости контракта на один ускоритель, их общая стоимость составляет до $14 млрд, сообщил ресурс The Financial Times. Ранее крупнейший среди неооблаков контракт был подписан между Microfoft и CoreWeave в интересах OpenAI, которая после разлада с Microsoft теперь напрямую закупает мощности у CoreWeave. В этом году Microsoft уже подписала сделки на аренду ИИ-мощностей с Nebius, Lambda и Nscale на общую сумму порядка $33 млрд. Новые сделки Nscale с Microsoft расширяют контракт стоимостью $6,2 млрд, в рамках которого Microsoft арендует вычислительные мощности на базе 52 тыс. ускорителей NVIDIA на объекте Nscale в Норвегии. Nscale и Microsoft также заняты реализацией крупного проекта в Великобритании. В прошлом месяце компании объявили о планах строительства самого мощного британского ИИ-суперкомпьютера в будущем ЦОД Nscale в Лоутоне (Loughton, граф. Эссекс), который, как ожидается, будет оснащён не менее 23 тыс. чипов Grace Blackwell Ultra. Но и от строительства собственных ИИ ЦОД Microsoft не отказывается.

15.10.2025 [16:25], Руслан Авдеев

Google вложит $15 млрд в развитие ИИ, ЦОД, сетей и энергетики в ИндииКомпания Google заявила о намерении создать хаб ИИ ЦОД гигаваттного класса в городе Вишакхапатнам (Visakhapatnam) индийского штата Андхра-Прадеш. Это первый объект компании в Индии, ориентированный на ИИ. Проект будет реализован в рамках инвестиционного плана на $15 млрд в 2026–2030 гг, сообщает Datacenter Knowledge. Это одна из крупнейших инвестиций Google в Азии. Проект призван объединить масштабные вычислительные мощности с источниками возобновляемой энергии и расширить возможности оптоволоконной связи для поддержки рабочих ИИ-нагрузок на территории всей Индии. Кампус будет развиваться в партнёрстве с AdaniConneX и телеком-компанией Airtel. ЦОД станет региональным облачным центром, центром исследований и хабом для внедрения технологий ИИ. Будут использоваться технологии исследовательских центров Google в Бангалоре, Хайдарабаде и Пуне. Кампус присоединится к глобальной сети ИИ ЦОД компании, охватывающей 12 стран. Проект также предусматривает строительство посадочной станции для подводного кабеля на восточном побережье Индии с подключением к нескольким международным кабелям для связи с глобальной подводной сетью Google общей протяжённостью более 3 млн км. Новая станция дополнит уже имеющиеся в Мумбае и Ченнаи, повысив надёжность, уменьшив задержки и увеличив пропускную способность сети.

Источник изображения: Vizag Explore/unsplash.com Рынок ЦОД в Индии стремительно растёт. По данным Omdia, в стране более 130 действующих ЦОД мощностью 1,18 ГВт и площадью более 1,1 млн м 2. Крупнейшие хабы находятся в Мумбаи, Хайдарабаде, Бангалоре, Дели, Ченнаи и Пуну, Ахмадабаде, Гургаоне, Нойду и Калькутте. Федеральные программы с налоговыми льготами, доступной землёй и субсидиями на электричество позволяют ускорить инвестиции. В 2026 году планируется построить ещё 35 ЦОД на 987 МВт. В недавнем отчёте JLL прогнозируется, что мощность ЦОД в Индии за следующие четыре года вырастет на 77 %. В январе Reliance Industries сообщила о намерении построить ЦОД на 3 ГВт в штате Гуджарат, который должен стать крупнейшим в мире. Компания Anant Raj из Дели также намерена инвестировать $2,1 млрд в строительство двух дата-центров в Харьяне (Haryana), к 2032 году установленная мощность там должна составить более 300 МВт. В Omdia предполагают, что государственная политика Индии стимулирует развитие индустрии ЦОД в стране. На рынке активно действуют как местные компании, так и глобальные игроки. Также Google развивает и сеть дата-центров и в США. Недавно она объявила о намерении вложить $9 млрд в проект ЦОД в Вирджинии. Ещё $9 млрд компания вложит в строительство кампуса ЦОД в Стиллуотере (Stillwater, Оклахома). В Орегоне одобрено расширение кампуса The Dalles — за $600 млн построят пятый по счёту ЦОД. Компания готовится построить до шести ЦОД в Айове, рядом с остановленной АЭС, которую могут перезапустить. Также Google заключила соглашение с Kairos Power и Tennessee Valley Authority в области атомной энергетики.

15.10.2025 [15:25], Руслан Авдеев

OpenAI и Oracle развернут 450 тыс. ускорителей NVIDIA в техасском дата-центре StargateПо словам председателя Oracle Ларри Эллисона (Larry Ellison), дата-центр проекта Stargate а Абилине (Abilene, Техас) вместит более 450 тыс. ускорителей на базе NVIDIA GB200, сообщает Datacenter Dynamics. Дата-центр Stargate получит 1,2 ГВт энергии — по словам Эллисона, энергии достаточно, чтобы обеспечить миллион домохозяйств в США. Как заявил миллиардер, «это довольно большой город». Питаться кампус будет как от энергосети штата, так и от газовых турбин. Информация подтверждает данные о том, что OpenAI и Oracle освоят всю ёмкость кампуса, застраиваемого Crusoe. Первые два строения уже функционируют, они введены в эксплуатацию в сентябре 2025 года. Строительство оставшихся шести зданий должны быть завершены к середине 2026 года. В марте 2025 года заявлялось, что площадка получит 64 тыс. ускорителей NVIDIA к концу 2026 года. С тех пор OpenAI подписала не имеющее обязательной силы письмо о намерении арендовать оборудование NVIDIA на 10 ГВт, которая в ответ пообещала инвестировать в OpenAI $100 млрд.

Источник изображения: OpenAI О росте числа используемых Stargate ускорителей можно было догадаться после анонса Oracle облачного ИИ-суперкомпьютера Zettascale10, который должен заработать во II половине 2026 года. Он объединит до 800 тыс. ускорителей в нескольких близко расположенных ЦОД. В Oracle отмечали, что суперкомпьютер станет основой флагманского суперкластера, создаваемого при участии OpenAI в Абилине в рамках проекта Stargate.

15.10.2025 [13:34], Руслан Авдеев

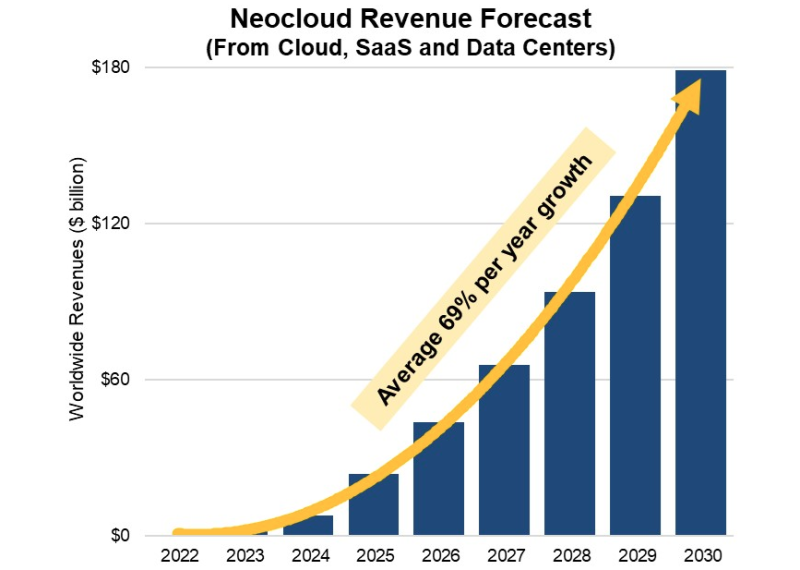

Квартальная выручка неооблаков выросла на 200 %, а в 2030 году она достигнет $180 млрдНовые данные Synergy Research Group свидетельствуют о том, что выручка неооблачных (neocloud) компаний преодолела во II квартале 2025 года отметку в $5 млрд, рост составил 205 % год к году. За весь год выручка, вероятно, превысит $23 млрд. Эксперты компании прогнозируют, что в 2030 году выручка достигнет почти $180 млрд, среднегодовой темп прироста составит порядка 69 %. Хотя неооблачные компании столкнулись с ожесточённой конкуренцией, они получают основную прибыль от работы с нишами, в которых наблюдается взрывной рост, и это чрезвычайно выгодно. Хотя перспективы таких компаний пока не вполне ясны, в среднем Synergy ожидает их стабильного роста. В конкуренции с «классическими» провайдерами-гиперскейлерами безусловным лидером посчитали компанию CoreWeave, в своё время оставившую криптовалютный бизнес для работы с ИИ-облаками. Хотя бизнес-модель OpenAI отличается от средств заработка прочих неооблачных провайдеров, компания считается в группе крупнейшей и останется ключевым игроком в ближайшие годы благодаря инициативам Stargate. Неооблачные компании представляют собой новые, развивающиеся облачные вычислительные платформы, обеспечивающие высокую производительность, ориентированную на использование ИИ-ускорителей инфраструктуру. Основными направлениями являются предоставление в аренду ускорителей (GPUaaS), платформенные сервисы для разработки и запуска генеративного ИИ (GenAI), а также управление высокопроизводительными дата-центрами.

Источник изображения: Synergy Research Group На сегодня основными компаниями, зарабатывающими на этом рынке существенные средства и влияющими на состояние фондового рынка, являются CoreWeave, Crusoe, Lambda, Nebius и OpenAI. В первую очередь благодаря OpenAI неооблака также предоставляют SaaS-подобные подписки для доступа к передовым ИИ-ботам. Помимо ведущих компаний из этой ниши, имеется ряд бизнесов намного менее масштабных или на ранних стадиях запуска: Altair, Applied Digital, Bitdeer, Core42, Core Scientific, DataRobot, Fluidstack, Hive Digital, HUMAIN, Hut8, IREN, Mawson, Northern Data Group, Nscale, TeraWulf, Together AI и WhiteFiber. Неооблачные компании являются относительно небольшими стартапами, либо компаниями, изменившими бизнес-модели с криптовалютных проектов на облачные вычислительные сервисы. Ведущие гиперскейлеры также предоставляют в аренду ИИ-ускорители и предлагают ИИ-сервисы, но неооблачные компании в основном обеспечивают доступ именно к чипам и сопутствующей инфраструктуре, а не широкому портфолио облачных сервисов. Как заявляют в Synergy, если не рассматривать «хайп», сопутствующий деятельности неооблачных компаний, темпы их роста и перспективы действительно впечатляют. GPUaaS и ИИ-сервисы растут сегодня на 165 % в год, причём неооблачные бизнесы играют в этих сегментах заметную роль. Есть все основания полагать, что они продолжать наращивать долю рынка на фоне того, что все облачные провайдеры стремятся удовлетворить растущий спрос на ИИ. У аналитиков JLL имеются собственные выкладки о прогрессе неооблачных компаний. В конце сентября компания сообщила, что среднегодовой темп роста выручки (GAGR) неооблаков с 2021 года составил 82 %.

15.10.2025 [12:14], Владимир Мироненко

Oracle запустит в 2026 году ИИ-кластер на базе 50 тыс. AMD Instinct MI450Oracle объявила о расширении сотрудничества с AMD, в рамках которого Oracle Cloud Infrastructure (OCI) запустит первый публично доступный ИИ-суперкластер на базе 50 тыс. ускорителей AMD Instinct MI450. Согласно пресс-релизу, первоначальное развёртывание кластера начнётся в III квартале 2026 года, после чего он будет расширяться в 2027 году, а также в дальнейшем. Будущие ИИ-кластеры OCI будут основаны на стоечной архитектуре AMD Helios с использованием ускорителей AMD Instinct серии MI450, процессоров AMD EPYC следующего поколения с кодовым названием Venice и сетевой системы AMD Pensando следующего поколения с кодовым названием Vulcano. Махеш Тиагараджан (Mahesh Thiagarajan), исполнительный вице-президент OCI отметил, что благодаря десятилетнему сотрудничеству с AMD — от ускорителей EPYC до AMD Instinct — компания продолжает предоставлять «оптимальную по соотношению цены и производительности, открытую, безопасную и масштабируемую облачную платформу в партнерстве с AMD, чтобы удовлетворить потребности клиентов в новой эре ИИ». Ускоритель AMD Instinct MI450 основан на архитектуре CDNA 5 и изготавливается по 2-нм техпроцессу TSMC. Ускоритель будет обладать до 432 Гбайт памяти HBM4 с пропускной способностью 20 Тбайт/с. Стойка AMD Helios с 72 ускорителями AMD Instinct MI450 объединяет возможности масштабирования UALoE и масштабируемую сеть на базе Ethernet, соответствующую стандартам Ultra Ethernet (UEC), для минимизации задержек и максимальной пропускной способности между модулями и стойками.

Источник изображения: Oracle Сообщается, что процессоры EPYC (Venice) будут предлагать возможности конфиденциальных вычислений и встроенные функции безопасности для комплексной защиты конфиденциальных рабочих ИИ-нагрузок. Конвергентные сети с DPU, созданные на основе полностью программируемой технологии AMD Pensando, обеспечат безопасность и производительность, необходимые ЦОД для работы с ИИ следующего поколения, включая обучение, инференс и облачные рабочие нагрузки. Каждый ускоритель может быть оснащён до трёх DPU Vulcano со скоростью передачи данных 800 Гбит/с. Несколько месяцев назад Oracle и AMD объявили, что провайдер облачных вычислений развернёт кластер, включающий до 131 072 ускорителей AMD MI355X, на основе ранее запущенного кластера на базе AMD Instinct MI300X. Ранее в этом месяце стало известно о соглашении AMD с OpenAI на поставку ИИ-ускорителей AMD нескольких поколений общей мощностью 6 ГВт на сумму около $60–$80 млрд для обеспечения её ИИ-инфраструктуры.

15.10.2025 [09:13], Сергей Карасёв

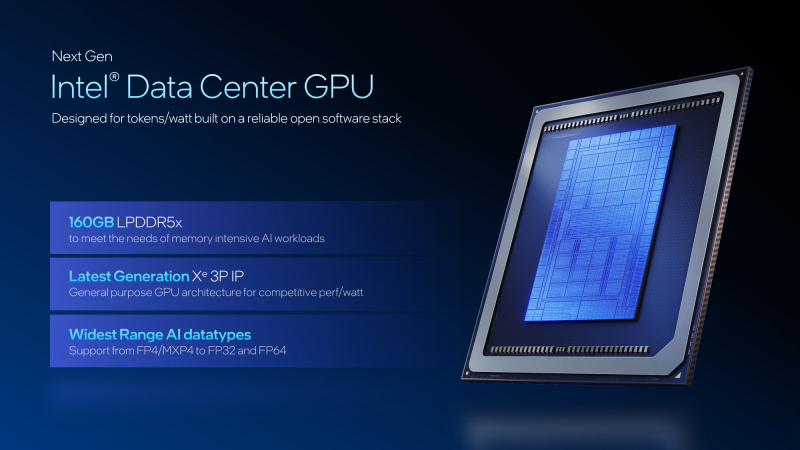

Intel представила GPU-ускоритель Crescent Island для ИИ-инференсаКорпорация Intel, как и ожидалось, представила на мероприятии OCP Global Summit в Сан-Хосе (Калифорния, США) графический процессор нового поколения для дата-центров. Изделие с кодовым названием Crescent Island специально оптимизировано для задач ИИ-инференса. В основу GPU положена архитектура Xe3P. Она представляет собой усовершенствованную версию Xe3, которая используется в процессорах Core Ultra 300 семейства Panther Lake для ноутбуков и компактных настольных ПК. Говорится об улучшенном показателе производительности в расчёте на 1 Вт затрачиваемой энергии. Ускоритель на базе Crescent Island получит 160 Гбайт памяти LPDDR5X. Как отмечает ресурс Tom's Hardware, максимальный объём чипов LPDDR5X составляет 8 Гбайт. При этом используются два 16-бит канала памяти, что в сумме даёт 32 бита. Таким образом, для обеспечения 160 Гбайт памяти требуются 20 чипов LPDDR5X. Это означает, что ускоритель получит либо один массивный GPU с 640-бит интерфейсом памяти для подключения всех 20 чипов LPDDR5X, либо два менее крупных процессора с 320-бит интерфейсом, каждый из которых будет обслуживать 10 чипов LPDDR5X. Прочие технические детали не раскрываются. При этом Intel отмечает, что изделие Crescent Island предназначено для использования в серверах с воздушным охлаждением. GPU поддерживает работу с широким спектром типов данных, благодаря чему может применяться в составе облачных платформ «токен как услуга» (tokens-as-a-service). Пробные поставки новинки планируется начать во II половине 2026 года, тогда как широкая доступность ожидается не ранее 2027-го. Решениям на основе Crescent Island предстоит конкурировать с ИИ-ускорителями AMD и NVIDIA следующего поколения, такими как Rubin CPX. |

|