Материалы по тегу: google

|

17.09.2025 [13:15], Руслан Авдеев

Собственный ЦОД Stargate и крупнейший в стране ИИ-суперкомпьютер: американские IT-гиганты вложат более $40 млрд в развитие ИИ в Великобритании

coreweave

google

hardware

microsoft

nscale

nvidia

openai

salesforce

stargate

великобритания

ии

инвестиции

суперкомпьютер

сша

финансы

цод

Microsoft объявила о намерении вложить около $30 млрд в ИИ-проекты на территории Великобритании к 2028 году. $15,5 млрд уйдёт на капитальное расширение в течение трёх лет, а $15,1 млрд — на операции в стране, сообщает CNBC. В частности, инвестиции позволят построить «крупнейший суперкомпьютер» в Великобритании с более 23 тыс. передовых ускорителей (24 тыс. по данным NVIDIA) совместно с британской Nscale. Дата запуска не раскрывалась, но в Nscale ранее объявляли, что новый ЦОД компании заработает в 2026 году и обеспечит доступ к 46 тыс. ускорителей. Планируемая мощность составляет 50 МВт, а всего на площадку выделено 90 МВт. На фоне государственного визита в Великобританию президента США Дональда Трампа (Donald Trump), инвестировать в развитие ИИ в стране пообещали NVIDIA, Google, OpenAI и Salesforce, общая сумма превысит $40 млрд. Эксперты ожидают, что премьер-министр Великобритании Кир Стармер и Дональд Трамп подпишут 17 сентября новое соглашение, открывая путь к инвестициям и сотрудничеству в сфере ИИ, квантовых и ядерных технологий. Президент Microsoft Брэд Смит (Brad Smith) заявил, что его позиция в отношении Великобритании «потеплела» с годами, ранее он критиковал Соединённое Королевство за попытку заблокировать в 2023 году сделку Microsoft по покупке Activision-Blizzard за $69 млрд. Впрочем, в том же году она была одобрена. По словам Смита, его воодушевляют сделанные правительстовм в последние несколько лет шаги для улучшения делового климата — ещё несколько лет назад подобные инвестиции были бы немыслимы из-за действующих норм и практики. Кроме того, не было спроса на такие вложения в ИИ. NVIDIA уже объявила о намерении вложить в Великобританию совместно с Nscale и CoreWeave £11 млрд ($15 млрд). NVIDIA намерена разместить в Соединённом Королевстве 120 тыс. ИИ-ускорителей Blackwell, это станет крупнейшим в этом роде проектом компании в Европе. Утверждается, что это сделает Великобританию действительно «производителем ИИ, а не потребителем».

Источник изображения: chan lee/unsplash.com Инвестировать в ИИ-проекты в Великобритании £5 млрд ($6,8 млрд) намерена Google. Компания откроет новый ЦОД в 19 километрах от центра Лондона. В Google уверены, что новый дата-центр поможет удовлетворить спрос на сервисы компании с ИИ-элементами: Google Cloud, Workspace, Search и Maps. Предполагается, что инвестиции позволят ежегодно создавать 8250 рабочих мест в британских компаниях. Значительный вклад внесёт и OpenAI благодаря проекту Stargate UK. Речь идёт о специализированной местной версии масштабного проекта, совместно реализуемого с SoftBank и Oracle. В Великобритании ИИ-стартап будет сотрудничать над проектом с Nscale и NVIDIA. OpenAI уже заявила, что в начале 2026 года для внедрения в Великобритании будут развёрнуты 8 тыс. ИИ-ускорителей с возможностью расширения мощностей до 31 тыс. в будущем. Первая крупная стройка для Stargate UK запланирована на территории Cobalt Park в Ньюкасле (Newcastle) на севере Англии. Salesforce объявила о планах увеличить инвестиции в Великобритании до $6 млрд, увеличив обязательства в сравнении с 2023 годом до $4 млрд. В Salesforce подчеркнули, что визит Трампа в Великобританию подтверждает важность отношений между Великобританией и США. Наконец, CoreWeave объявила о дополнительных инвестициях в размере £1,5 млрд для увеличения мощности своего ИИ ЦОД в стране. Благодаря этому обязательству общий объем инвестиций CoreWeave в этой стране достигнет £2,5 млрд. Суммарный объём инвестиций IT-гигантов превысит $40 млрд.

16.09.2025 [16:37], Руслан Авдеев

Google сообщила об инвестициях £5 млрд в развитие ИИ в ВеликобританииAlphabet объявила об инвестициях £5 млрд ($6,8 млрд) в развитие искусственного интеллекта в Великобритании. Новость появилась как раз в то время, когда страна готовится к визиту президента США Дональда Трампа (Donald Trump), сообщает CNBC. Ожидается, что визит совпадёт с заключением череды деловых соглашений. Двухлетний план инвестиций Google, вероятно, окажет ощутимую поддержку правительству Великобритании, переживающему не лучшие времена. Американский IT-гигант объявил об открытии нового дата-центра в Уолтем-Кроссе (Waltham Cross), приблизительно в 19 км к северу от центра Лондона. В Google уверены, что объект поможет удовлетворить растущий спрос на сервисы компании с элементами ИИ. По-видимому, речь идёт о кампусе DC01 UK стоимостью £3,75 млрд ($4,9 млрд), который станет одним из крупнейших в Европе. Для кампуса уже зарезервировано 400 МВ·А, но присоединение намечено лишь на 2029 год. Как сообщают в Google, выделенная сумма позволит ежегодно создавать 8250 рабочих мест в компаниях Великобритании и будет способствовать росту экономики на £400 млрд к 2030 году. По словам местного министра финансов Рэйчел Ривз (Rachel Reeves), поступившее от Google заявление стало «мощным вотумом доверия британской экономике и прочности партнёрства с США». Инвестиции Google в Соединённом Королевстве включают финансирование своего лондонского ИИ-стартапа DeepMind. Google также заявила о сделке с британским нефтегазовым гигантом Shell для управления поставками возобновляемой энергии в Великобритании. В компании уверены, что этот альянс будет способствовать стабильности местной энергосистемы и энергетическому переходу страны. В Shell подчёркивают, что разноплановое портфолио компании в области возобновляемой энергии, доступ к аккумуляторным хранилищам и опыт торговли энергией и оптимизации её использования позволяет удовлетворять меняющиеся потребности ведущих компаний мира и поддерживать дальнейший рост рынка ЦОД. Помимо Google, о готовности инвестиций в британские ЦОД объявляют и другие игроки. Так, буквально на днях появилась информация, что в местные дата-центры вложат миллиарды долларов OpenAI и NVIDIA, а совсем недавно выяснилось, что на ЦОД в Великобритании готова потратить £500 млн инвестиционная компания BlackRock.

04.09.2025 [14:47], Руслан Авдеев

Google бросила вызов NVIDIA, предложив малым облачным провайдерам собственные ИИ-ускорители TPUПо последним данным, Google обратилась к небольшим облачным провайдерам, обычно сдающим в аренду чипы NVIDIA, с необычным предложением — сдавать в аренду её собственные ИИ-ускорители TPU, ранее доступные только в облаке самой Google, сообщает Trendforce со ссылкой на The Information. Это может привести к прямой конкуренции с NVIDIA. Сообщается, что Google уже заключила соглашение как минимум с одним поставщиком облачных сервисов — лондонской Fluidstack. Предполагается разместить TPU в нью-йоркском дата-центре последней. Fluidstack предложены льготы для расширения бизнеса за счёт TPU. Если компания не сможет покрыть расходы на аренду ЦОД в Нью-Йорке, Google обещает предоставить поддержку в объёме до $3,2 млрд. Как утверждается в отчёте, Google ориентируется на молодые компании, в основном на поставщиков облачных услуг, активных пользователей ускорителей NVIDIA. Сообщается, что она уже пыталась заключить аналогичные договоры с другими поставщиками, в настоящее время отдающими предпочтение NVIDIA — включая такие перспективные компании как Crusoe, которая строит ЦОД для OpenAI. Также возможно сотрудничество с CoreWeave, сдающей оборудование NVIDIA в аренду Microsoft (в основном для OpenAI) и также имеющей прямой контракт с OpenAI.

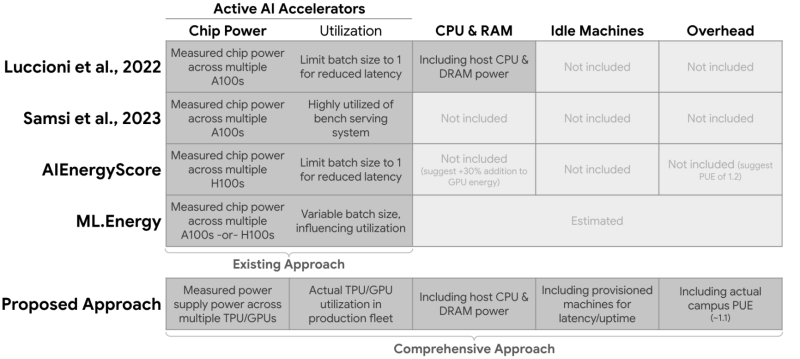

Источник изображения: Google Google довольно давно работает над созданием ИИ-ускорителей. По данным источников The Information, компания рассматривала возможности расширения связанного с TPU бизнеса, чтобы увеличить выручку и снизить зависимость от чипов NVIDIA. По оценкам Morningstar, совокупную стоимость бизнеса TPU и подразделения DeepMind составляет приблизительно $900 млрд. Отмечается, что вышедшие в декабре 2024 года TPU Trillium шестого поколения, весьма востребованы, ожидается и рост спроса на седьмое поколение ускорителей — TPU Ironwood. Это первая модель, разработанная для масштабного инференса. Ранее Google в основном применяла TPU для собственных проектов. Однако некоторое время назад доступность TPU для внешних заказчиков в рамках Google Cloud стала намного выше. Эти чипы использует, например, Apple. Впрочем, и она теперь хочет получить ускорители NVIDIA.

27.08.2025 [09:25], Руслан Авдеев

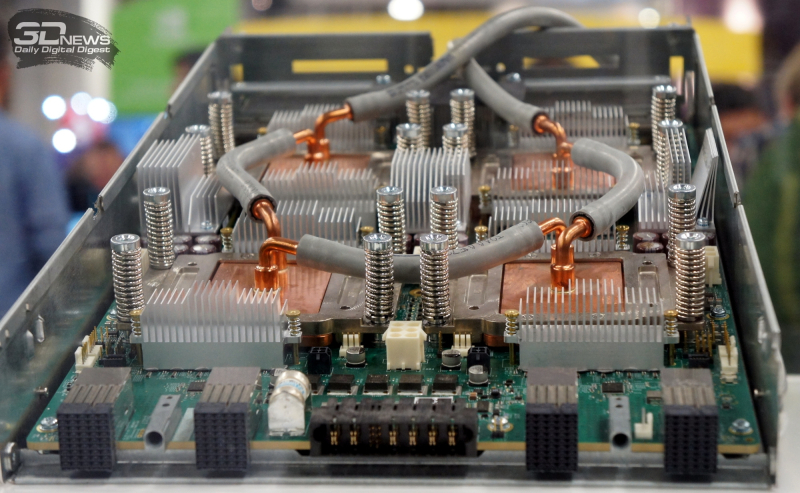

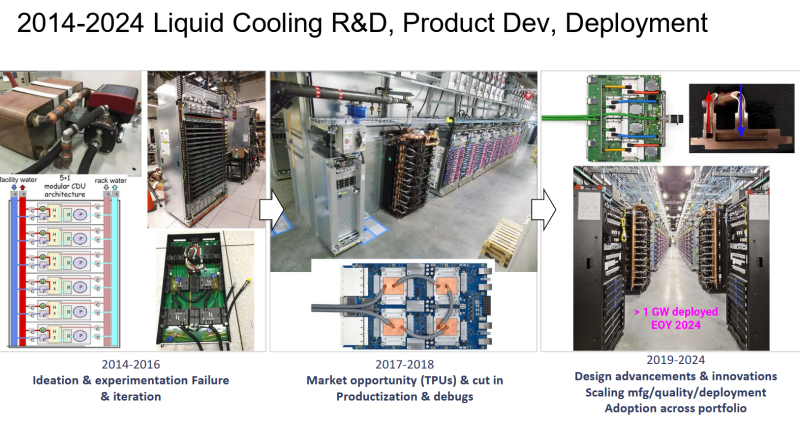

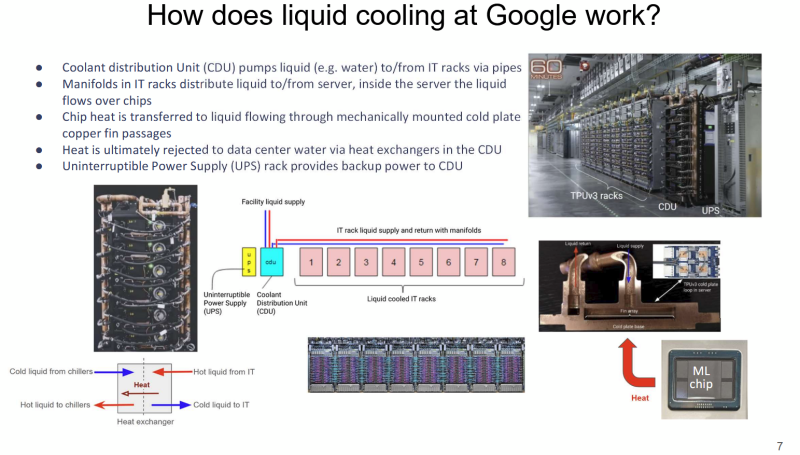

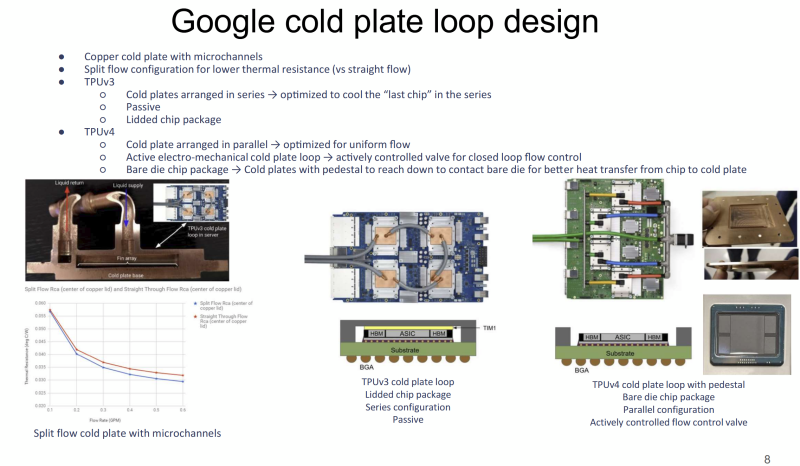

Большому ИИ — большую СЖО: Google рассказала о системе охлаждения TPUЖидкостное охлаждение (СЖО) в ЦОД применяется давно, хотя и не повсеместно. В последнее время оно играет всё более важную роль на фоне роста энергопотребления и тепловыделения ИИ-оборудования. Google рассказала об эволюции охлаждении на уровне дата-центров для своих ИИ-ускорителей TPU, сообщает Chips and Cheese. Google впервые оснастила свои TPU жидкостным охлаждением ещё в 2018 году после ряда экспериментов, и с тех пор совершенствует СЖО. Текущие решения предназначены именно для масштабов ЦОД. Так, стойки с шестью (5+1) блоками распределения жидкости (CDU) обслуживают до восьми стоек с TPU. Применяются гибкие шланги и быстроразъёмные соединения для удобства обслуживания. Во внутреннем контуре чипы в контуре соединены последовательно, что приводит к прогреву теплоносителя, поэтому расчёт охлаждающей мощности ведётся по самому горячему чипу в конце каждого контура. От CDU через теплообменники тепло передаётся в общую систему водоснабжения объекта без смешения жидкостей (в обоих контурах вода). По данным Google, энергопотребление насосов СЖО составляет менее 5 % от мощности вентиляторов, необходимых для воздушного охлаждения. Google применяет водоблок с разделённым потоком жидкости. Для охлаждения TPUv4 применялась система охлаждения открытого кристалла (bare-die). Способ не вполне безопасен, но с случае с TPUv4 такой подход необходим, поскольку такие ускорители потребляют в 1,6 раз больше энергии, чем TPUv3. Кроме того, компании пришлось поработать над проблемами протечек и появления микроорганизмов. Google тщательно проверяет компоненты на герметичность, использует специальные системы оповещения об утечках и проводит плановое обслуживание и фильтрацию. Дополнительно у компании есть набор протоколов реагирования на проблемы и оповещения, что позволяет оперативно устранять угрозы, которые в масштабах ЦОД могут быть весьма существенными. В мае сообщалось, что Google готовит мегаваттные стойки. Строго говоря, компания уже начала использовать 416 В AC на входе в стойки и DC-конвертеры, а также оснащать их встроенными ИБП. Кроме того, она динамически управляет энергопотреблением и производительностью как отдельных TPU, так и стоек в целом.

22.08.2025 [17:23], Руслан Авдеев

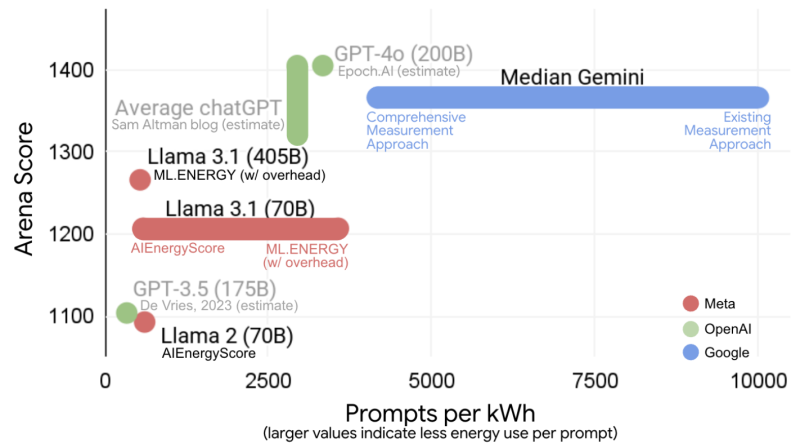

Google: медианный промпт Gemini потребляет 0,24 Вт·ч энергии и 0,26 мл водыКомпания Google опубликовала документ, в котором описывается методология измерения потребления энергии и воды, а также выбросов и воздействия на окружающую среду ИИ Gemini. Как утверждают в Google, «медианное» потребление энергии на одно текстовое сообщение в Gemini Apps составляет 0,24 Вт·ч, выбросы составляют 0,03 г эквивалента углекислого газа (CO2e), а воды расходуется 0,26 мл. В компании подчёркивают, что показатели намного ниже в сравнении со многими публичными оценками, а на каждый запрос тратится электричества столько же, сколько при просмотре телевизора в течение девяти секунд. Google на основе данных о сокращении выбросов в ЦОД и декарбонизации энергопоставок полагает, что за последние 12 месяцев энергопотребление и общий углеродный след сократились в 33 и 44 раза соответственно. В компании надеются, что исследование внесёт вклад в усилия по разработке эффективного ИИ для общего блага. Методологии расчёта энергопотребления учитывает энергию, потребляемую активными ИИ-ускорителями (TPU), CPU, RAM, а также затраты простаивающих машин и общие расходы ЦОД. При этом из расчёта исключаются затраты на передачу данных по внешней сети, энергия устройств конечных пользователей, расходы на обучение моделей и хранение данных. Впрочем, по мнению некоторых экспертов, данные вводят в заблуждение, поскольку часть информации не учитывается. Так, не принимается в расчёт «косвенное» использование воды, поскольку считается только вода, которую ЦОД применяют для охлаждения, хотя значительная часть водопотребления приходится на генерирующие мощности, а не на их потребителей. Кроме того, при учёте углеродных выбросов должны приниматься во внимание не купленные «зелёные сертификаты», а реальное загрязняющее действие ЦОД в конкретной локации с учётом использования «чистой» и «обычной» энергии в местной электросети. OpenAI также недавно оказалась в центре внимания экспертов и общественности, поскольку появилась информация, что её новейшая модель GPT-5 потребляет более 18 Вт·ч электроэнергии, до 40 Вт·ч на ответ средней длины. Сам глава компании Сэм Альтман (Sam Altman) объявил, что в среднем на выполнение запроса тратится около 0,34 Вт∙ч и около 0,32 мл воды. Это несколько больше, чем заявленные показатели Google Gemini, однако, согласно расчётам исследователей, эти цифры, скорее всего, актуальны для GPT-4o.

21.08.2025 [12:45], Руслан Авдеев

Google наконец построит ЦОД в Австрии — через 17 лет после покупки землиGoogle, наконец, займётся строительством дата-центра в Австрии. Примечательно, что работы начнутся спустя 17 лет после того, как компания приобрела первый земельный участок под этот проект, сообщает Datacenter Dynamics. По данным локальных СМИ, IT-гигант не отказался от планов строительства в австрийском Кронсторфе (Kronstorf) округа Линц-Ланд (Linz-Land) и подал проект на рассмотрение местным регуляторам. Кронсторф расположен между Веной и Зальцбургом. Разрешение на строительство могут выдать уже в конце 2025 года. По словам властей Кронсторфа, Google действительно представила конкретный проект как торговому, так и строительному ведомствам. Подробные данные о технических характеристиках и сроках строительства пока не разглашаются. Местная пресса сообщает, что подготовительные работы уже ведутся и экскаваторы находятся на месте. Впрочем, в самой Google новость не комментируют. При этом в городе действуют определённые правила проведения работ, и пока проект проходит официальную экспертизу. Позднее его необходимо будет согласовать со всеми заинтересованными сторонами, и только после этого Google сделает официальное заявление.

Источник изображения: Hasmik Ghazaryan Olson/unsplash.com В 2008 году компания купила порядка 70 га земли недалеко от ГЭС на реке Энс. На тот момент сообщалось, что Google намерена вложить в участок около €200 млн в течение следующих двух лет. Однако Google не выполнила договорные обязательства, касающиеся строительства, и региональная торговая ассоциация Inkoba совместно с местными регуляторами инициировала частичную отмену сделки. В результате Google сохранила за собой 50 га, а 20 га были выкуплены обратно. При этом IT-гигант продолжал проявлять интерес к объекту и в последующие годы, занимаясь модернизацией электроснабжения и проводя встречи с местными чиновниками. В Австрии работает не только Google. Microsoft недавно запустила облачный регион близ Вены. Свои дата-центры в том же округе имеют NTT, Digital Realty, AtlasEdge, A1, Exa и несколько местных игроков. У самой Google имеются облачные регионы во Франкфурте (в т.ч. собственная площадка в Ханау земли Гессен) и Берлине. Кроме Германии, есть объекты в Цюрихе (Швейцария) и Милане (Италия). Все они расположены не так уж далеко от Австрии.

20.08.2025 [16:15], Руслан Авдеев

Fluidstack арендовала 360 МВт у криптомайнера TeraWulf, который частично принадлежит GoogleКриптомайнинговая компания TeraWulf и провайдер ИИ-облака Fluidstack расширили договор аренды, подписанный буквально на прошлой неделе. На тот момент стороны заключили соглашение, предусматривавшее аренду Fluidstack 200 МВт IT-нагрузки (около 250 МВт общей мощности) в кампусе TeraWulf Lake Mariner в Нью-Йорке, а теперь решили добавить ещё 160 МВт, сообщает Datacenter Dynamics. Благодаря очередному расширению законтрактованная мощность увеличилась до 360 МВт, что соответствует $6,7 млрд выручки с потенциалом увеличения до $16 млрд путём дальнейшего развития бизнеса. Для поддержки расширения Google увеличит вливания до $3,2 млрд, доведя свою долю в TeraWulf приблизительно до 14 %. В настоящее время общая мощность кампуса Lake Mariner, расположенного на месте закрытой угольной электростанции, составляет 500 МВт с возможностью расширения до 750 МВт. Изначально кампус был ориентирован на криптомайнинг, но теперь обслуживает ИИ- и HPC-нагрузки. Так, одним из арендаторов кампуса стала Core42 (G42) из ОАЭ. Сделка позволит Fluidstack развернуть 40 МВт IT-нагрузок в I полугодии 2026 года, а 200 МВт будут развёрнуты к концу 2026 года на объектах CB-3 и CB-4. Оставшиеся 160 МВт будут развёрнуты на объекте CB-5, который должен заработать во II полугодии 2026 года. По словам TeraWulf, расширение подчёркивает масштаб и возможности кампуса. Построив CB-5, компания не только увеличит контрактные мощности для Fluidstack, но и укрепит стратегическое сотрудничество с ключевым финансовым партнёром в лице Google для создания ИИ-инфраструктуры нового поколения. Fluidstack основана в 2017 году в Оксфордском университете. Сегодня компания располагает более 100 тыс. ИИ-ускорителей, в число клиентов входят Mistral AI, Character.AI, Poolside и Black Forest Labs. В 2025 году компания объявила о соглашении с Macquarie Group об обеспечение ИИ-мощностями европейских исследовательских лабораторий, занимающихся ИИ-проектами. Кроме того, сообщалось о сотрудничестве с NVIDIA, Borealis и Dell для создания экзафлопсных ИИ-кластеров в Исландии и Северной Европе. В феврале 2025 года Fluidstack подписала меморандум о взаимопонимании с французским правительством, согласно которому она построит во Франции ИИ-суперкомпьютер мощностью 1 ГВт.

20.08.2025 [14:08], Руслан Авдеев

Amazon, Google и Microsoft призвали США сохранить субсидии на возобновляемые источники энергии ради борьбы с КНР за первенство в сфере ИИ

amazon

google

hardware

microsoft

возобновляемая энергия

гиперскейлер

дефицит

закон

ии

сша

цод

экология

энергетика

Объединение крупных владельцев ЦОД Data Center Coalition, включающее Microsoft, Amazon (AWS), Google, Meta✴, CyrusOne, Stack, CloudHQ, Vantage и др. призвало Министерство финансов США не отменять субсидии на ветряную и солнечную энергетику. По словам представителей коалиции, имеющиеся льготы дают отрасли в США преимущество перед конкурентами из Китая, передаёт Reuters. Как заявляется в письме коалиции главе министерства, любые регуляторные препятствия, замедляющие развёртывание новых генерирующих мощностей, напрямую влияют на способность удовлетворять энергетические потребности ИИ. Администрация Трампа предпринимает активные попытки отменить ряд налоговых льгот, способствующих росту возобновляемой энергетики США. Так, один из основополагающих новых законопроектов предполагает налог в 50 % с ветряных генерирующих мощностей и 30 % с солнечной энергетики, если соответствующие проекты завершены после декабря 2027 года. Во всяком случае, если те не смогут доказать, что в них не использовались китайские комплектующие. Если же строительство объекта «чистой» энергетики начнётся после 2032 года, то размер налоговых кредитов (Clean Electricity Tax Credits) будет автоматически уменьшаться, независимо от того, достигнуты ли общие целевые показатели по сокращению выбросов, установленные законом. В поддержку такого решения президент США заявил, что возобновляемые источники дорого обходятся, нестабильны, зависят от цепочек поставок, контролируемых из-за рубежа, и даже наносят вред окружающей среде и стабильности электросетей. На прошлой неделе Министерство финансов США опубликовало правила, регламентирующие получение налоговых льгот для проектов, связанных с ветряной и солнечной энергетикой. Они, в частности, отменяют налоговый вычет в размере 5 % для любых проектов мощнее 1,5 МВт — это может оказать негативное влияние на уже запланированные инвестиции в отрасль в объёме более $100 млрд в рамках проектов общей мощностью 6 ГВт.

Источник изображения: Laura Ockel/unsplash.com При этом источники возобновляемой энергии, особенно солнечные, в среднем дешевле других альтернатив ископаемому топливу. Опубликованное в 2023 году исследование Energy Innovation показало, что 99 % действующих угольных электростанций США дороже в эксплуатации, чем солнечные или ветряные электростанции. Утверждается, что солнечная энергия минимум на 30 % дешевле. Впрочем, Трамп принимает меры для реанимации угольных ТЭС и других источников на ископаемом топливе. Крупнейшими потребителями возобновляемой энергии в США являются операторы дата-центров, особенно крупные гиперскейлеры. В марте 2025 года сообщалось, что американские технологические бизнесы заключили контракты о поставке в общей сложности 48 ГВт «чистой» энергии (в годовом исчислении). Это на 66,4 % больше год к году. Большинство соответствующих договоров представляют собой соглашения о покупке электроэнергии (PPA), например, на 300 МВт между Meta✴ и Longroad Energy, на 734 МВт — между Google и Leeward Energy, отмечает DataCenter Dynamics.

19.08.2025 [14:47], Руслан Авдеев

Американские дата-центры Google подключат к малым модульным реакторам Kairos — начнут с 50 МВтРазрабатывающая малые модульные реакторы (SMR) компания Kairos Power, поддерживаемая Google, заключила договор (PPA) о покупке 50 МВт энергии с коммунальной компанией Tennessee Valley Authority (TVA) из США. Речь идёт о поставке энергии от реакторов для ЦОД Google в Теннесси и Алабаме через энергосеть TVA, сообщает Datacenter Dynamics. Предполагается, что это позволит снизить углеродные выбросы ЦОД в округах Монтгомери (Теннесси) и Джексон (Алабама). Подписанные PPA — первые в рамках соглашения, заключенного Google и Kairos в 2024 году. Тогда IT-гигант обязался закупить до 500 МВт от шести-семи реакторов, которые, как ожидается, будут введены в эксплуатацию к 2035 году. Сотрудничество компаний должно ускорить внедрение ядерной энергетики и помочь удовлетворить потребности растущей цифровой экономики в безуглеродной энергии. Это первое PPA-соглашение, подписанное между американской коммунальной компанией и разработчиком передовых реакторов Gen IV SMR. Электричество будет поставляться с АЭС Hermes 2 компании Kairos Power в Ок-Ридже (Oak Ridge, Теннесси). Строительство станции в технопарке East Tennessee Technology Park Heritage Center началось в июле 2024 года, а первый энергоблок планируется завершить к концу 2027-го.

Источник изображения: Kairos Power В TVA заявляют, что новое сотрудничество поможет США победить в гонке за первенство в сфере искусственного интеллекта с участием компаний вроде Google. Чтобы ускорить поставки энергии в соответствии с PPA, планируется увеличить мощность выработки электричества каждым реактором Hermes 2 с 28 до 50 МВт. Ожидается, что на полную мощность станция выйдет к 2030 году. Цель Kairos — демонстрация SMR с технологией KP-FHR, использующего фторидную расплавленную соль в качестве теплоносителя и керамическое топливо в виде шаровых тепловыделяющих элементов. По словам Kairos, сотрудничество — важный фактор, способствующий коммерциализации передовой атомной энергетики. Обновлённый проект Hermes 2 позволит быстрее приблизиться к созданию коммерческого парка реакторов — это стало возможным только благодаря сотрудничеству с TVA и Google, а также поддержке местных жителей. Малые модульные реакторы становятся всё популярнее в секторе ЦОД. Только на прошлой неделе Equinix подписала три крупных соглашения с разработчиками SMR, в совокупности проекты способны обеспечить до 774 МВт. Кроме того, соглашения с разработчиками SMR за последний год подписали Amazon (AWS), Data4, Oracle, Switch и Endeavour.

17.08.2025 [18:08], Руслан Авдеев

Google потратит $9 млрд на развитие облачной и ИИ-инфраструктуры в Оклахоме — часть пойдёт на обучение электриковКомпания Google взяла обязательство вложить $9 млрд в расширение собственной облачной и ИИ-инфраструктуры на территории штата Оклахома (США). Инвестиции направят на развитие кампуса ЦОД в Стиллуотере (Stillwater) и расширение уже имеющегося объекта в Прайоре (Prior), сообщает Datacenter Dynamics. Часть выделенных средств будет потрачена на программы образования и развития персонала. В марте 2025 года стало известно, что Google подала заявку на строительство кампуса ЦОД в Стиллоутере. Тогда было объявлено, что на него потратят $3 млрд, а площадь кампуса составит более 160 га. Подробных данных о кампусе нет, но согласно проекту плана экономического развития от августа 2024 года, предполагается построить до шести зданий, каждое площадью почти 29 тыс. м2. На каждом этапе строительства предполагается строить по одному ЦОД. Объект в Прайоре Google анонсировала ещё в 2007 году, запуск состоялся в 2011-м. С тех пор дата-центр регулярно расширялся. Университет Оклахомы (University of Oklahoma) и Университет штата Оклахома (Oklahoma State University) готовы участвовать в инициативе Google AI for Education Accelerator. В её рамках можно будет получить сертификаты Google Career Certificates, а также доступ к бесплатным курсам обучения ИИ-навыкам. Также Google финансирует в Оклахоме национальную программу обучения, созданную для подготовки квалифицированных электриков — Electrical Training Alliance.

Источник изображения: Gerson Repreza/unsplash.com Ранее Оклахома никогда не считалась крупным рынком ЦОД и сопутствующих технологий. Среди недавно анонсировавших проекты ЦОД в Оклахоме — компании Cerebras, Damac и CoreWeave с Core Scientific. По слухам, кампус площадью около 138 га готовит и Meta✴. Также есть данные, что в мае подана заявка на строительство кампуса площадью более 200 га в Талсе (Tulsa), но что за компания стоит за проектом, не разглашается. |

|