Материалы по тегу: hgx

|

14.10.2025 [09:54], Сергей Карасёв

Giga Computing представила ИИ-сервер TO86-SD1 на платформе NVIDIA HGX B200Компания Giga Computing, подразделение Gigabyte, анонсировала высокопроизводительный сервер TO86-SD1 для обучения ИИ-моделей, инференса и ресурсоёмких HPC-задач. Новинка выполнена в форм-факторе 8OU в соответствии со стандартом OCP ORv3. Возможна установка двух процессоров Intel Xeon 6500P/6700P (Granite Rapids-SP) с показателем TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти DDR5 (RDIMM 6400 или MRDIMM 8000). Во фронтальной части предусмотрены отсеки для восьми SFF-накопителей с интерфейсом PCIe 5.0 (NVMe); поддерживается горячая замена. Есть коннектор M.2 2280/22110 для SSD (PCIe 5.0 x4). Упомянута поддержка CXL 2.0. Сервер несёт на борту ИИ-ускорители NVIDIA HGX B200 поколения Blackwell в конфигурации 8 × SXM. Суммарный объём памяти HBM3E составляет 1,4 Тбайт. Доступны 12 слотов PCIe 5.0 x16 для карт расширения FHHL с доступом через лицевую панель корпуса. Говорится о совместимости с NVIDIA BlueField-3 DPU и NVIDIA ConnectX-7 NIC.

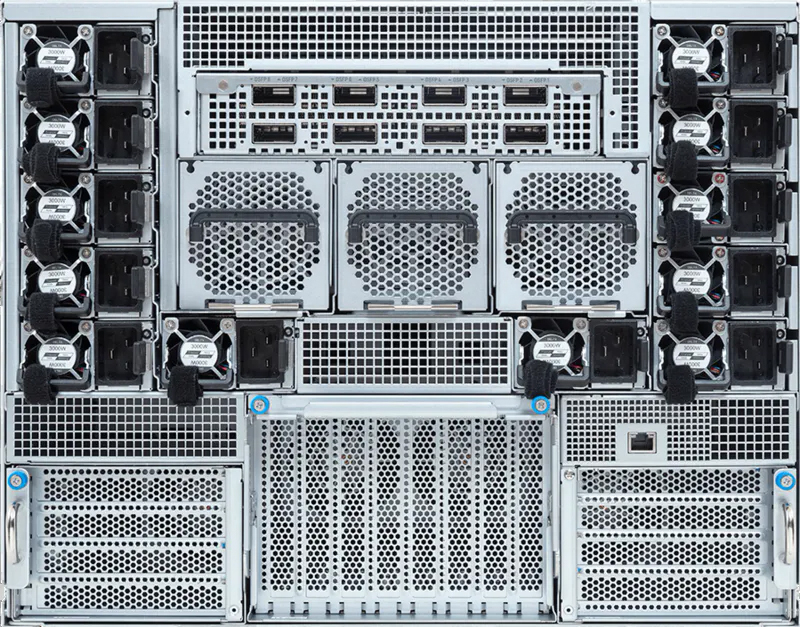

Источник изображения: Giga Computing В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на базе Intel X710-AT2, выделенный сетевой порт управления 1GbE, разъёмы USB 3.2 Gen1 Type-C, Micro-USB и Mini-DP. Применяется система воздушного охлаждения с четырьмя 92-мм вентиляторами в области материнской платы и двенадцатью 92-мм кулерами в GPU-секции. Диапазон рабочих температур — от +10 до +35 °C. Заявлена совместимость с Windows Server, RHEL, Ubuntu, Citrix, VMware ESXi.

18.09.2025 [15:25], Сергей Карасёв

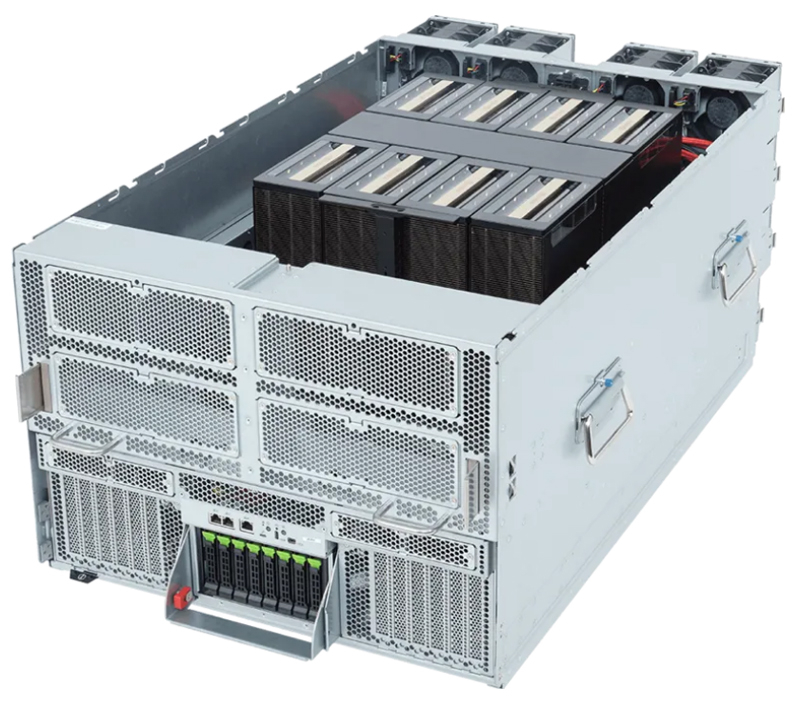

Giga Computing представила флагманский ИИ-сервер на базе NVIDIA HGX B300Компания Giga Computing, подразделение Gigabyte, анонсировала сервер G894-SD3-AAX7 — флагманскую систему, предназначенную для решения сложных HPC-задач, обучения больших языковых моделей (LLM), инференса и других ресурсоёмких ИИ-нагрузок. В основу новинки положены процессорры Intel Xeon Granite Rapids и ускорители NVIDIA Blackwell Ultra. Сервер выполнен в форм-факторе 8U. Возможна установка двух процессоров Xeon 6500P/6700P с показателем TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти DDR5 RDIMM-6400 или MRDIMM-8000. Во фронтальной части расположены восемь посадочных мест для SFF-накопителей с интерфейсом PCIe 5.0 (NVMe) и поддержкой горячей замены. Кроме того, есть два внутренних коннектора для SSD типоразмера M.2 2280/22110 (PCIe 5.0 x4 и PCIe 5.0 x2).  Система, построенная на платформе NVIDIA HGX B300, имеет восемь SXM-ускорителей Blackwell Ultra. Могут быть реализованы восемь портов 800G OSFP InfiniBand или 16 портов 400GbE посредством адаптеров NVIDIA ConnectX-8 SuperNIC. Говорится о поддержке DPU NVIDIA BlueField-3 и о наличии четырёх слотов PCIe 5.0 x16 для карт FHHL.  Сервер оснащён двумя портами 10GbE на базе Intel X710-AT2, выделенным сетевым портом управления 1GbE, контроллером ASPEED AST2600, двумя портами USB 3.2 Gen1 Type-A и интерфейсом D-Sub. Применяется воздушное охлаждение. За питание отвечают 12 блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Диапазон рабочих температур — от +10 до +30 °C.

12.08.2025 [16:32], Сергей Карасёв

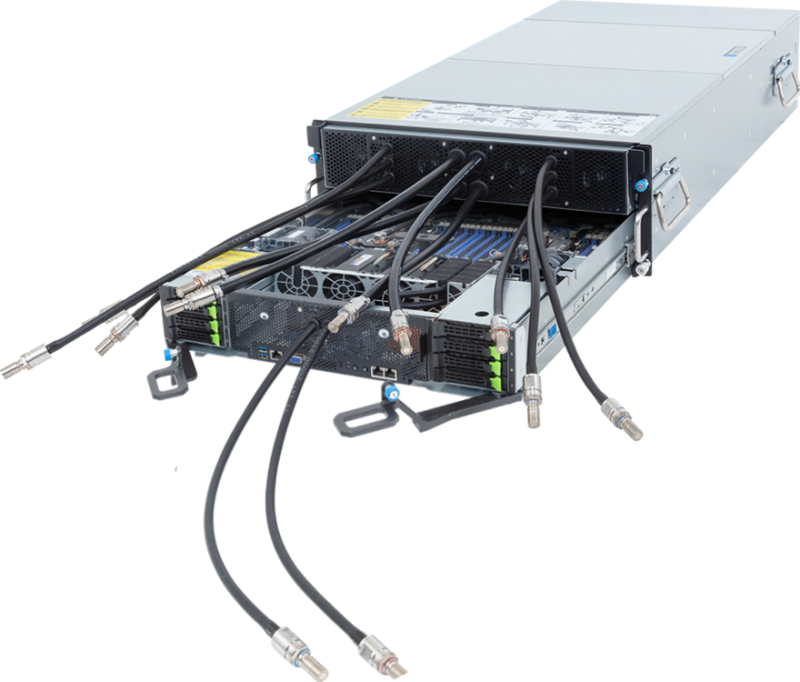

Supermicro представила 4U-сервер на базе NVIDIA HGX B200 с СЖОКомпания Supermicro анонсировала GPU-сервер SYS-422GS-NBRT-LCC для ресурсоёмких нагрузок, включая задачи ИИ, построенный на аппаратной платформе Intel Granite Rapids. Устройство оборудовано системой прямого жидкостного охлаждения DLC-2. Новинка выполнена в форм-факторе 4U. Допускается установка двух процессоров Xeon 6700P с TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти: максимальный объём ОЗУ составляет 4 Тбайт в случае DDR5-6400 ECC и 8 Тбайт при использовании DDR5-5200 ECC. Сервер располагает восемью слотами PCIe 5.0 x16 для низкопрофильных карт расширения и двумя разъёмами PCIe 5.0 x16 для карт полной высоты и половинной длины (FHHL). Сервер оснащён ИИ-ускорителями NVIDIA HGX B200 поколения Blackwell в конфигурации 8 × SXM. Предусмотрены восемь фронтальных отсеков для накопителей E1.S с поддержкой горячей замены, а также два отсека для M.2 NVMe SSD. Имеются два сетевых порта 10GbE (RJ45) на основе контроллера Intel X710-AT2. Система может быть укомплектована восемью однопортовыми адаптерами NVIDIA ConnectX-7 NIC или NVIDIA BlueField-3 SuperNIC, а также двумя двухпортовыми DPU NVIDIA BlueField-3. Реализованы интерфейсы Mini-DP и D-Sub. Питание обеспечивают четыре блока мощностью 6600 Вт с сертификатом 80 PLUS Titanium. Диапазон рабочих температур — от +10 до +35 °C. Помимо системы DLC-2, установлены шесть вентиляторов диаметром 80 мм. Габариты сервера составляют 174 × 448 × 991,4 мм, масса — 107 кг.

Источник изображения: Supermicro

06.07.2025 [23:08], Сергей Карасёв

Giga Computing представила ИИ-серверы на базе NVIDIA HGX B200 с воздушным и жидкостным охлаждениемКомпания Giga Computing, подразделение Gigabyte, представила серверы G4L3-SD1-LAX5, G4L3-ZD1-LAX5, G894-AD1-AAX5 и G894-SD1-AAX5 для приложений ИИ, инференса и других ресурсоёмких нагрузок. В основу новинок положена платформа NVIDIA HGX B200 в конфигурации 8 × SXM. Модель G4L3-SD1-LAX5 типоразмера 4U оснащена системой прямого жидкостного охлаждения (DLC) с отдельными зонами CPU и GPU. Допускается установка двух процессоров Intel Xeon Sapphire Rapids или Xeon Emerald Rapids с показателем TDP до 385 Вт. Предусмотрены 32 слота для модулей DDR5-5600, восемь фронтальных отсеков для SFF-накопителей (NVMe/SATA), а также два коннектора для SSD типоразмера M.2 2280/22110 (PCIe 3.0 x2 и PCIe 3.0 x1). Доступны восемь разъёмов для однослотовых карт расширения FHHL PCIe 5.0 x16 и четыре разъёма для карт FHHL PCIe 5.0 x16 двойной ширины. В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на базе Intel X710-AT2 и выделенный сетевой порт управления 1GbE. Питание обеспечивают восемь блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Диапазон рабочих температур простирается от +10 до +35 °C. Вариант G4L3-ZD1-LAX5 рассчитан на два чипа AMD EPYC 9004 (Genoa) или EPYC 9005 (Turin) с TDP до 500 Вт. Этот сервер также выполнен в формате 4U и оборудован DLC-охлаждением. Есть 24 слота для модулей DDR5-6400, восемь фронтальных отсеков для SFF-накопителей NVMe и два внутренних коннектора для SSD стандартов M.2 2280/22110 (PCIe 3.0 x4 и PCIe 3.0 x1). Прочие характеристики аналогичны предыдущей модели. Двухпроцессорные серверы G894-AD1-AAX5 и G894-SD1-AAX5 типоразмера 8U наделены воздушным охлаждением, включая 15 вентиляторов диаметром 80 мм в зоне GPU. Вариант G894-AD1-AAX5 поддерживает установку чипов Intel Xeon 6900 с показателем TDP до 500 Вт и 24 модулей DDR5 (RDIMM-6400 или MRDIMM-8800). Модификация G894-SD1-AAX5, в свою очередь, рассчитана на процессоры Intel Xeon 6700/6500 с TDP до 350 Вт и 32 модуля DDR5 (RDIMM-6400 или MRDIMM-8000). Оба сервера оборудованы двумя портами 10GbE (Intel X710-AT2), сетевым портом управления 1GbE, контроллером ASPEED AST2600, восемью фронтальными отсеками для SFF-накопителей NVMe, двумя коннекторами M.2 2280/22110 (PCIe 5.0 x4 и PCIe 5.0 x2). Имеются восемь разъёмов для карт расширения FHHL PCIe 5.0 x16 одинарной ширины и четыре разъёма для карт FHHL PCIe 5.0 x16 двойной ширины. Установлены 12 блоков питания мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Серверы могут эксплуатироваться при температурах от +10 до +30 °C.

26.06.2025 [12:05], Сергей Карасёв

HPE представила ИИ-систему Compute XD690 на базе NVIDIA HGX B300Компания HPE анонсировала высокопроизводительный сервер Compute XD690, предназначенный для решения таких ресурсоёмких задач, как обучение ИИ-моделей, инференс и пр. В основу новинки положены процессоры Intel и ускорители NVIDIA на архитектуре Blackwell. Поставки новинки компания планирует организовать в октябре нынешнего года. Система Compute XD690 выполнена в форм-факторе 10U с воздушным охлаждением. Полностью технические характеристики не раскрываются, но известно, что конфигурация включает два чипа Intel Xeon 6. Задействована платформа NVIDIA HGX B300 с восемью модулями Blackwell Ultra SXM. Заявленная производительность на операциях FP64 достигает 10 Тфлопс, на операциях FP4 — 144 Пфлопс. Суммарный объём памяти HBM3e составляет около 2,3 Тбайт. Применяется интерконнект NVLink пятого поколения с общей пропускной способностью 14,4 Тбайт/с. Говорится о поддержке XDR InfiniBand и Spectrum-X Ethernet.

Источник изображения: HPE Как отмечает HPE, ускорители Blackwell Ultra обеспечивают на 50 % более высокую производительность FP4 и удвоенную пропускную способность GPU↔CPU по сравнению с решениями на архитектуре Blackwell предыдущего поколения. Благодаря этому возможна работа со сложными ИИ-моделями, агентами ИИ, рассуждающими системами и пр. Среди других вариантов использования названы генерация фотореалистичных видеоматериалов и симуляция детализированного 3D-окружения для робототехнических сред и самоуправляемых транспортных средств.

25.06.2025 [18:44], Владимир Мироненко

HPE представила новые решения для частных ИИ-фабрик на базе продуктов NVIDIAHPE представила комплексный набор решений, предназначенных для ускорения создания, внедрения и управления ИИ-фабриками на протяжении всего жизненного цикла ИИ. Эти решения адаптированы для использования практически для всех организаций, независимо от размера или отрасли, говорит компания. HPE расширила своё портфолио NVIDIA AI Computing by HPE, добавив ускорители NVIDIA Blackwell, включая новые компонуемые решения, оптимизированные для поставщиков услуг, разработчиков моделей и суверенных субъектов. Также было добавлено следующее поколение решений HPE Private Cloud AI — готового решения для ИИ-фабрик на предприятиях. Предлагаемые интегрированные, комплексные решения и услуги для ИИ-фабрик позволяют устранить для клиентов необходимость самостоятельно собирать полный стек ИИ-технологий при создании современного ИИ ЦОД. В основе портфолио NVIDIA AI Computing by HPE лежит решение HPE Private Cloud AI, представляющее собой полностью интегрированную, готовую ИИ-фабрику. Private Cloud AI обеспечит:

Новые ИИ-фабрики объединяют инновации и опыт HPE в области ИИ, достижения в области разработки жидкостного охлаждения и ПО HPE Morpheus Enterprise.

Источник изображения: HPE Благодаря совместимости с архитектурой NVIDIA Enterprise AI Factory ИИ-фабрики HPE могут быть развёрнуты с использованием новейших ускорителей NVIDIA, решений Spectrum-X Ethernet, DPU NVIDIA BlueField-3 и ПО NVIDIA AI Enterprise. Портфолио NVIDIA AI Computing by HPE также пополнила система HPE Compute XD690 (поставки начнутся в октябре) на платформе NVIDIA HGX B300. HPE Performance Cluster Manager обеспечивает полностью интегрированное управление системами и расширенный мониторинг инфраструктуры и оповещения в больших, сложных ИИ-средах с масштабированием до тысячи узлов. Чтобы обеспечить непрерывную подачу готовых к ИИ-нагрузкам неструктурированных данных для ИИ-фабрик и приложений, СХД HPE Alletra Storage MP X10000 будет поддерживать серверы с поддержкой Model Context Protocol (MCP), которая появится во II половине 2025 года. В дополнение X10000 поддерживает эталонный дизайн NVIDIA AI Data Platform и предлагает SDK для оптимизации неструктурированных конвейеров данных для обработки, инференса, обучения и процесса непрерывного приобретения знаний и навыков. HPE сообщила, что программа Unleash AI пополнилась 26 новыми партнёрами. Также было объявлено, что сотрудничество HPE и Accenture с целью создания агентских ИИ-решений для финансовых сервисов и закупок, получило реализацию в новом совместном предложении для выхода на рынок, которое использует платформу Accenture AI Refinery, созданную на базе NVIDIA AI Enterprise и развёрнутую на HPE Private Cloud AI.

26.05.2025 [11:21], Сергей Карасёв

Supermicro представила сервер SYS-822GS-NB3RT на базе NVIDIA HGX B300Компания Supermicro представила модель SYS-822GS-NB3RT на аппаратной платформе NVIDIA HGX B300 (Blackwell Ultra) для ресурсоёмких ИИ-нагрузок. Устройство выполнено в форм-факторе 8U и . Допускается установка двух процессоров Intel Xeon 6500P или 6700P поколения Granite Rapids с высокопроизводительными Р-ядрами. Доступны 32 слота для модулей оперативной памяти DDR5 с поддержкой MRDIMM-8000. Система имеет архитектуру 8-GPU. Во фронтальной части располагаются отсеки для восьми накопителей E1.S (NVMe) с возможностью горячей замены. Кроме того, есть два внутренних слота М.2 для NVMe SSD. Сервер оснащён двумя разъёмами PCIe 5.0 х16 FHHL для DPU NVIDIA BlueField-3. Упомянуты сетевые адаптеры NVIDIA ConnectX-8 SuperNIC. Supermicro позиционирует модель SYS-822GS-NB3RT в качестве передового «строительного блока» для формирования масштабных ИИ-кластеров с воздушным охлаждением. Компания Supermicro также сообщила о том, что в её ассортименте для заказа доступны более 20 систем, поддерживающих установку ускорителей NVIDIA RTX PRO 6000 Blackwell Server Edition с 96 Гбайт памяти GDDR7. Это, в частности, многоузловые серверы SuperBlade, компактные edge-решения, серверы типоразмера 5U с поддержкой до восьми GPU-карт, системы на модульной архитектуре NVIDIA MGX для ИИ-приложений и задач НРС, а также мощные рабочие станции.

22.05.2025 [12:43], Сергей Карасёв

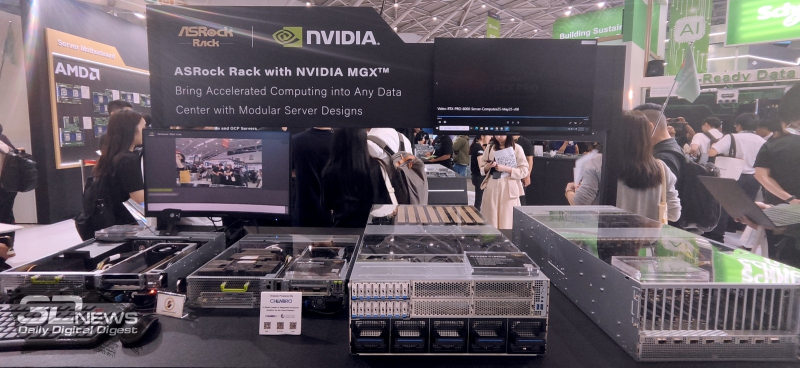

ASRock Rack показала серверы NVIDIA HGX B300 и систему XGMRACK GB300 NVL72Компания ASRock Rack в рамках выставки Computex 2025 представила серверы нового поколения, оснащённые ИИ-ускорителями NVIDIA на архитектуре Blackwell. Кроме того, демонстрируются другие индустриальные и корпоративные продукты, включая материнские платы и системы с процессорами AMD и Intel. В число новинок вошёл сервер ASRock Rack 8U16X-GNR2 типоразмера 8U с воздушным охлаждением. Он выполнен на платформе NVIDIA HGX B300. По заявления разработчика, достигается в семь раз более высокая ИИ-производительность по сравнению с сопоставимыми системами, оборудованными ускорителями NVIDIA на архитектуре Hopper. Суммарный объём памяти HBM3e составляет около 2,3 Тбайт. Задействованы сетевые адаптеры NVIDIA ConnectX-8 SuperNIC. Кроме того, ASRock Rack готовит к выпуску сервер 4U16X-GNR2 на базе NVIDIA HGX B300 с жидкостным охлаждением. Обе модели ориентированы на ресурсоёмкие рабочие ИИ-нагрузки, такие как агентные системы, рассуждающие модели и генеративные сервисы. На стенде ASRock Rack представлено стоечная система XGMRACK на основе NVIDIA GB300 NVL72. Она объединяет 36 чипов NVIDIA Grace и 72 ускорителя NVIDIA Blackwell Ultra. Вычислительные и коммутационные узлы используют на 100 % жидкостное охлаждение. Общий объём памяти HBM3e превышает 20 Тбайт. Применяются решения NVIDIA Quantum-X800 InfiniBand и Spectrum-X Ethernet. ASRock Rack также представила серверы на модульной архитектуре NVIDIA MGX для масштабируемых ИИ-приложений и периферийных вычислений. В число таких машин входит модель 4UXGM-GNR2 типоразмера 4U с поддержкой двух процессоров Intel Xeon 6700P, 6500P (Granite Rapids) или Xeon 6700E (Sierra Forest). Доступны 32 слота для модулей оперативной памяти DDR5-6400, 16 посадочных мест для накопителей E1.S с интерфейсом PCIe 5.0 x4, два коннектора М.2 22110/2280 для SSD (PCIe 5.0 x4 и PCIe5.0 x2), восемь слотов PCIe 5.0 x16 FHFL, пять слотов PCIe 5.0 x16 FHHL и один слот PCIe 5.0 x16 HHHL. Установлены контроллер ASPEED AST2600 и четыре блока питания мощностью 1200 Вт с сертификатом 80 PLUS Titanium.

19.05.2025 [23:55], Владимир Мироненко

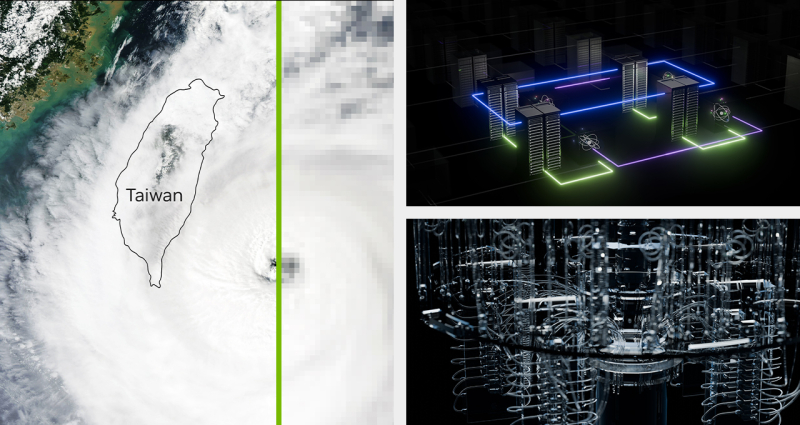

NVIDIA построит на Тайване новую штаб-квартиру и развернёт два ИИ-суперкомпьютераNVIDIA построит в ближайшем будущем на Тайване новую штаб-квартиру, а также два ИИ-суперкомпьютера. Об этом сообщил гендиректор американской компании Дженсен Хуанг (Jensen Huang), подтвердив свою приверженность Тайваню как глобальному технологическому центру, пишет The Financial Times. Хуан отдал должное Тайваню, «крупнейшему региону по производству электроники в мире», назвав его «центром компьютерной экосистемы». Строительством первого ИИ-суперкомпьютера на базе 10 тыс. ускорителей Blackwell займётся Big Innovation Company, «дочка» Foxconn, в сотрудничестве с NVIDIA и при поддержке тайваньского правительства. Стоимость суперкомпьютера, который будут использоваться в технологической экосистеме Тайваня, составит сотни миллионов долларов. В числе клиентов будущего суперкомпьютера Хуанг назвал TSMC, ключевого производственного партнёра NVIDIA, которая будет использовать его вычислительные мощности для исследований и разработки новых процессов создания чипов. Второй ИИ-суперкомпьютер построит ASUS в интересах Национального HPC-центра NCHC (National Center for High-Performance Computing). Он будет ориентирован на исследование климата, разработку квантовых технологий, создание LLM и иную R&D-деятельность. Система будет в восемь раз мощнее суперкомпьютера Taiwania 2, в создании которого также принимала участие ASUS. Новинка получит узлы HGX H200 (всего 1700 ускорителей), две стойки GB200 NVL72, а также HGX B300, объединённые интерконнектом Quantum InfiniBand. Кроме того, NCHC планирует установить системы DGX Spark и развернуть облачный HGX-кластер. «Мы растём за пределы нашего текущего офиса [на Тайване]», — заявил Хуан, демонстрируя видео приземления футуристического космического корабля и его последующей трансформации в дизайн новой штаб-квартиры Constellation («Созвездие»), строительство которой начнется в ближайшее время в Бэйтоу (Beitou), районе Тайбэя. Дженсен Хуанг также представил интерконнект NVLink Fusion, который позволит объединить решения NVIDIA с решениями конкурентов. Таким способом компания надеется закрепить свою технологию в качестве решения для базовой инфраструктуры. «Ничто не радует меня больше, чем, когда вы покупаете всё у NVIDIA… но мне доставляет огромную радость, если вы просто покупаете что-то у NVIDIA», — пошутил он. На вопрос о возможности создания NVIDIA нового чипа для Китая, который бы соответствовал последним экспортным ограничениям США, Хуанг заявил, что компания «оценивает, как лучше всего выйти на китайский рынок», отметив, что дальнейшие модификации H20 невозможны. Вместе с тем NVIDIA рассматривает возможность перепроектирования своих чипов с учётом новых ограничений, чтобы продолжать продавать их в Китае. На прошлой неделе стало известно о планах NVIDIA построить новый исследовательский центр в Шанхае в знак своей приверженности Поднебесной. Хуанг добавил, что «нет никаких доказательств контрабанды каких-либо ИИ-чипов» в Китай. Из-за опасений по поводу нелегальных поставок передовых чипов NVIDIA в Китай американские законодатели потребовали в прошлом месяце от компании предоставить отчёт о продажах её продукции в Китае и Юго-Восточной Азии.

08.05.2025 [19:22], Сергей Карасёв

Cadence представила суперкомпьютер Millennium M2000 на базе NVIDIA BlackwellКомпания Cadence анонсировала суперкомпьютер Millennium M2000, спроектированный для выполнения сложного моделирования с использованием ИИ. Новая НРС-система предназначена для ускорения проектирования микрочипов, разработки лекарственных препаратов следующего поколения и пр. Суперкомпьютер построен на платформе NVIDIA HGX B200. Кроме того, задействованы карты NVIDIA RTX Pro 6000 Blackwell Server Edition, оснащённые 96 Гбайт памяти GDDR7. Применены библиотеки NVIDIA CUDA-X и специализированное ПО для решения ресурсоёмких задач. Утверждается, что Millennium M2000 обеспечивает до 80 раз более высокую производительность по сравнению с системами на базе CPU в области автоматизации проектирования электроники (EDA), создания и анализа систем (SDA) и разработки медикаментов. При этом глубоко оптимизированный программно-аппаратный стек помогает существенно сократить общее энергопотребление. В качестве примера приводится моделирование подсистемы питания на уровне полупроводниковых чипов. В случае вычислительных комплексов на основе сотен традиционных CPU на выполнение такой задачи может потребоваться около двух недель. Суперкомпьютер Millennium M2000 позволит получить результат менее чем за один день. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) сообщил, что компания планирует приобрести десять суперкомпьютерных систем Millennium на базе GB200 NVL72 для ускорения проектирования собственных продуктов. Сторонние заказчики смогут получить доступ к Millennium M2000 через облако или купить устройство для установки в собственном дата-центре. Базовая конфигурация включает около 32 ускорителей и стоит $2 млн, но это не финальная цена. |

|