Материалы по тегу: nvidia

|

09.07.2024 [23:33], Владимир Мироненко

$10-млрд сделка между Oracle и xAI сорваласьИИ-стартап Илона Маска (Elon Musk) xAI отказался от планов по расширению сотрудничества с Oracle. Как пишет The Wall Street Journal, во вторник миллиардер сообщил в соцсети X, что xAI прекратил переговоры с облачным провайдером о сделке на $10 млрд по поводу расширения аренды вычислительных мощностей, поскольку стартап сам построит «самый мощный кластер для обучения [ИИ-моделей] в мире с большим запасом». Сообщивший ранее о срыве сделки ресурс The Information рассказал, что многолетнее соглашение об аренде у Oracle запланированного к строительству суперкомпьютера на чипах NVIDIA уже было на стадии подписания, но переговоры зашли в тупик из-за того, что Маска не устроили сроки строительства, предложенные Oracle. Oracle же заявила об отсутствии доступа к адекватному источнику энергии для работы ИИ-суперкомпьютера в выбранном xAI регионе.

Источник изображения: xAI В итоге Маск заявил, что «самый мощный суперкомпьютер в мире» будет построен стартапом в Мемфисе (штат Теннесси, США) и начнёт работу осенью 2025 года. Ранее Маск сообщил, что в течение следующих нескольких месяцев xAI развернёт кластер из 100 тыс. ускорителей NVIDIA H100 с жидкостным охлаждением, а летом следующего года запустит ещё один кластер из 300 тыс. ускорителей NVIDIA B200. Как отметил ресурс Data Center Dynamics, xAI уже арендует у Oracle около 16 тыс. ускорителей NVIDIA, что делает его одним из крупнейших клиентов провайдера облачных услуг. Стартап также использует для работы сервисы AWS и резервные мощности в ЦОД соцсети X (Twitter). Oracle также предоставляет свою ИИ-инфраструктуру Microsoft и OpenAI.

05.07.2024 [09:18], Владимир Мироненко

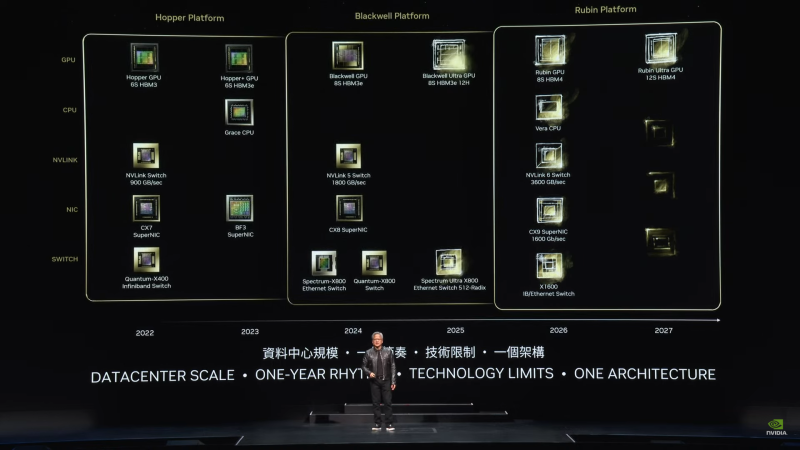

Потрать доллар — получи семь: ИИ-арифметика от NVIDIANVIDIA заявила, что инвестиции в покупку её ускорителей весьма выгодны, передаёт ресурс HPCwire. По словам NVIDIA, компании, строящие огромные ЦОД, получат большую прибыль в течение четырёх-пяти лет их эксплуатации. Заказчики готовы платить миллиарды долларов, чтобы не отстать в ИИ-гонке. «Каждый доллар, вложенный провайдером облачных услуг в ускорители, вернётся пятью долларами через четыре года», — заявил Иэн Бак (Ian Buck), вице-президент HPC-подразделения NVIDIA на конференции BofA Securities 2024 Global Technology Conference. Он отметил, что использование ускорителей для инференса несёт ещё больше выгоды, позволяя получить уже семь долларов за тот же период. Как сообщается, инференс ИИ-моделей Llama, Mistral и Gemma становится всё масштабнее. Для удобства NVIDIA упаковывает открытые ИИ-модели в оптимизированные и готовые к запуску контейнеры NIM. Компания отметила, что её новейшие ускорители Blackwell оптимизированы для инференса. Они, в частности, поддерживают типы данных FP4/FP6, что повышает энергоэффективность оборудования при выполнении рабочих нагрузок ИИ с низкой интенсивностью. Провайдеры облачных услуг планируют строительство ЦОД на пару лет вперёд и хотят иметь представление о том, какими будут ускорители в обозримом будущем. Бак отметил, что провайдерам важно знать, как будут выглядеть ЦОД с серверами на базе чипов Blackwell и чем они будут отличаться от дата-центров на Hopper. Скоро на смену Blackwell придут ускорители Rubin. Их выпуск начнётся в 2026 году, так что гиперскейлерам уже можно готовиться к обновлению дата-центров. Как ожидается, чипы Blackwell, первые партии которых будут поставлены к концу года, будут в дефиците. «С каждым новым технологическим переходом возникает… сочетание проблем спроса и предложения», — отметил Бак. По его словам, операторы ЦОД постепенно отказываются от инфраструктуры на базе CPU, освобождая место под большее количество ускорителей. Ускорители Hopper пока остаются в ЦОД и всё ещё будут основными «рабочими лошадками» для ИИ, но вот решения на базе архитектур Ampere и Volta уже перепродаются. Microsoft и Google сделали ставку на ИИ и сейчас работают над более функциональными большими языковыми моделями, причём Microsoft (и OpenAI) в значительной степени полагается на ускорители NVIDIA, тогда как Google опирается на TPU собственной разработки для использования в своей ИИ-инфраструктуре. Пока что самая крупная модель насчитывает порядка 1,8 трлн параметров, но по словам Бака, это только начало. В дальнейшем появятся модели с триллионами параметров, вокруг которой будут построены более мелкие и более специализированные модели. Так, свежая GPT-модель (вероятно, речь о GPT-4o) включает 16 отдельных нейросетей. NVIDIA уже адаптирует свои ускорители к архитектуре Mixture of Experts (MoE, набор экспертов), где процесс обработки запроса пользователя делится между несколькими специализированными «экспертными» нейросетями. GB200 NVL72, по словам Бака, идеально подходит для MoE благодаря множеству ускорителей связанных быстрым интерконнектом, каждый из которых может обрабатывать часть запроса и быстро делится ответом с другими.

03.07.2024 [08:32], Владимир Мироненко

Крупный европейский криптомайнер Northern Data обдумывает вывод на биржу подразделений ЦОД и ИИКомпания Northern Data, деятельность которой связана с майнингом криптовалюты, предоставлением услуг высокопроизводительных вычислений (HPC) и ИИ, обдумывает возможность проведения IPO подразделений Taiga и Ardent, предоставляющих услуги облачных вычислений и ЦОД соответственно, пишет Bloomberg. По данным источников Bloomberg, IPO может состояться на площадке Nasdaq. В настоящее время компания ведёт переговоры с банками для проведения публичного размещения акций. По оценкам банков, капитализация этих подразделений может составить $10–$16 млрд. Как и многие компании, занимающиеся майнингом криптовалют, Northern Data рассматривает HPC и ИИ как прибыльное дополнение к своей основной деятельности. В прошлом году Northern Data разделила свой бизнес на три подразделения — Arden, Taiga и Peak Mining, сосредоточив в последнем все операции по майнингу криптовалют. Согласно информации на сайте компании, у неё имеется 11 дата-центров. Peak Mining, американское подразделение компании по майнингу биткоинов, строит и разрабатывает дата-центры суммарной ёмкостью почти 700 МВт, что в случае реализации всех планов сделает его одним из крупнейших майнеров криптовалюты в США. Taiga уже владеет 24,5 тыс. ускорителей NVIDIA, включая H100, A100 и A6000. Они в основном находятся в трёх ЦОД в Швеции и Норвегии и на 100 % запитаны от «зелёных» источников энергии. В понедельник компания объявила, что первой в Европе приобрела 2 тыс. ускорителей NVIDIA H200, дополненных DPU BlueField-3 и ConnectX-7. Они будут размещены в одном из европейских ЦОД с PUE менее 1,2. Запуск первого кластера намечен на IV квартал, а его производительность составит порядка 32 Пфлопс (точность вычислений не указана). Пиковая теоретическая FP64-производительность такого количества ускорителей H200 составляет 68 Пфлопс. В свою очередь Ardent занимается дизайном и строительством высокоплотных ЦОД, ориентированных на HPC- и ИИ-нагрузки. Компания использует СЖО, а заявленный уровень PUE не превышает 1,15. При этом Ardent обещает 100 % доступность своих площадок. Как сообщается, Northern Data в ноябре получила кредитное финансирование на сумму €575 млн от компании Tether Group, занимающейся стейблкоинами, а в январе завершила приобретение у Tether компании Damoon за €400 млн, рассчитавшись с помощью облигаций, конвертируемых в акции, выпущенные Northern Data AG. В результате Tether стала основным инвестором Northern Data. Полученные средства Northern Data использует для закупок самых востребованных чипов NVIDIA. Благодаря этому к концу лета компанией будет развёрнуто около 20 тыс. NVIDIA H100.

30.06.2024 [14:28], Сергей Карасёв

В Австралии запущен ИИ-суперкомпьютер Virga [Обновлено]Государственное объединение научных и прикладных исследований Австралии (CSIRO) сообщило о вводе в эксплуатацию высокопроизводительного вычислительного комплекса Virga. Система, предназначенная для ИИ-задач, ускорит научные открытия, а также поможет развитию промышленности и экономики страны. Суперкомпьютер располагается в дата-центре Hume компании CDC в Канберре. Его созданием занималась компания Dell: в основу положены серверы PowerEdge XE9640, оснащённые двумя процессорами Intel Xeon Sapphire Rapids 8452Y (36C/72T, 2,0/3,2 ГГц, 300 Вт), до 512 Гбайт RAM и четырьмя 61,44-Тбайт NVMe SSD. Задействованы ИИ-ускорители NVIDIA H100 с 96 Гбайт памяти HBM3 — всего 448 шт. Система занимает 14 стоек, а в качестве интерконнекта используется Infiniband NDR. Dell заключила контракт на создание Virga в 2023 году: сумма изначально составляла $9,65 млн, однако фактическое строительство комплекса обошлось в $10,85 млн. Новый суперкомпьютер придёт на смену НРС-системе CSIRO предыдущего поколения под названием Bracewell, но унаследует от неё BeeGFS-хранилище, также построенное на оборудовании Dell. В нынешнем рейтинге TOP500 машина занимает 72 место с пиковой и практической FP64-производительностью 18,46 Пфлопс и 14,94 Пфлопс соответственно. Комплекс Virga получил своё имя в честь метеорологического эффекта «вирга» — это дождь, который испаряется, не достигая земли: видеть его можно в виде полос, выходящих из-под облаков. Систему Virga планируется использовать для таких задач, как прогнозирование пожаров, разработка вакцин нового поколения, проектирование гибких солнечных панелей, анализ медицинских изображений и пр. Пока подробные технические характеристики Virga и показатели быстродействия не раскрываются. Отмечается лишь, что в составе комплекса применена гибридная система прямого жидкостного охлаждения. Говорится также, что CDC оперирует двумя кампусами дата-центров Hume. Площадка Hume Campus One объединяет три ЦОД и имеет мощность 21 МВт, тогда как в состав Hume Campus Two входят два объекта суммарной мощностью 51 МВт.

27.06.2024 [12:58], Сергей Карасёв

В Японии запущен суперкомпьютер TSUBAME4.0 с ускорителями NVIDIA H100 для ИИ-задачГлобальный научно-информационный вычислительный центр (GSIC) Токийского технологического института (Tokyo Tech) в Японии объявил о вводе в эксплуатацию вычислительного комплекса TSUBAME4.0, созданного компанией HPE. Новый суперкомпьютер будет применяться в том числе для задач ИИ. В основу машины легли 240 узлов HPE Cray XD665. Каждый из них несёт на борту два процессора AMD EPYC Genoa и четыре ускорителя NVIDIA H100 SXM5 (94 Гбайт HBM2e). Объём оперативной памяти DDR5-4800 составляет 768 Гбайт. Задействован интерконнект Infiniband NDR200. Вместимость локального накопителя NVMe SSD — 1,92 Тбайт. В состав НРС-комплекса входит подсистема хранения данных HPE Cray ClusterStor E1000. Сегмент на основе HDD имеет ёмкость 44,2 Пбайт — это в 2,8 раза больше по сравнению с суперкомпьютером предыдущего поколения TSUBAME 3.0. Кроме того, имеется SSD-раздел ёмкостью 327 Тбайт. Пиковая производительность TSUBAME4.0 достигает 66,8 Пфлопс (FP64), что в 5,5 больше по отношению к системе третьего поколения. Быстродействие на операциях половинной точности (FP16) поднялось в 20 раз по сравнению с TSUBAME3.0 — до 952 Пфлопс.

Источник изображения: Tokyo Tech На сегодняшний день TSUBAME4.0 является вторым по производительности суперкомпьютером в Японии после Fugaku. Эта система в нынешнем рейтинге TOP500 занимает четвёртое место с показателем 442 Пфлопс. Лидером в мировом масштабе является американский комплекс Frontier — 1,21 Эфлопс.

27.06.2024 [11:08], Сергей Карасёв

Встраиваемая система AAEON Boxer-8658AI получила модуль NVIDIA Jetson Orin NX и восемь 1GbE-портов с PoEКомпания AAEON представила встраиваемую систему Boxer-8658AI, предназначенную для использования прежде всего в транспортной сфере. Устройство выполнено на аппаратной платформе NVIDIA Jetson Orin NX в соответствии со стандартом MIL-STD-810G, что означает защиту от вибрации, ударов и других воздействий. В зависимости от модификации система комплектуется модулем Orin NX 8GB или Orin NX 16GB с шестью и восемью ядрами Arm Cortex-A78AE соответственно. Отмечается, что производительность Boxer-8658AI на операциях ИИ достигает 100 TOPS. Объём памяти LPDDR5 — 8 и 16 Гбайт. Есть посадочное место для SFF-накопителя с интерфейсом SATA-3 и коннектор M.2 2280 для SSD (NVMe).

Источник изображений: AAEON Устройство заключено в корпус с габаритами 210 × 164,2 × 76 мм (без монтажных планок), а масса составляет около 3 кг. Доступны восемь сетевых портов 1GbE RJ-45 с поддержкой PoE/PSE (802.3af/at, до 120 Вт) и ещё два разъёма 1GbE RJ-45 без РоЕ. Предусмотрены коннектор M.2 2230 E Key для комбинированного адаптера Wi-Fi/Bluetooth и разъём M.2 3052 B Key для модема 4G (плюс два слота для SIM-карт).  В число доступных интерфейсов входят HDMI 2.0, USB 3.2 Gen2 Type-A (×4), DB-9 (CANBus FD), DB-15 (RS232/422/485), линейный аудиовыход, порт Micro-USB и трёхконтактный разъём для подачи питания (9–36 В). Диапазон рабочих температур простирается от -15 до +60 °C. Говорится о совместимости с программными платформами на ядре Linux.

25.06.2024 [14:44], Сергей Карасёв

От Алжира до Мальдив: катарская Ooredoo предоставит ИИ-оборудование NVIDIA заказчикам со всего Ближнего ВостокаNVIDIA, по сообщению Reuters, подписала соглашение с катарской телекоммуникационной компанией Ooredoo Group о поставках ИИ-оборудования в дата-центры на Ближнем Востоке. Это первый крупномасштабный проект NVIDIA в данном регионе. Финансовые условия сделки не раскрываются. Какие именно продукты NVIDIA будет поставлять, не уточняется, но, например, упоминаются ИИ-ускорители на основе GPU. Соглашение распространяется на дата-центры Ooredoo в Катаре, Алжире, Тунисе, Омане, Кувейте и на Мальдивах. Старший вице-президент NVIDIA по телеком-бизнесу Ронни Васишта (Ronnie Vasishta) подчёркивает, что закупаемое оборудование позволит Ooredoo предоставлять заказчикам услуги по развёртыванию приложений на основе генеративного ИИ. «Благодаря этому соглашению наши B2B-клиенты получат доступ к сервисам, которые конкуренты, вероятно, не смогут предложить в течение следующих 18–24 месяцев», — заявил глава Ooredoo Азиз Алутман Фахру (Aziz Aluthman Fakhroo). Ooredoo инвестирует $1 млрд в наращивание мощностей региональных ЦОД. К имеющимся 40 МВт добавятся ещё 20–25 МВт, а к концу текущего десятилетия этот показатель, как ожидается, будет утроен. В настоящее время Ooredoo Group имеет 26 действующих дата-центров в Катаре, Кувейте, Омане, Ираке и Тунисе. Нужно отметить, что Вашингтон разрешает экспорт некоторых решений NVIDIA на Ближний Восток, но накладывает ограничения на поставки наиболее передовых чипов компании. Связано это с «углублением взаимоотношений» Китая с некоторыми странами региона. Между тем многие облачные компании и ЦОД-операторы намерены реализовать или уже реализуют проекты на Ближнем Востоке. Так, в ОАЭ и Саудовской Аравии активно наращивают присутствие и американские, и китайские гиперскейлеры.

23.06.2024 [12:35], Сергей Карасёв

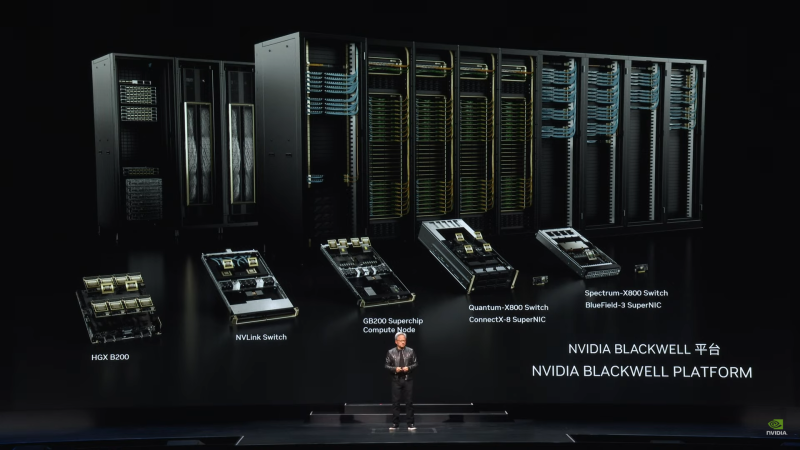

Между Microsoft и NVIDIA возникли разногласия по поводу использования ускорителей B200У компаний Microsoft и NVIDIA, по сообщению The Information, возникли разногласия по поводу использования новейших ускорителей B200 на архитектуре Blackwell. NVIDIA настаивает на том, чтобы клиенты приобретали эти изделия в составе полноценных серверных стоек, тогда как Microsoft с этим не согласна. Отмечается, что NVIDIA, удерживающая приблизительно 98 % рынка ускорителей для ЦОД, стремится контролировать использование своих продуктов. В частности, компания накладывает ограничения в отношении дизайна ускорителей, которые партнёры создают на чипах NVIDIA. Во время презентации Blackwell глава NVIDIA Дженсен Хуанг (Jensen Huang) неоднократно указывал на то, что теперь минимальной единицей для развёртывания должен стать суперускоритель GB200 NVL72. То есть NVIDIA призывает клиентов приобретать вместо отдельных ускорителей целые стойки и даже кластеры SuperPOD. По заявлениям компании, это позволит повысить ИИ-производительность благодаря оптимизации всех компонентов и их максимальной совместимости друг с другом. Кроме того, такая бизнес-модель позволит NVIDIA получить дополнительную выручку от распространения серверного оборудования и ещё больше укрепить позиции на стремительно развивающемся рынке ИИ. Однако у Microsoft, которая оперирует огромным количеством разнообразных ускорителей и других систем в составе своей инфраструктуры, возникли возражения в отношении подхода NVIDIA. Сообщается, что вице-президент NVIDIA Эндрю Белл (Andrew Bell) попросил Microsoft приобрести специализированные серверные стойки для ускорителей Blackwell, но редмондский гигант ответил отказом. По заявлениям Microsoft, решения NVIDIA затруднят корпорации внедрение альтернативных ускорителей, таких как AMD Instinct MI300X. Дело в том, что форм-факторы стоек NVIDIA и стоек Microsoft различаются на несколько дюймов. Из-за этого могут возникнуть сложности с изменением конфигурации и модернизацией, предусматривающей использование конкурирующих компонентов. Так, Microsoft использует единую базовую платформу и для ускорителей NVIDIA, и для ускорителей AMD. Microsoft эксплуатирует вариант стоек OCP и старается максимально унифицировать инфраструктуру своих многочисленных дата-центров. NVIDIA, в конце концов, согласилась с доводами Microsoft и пошла на уступки, но это, похоже, не последнее подобное разногласие между компаниями.

21.06.2024 [12:05], Сергей Карасёв

«ИИ-гигафабрику» для xAI построят Dell и SupermicroОборудование для мощнейшего ИИ-суперкомпьютера компании xAI, курируемой Илоном Маском (Elon Musk), как сообщает Datacenter Dynamics, будут поставлять Dell и Supermicro. Речь идёт о серверах, оборудованных высокопроизводительными ускорителями NVIDIA. После анонса акции обеих компаний выросли в цене. Напомним, что xAI реализует проект по созданию самого мощного в мире вычислительного комплекса, ориентированного на задачи ИИ. Строительство суперкомпьютера будет осуществляться в несколько этапов. Так, в ближайшее время должна быть запущена система, содержащая 100 тыс. ускорителей NVIDIA H100. А летом 2025 года планируется ввести в эксплуатацию кластер из 300 тыс. новейших ускорителей NVIDIA B200. О том, что участие в масштабном проекте xAI принимает корпорация Dell, сообщил её генеральный директор Майкл Делл (Michael Dell). Эти сведения подтвердил и сам Маск: по его словам, Dell «соберёт половину стоек, которые войдут в состав суперкомпьютера». За строительство оставшейся части системы будет отвечать Supermicro. По имеющейся информации, огромный дата-центр xAI, прозванный «ИИ-гигафабрикой», расположится в окрестностях Мемфиса (штат Теннесси). О том, в какой пропорции работы по строительству машины будут распределены между Dell и Supermicro, на данный момент нет. Стоимость проекта оценивается в миллиарды долларов. xAI в настоящее время арендует около 16 тыс. ускорителей NVIDIA H100 в облаке Oracle Cloud, а также использует веб-сервисы Amazon и свободные мощности на ЦОД-площадках X/Twitter. В мае 2024 года стартап осуществил раунд финансирования Series B, в ходе которого было привлечено $6 млрд. В результате, рыночная стоимость xAI достигла $24 млрд. Создаваемый суперкомпьютер будет использоваться в том числе для поддержания работы чат-бота xAI Grok следующего поколения.

20.06.2024 [14:54], Владимир Мироненко

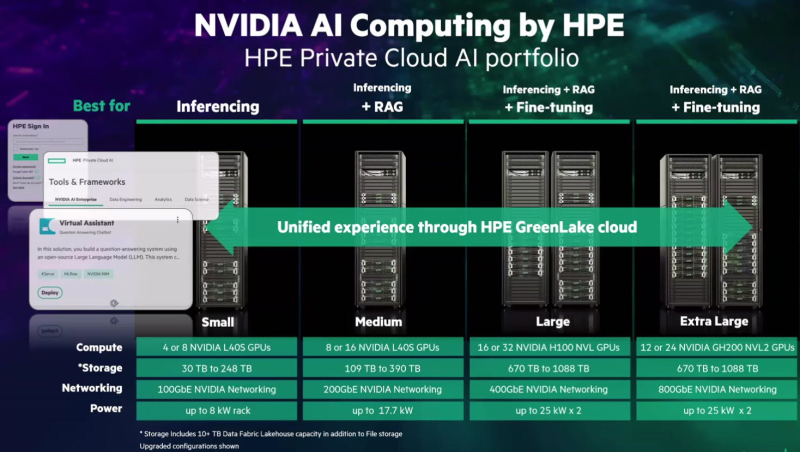

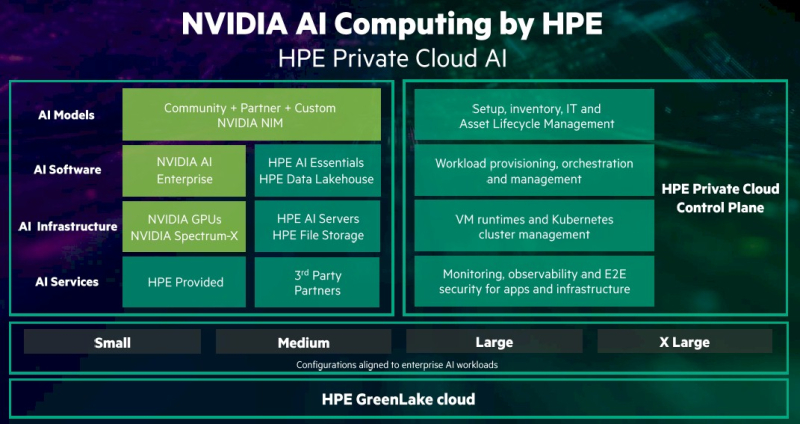

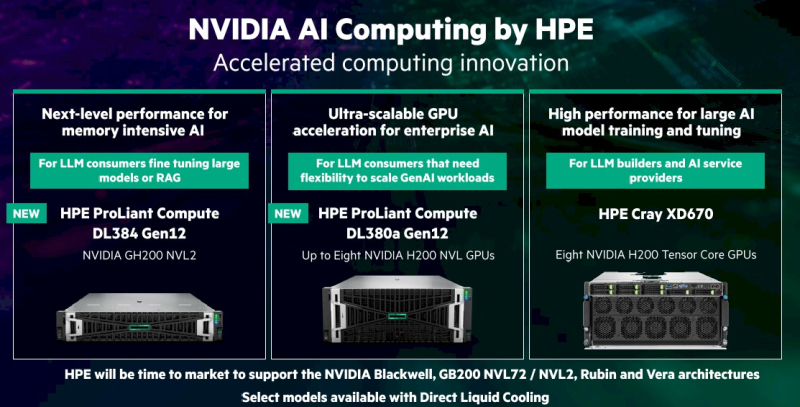

HPE и NVIDIA представили совместные решения для ускорения внедрения ИИHewlett Packard Enterprise (HPE) и NVIDIA представили платформу NVIDIA AI Computing by HPE — портфель совместно разработанных решений для ускорения внедрения генеративного ИИ. Ключевым в портфеле является предложение HPE Private Cloud AI. Как указано в пресс-релизе, это первое в своём роде комплексное решение, которое обеспечивает самую глубокую на сегодняшний день интеграцию вычислительных технологий, сетей и ПО NVIDIA с хранилищем, вычислительными ресурсами и облачной платформой HPE GreenLake. Решение предоставляет предприятиям любого размера возможность быстрой и эффективной разработки и развёртывания приложений генеративного ИИ. Решение HPE Private Cloud AI с новой функцией OpsRamp AI Copilot, которая позволяет повысить эффективность ИТ-операций и обработки рабочих нагрузок, включает в себя облачную среду самообслуживания с полным управлением жизненным циклом. Оно доступно в четырёх конфигурациях (Small, Medium, Large и Extra Large) для поддержки рабочих нагрузок ИИ различной сложности. HPE Private Cloud AI также поддерживает инференс, точную настройку моделей и их дообучение посредством RAG с использованием собственных данных. Решение сочетает в себе средства контроля конфиденциальности, безопасности, прозрачности и управления данными, в том числе средства ITOps и AIOps. AIOps использует машинное обучение и анализ данных для автоматизации и улучшения ИТ-операций. ITOps включает в себя ряд инструментов, обеспечивающих бесперебойное функционирование ИТ-инфраструктуры организации. Конфигурация HPE Private Cloud AI Small, предназначенная для инференса, включает от четырёх до восьми ускорителей NVIDIA L40S, до 248 Тбайт дискового пространства и 100GbE-подключение в стойке мощностью 8 кВт. Конфигурация Medium, предназначенная для инференса и RAG, включает до 16 ускорителей NVIDIA L40S, до 390 Тбайт дискового пространства и 200GbE-подключение в стойке мощностью 17,7 кВт. Конфигурации Large и Extra Large предлагают дополнительные возможности по обработке нагрузок ИИ и ML, а также тонкой настройке ИИ-модели. Конфигурация Large включает до 32 ускорителей NVIDIA H100 NVL, до 1,1 Пбайта дискового пространства и 400GbE-интерконнект в двух стойках мощностью 25 кВт каждая. В свою очередь, конфигурация Extra Large включает до 24 ускорителей NVIDIA GH200 NVL2, до 1,1 Пбайта дискового пространства и 800GbE-интeрконнект в двух стойках мощностью 25 кВт каждая. Стойки могут управляться клиентом самостоятельно или обслуживаться HPE. Каждая конфигурация может работать как автономное локальное решение ИИ или в составе гибридного облака. Используется программная платформа NVIDIA AI Enterprise, включающая микросервисы инференса NIM. Её дополняет ПО HPE AI Essentials. Кроме того, поддержку новых ускорителей NVIDIA получили три аппаратные платформы:

HPE также объявила, что её облачная платформа HPE GreenLake for File Storage прошла сертификацию Nvidia DGX BasePOD и валидацию хранилища NVIDIA OVX, HPE Private Cloud AI, а также анонсированное оборудование будут доступны этой осенью за исключением платформы Cray XD670 на базе NVIDIA H200 NVL, который поступит в продажу этим летом. А после станут доступны и решения на базе Blackwell. |

|