Материалы по тегу: nvidia

|

19.06.2024 [11:02], Сергей Карасёв

NVIDIA стала самой дорогой в мире компанией благодаря развитию ИИ18 июня 2024 года, по сообщению ресурса AnandTech, стоимость ценных бумаг NVIDIA поднялась до $135,58. Росту курса акций способствует востребованность ИИ-ускорителей на базе GPU. На этом фоне NVIDIA стала самой дорогой компанией в мире, превзойдя по капитализации Apple и Microsoft. Продажи ИИ-решений NVIDIA бьют рекорды. По оценкам, в 2023 году компания отгрузила приблизительно 3,76 млн ускорителей, ориентированных на ЦОД. Это более чем на 1 млн штук превосходит результат 2022 года. NVIDIA заняла примерно 98 % мирового рынка ускорителей на основе GPU для дата-центров.

Источник изображения: AnandTech При цене акций в $135,58 за штуку рыночная стоимость NVIDIA достигла $3,335 трлн. Для сравнения: в этот же день капитализация Microsoft составляла $3,317 трлн, а Apple — $3,285 трлн. Холдинг Alphabet, в состав которого входит Google, имел рыночную стоимость $2,170 трлн, Amazon — $1,902 трлн. Однако, говорят специалисты, показатель капитализации, как и сам фондовый рынок, является весьма волатильным. А поэтому, нет гарантий, что NVIDIA сможет удерживать первое место в рейтинге самых дорогих компаний мира в течение длительного времени, не говоря уже о ежедневных колебаниях. Оценки стоимости NVIDIA, Apple и Microsoft находятся в пределах $50 млрд (1%) друг от друга, что в масштабах их бизнеса является сравнительно небольшой разницей. С другой стороны, спрос на ИИ-ускорители для дата-центров и облачных платформ остаётся высоким, а поэтому NVIDIA имеет хорошие перспективы для наращивания продаж. Недавно компания анонсировала новые решения на базе архитектуры Blackwell. Говорится, что некоторые заказы на высокопроизводительные ускорители NVIDIA по-прежнему остаются невыполненными. Иными словами, компания всё ещё не в полной мере удовлетворяет потребности гиперскейлеров и других крупных заказчиков. UPD 21.06.2024: по итогам биржевых торгов в четверг NVIDIA потеряла звание самой дорогой компании в мире, уступив позицию Microsoft. Впрочем, разница между компаниями минимальна, так что вероятна череда взлётов и падений.

17.06.2024 [22:49], Илья Коваль

Три квантовых компьютера, NVIDIA DGX Quantum, немножко HPC и облако: в Израиле открыт уникальный центр квантовых вычислений IQCC

aws

gh200

grace

hardware

hpc

nvidia

quantum machines

израиль

квантовые вычисления

квантовый компьютер

облако

разработка

Стартап Quantum Machines, разработчик систем управления квантовыми компьютерами, открыл Израильский центр квантовых вычислений (Israeli Quantum Computing Center, IQCC). Площадка, создание которой было частично профинансировано правительством страны, располагается в Тель-Авивском университете. По словам основателей, это первый в мире центр, располагающий квантовыми компьютерами разных типов, которые интегрированы с системой NVIDIA DGX Quantum, HPC-инфраструктурой и облаком. Приоритетный доступ со скидкой получат исследовательские организации Израиля, но в целом центр будет открыт для компаний со всего света. Как говорят создатели, IQCC — это лучший в мире полигон для создания новых технологий в области квантовых вычислений, а открытая архитектура площадки позволяет регулярно проводить обновления и упрощает дальнейшее масштабирование возможностей и вычислительных мощностей. Сейчас в IQCC установлены 21-кубитный компьютер Galilee от Quantware на сверхпроводящих кубитах (ещё один такой же используется в качестве тестовой платформы) и фотонный компьютер Negev от ORCA (8 кумод). Системы управляются контроллерами OPX1000 от самой Quantum Machines. HPC-инфраструктура представлена DGX A100, четырьмя GH200 и 128 vCPU на базе AMD EPYC 9334 (Genoa). Дополнительные ресурсы можно арендовать в облаке AWS. Для Galilee и Negev доступна интеграция с DGX Quantum, платформой для гибридных квантово-классических вычислений, которая была создана NVIDIA и Quantum Machines и впервые в мире развёрнута именно в IQCC. Управлять компьютерами и разрабатывать ПО можно с использованием Qiskit, QUA, OpenQASM3, QBridge, а также Classiq. К системе организован облачный доступ. В ближайшие месяцы в IQCC будут развёрнуты ещё несколько квантовых компьютеров и QPU.

16.06.2024 [16:25], Сергей Карасёв

Холодный приём: новый национальный суперкомпьютер Норвегии разместят в руднике и охладят водой из фьордаВласти Норвегии, по сообщению ресурса HPC Wire, подписали контракт стоимостью Kr225 млн ($21 млн) с корпорацией HPE, предусматривающий создание нового национального суперкомпьютера A2 (постоянное имя системе дадут позже). Он станет самым мощным в истории страны и значительно ускорит исследования и разработки в различных областях, в том числе в сфере ИИ. За закупку и эксплуатацию НРС-систем в Норвегии отвечает государственная компания Sigma2 AS. Вычислительные услуги предоставляются в сотрудничестве с университетами Бергена, Осло, Тромсё, а также Норвежским университетом естественных и технических наук (NTNU) в рамках проекта NRIS. В основу нового суперкомпьютера ляжет платформа HPE Cray EX4000. Известно, что в состав комплекса войдут 76 узлов с четырьмя гибридными суперчипами NVIDIA GH200 (всего 304 ускорителя), 252 узла с двумя 128-ядерными AMD EPYC Turin (64 512 ядер) и 5,3-Пбайт хранилище HPE Cray ClusterStor E1000. Узлы объединит интерконнект HPE Slingshot. Ожидаемая производительность системы составит порядка 10 Пфлопс. Монтаж системы планируется выполнить в течение весны–лета 2025 года. Машина расположится в дата-центре Лефдаль (Lefdal Mine Datacenter, LMD), развёрнутом на базе бывшего рудника. Этот объект имеет большую площадь и предоставляет гибкие возможности в плане масштабирования. Новый суперкомпьютер HPE станет первой национальной высокопроизводительной системой, установленной в этом ЦОД.

Источник изображения: Sigma2 Несмотря на то, что готовящийся комплекс будет значительно мощнее высокопроизводительных вычислительных систем Sigma2 предыдущего поколения, его энергопотребление окажется меньше примерно на 30 %. Для охлаждения будет использоваться холодная вода из близлежащего фьорда. Нагретая вода затем может быть направлена на нужды местных предприятий, в том числе, например, рыбных ферм. Ожидается, что суперкомпьютер сможет удовлетворить потребности Норвегии в НРС-ресурсах в течение следующих пяти лет. Он будет доступен исследователям по всей стране. В дальнейшем суперкомпьютер может дополнительно получить 119 808 CPU-ядер и/или 224 ускорителя. В целом же Норвегия рассчитывает, что современные ЦОД станут для страны «новой нефтью».

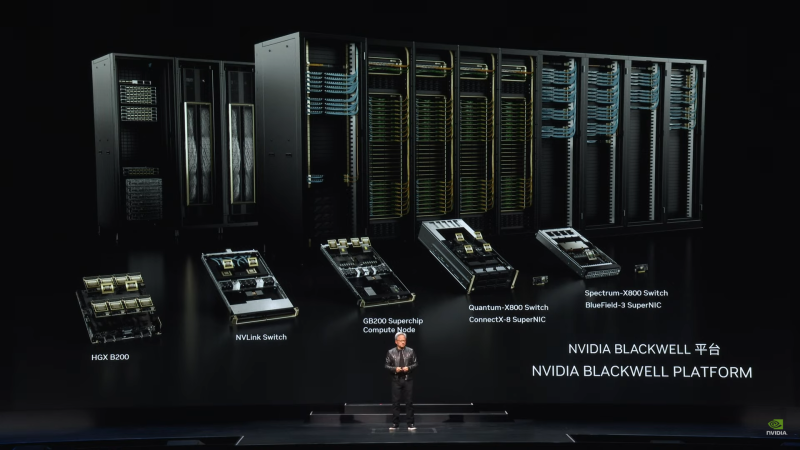

13.06.2024 [21:48], Руслан Авдеев

Microsoft арендует у Oracle ускорители NVIDIA для нужд OpenAIMicrosoft снова прибегнет к помощи Oracle для того, чтобы помочь OpenAI расширить вычислительные мощности. По данным The Register, компания арендует ИИ-мощности у Oracle Cloud Infrastructure (OCI). Microsoft уже вложила в OpenAI огромные средства и, по некоторым данным, владеет почти половиной компании, но, похоже, ресурсов Azure не хватает для того, чтобы ИИ-стартап смог свободно расти. В ходе последнего квартального отчёта Oracle заявлялось, что компания скоро построит «очень-очень большой дата-центр», около половины которого будет использовать Microsoft. Предполагается, что в нём будет использовано немало ускорителей NVIDIA с СЖО, предназначенных в первую очередь для обучения ИИ-моделей. ИИ-инфраструктура Oracle второго поколения будет существенно производительней первого и спрос на неё будет велик, говорит Oracle. Так, OCI Supercluster сможет объединить до 64 тыс. суперускорителей NVIDIA Blackwell GB200 посредством RDMA-интерконнекта с ультранизкой задержкой и получит высокопроизводительные хранилища. Суперкластером помимо Microsoft будут пользоваться Adept, Modal, MosaicML, NVIDIA, Reka, Suno, Together AI, Twelve Labs и xAI — Илон Маск (Elon Musk) уже объявил о готовности потратить $10 млрд на облачные серверы Oracle. При этом Oracle предлагает собственный сервис OCI Generative AI, который является конкурентом Azure OpenAI. Первые слухи о взаимном использовании облачных ресурсов Microsoft и Oracle появились год назад. Впоследствии Microsoft действительно арендовала ускорители NVIDIA у Oracle. Кроме того, компании стали значительно ближе к другу к другу — Oracle разместила свои комплексы Exadata в Azure. Аналогичное решение вскоре появится и в Google Cloud Platform — сервис последней Cross-Cloud Interconnect будет доступен в 11 облачных регионах OCI, а до конца 2024 года должен стартовать проект Oracle Database@Google Cloud. В последнем квартале быстрее всего у Oracle росла выручка от облачных сервисов лицензионной поддержки. В компании заявляют о крупнейших контрактах в истории на фоне спроса на обучение ИИ-моделей и рекордных уровнях продаж сервисов OCI. При этом клиенты переходят от разовых закупок на многолетнее облачное обслуживание, чего Oracle и добивалась. Обязательства компании (RPO) уже достигли $98 млрд. В ближайшем будущем Oracle будет наращивать производительность ИИ-инфраструктуры, чтобы клиенты могли пользоваться актуальными моделями, и строить всё больше крупных дата-центров. Ёмкость некоторых ЦОД приблизится к 1 ГВт. По слухам, Microsoft и OpenAI в марте 2024 года изучали возможность строительства кампуса на 5 ГВт за $100 млрд. Кроме того, как считается, Microsoft является одним из крупнейших заказчиков CoreWeave. Прямо сейчас Microsoft стремительно наращивает ёмкость своих ЦОД и ежемесячно вводит в строй по пять ИИ-суперкомпьютеров.

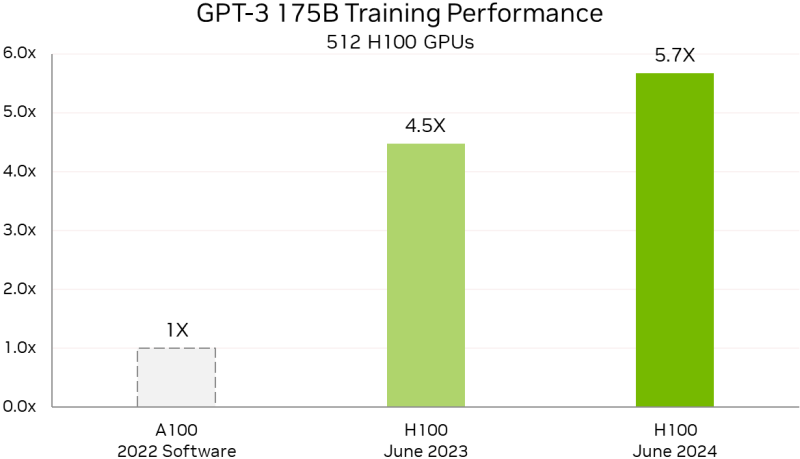

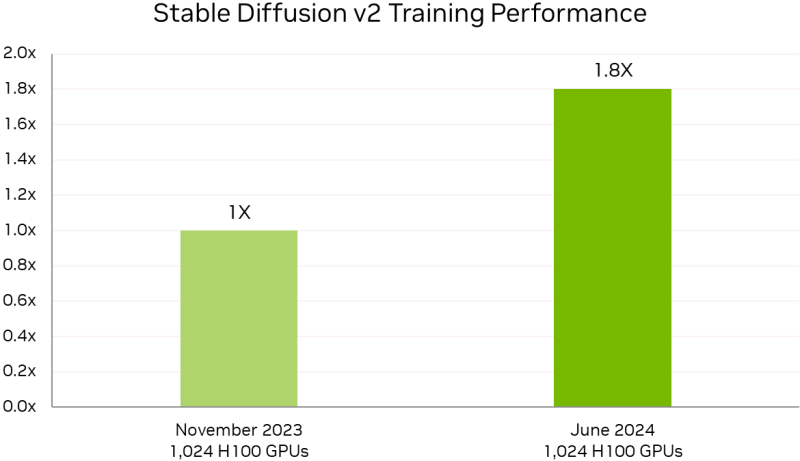

12.06.2024 [18:00], Владимир Мироненко

Уже рутина: NVIDIA снова улучшила результаты в ИИ-бенчмарке MLPerf TrainingВычислительные платформы NVIDIA снова продемонстрировали высокую производительность, на этот раз в свежих тестах MLPerf Training v4.0. Так, суперкомпьютер NVIDIA EOS-DFW более чем утроил свою производительность в LLM-тесте на базе GPT-3 175B по сравнению с прошлогодним результатом. Как сообщается, 11 616 ускорителей NVIDIA H100, объединённых 400G-интерконнектом NVIDIA Quantum-2 InfiniBand, позволили суперкомпьютеру EOS достичь столь значительного результата благодаря более масштабному и комплексному подходу к проектированию системы. А это позволяет более эффективно обучать и запускать крупные модели, экономя время и ресурсы, говорит компания. А более современный ускоритель H200 с улучшенной подсистемой памяти в MLPerf Training быстрее H100 на 14 %, а в GNN-тестах (RGAT) узлы с H200 оказались быстрее узлов с H100 сразу на 47 %. По словам компании, поставщики услуг LLM могут всего за четыре года, инвестировав $1, получить $7, используя модель Llama 3 70B на серверах на базе NVIDIA HGX H200, если исходить из того, что обслуживание обходится в $0,60 за миллион токенов, а пропускная способность HGX H200 составляет 24 тыс. токенов в секунду. Росту производительности также способствовало совершенствование и оптимизация ПО. Так, кластер из 512 чипов H100 за год стал на 27 % быстрее, а рост производительности с увеличением количества ускорителей теперь более линеен. В новом тесте MLPerf Training по тюнингу LLM (LoRA применительно к Meta✴ Llama 2 70B) системы NVIDIA показали эффективное масштабирование при количестве ускорителей от 8 до 1024. NVIDIA также увеличила производительность обучения Stable Diffusion v2 почти на 80 % при тех же масштабах систем, что были представлены в прошлом тестировании. NVIDIA отметила, что для компаний, запускающих приложения на базе LLM, высокая производительность имеет большое значение. Возможность обучать и настраивать более мощные модели — и быстрее их развёртывать и запускать — позволит получить лучшие результаты и более высокий доход. А с выходом платформы NVIDIA Blackwell скоро появится возможность как обучения, так и инференса моделей генеративного ИИ с триллионом параметров.

12.06.2024 [09:49], Владимир Мироненко

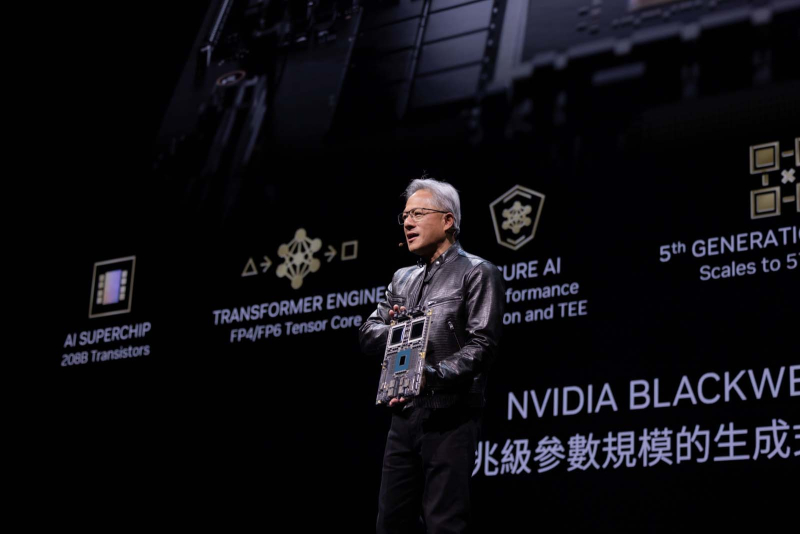

Суверенный ИИ может стать для NVIDIA новым источником роста доходовСейчас во многих странах Азии, Ближнего Востока, Европы и в США наблюдается всплеск интереса к внедрению ИИ, что вызвало резкий рост расходов на вычислительные мощности, пишет The Wall Street Journal. Правительства стран увеличивают бюджеты и используют различные рычаги для стимулирования локальных компаний и транснациональных корпораций к строительству новых ЦОД и модернизации существующих с целью развития собственных ИИ-технологий и обучения больших языковых моделей (LLM) на языках и данных граждан своей страны. Этот тренд ресурс WSJ объясняет стремлением стран к большей стратегической самостоятельности на фоне растущей напряжённости между США и Китаем, сосредоточенной на технологиях, а также намерением защитить национальную культуру и национальную безопасность в связи с бурным развитием ИИ-технологий. В прошлом месяце NVIDIA сообщила, что так называемые инициативы в области суверенного ИИ, как ожидается, принесут её в этом году почти $10 млрд, тогда как в прошлом году это направление не было для неё доходным. Из $26 млрд выручки NVIDIA за прошлый квартал почти половина поступила от крупных компаний, занимающихся облачными вычислениями, которые арендуют доступ к её чипам. Новое направление сулит выгоду NVIDIA и другим американским технологическим компаниями, занятым в сфере строительства и эксплуатации ЦОД, и ищущим новые источники роста, поскольку спрос частного сектора на ИИ-технологии может снизиться. Глава NVIDIA Дженсен Хуанг (Jensen Huang, на фото выше) в последние месяцы провёл немало встреч с правительственными чиновниками разных стран, чтобы убедить их в необходимости инвестиций в ИИ со стороны государства. В сентябре прошлого года он встречался с премьер-министром Индии Нарендрой Моди, в декабре — с премьер-министрами Японии и Сингапура. В этом году он провёл встречи с официальными лицами ОАЭ и Канады. и побывал на Тайване. Среди крупнейших спонсоров суверенного ИИ — Сингапур, чей национальный суперкомпьютерный центр оснащается новейшими чипами NVIDIA, а государственная телекоммуникационная компания Singtel в сотрудничестве с NVIDIA занята расширением своего парка ЦОД в Юго-Восточной Азии. Страна также стала инициатором создания LLM для языков Юго-Восточной Азии. В свою очередь, Канада планирует выделить $1,5 млрд в рамках суверенной вычислительной стратегии для стартапов и исследователей, а в Японии после визита Хуанга объявили о планах инвестировать в этом году около $740 млн в наращивание вычислительной мощности для разработки ИИ для нужд страны. Аналогичные инициативы нашли поддержку Европе. Например, во Франции и Италии телекоммуникационные компании создают ИИ-суперкомпьютеры с чипами NVIDIA для разработки LLM с поддержкой национальных языков. Кения в прошлом месяце подписала с Microsoft и поддерживаемой ОАЭ компанией G42, занимающейся ИИ, соглашение о строительстве в стране ЦОД стоимостью $1 млрд на геотермальной энергии с целью обучения ИИ-модели непосредственно на суахили и английском языке. «Правительствам теперь нужны суверенные облака для инфраструктуры ИИ и конфиденциальных данных, а американские технологические компании стремятся помочь в их создании», — говорит Ну Векслер (Nu Wexler), бывший сотрудник по связям с общественностью в Google, Meta✴ и Twitter (нынешней X). Китай также стремится занять позиции на рынке суверенного ИИ. Он предлагает строительство ЦОД и возможности ИИ африканским странам, включая Египет. Но китайские ИИ-чипы пока уступают по производительности ускорителям NVIDIA и других американских компаний, что часто делает США предпочтительным поставщиком, несмотря на экспортные ограничения, отметил WSJ. По мнению аналитиков, тренд на развитие суверенного ИИ может стать для NVIDIA спасительным кругом, когда наступит сокращение закупок ИИ-чипов со стороны основной группы клиентов технологических компаний, таких как Microsoft, Amazon и Google.

11.06.2024 [17:09], Руслан Авдеев

Foxconn построит на Тайване передовой вычислительный центр на базе суперускорителей NVIDIA BlackwellПроизводитель электроники Foxconn намерен построить на острове передовой вычислительный центр в Гаосюне (Тайань). Datacenter Dynamics информирует, что центр, который будет готов в 2026 году, получит 64 суперускорителя NVIDIA Blackwell GB200 NVL72. Foxconn и NVIDIA будут сотрудничать и над созданием «цифровых двойников» для производственных компаний, электромобилей и систем умного города. Проекты будут реализованы на платформе NVIDIA Omniverse. В NVIDIA заявили, что сейчас происходит расцвет новой эры вычислений, ставшей драйвером спроса на дата-центры для генеративного ИИ. Также в компании подчеркнули, что Foxconn является ведущим поставщиком вычислительных решений NVIDIA и одним из ключевых новаторов в деле внедрения генеративного ИИ в промышленности и робототехнике. Используя платформы NVIDIA Omniverse и Isaac, компания задействует передовые ИИ-технологии и систему цифровых двойников для создания передового вычислительного центра в Гаосюне. Основанная в 1974 году компания Foxconn в последнее время стремится расширить долю рынка в полупроводниковой индустрии на фоне медленного роста продаж смартфонов. Дочерняя компания Ingrays выпускает серверы, системы хранения данных и HPC-компоненты, включая HPC-платформы на основе чипов NVIDIA. Ранее появилась информация о том, что компания намерена превратить опосредованно принадлежащий ей завод Sharp по выпуску LCD-панелей в дата-центр, но тот расположен в Япони и к текущему проекту не имеет прямого отношения.

11.06.2024 [15:22], Сергей Карасёв

3,76 млн ускорителей в 2023 году: NVIDIA захватила 98 % рынка GPU для ЦОДПо оценкам аналитической фирмы Tech Insights, которые приводит ресурс HPC Wire, компания NVIDIA в 2023 году отгрузила приблизительно 3,76 млн ускорителей на базе GPU, ориентированных на ЦОД. Это более чем на 1 млн штук превосходит результат 2022 года, когда поставки таких изделий оценивались в 2,64 млн единиц. С учётом решений AMD и Intel общий объём поставок GPU-ускорителей для ЦОД в 2023 году составил 3,85 млн единиц против примерно 2,67 млн штук в 2022 году. Правда, столь малая доля отгрузок решений AMD и Intel вызывает некоторые сомнения. Как отмечает аналитик Tech Insights Джеймс Сандерс (James Sanders), в настоящее время на рынке не хватает аппаратных ресурсов для удовлетворения всех ИИ-потребностей. А поэтому будет расти спрос на ускорители и специализированные чипы разработчиков, конкурирующих с NVIDIA. Согласно подсчётам TechInsights, по итогам 2023-го NVIDIA контролировала около 98 % мирового рынка ускорителей на базе GPU для дата-центров. Схожий результат компания продемонстрировала и годом ранее. Такой рост связан со стремительным развитием ИИ-приложений и увеличением спроса на НРС-системы. При этом на NVIDIA приходится и 98 % выручки от реализации таких ускорителей: в 2023 году они принесли компании $36,2 млрд, что более чем в три раза превышает прошлогодний показатель в $10,9 млрд. По данным TechInsights, в 2023 году AMD поставила около 50 тыс. ускорителей для ЦОД, а Intel — примерно 40 тыс. единиц (в оригинальном материале HPCWire указаны на порядок более высокие значения; корректировка сделана в соответствии с оставшейся долей в 2 % рынка). В 2024-м, как полагают эксперты, спрос на такие продукты в глобальном масштабе поднимется. Речь, в частности, идёт об ускорителях серии Instinct MI300, разработанных AMD. При этом AMD заявляет, что намерена выпускать новые решения ежегодно: ускоритель MI325X запланирован на 2024 год, MI350 — на 2025-й, а MI400 — на 2026-й. В свою очередь, Intel продвигает изделия Gaudi3. Специализированные ИИ-чипы проектируют и ведущие гиперскейлеры. Так, AWS в конце прошлого года представила ИИ-ускоритель Trainium2, предназначенный для обучения нейронных сетей. Google анонсировала изделия Cloud TPU v5p, а Microsoft — Maia 100. Meta✴ намерена активно внедрять собственные ИИ-ускорители Artemis.

09.06.2024 [12:36], Сергей Карасёв

ASUS представила ИИ-систему ESC AI POD на базе NVIDIA GB200 NVL72Компания ASUS анонсировала мощный вычислительный комплекс ESC AI POD, предназначенный для решения ресурсоёмких задач в области ИИ и НРС. В основу новинки положена платформа NVIDIA GB200 NVL72 на архитектуре Blackwell. Решение ESC NM2N721-E1 использует 72 ускорителя NVIDIA Blackwell и 36 процессоров NVIDIA Grace, объединённых интерконнекта NVIDIA NVLink 5. Утверждается, что ESC AI POD поддерживает работу с большими языковыми моделями (LLM), насчитывающими до триллиона параметров. В состав системы входят вычислительные узлы, коммутаторы, а также полки питания 1U мощностью 33 кВт. Возможно развёртывание воздушно-жидкостного или полностью жидкостного охлаждения. Кроме того, ASUS продемонстрировала в рамках Computex 2024 другие новинки. В их числе — системы, выполненные на модульной архитектуре NVIDIA MGX. Это, в частности, сервер ESC NM1-E1 типоразмера 2U, комплектующийся суперчипом NVIDIA Grace Hoppe GH200. Он использует технологию NVIDIA NVLink-C2C и поддерживает воздушное охлаждение. Кроме того, показаны серверы ESC NM2-E1 и ESR1-511N-M1 (стандарта 1U).

Среди других решений упоминаются серверы ESC N8 на платформе Intel Xeon Emerald Rapids и ESC N8A на базе AMD EPYC 9004 (Genoa). Эти системы несут на борту ускорители NVIDIA Blackwell. Кроме того, ASUS готовит новые ИИ-решения, оснащённые сетевым ускорителем NVIDIA BlueField-3 SuperNIC.

07.06.2024 [15:42], Руслан Авдеев

«ИИ-гигафабрика» xAI разместится в гигантском дата-центре в ТеннесиИИ-стартап xAI, курируемый Илоном Маском (Elon Musk), намерен построить гигантский дата-центр с самым производительным в мире ИИ-суперкомпьютером. По данным Datacenter Dynamics, ЦОД разместится в окрестностях Мемфиса (штат Теннесси), а пока ожидает одобрения властей. В обозримом будущем компания должна получить сотни тысяч ускорителей для обучения новых моделей, в частности, чат-бота Grok, предлагаемого, например, по подписке в социальной сети X (Twitter). Ранее в Сеть утекла информация, что NVIDIA передаст xAI чипы, изначально предназначавшиеся для Tesla — Маск весьма вольно распоряжается активами подконтрольных ему бизнесов, часто вызывая недовольство инвесторов. Пока проект ожидает окончательного разрешения от местного бизнес-инкубатора Memphis Shelby County Economic Development Growth Engine (EDGE), а также муниципальных и федеральных властей. Впрочем, гораздо важнее дождаться одобрения энергетической компании Tennessee Valley Authority (TVA). Реализация проекта сулит появление высокооплачиваемых рабочих мест и увеличение доходов штата, что поможет поддерживать и модернизировать местную инфраструктуру. Муниципальные власти уже назвали проект «крупнейшей мультимиллиардной инвестицией в истории Мемфиса, а Маск окрестил ЦОД «гигафабрикой для вычислений» по аналогии с Tesla Gigafactory. По данным местных СМИ, приглянувшаяся Маску площадка принадлежит инвесткомпании Phoenix Investors, сотрудничающей с xAI и местными властями. Ранее объект управлялся компанией Electrolux. Неизвестно, насколько масштабной будет первая фаза проекта и сколько средств на неё потратят. Ранее Маск заявлял, что xAI развернёт в ближайшие месяцы 100 тыс. ускорителей NVIDIA H100, а кластер из ещё 300 тыс. B200 введут в эксплуатацию следующим летом. Считается, что xAI арендует около 16 тыс. H100 у Oracle Cloud, также компания пользуется услугами AWS и свободными мощностями X (Twitter). |

|