Материалы по тегу: nvidia

|

02.06.2024 [16:20], Сергей Карасёв

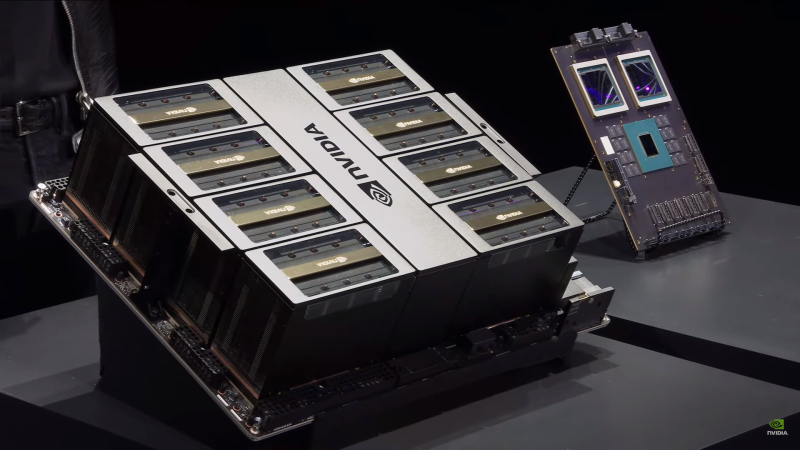

NVIDIA представила ускорители GB200 NVL2, платформы HGX B100/B200 и анонсировала экосистему следуюшего поколения Vera RubinNVIDIA сообщила о широкой отраслевой поддержке своей архитектуры нового поколения Blackwell. Эти ускорители, а также чипы Grace легли в основу многочисленных систем для ИИ-фабрик и дата-центров, которые, как ожидается, будут способствовать «следующей промышленной революции». Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) объявил о том, что серверы на базе Blackwell выпустят ASRock Rack, ASUS, Gigabyte, Ingrasys, Inventec, Pegatron, QCT, Supermicro, Wistron и Wiwynn. Речь идёт об устройствах разного уровня, рассчитанных на облачные платформы, периферийные вычисления и ЦОД клиентов. «Началась очередная промышленная революция. Компании и целые страны сотрудничают с NVIDIA, чтобы трансформировать традиционные дата-центры общей стоимостью в триллионы долларов в платформы нового типа — фабрики ИИ», — говорит Хуанг. Для решения ИИ-задач и поддержания других ресурсоёмких приложений будут выпущены серверы с CPU на архитектурах х86 и Arm (изделия Grace) с воздушным и жидкостным охлаждением. Заказчикам будут доступны модели с одним и несколькими ускорителями. В частности, сама NVIDIA предлагает DGX-системы Blackwell, а для сторонних производителей доступны готовые платформы HGX B100 и HGX B200. Кроме того, компания представила ускоритель GB200 NVL2, т.е. сборку из двух GB200, объединённых NVLink 5. NVIDIA также сообщила о том, что модульная архитектура NVIDIA MGX отныне поддерживает Blackwell, включая и GB200 NVL2. В целом, NVIDIA MGX предлагает свыше 100 различных конфигураций. На сегодняшний день на базе MGX выпущены или находятся в разработке более 90 серверов от более чем 25 партнёров NVIDIA по сравнению с 14 системами от шести партнёров в 2023 году. В составе MGX, в частности, впервые будут использоваться изделия AMD EPYC Turin и чипы Intel Xeon 6 (ранее — Granite Rapids). Отмечается, что глобальная партнёрская экосистема NVIDIA включает TSMC, а также поставщиков различных компонентов, включая серверные стойки, системы электропитания, решения для охлаждения и пр. В число поставщиков такой продукции входят Amphenol, Asia Vital Components (AVC), Cooler Master, Colder Products Company (CPC), Danfoss, Delta Electronics и Liteon. Серверы нового поколения готовят Dell Technologies, Hewlett Packard Enterprise (HPE) и Lenovo. В скором времени NVIDIA представит улучшенные ускорители Blackwell Ultra, которые получат более современную HBM3e-память. А уже в следующем году компания покажет решения на архитектуре следующего поколения: ускорители Rubin, процессоры Vera, NVLink 6 с удвоенной пропускной способностью (3,6 Тбайт/с), коммутаторы X1600 и DPU SuperNIC CX9 для сетей 1,6 Тбит/с.

02.06.2024 [15:30], Сергей Карасёв

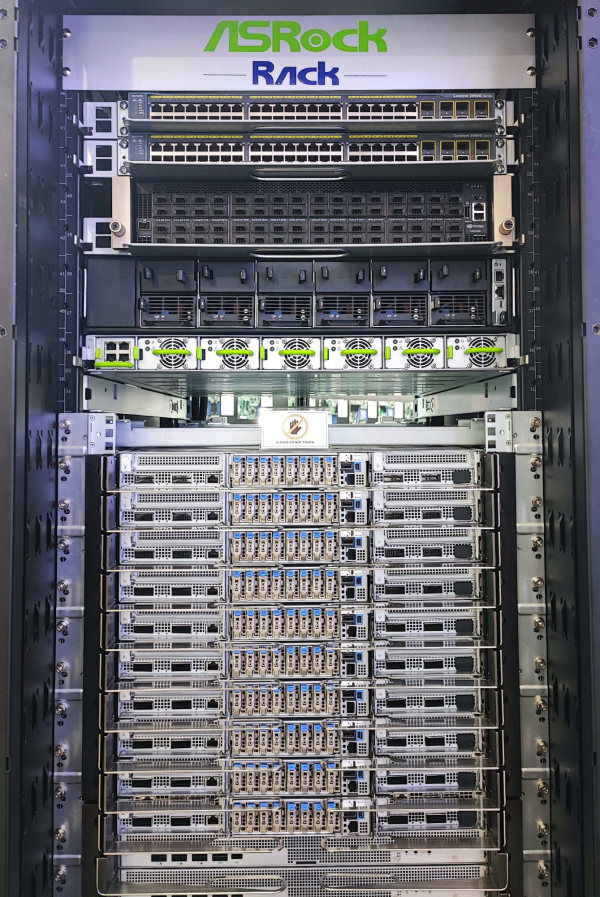

ASRock Rack анонсировала ИИ-системы с ускорителями NVIDIA Blackwell GB200, B200 и B100Компания ASRock Rack представила серверы с ускорителями NVIDIA Blackwell, предназначенные для решения ресурсоёмких задач в области ИИ и НРС. В частности, демонстрируются устройства, оборудованные системой жидкостного охлаждения. В число новинок на базе архитектуры NVIDIA Blackwell входят стоечная система ORV3 NVIDIA GB200 NVL72 с СЖО и сервер 6U8X-GNR2/DLC NVIDIA HGX B200 с технологией прямого жидкостного охлаждения Direct-to-chip. Второе из названных устройств выполнено в формате 6U; поддерживаются до восьми ускорителей NVIDIA HGX B200. А сервер 6U8X-EGS2 NVIDIA HGX B100, в свою очередь, рассчитан на восемь NVIDIA HGX B100. Все новые серверы ASRock Rack NVIDIA HGX допускают использование до восьми DPU NVIDIA BlueField-3 SuperNIC. ASRock Rack также продемонстрировала системы, выполненные на модульной архитектуре NVIDIA MGX. Это, в частности, двухсокетный сервер 4UMGX-GNR2 формата 4U с возможностью установки восьми ускорителей FHFL. Устройство располагает пятью слотами FHHL PCIe 5.0 x16 и одним разъёмом HHHL PCIe 5.0 x16 с поддержкой NVIDIA BlueField-3 DPU и NVIDIA ConnectX-7 NIC. Есть 16 отсеков для накопителей E1.S (PCIe 5.0 x4) с возможностью горячей замены. «Мы представили решения для дата-центров на базе архитектуры NVIDIA Blackwell для самых требовательных рабочих нагрузок в области обучения больших языковых моделей (LLM) и генеративного ИИ. Мы и дальше намерены расширять семейство этих серверов», — сказал Вейши Са, президент ASRock Rack. На выставке Computex 2024 компания ASRock Rack демонстрирует и другие системы с ускорителями NVIDIA. Например, представлена модель MECAI-GH200 (на изображении) — на момент анонса это самый компактный в мире сервер с суперчипом NVIDIA GH200.

02.06.2024 [15:30], Сергей Карасёв

NVIDIA представила платформу AI Enterprise-IGX для индустриальных ИИ-приложенийКомпания NVIDIA сообщила о доступности комплексного решения AI Enterprise-IGX, которое, как утверждается, призвано удовлетворить растущую потребность в ИИ-вычислениях в реальном времени на периферии в таких областях, как медицина, промышленность и пр. Продукт объединяет NVIDIA IGX и систему Holoscan, а также Isaac и Metropolis. Напомним, IGX — это платформа индустриального уровня для ИИ-вычислений на периферии, специально разработанная для промышленных и медицинских сред. Holoscan предоставляет собой полнофункциональную инфраструктуру, необходимую для масштабируемой программно-определяемой обработки потоковых данных в режиме реального времени на периферии. Отмечается, что AI Enterprise-IGX предоставляет предприятиям новый уровень производительности, безопасности и поддержки для всего стека ПО для периферийных вычислений. В результате, упрощается и ускоряется развёртывание ИИ-приложений на периферии. Благодаря сочетанию NVIDIA AI Enterprise-IGX и Holoscan на базе IGX-платформ клиенты получают решение с гибкими возможностями интеграции сенсоров, высокой ИИ-производительностью и безопасностью для решения задач на периферии. Вместе с тем NVIDIA объявила об обновлении самой аппаратной платформы IGX. В частности, для IGX Orin 700 (кодовое имя IGX Boardkit) реализована поддержка ускорителей NVIDIA RTX 6000 Ada, что обеспечивает ИИ-производительность до 1,705 TOPS — это в семь раз больше по сравнению с показателем, который достигается при использовании интегрированного GPU. Кроме того, появилась поддержка «системы на модуле» IGX Orin 500. Говорится также, что программа сертификации NVIDIA-Certified Systems теперь распространяется на платформу IGX. Такие продукты готовят Advantech, Adlink, Aetina, Ahead, Cosmo Intelligent Medical Devices (подразделение Cosmo Pharmaceuticals), Dedicated Computing, Leadtek, Onyx, YUAN и др. Вместе с тем многие компании, работающие в области медицинских технологий, включая Barco, Karl Storz, Medtronic и Moon Surgical, внедряют NVIDIA IGX с системой Holoscan для ускорения разработки ИИ-решений для медицинской диагностики, хирургических роботов, средств по уходу за пациентами и пр.

02.06.2024 [15:30], Владимир Мироненко

NVIDIA объявила о доступности NIM для разработчиков ИИNVIDIA объявила о доступности NVIDIA NIM, микросервисов инференса, которые предоставляют готовые модели в виде заранее оптимизированных контейнеров, доступных для развёртывания в облаках, ЦОД или на рабочих станциях. Это, по словам компании, позволяет разработчикам возможность без труда создавать приложения генеративного ИИ за считанные минуты, хотя ранее на это уходили недели. Сложность приложений генеративного ИИ растёт и часто в них используется несколько моделей с различными возможностями для генерации текста, изображений, видео, речи и т.д. NVIDIA NIM позволяет значительно повысить производительность разработчиков, предоставляя простой стандартизированный способ добавления генеративного ИИ в их приложения. NIM также позволяет компаниям максимизировать свои инвестиции в инфраструктуру. Например, NIM-контейнер с оптимизированным вариантом Meta✴ Llama 3-8B выдаёт втрое больше токенов за единицу времени, чем LLM без оптимизаций. Более 200 технологических партнёров NVIDIA, включая Cadence, Cloudera, Cohesity, DataStax, NetApp, Scale AI и Synopsys, уже используют NIM, чтобы ускорить развёртывание генеративного ИИ для приложений, специфичных для их индустрии, таких как ИИ-помощники, помощники по созданию кода, цифровые человеческие аватары и многое другое. Кроме того, экосистему NIM поддерживают Canonical, Red Hat, Nutanix, VMware, Kinetica и Redis. Доступна и интеграция с KServe. NIM интегрирован в платформу NVIDIA AI Enterprise. Начиная со следующего месяца участники программы NVIDIA Developer Program получат бесплатный доступ к NIM для исследований, разработки и тестирования. Контейнеры NIM могут включать ПО NVIDIA CUDA, NVIDIA Triton Inference Server и NVIDIA TensorRT-LLM. А на ai.nvidia.com уже доступно более 40 готовых моделей, включая Databricks DBRX, Google Gemma, Meta✴ Llama 3, Microsoft Phi-3, Mistral Large, Mixtral 8x22B и Snowflake Arctic. Компания также представила и NVIDIA BioNeMo NIM для биомедицинской сферы. Ведущие провайдеры ИИ-решений и MLOps-платформ, включая Amazon SageMaker, Microsoft Azure AI, Dataiku, DataRobot, deepset, Domino Data Lab, LangChain, Llama Index, Replicate, Run.ai, ServiceNow, Securiti AI и Weights & Biases также внедрили NIM. Hugging Face теперь тоже предлагает NIM-контейнейры и позволяет развернуть модели в различных облаках всего за несколько кликов. Микросервисы NIM также интегрированы в AWS, Google Cloud, Microsoft Azure и Oracle Cloud. Наконец, компетенциями в области NIM обзавелись Accenture, Deloitte, Infosys, Latentview, Quantiphi, SoftServe, TCS и Wipro. Предприятия могут запускать приложения с поддержкой NIM практически в любом месте, в том числе на сертифицированных NVIDIA системах Cisco, Dell, HPE, Lenovo и Supermicro, а также ASRock Rack, ASUS, GIGABYTE, Ingrasys, Inventec, Pegatron, QCT, Wistron и Wiwynn. Более того, например, Foxconn и Pegatron уже используют NIM для разработки предметно-ориентированных LLM для собственных производственных нужд.

27.05.2024 [22:20], Алексей Степин

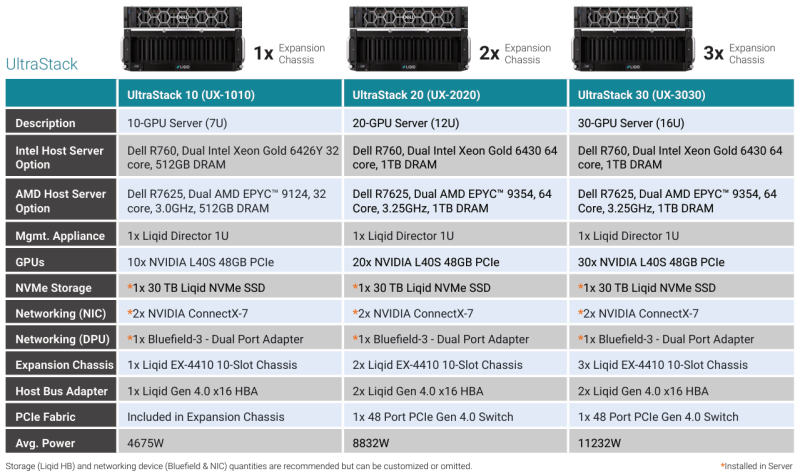

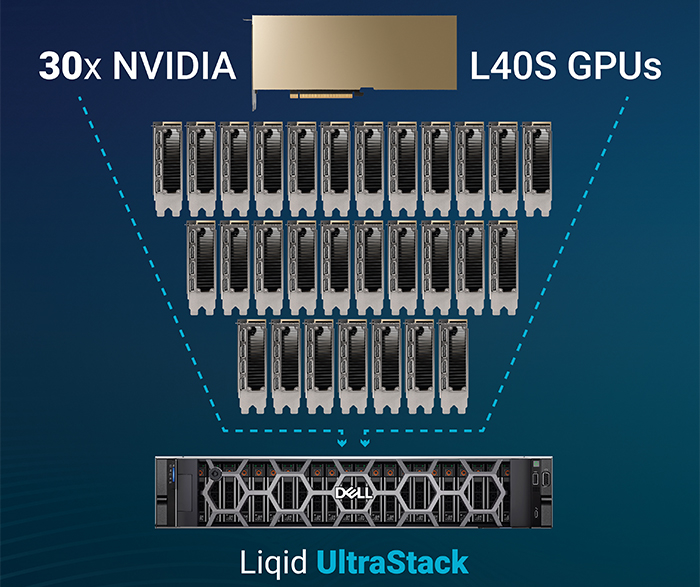

Тридцать на одного: Liqid UltraStack 30 позволяет подключить десятки GPU к одному серверуКомпания Liqid сотрудничает с Dell довольно давно — ещё в прошлом году она смогла добиться размещения 16 ускорителей в своей платформе UltraStack L40S. Но на этом компания не остановилась и представила новую композитную платформу UltraStack 30, в которой смогла довести число одновременно доступных хост-системе ускорителей до 30. Для подключения, конфигурации и управления ресурсами ускорителей Liqid использует комбинацию фирменного программного обеспечения Matrix CDI и интерконнекта Liqid Fabric. В основе последнего лежит PCI Express. Это позволяет динамически конфигурировать аппаратную инфраструктуру с учётом конкретных задач с её возвратом в общий пул ресурсов по завершению работы. Сами «капсулы» с ресурсами подключены к единственному хост-серверу, что упрощает задачу масштабирования, минимизирует потери производительности, повышает энергоэффективность и позволяет добиться наиболее плотной упаковки вычислительных ресурсов, нежели это возможно в классическом варианте с раздельными серверами. А благодаря гибкости конфигурирования буквально «на лету» исключается простой весьма дорогостоящих аппаратных ресурсов.

Источник здесь и далее: Liqid В случае UltraStack 30 основой по умолчанию является сервер серии Dell PowerEdge R760 с двумя Xeon Gold 6430 и 1 Тбайт оперативной памяти, однако доступен также вариант на базе Dell R7625, оснащённый процессорами AMD EPYC 9354. Опционально можно укомплектовать систему NVMe-хранилищем объёмом 30 Тбайт, в качестве сетевых опций доступны либо пара адаптеров NVIDIA ConnectX-7, либо один DPU NVIDIA Bluefield-3.  За общение с ускорительными модулями отвечает 48-портовой коммутатор PCI Express 4.0 вкупе с фирменными хост-адаптерами Liqid. Технология ioDirect позволяет ускорителям общаться друг с другом и хранилищем данных напрямую, без посредничества CPU. В трёх модулях расширения установлено по 10 ускорителей NVIDIA L40S, каждый несет на борту 48 Гбайт памяти GDDR6. Такая конфигурация теоретически способна развить 7,3 Пфлопс на вычислениях FP16, вдвое больше на FP8, и почти 1,1 Пфлопс на тензорных ядрах в формате TF32. Платформа UltraStack 30 предназначена в первую очередь для быстрого развёртывания достаточно мощной ИИ-инфраструктуры там, где требуется тонкая подстройка и дообучение уже «натасканных» больших моделей. При этом стоит учитывать довольно солидное энергопотребление, составляющее более 11 кВт. Также в арсенале компании есть решения SmartStack на базе модульных систем Dell PowerEdge C-Series, позволяющие подключать к каждому из лезвийных модулей MX760c, MX750с и MX740c до 20 ускорителей. Модульные решения Liqid поддерживают также ускорители других производителей, включая достаточно экзотические, такие как Groq.

26.05.2024 [22:25], Александр Бенедичук

«Гигафабрика» для ИИ: стартап xAI Илона Маска хочет построить суперкомпьютер со 100 тыс. NVIDIA H100Как сообщает Reuters со ссылкой на The Information, Илон Маск планирует построить гигантский суперкомпьютер для своего ИИ-стартапа xAI для работы над следующей версией чат-бота Grok. Запуск предполагаемого суперкомпьютера ожидается к осени 2025 года, при этом, по словам Маска, xAI может сотрудничать с Oracle. Для обучения Grok 2 использовалось около 20 тыс. ускорителей NVIDIA H100, а для Grok 3 и более поздних версий потребуется уже 100 тыс. NVIDIA H100. После завершения строительства суперкомпьютер будет как минимум в четыре раза больше самых больших существующих на сегодняшний день GPU-кластеров, утверждается в презентации, сделанной для инвесторов в мае. Семейство ускорителей NVIDIA доминирует на рынке ИИ-чипов для ЦОД, но из-за высокого спроса их может быть трудно приобрести. Маск основал xAI в прошлом году в качестве конкурента OpenAI и Google. Маск также был соучредителем OpenAI и членом совета директоров до 2018 года. В феврале этого года он подал иск к OpenAI и соучредителям Альтману и Брокману, посчитав, что они нарушили соглашение о некоммерческом характере деятельности.

24.05.2024 [13:29], Сергей Карасёв

Облачный провайдер Scaleway расширил охват до 52 стран и закупил ещё тысячу NVIDIA H100Французский облачный провайдер Scaleway, по сообщению ресурса Datacenter Dynamics, значительно расширил зону охвата. Компания теперь предоставляет свой сервис Dedibox Virtual Private Server (VPS) в 65 городах на территории 52 стран. По заявлениям Scaleway, Dedibox VPS даёт компаниям гибкость в развёртывании виртуальной инфраструктуры. Доступны различные конфигурации, а стоимость начинается примерно с €5/мес. Услуга охватывает Северную Америку, Южную Америку, Европу, Ближний Восток, Африку, Азию и Океанию. Кроме того, провайдер объявил о приобретении более 1000 дополнительных ускорителей NVIDIA H100, которые будут использованы для расширения вычислительных мощностей в дата-центре Iliad DC5 в Большом Париже. Scaleway использует Ethernet-платформу Spectrum-X, разработанную для облачных провайдеров. Scaleway также запустила новую услугу под названием GPU Cluster On Demand. Она позволяет клиентам зарезервировать необходимое количество вычислительных кластеров на базе GPU — от нескольких штук до нескольких тысяч. Таким образом, можно гибко масштабировать ресурсы при реализации различных проектов в области ИИ и НРС. Наконец, Scaleway объявила о подписании соглашения о предоставлении ускорителей H100 компании H из Парижа. Этот стартап сформирован командой бывших руководителей Google DeepMind. Компания занимается разработкой мультиагентных моделей и фундаментальных моделей поведения.

24.05.2024 [13:17], Сергей Карасёв

Microsoft ежемесячно развёртывает по пять ИИ-суперкомпьютеровMicrosoft на фоне стремительного развития ИИ активно расширяет свой вычислительный потенциал: каждый месяц корпорация развёртывает эквивалент пяти суперкомпьютеров Eagle. Об этом, как сообщает ресурс Datacenter Dynamics, заявил технический директор облачной платформы Azure Марк Руссинович (Mark Russinovich). Комплекс Microsoft Azure Eagle в нынешнем рейтинге TOP500 занимает третье место с FP64-производительностью 561,2 Пфлопс — это самый мощный в мире облачный суперкомпьютер. В системе задействованы 14 400 ускорителей NVIDIA H100, а также интерконнект NVIDIA InfiniBand NDR. «Сегодня мы развёртываем эквивалент пяти таких суперкомпьютеров каждый месяц. Наша экосистема ИИ теперь на несколько порядков больше и меняется каждый день и каждый час», — сказал Руссинович на конференции Microsoft Build. Таким образом, ежемесячно Microsoft вводит в эксплуатацию вычислительные мощности, сопоставимые с теми, которые могут обеспечить 72 000 ускорителей Н100. В общей сложности это 2,8 Эфлопс ресурсов, которые распределены по расширяющейся сети дата-центров корпорации. Руссинович отметил, что общая протяжённость соединений InfiniBand в этих ЦОД такова, что ими можно было бы как минимум пять раз опоясать Землю. То есть, это не менее 200 тыс. км. О стремительном расширении вычислительных мощностей также говорит технический директор Microsoft Кевин Скотт (Kevin Scott). Он не стал приводить конкретные цифры, но дал наглядное представление. Так, ИИ-суперкомпьютер, который корпорация в 2020 году создала для OpenAI GPT-3, Скотт сравнил с акулой. Система следующего поколения, разработанная в 2022-м для обучения GPT-4, — это косатка, которая в два раза длиннее и в три раза тяжелее больших белых акул. Нынешняя система Microsoft сравнивается с синим китом: он более чем в два раза длиннее и примерно в 25 раз тяжелее косатки. В настоящее время Microsoft и OpenAI обсуждают проект строительства масштабного кампуса ЦОД для решения самых сложных и ресурсоёмких задач в области ИИ. Проект под названием Stargate стоимостью около $100 млрд предполагает создание ряда объектов, суммарная мощность которых может достигать 5 ГВт. Компания действительно стремительно наращивает ёмкость своих ЦОД, добавляя порядка 200 МВт ежемесячно.

23.05.2024 [21:00], Владимир Мироненко

Чистая прибыль NVIDIA по итогам квартала взлетела более чем в семь разNVIDIA объявила финансовые результаты за I квартал 2025 финансового года, завершившийся 28 апреля 2024 года. После объявления итогов, которые превзошли прогнозы аналитиков Уолл-стрит, акции компании выросли в цене в ходе расширенных торгов на 7 %, впервые превысив отметку в $1000. Выручка компании выросла на 262 % до $26,04 млрд, что значительно превышает консенсус-прогноз аналитиков, опрошенных LSEG, в размере $24,65 млрд. Скорректированная прибыль на акцию (Non-GAAP) превзошла прошлогодний показатель на 461%, составив $6,12, что также выше консенсус-прогноза LSEG, равного $5,59 на акцию. Чистая прибыль (GAAP) выросла год к году на 628 %, достигнув $14,881 млрд или $5,98 на акцию.

Источник изображения: NVIDIA В текущем, II квартале 2025 года NVIDIA ожидает получить выручку в размере $28,0 млрд ± 2 %, что выше прогноза аналитиков Уолл-стрит в размере $26,61 млрд. Консенсус-прогноз аналитиков, опрошенных LSEG, по скорректированной прибыли на акцию (Non-GAAP) в этом квартале равен $5,95. NVIDIA проведёт форвардное дробление акций в соотношении 10:1, которое пройдёт после закрытия торгов 7 июля. Это сделает акции компании доступными для более широкого круга розничных инвесторов. Большую часть выручки компании принесло подразделение по выпуску продуктов для ЦОД, увеличившее выручку год к году на 427 % до $22,56 млрд, чему способствовал растущий спрос на ИИ-ускорители. При этом поставки продукции для серверов увеличились год к году на 478 % до $19,39 млрд, а продажи сетевых решений — на 242 % до $3,17 млрд. В сегменте профессиональной визуализации продажи выросли на 45 % до $427 млн, в автомобильном секторе рост выручки год к году составил 11 %, до $329 млн. По словам финансового директора Колетт Кресс (Colette Kress), рост показателей подразделения по выпуску решений для ЦОД был обусловлен высоким спросом на ускорители H100, которые в настоящее время являются самыми мощными на рынке и на них приходится около 40 % продаж в этом сегменте. «Большим событием в этом квартале стал анонс Meta✴ большой языковой модели Llama 3, для которой потребовалось 24 тыс. ИИ-ускорителей H100», — сообщила Кресс. Аналитик Third Bridge Лукас Ке (Lucas Keh) утверждает, что спрос на ускорители NVIDIA H100 настолько велик, что производитель чипов едва успевает за ним. Генеральный директор компании Дженсен Хуанг (Jensen Huang) заявил, что ожидает ещё большего роста благодаря выходу к концу года ускорителей Blackwell следующего поколения. По его словам, эти ускорители начнут поступать в ЦОД к IV кварталу. Компания намерена ежегодно представлять новую архитектуру ускорителей. NVIDIA также отметила высокий спрос на её сетевые компоненты, которые становятся столь же важными, как и ИИ-ускорители, поскольку кластеры из десятков тысяч чипов требуют эффективного интерконнекта. Рост продаж, связанных с сетевыми технологиями, в первую очередь был обусловлен увеличением реализации продуктов InfiniBand.

22.05.2024 [14:09], Сергей Карасёв

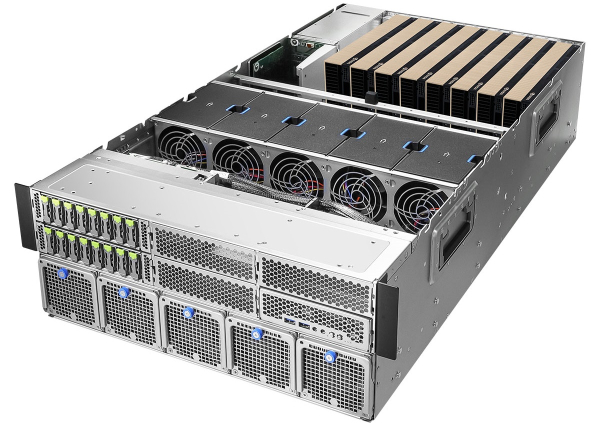

Dell представила ИИ-сервер PowerEdge XE9680L с ускорителями NVIDIA B200 и СЖОКомпания Dell анонсировала сервер PowerEdge XE9680L, предназначенный для наиболее требовательных больших языковых моделей (LLM) и крупномасштабных сред ИИ, где плотность размещения ускорителей на стойку имеет решающее значение. Новинка станет доступна во II половине 2024 года. Сервер выполнен в форм-факторе 4U. Он может комплектоваться восемью ускорителями NVIDIA HGX B200 (Blackwell). Задействована система прямого жидкостного охлаждения (DLC). Доступны 12 слотов PCIe 5.0 полной высоты и половинной длины для установки сетевых карт и иных адаптеров/контроллеров. «Сервер использует эффективное интеллектуальное охлаждение DLC как для CPU, так и для GPU. Эта революционная технология позволяет создать более плотную конфигурацию 4U, максимизируя вычислительную мощность при сохранении тепловой эффективности», — заявляет производитель. Отмечается, что PowerEdge XE9680L обеспечивает возможность масштабирования до 72 ускорителей Blackwell в расчёте на стойку 52U или до 64 ускорителей на стойку 48U. Прочие характеристики новинки будут обнародованы ближе к началу продаж. В ассортименте Dell уже есть 6U-сервер PowerEdge XE9680. Эта система использует процессоры Intel Xeon Sapphire Rapids. Она поддерживает установку восьми ускорителей NVIDIA H100/A100, а также AMD Instinct MI300X и Intel Gaudi3. |

|