Материалы по тегу: b200

|

26.07.2025 [01:05], Руслан Авдеев

Несмотря на запреты США в Китай «просочились» передовые ускорители NVIDIA на $1 млрдЗа три месяца действия новых правил США по ужесточению контроля за экспортом ИИ-чипов в КНР всё равно попали ускорители NVIDIA на сумму не менее $1 млрд. Возможности Вашингтона по борьбе с контрабандой оказались весьма ограниченными, сообщает The Financial Times. Проведённый анализ самых разных коммерческих документов и беседы с информаторами позволили выяснить, что наиболее востребованы ускорители NVIDIA B200. Причём они широко доступны на чёрном рынке, хотя их продажа клиентам из КНР запрещена. По данным The Financial Times, в мае некоторые китайские дистрибуторы начали продавать B200 для местных ИИ ЦОД — вскоре после того, как Трамп ограничил поставки в Китая ослабленных ускорителей H20. Юристы утверждают, что в Китае активно поддерживается «параллельный импорт» — ввоз новинок в страну вполне легален, если оплатить таможенные пошлины. При этом поставщики нарушают законы США. По словам экспертов, после появления слухов об ограничении поставок ускорителей в Юго-Восточную Азию, покупатели поспешили с заказами, стремясь создать запасы до того, как правила вступят в силу. Не так давно глава NVIDIA Дженсен Хуанг (Jensen Huang) жёстко раскритиковал запрет на поставки ускорителей NVIDIA в Китай, а на днях объявил, что администрация Трампа снова разрешила их поставку в страну. Правда, три месяца запретов не помешали китайским дистрибьюторам довольно свободно продавать B200, H100 и H200, а также другие ускорители, ввоз которых в КНР запрещён. В NVIDIA подчёркивают, что доказательства причастности производителей к контрабанде отсутствуют, а использование чипов с чёрного рынка вообще неэффективно, поскольку для них нужна официальная поддержка. Решения на базе B200 пользуются повышенным спросом из-за их относительной простоты и высокой производительности.

Источник изображения: Christian Lue/unsplash.com Тем не менее попавшие, в руки журналистов документы свидетельствуют о том, что компания из провинции Аньхой, название которой переводится как Gate of the Era («Врата эпохи»), была основана в феврале 2025 года шанхайской бизнес-группой. Чипы продавались в составе готовых платформ с восемью B200, необходимым ПО и вспомогательным оборудованием. Текущая рыночная цена — $489 тыс. за единицу — примерно на 50 % больше, чем в США. С середины мая компания получила как минимум две партии стоек по несколько сотен штук, продано оборудования на сумму около $400 млн. Крупнейшим акционером бизнеса является китайская ИИ-компания China Century (Huajiyuan). Судя по сайту последней, у неё есть даже офис в Кремниевой долине и узел цепочки поставок в Сингапуре, а также более 100 деловых партнёров, включая AliCloud, ByteDance Huoshan Cloud и Baidu Cloud, хотя представители некоторых бизнесов опровергают факт сотрудничества. В самой China Century сообщают, что занимаются умными городами и никаких чипов NVIDIA не закупали. Как показало расследование The Financial Times, многие решения, проданные Gate of the Era и другими китайскими дистрибьюторами за последние месяцы, были произведены Supermicro, Dell и Asus. Правда, предполагать причастность производителей к контрабанде оснований нет. По словам одного из китайских ЦОД, экспортный контроль США не эффективен и лишь даёт огромные прибыли посредникам, готовым рисковать. Некоторые китайские поставщики открыто предлагают стойки B200 в социальных сетях и даже предлагают протестировать их. А некоторые компании уже рекламируют грядущие поставки B300, которые должны появиться к концу года.

Источник изображения: Gene Brutty/unsplash.com Конечно, экспортный контроль США не мог не повлиять на структуру рынка ускорителей. Доходит до того, что многие китайские компании пользуются услугами облачных посредников из третьих стран, которым разрешено покупать ускорители. Впрочем, эксперты ожидают, что возобновление продаж H20 в КНР приведёт к их массовой закупке, хотя они и значительно слабее B200. По данным дистрибуторов, продажи B200 и других чипов упали после объявления об ослаблении запрета на H20. Впрочем, утверждается, что спрос на передовые продукты всегда будет. По словам отраслевых экспертов, китайский бизнес активно скупал «запрещённые» чипы в странах Юго-Восточной Азии. Министерство торговли США уже обсуждает возможность ограничить экспорт в страны вроде Таиланда. Малайзия ужесточила экспортный контроль, ограничив возможность перепродажи передовых ИИ-чипов другим страна, в первую очередь — в Китай. Впрочем, даже если эти лазейки закроют, китайские отраслевые эксперты уверены, что появятся новые маршруты поставок. Более того, они якобы уже начались через европейские страны, не попадающие под экспортные ограничения. По словам одного из дистрибуторов, история уже не раз доказывала, что, с учётом огромной прибыли, посредники всегда найдут способ обойти ограничения.

25.07.2025 [17:41], Сергей Карасёв

SoftBank развернула крупнейшую в мире ИИ-платформу на базе NVIDIA DGX B200Японский холдинг SoftBank объявил о расширении вычислительной ИИ-инфраструктуры на платформе NVIDIA DGX SuperPOD: развёрнуты системы DGX B200, насчитывающие в общей сложности 4 тыс. ускорителей поколения Blackwell. О планах SoftBank по созданию первого в мире ИИ-суперкомпьютер на базе NVIDIA DGX B200 стало известно в конце прошлого года. Вычислительная система использует интерконнект Quantum-2 InfiniBand и поддерживается программной платформой NVIDIA AI Enterprise. Холдинг SoftBank изначально внедрил DGX SuperPOD с более чем 2 тыс. ускорителями поколения NVIDIA Ampere в сентябре 2023 года: на тот момент производительность достигала 0,7 Эфлопс на операциях ИИ (точность вычислений не раскрывается). В октябре 2024 года завершился первый этап модернизации, в ходе которого были добавлены 4000 ускорителей семейства NVIDIA Hopper. В результате, суммарное быстродействие поднялось до 4,7 Эфлопс. После установки DGX B200 показатель вырос до 13,7 Эфлопс. Отмечается, что на сегодняшний день новая вычислительная инфраструктура SoftBank является крупнейшей в мире ИИ-платформой на основе DGX B200. При этом в общей сложности задействованы свыше 10 тыс. ускорителей. Изначально систему будет использовать SB Intuitions Corp. — дочерняя структура SoftBank, которая специализируется на разработке собственных больших языковых моделей (LLM), адаптированных для Японии. SB Intuitions уже создала LLM с примерно 460 млрд параметров, а в текущем 2025 финансовом году, который заканчивается 31 марта 2026-го, компания планирует представить коммерческую ИИ-модель Sarashina mini с 70 млрд параметров. Нужно отметить, что ранее SoftBank и OpenAI объявили о формировании совместного предприятия SB OpenAI для развития корпоративных ИИ-сервисов в Японии. Кроме того, SoftBank участвует в мегапроект Stargate — это совместное предприятие с OpenAI и Oracle по развитию ИИ-инфраструктуры в США. Предполагается, что суммарные затраты на реализацию Stargate достигнут $500 млрд. Впрочем, пока проект продвигается с большим трудом.

23.07.2025 [15:46], Руслан Авдеев

Илон Маск объявил, что ИИ-суперкомпьютер xAI Colossus 2 запустят в ближайшие неделиОснователь ИИ-стартапа xAI Илон Маск (Elon Musk) поделился в социальной сети X информацией о будущем второго кампуса ЦОД в Мемфисе (Теннесси). В числе прочего он объявил намерении запустить в эксплуатацию суперкомпьютер Colossus 2 в ближайшие недели, сообщает Commercial Appeal. По его словам, Colossus 2 получит 550 тыс. ИИ-ускорителей. Компания располагает в городе двумя кампусами — Colossus 1 и Colossus 2. Первый расположен на территории бывшего завода Electrolux и включает 230 тыс. укорителей, в том числе 30 тыс. NVIDIA GB200. Система используется только для обучения, инференс осуществляется в облаках партнёров xAI. Второй кампус, Colossus 2 на площадке Тулейн-роуд (Tulane Road), на первом этапе получит 110 тыс. GB200 и GB300, что потребует 170 МВт энергии. Он должен начать работу в течение нескольких недель. Сроки развёртывания оставшихся 440 тыс. ускорителей не определены, поскольку поставки NVIDIA GB300 задерживаются. В феврале дочерняя структура xAI, компания CTC Property, купила более 75 га вдоль Тулейн-роуд за $70,9 млн. С тех пор, как xAI объявил о планах довести количество ускорителей Colossus до 1 млн, всё чаще возникает вопрос, как именно компания намерена снабжать свой проект энергией. В мае Маск объявил, что Colossus 2 станет первым гигаваттным ИИ-кластером. 15 июля в xAI подтвердили, что компания работает с Memphis Light, Gas and Water (MLGW) и Tennessee Valley Authority (TVA) над обеспечением объекта питанием. MLGW подтвердила, что у неё есть договор на поставку 500 кВт объекту xAI на Тулейн-роуд. А 16 июля MXZ Tech LLC, дочерняя компания xAI, приобрела территорию бывшей электростанции Duke Energy (46 га) неподалёку от кампуса Colossus 2. Этот объект сохранил подключение к энергосети TVA. Кроме того, кампус Colossus 2 уже получил 168 модулей Tesla Megapacks. По-видимому, этот кампус тоже не обойдётся без газовых турбин, и использование которых для питания Colossus 1 вызвало недовольство местных экоактививстов NAACP и SELC. Впрочем, пока непонятно, состоится ли серьёзное разбирательство. Совсем недавно Илон Маск сообщил о намерении ввести в эксплуатацию эквивалент 50 млн NVIDIA H100 в течение пяти лет — это ответ на недавнее заявление OpenAI о намерении освоить более 1 млн ускорителей к концу текущего года, а в будущем получить в своё распоряжение 100 млн ускорителей. Сейчас xAI намерена найти ещё $12 млрд на закупку ускорителей.

20.07.2025 [14:26], Сергей Карасёв

NVIDIA приступила к производству ИИ-ускорителей GB300Компания NVIDIA, по сообщению DigiTimes, приступила к ограниченному производству суперчипов Grace Blackwell GB300 для ресурсоёмких ИИ-нагрузок. Ожидается, что поставки изделия будут организованы в сентябре с постепенным наращиванием объёмов выпуска. Решение GB300 представляет собой связку из Arm-процессора Grace с 72 ядрами Neoverse V2 и двух чипов Blackwell Ultra. В оснащение входят 288 Гбайт памяти HBM3E с пропускной способностью до 8 Тбайт/с. Ускоритель GB300 является основой стоечной системы GB300 NVL72, которая насчитывает 36 чипов Grace и 72 процессора Blackwell Ultra. ИИ-производительность такого комплекса достигает 720 Пфлопс на операциях FP8/FP6. «На данном этапе серьёзных проблем с GB300 нет. Поставки должны идти гладко со II половины года», — подчеркнули представители одного из ODM-производителей.

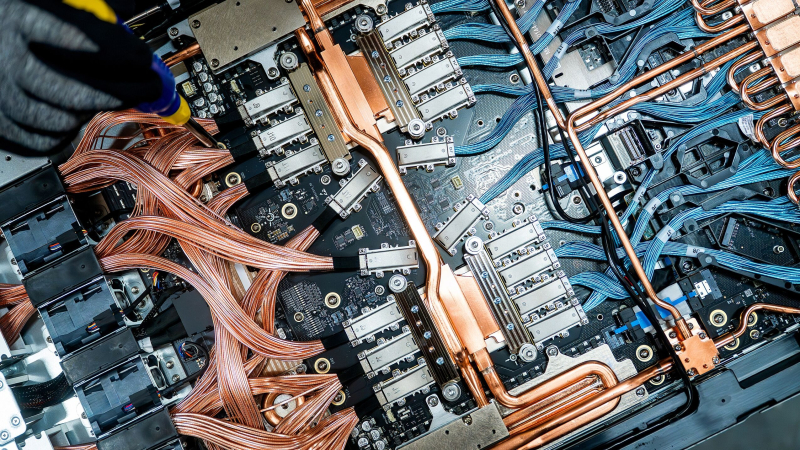

Источник изображения: NVIDIA Вместе с тем, как отмечается, сохраняется высокий спрос на ускорители GB200. Заказчики продолжают закупать эти изделия, несмотря на сложности с охлаждением. Огромная вычислительная мощность и повышенная плотность компоновки серверов обусловили необходимость применения жидкостных систем отвода тепла. Однако при этом возникли проблемы протечек. Оказалось, что во многих случаях это связано с быстроразъёмными соединениями, которые не всегда удовлетворяют нужным требованиям — даже после стресс-тестирования на заводе. ODM-производители отмечают, что реальные условия эксплуатации сильно различаются по давлению воды и конструкции трубопроводов, что затрудняет полное исключение протечек. Послепродажное обслуживание требует значительных временных и финансовых затрат. В случае GB200 основные сложности были обусловлены переходом от архитектуры Hopper к Blackwell, что привело к комплексным изменениям на уровне платформы. С другой стороны, GB300 использует существующую инфраструктуру, а поэтому, как ожидается, серьёзных проблем при выпуске и поставках этих изделий не возникнет. ODM-производители, которые в настоящее время активно тестируют GB300, говорят об обнадёживающих результатах. Предполагается, что переход пройдёт гладко: массовые поставки запланированы на III квартал с увеличением объёмов выпуска в последней четверти текущего года. Новые вызовы может создать появление ускорителей следующего поколения семейства Rubin, которые придут на смену Blackwell Ultra во II половине 2026 года. Эта платформа предполагает использование чиплетов и полностью новой стойки Kyber (для VR300 NVL 576), которая заменит нынешнюю конструкцию Oberon. Плотность компоновки возрастёт до 600 кВт на стойку, что потребует ещё более надёжных систем охлаждения. Отмечается, что применение СЖО станет обязательным для суперускорителей Rubin. Вместе с тем с восстановлением производства ослабленных ускорителей H20, которые США вновь разрешили поставлять в Китай, возможны проблемы. Как передаёт Reuters со ссылкой на The Information, TSMC успела переключить производственные линии, которые использовались для H20, на выпуск других продуктов. Полное восстановление производства H20 может занять девять месяцев.

16.07.2025 [08:58], Руслан Авдеев

Разработка AWS собственной СЖО для NVIDIA GB200 NVL72 привела к падению акций VertivГиперскейлер Amazon Web Services (AWS) разработал собственную систему охлаждения для последнего поколения ускорителей NVIDIA. Ранее в этом месяце облачный гигант начал внедрение систем UltraServer на основе NVIDIA GB200 NVL72, поэтому переход на жидкостное охлаждение стал необходим, сообщает Datacenter Dynamics. Вице-президент AWS Дэвид Браун (David Brown) заявил, что для поддержки «невероятных вычислительных мощностей» стойкам GB200 NVL72 пришлось перейти на СЖО. По его словам, ранее компания обходилась воздушным охлаждением, речь идёт о первом масштабном внедрении жидкостных систем в AWS. При этом AWS рассматривала возможность обратиться к сторонним разработчикам СЖО, но решила отказаться от идеи, поскольку она потребовала бы строительства полностью новых ЦОД, рассчитанных на такие системы охлаждения. Это привело бы к задержкам внедрения на несколько лет. Альтернативой были полностью готовые решения для жидкостного охлаждения, но они не подходили из-за проблем с масштабируемостью: занимали слишком много места в ЦОД, требовали значительных переделок инфраструктуры или значительно увеличивали расход воды. Вместо этого компания разработала собственный теплообменник In Row Heat Exchanger (IRHX), который можно использовать без серьёзных изменений существующей инфраструктуры. IRHX состоит из блока распределения теплоносителя, насосного блока и теплообменников с вентиляторами. Охлаждающая жидкость к водоблокам, совместно разработанным AWS и NVIDIA. IRHX легко масштабируется, позволяя по необходимости убирать или добавлять внутренние теплообменники. Ранее AWS похвасталась, что у неё ушло четыре месяца на переход от набросков к первому прототипу прототипам и ещё 11 месяцев — на переход к массовому производству. AWS не впервые разрабатывает собственное оборудование. Компания имеет собственные чипы семейств Graviton, Tranium и Inferentia, а в прошлом году она представила серию решений для дата-центров для обеспечения выполнения связанных с ИИ задач нового поколения. После новости об использовании AWS собственных решений, акции Vertiv, поставляющей различные системы охлаждения для ЦОД, упали в цене. По данным Bloomberg Intelligence, разработки Amazon могут негативно сказаться на перспективах роста бизнеса Vertiv, поскольку она является крупным клиентом компании. Около 10 % всех продаж Vertiv связаны с жидкостным охлаждением.

11.07.2025 [09:09], Сергей Карасёв

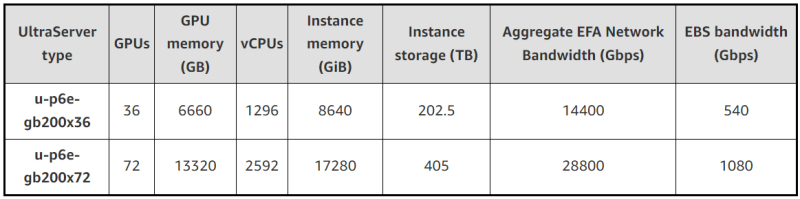

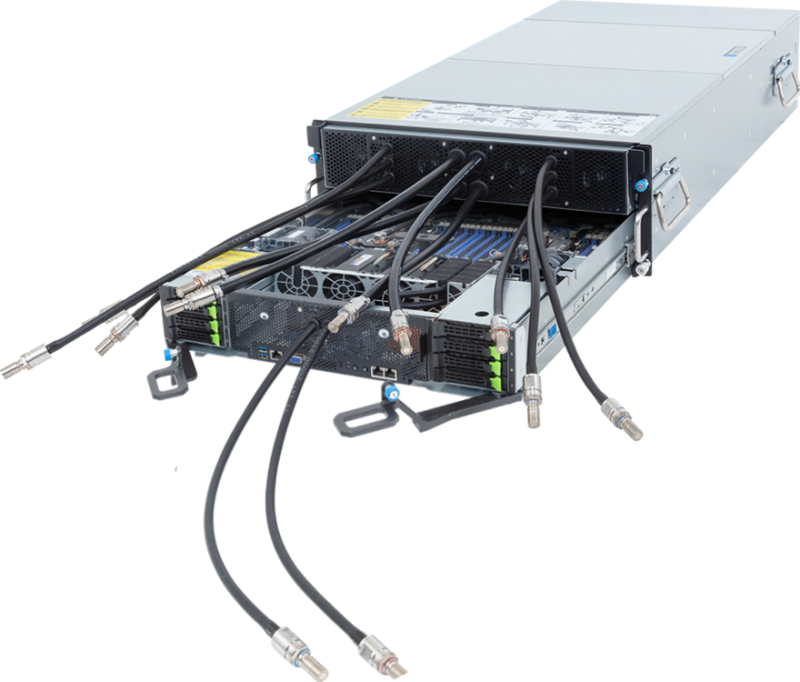

В облаке AWS появились инстансы EC2 P6e-GB200 UltraServer на базе ИИ-суперускорителей NVIDIA GB200 NVL72Облачная платформа AWS объявила о доступности высокопроизводительных инстансов EC2 P6e-GB200 UltraServer, рассчитанных на наиболее ресурсоёмкие нагрузки ИИ. В основу экземпляров положены суперускорители NVIDIA GB200 NVL72. Система GB200 NVL72 объединяет в одной стойке 18 узлов 1U, каждый из которых содержит два ускорителя GB200, что даёт в общей сложности 72 чипа B200 и 36 процессоров Grace. Задействована шина NVLink 5. Инстансы u-p6e-gb200-x72 предоставляют доступ к 72 чипам поколения Blackwell в одном домене NVLink, включая примерно 13,4 Тбайт памяти HBM3e. Производительность в режиме FP8 достигает 360 Пфлопс. Количество vCPU составляет до 2592, объём памяти — до 17 280 ГиБ. Кроме того, предоставляется до 405 Тбайт пространства для хранения данных. Используются адаптеры AWS Elastic Fabric Adapter (EFAv4) с низкой задержкой, агрегированной скоростью передачи данных 28,8 Тбит/с и поддержкой NVIDIA GPUDirect RDMA. Пропускная способность EBS достигает 1080 Гбит/с. Также доступны u-p6e-gb200-x36 с вдвое меньшими характеристиками.

Источник изображений: AWS Применяется система AWS Nitro, которая переносит функции виртуализации, хранения и сетевые операции на выделенное оборудование и ПО для повышения производительности и улучшения безопасности. Инстансы EC2 P6e-GB200 UltraServer объединяются в кластеры EC2 UltraCluster, что обеспечивает возможность безопасного и надёжного масштабирования до десятков тысяч ускорителей. AWS отмечает, что новые экземпляры подходят для работы с передовыми ИИ-моделями, насчитывающими триллионы параметров. При этом может использоваться сочетание экспертных и рассуждающих моделей. После резервирования ёмкости стоимость за инстанс списывается авансом, и цена не меняется после оплаты.

06.07.2025 [23:08], Сергей Карасёв

Giga Computing представила ИИ-серверы на базе NVIDIA HGX B200 с воздушным и жидкостным охлаждениемКомпания Giga Computing, подразделение Gigabyte, представила серверы G4L3-SD1-LAX5, G4L3-ZD1-LAX5, G894-AD1-AAX5 и G894-SD1-AAX5 для приложений ИИ, инференса и других ресурсоёмких нагрузок. В основу новинок положена платформа NVIDIA HGX B200 в конфигурации 8 × SXM. Модель G4L3-SD1-LAX5 типоразмера 4U оснащена системой прямого жидкостного охлаждения (DLC) с отдельными зонами CPU и GPU. Допускается установка двух процессоров Intel Xeon Sapphire Rapids или Xeon Emerald Rapids с показателем TDP до 385 Вт. Предусмотрены 32 слота для модулей DDR5-5600, восемь фронтальных отсеков для SFF-накопителей (NVMe/SATA), а также два коннектора для SSD типоразмера M.2 2280/22110 (PCIe 3.0 x2 и PCIe 3.0 x1). Доступны восемь разъёмов для однослотовых карт расширения FHHL PCIe 5.0 x16 и четыре разъёма для карт FHHL PCIe 5.0 x16 двойной ширины. В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на базе Intel X710-AT2 и выделенный сетевой порт управления 1GbE. Питание обеспечивают восемь блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Диапазон рабочих температур простирается от +10 до +35 °C. Вариант G4L3-ZD1-LAX5 рассчитан на два чипа AMD EPYC 9004 (Genoa) или EPYC 9005 (Turin) с TDP до 500 Вт. Этот сервер также выполнен в формате 4U и оборудован DLC-охлаждением. Есть 24 слота для модулей DDR5-6400, восемь фронтальных отсеков для SFF-накопителей NVMe и два внутренних коннектора для SSD стандартов M.2 2280/22110 (PCIe 3.0 x4 и PCIe 3.0 x1). Прочие характеристики аналогичны предыдущей модели. Двухпроцессорные серверы G894-AD1-AAX5 и G894-SD1-AAX5 типоразмера 8U наделены воздушным охлаждением, включая 15 вентиляторов диаметром 80 мм в зоне GPU. Вариант G894-AD1-AAX5 поддерживает установку чипов Intel Xeon 6900 с показателем TDP до 500 Вт и 24 модулей DDR5 (RDIMM-6400 или MRDIMM-8800). Модификация G894-SD1-AAX5, в свою очередь, рассчитана на процессоры Intel Xeon 6700/6500 с TDP до 350 Вт и 32 модуля DDR5 (RDIMM-6400 или MRDIMM-8000). Оба сервера оборудованы двумя портами 10GbE (Intel X710-AT2), сетевым портом управления 1GbE, контроллером ASPEED AST2600, восемью фронтальными отсеками для SFF-накопителей NVMe, двумя коннекторами M.2 2280/22110 (PCIe 5.0 x4 и PCIe 5.0 x2). Имеются восемь разъёмов для карт расширения FHHL PCIe 5.0 x16 одинарной ширины и четыре разъёма для карт FHHL PCIe 5.0 x16 двойной ширины. Установлены 12 блоков питания мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Серверы могут эксплуатироваться при температурах от +10 до +30 °C.

02.07.2025 [08:35], Руслан Авдеев

Arm-чипы захватывают рынок, но до доминирования в ЦОД им пока далекоСерверы на базе Arm-чипов стремительно набирают популярность — в 2025 году их поставки должны вырасти на 70 %. Тем не менее, этого не хвататит, чтобы к концу года добиться планируемого Arm Holdings охвата рынка в 50 %, сообщает The Register. Аналитики IDC утверждают, что Arm-серверы пользуются массовым спросом в основном благодаря стоечным системам вроде NVIDIA GB200 NVL72. В новейшем отчёте Worldwide Quarterly Server Tracker эксперты IDC подсчитали, что в текущем году на Arm-серверы придётся 21,1 % от общего объёма мировых поставок. Ожидается, что поставки серверов с хотя бы одним ИИ-ускорителем вырастут на 46,7 %, на них придётся в текущем году около половины рыночной стоимости. Всего за три года, по оценкам IDC, рынок серверов должен вырасти втрое благодаря гиперскейлерам и облачным провайдерам. В целом рынок серверов достиг в I квартале 2025 года $95,2 млрд, увеличившись год к году на 134,1 %. В результате IDC повысила прогноз на год до $366 млрд, на 44,6 % выше год к году — исторический максимум для данного сегмента. При этом поставки «стандартных» x86-серверов должны вырасти в 2025 году на 39,9 % до $283,9 млрд. При этом доля AMD непрерывно растёт. Сегмент альтернативных систем вырастет на 63,7 % год к году, а их общий прогнозируемый объём составит $82 млрд. По прогнозам IDC, наибольший рост, на 59,7 % год к году ожидается в США. К концу 2025 года на данный рынок будет приходиться почти 62 % общей выручки от продаж серверов. Ещё одной точкой роста является Китай. IDC прогнозирует рост на 39,5 % — более 21 % квартального дохода во всём мире. Регионы EMEA и Латинская Америка могут рассчитывать на 7 % и 0,7 % соответственно, а Канаду, вероятно, ожидает спад на 9,6 % из-за некой «очень крупной сделки» 2024 года. В IDC подчёркивают, что спрос на большие вычислительные мощности для ИИ, вероятно, сохранится — эволюция от старых чат-ботов к рассуждающим моделям и агентному ИИ потребует роста производительности на несколько порядков, особенно для инференса.

24.06.2025 [11:42], Сергей Карасёв

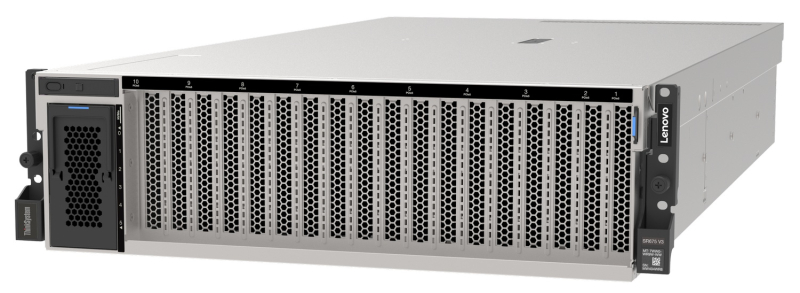

Lenovo анонсировала новые системы для дата-центров, оптимизированные для ИИКомпания Lenovo анонсировала новые гибридные платформы, оптимизированные для решения ресурсоёмких ИИ-задач в дата-центрах. Представлены системы различного уровня, созданные в партнёрстве с NVIDIA, Cisco и IBM. В частности, дебютировала модель ThinkSystem SR680a V4 на аппаратной платформе Intel. Полностью характеристики платформы не раскрываются. Известно, что применены процессоры семейства Xeon 6, в которое входят изделия на основе энергоэффективных E-ядер (Sierra Forest) и производительных P-ядер (Granite Rapids). Система несёт на борту восемь ускорителей NVIDIA Blackwell B200, а также восемь карт NVIDIA SuperNIC и NVIDIA BlueField-3 DPU. Утверждается, что по сравнению с серверами предыдущего поколения модель ThinkSystem SR680a V4 обеспечивает семикратный рост вычислительной производительности, тогда как объём памяти увеличился в четыре раза. Скорость инференса при работе с большими языковыми моделями (LLM) поднялась приблизительно в 11 раз. Кроме того, Lenovo представила ИИ-систему Hybrid AI на платформе IBM watsonx. В основу этого решения положены серверы Lenovo ThinkSystem SR675 (V3), оснащённые системой жидкостного охлаждения Neptune. Ещё одна система Lenovo Hybrid AI создана в партнёрстве с Cisco: она объединяет коммутаторы Cisco Nexus с технологией NVIDIA Spectrum-X для ускорения развёртывания ИИ-фабрик на предприятиях. Задействован сервер ThinkSystem SR675 V3, который может содержать до восьми ускорителей NVIDIA RTX Pro 6000 Blackwell Server Edition. Говорится о поддержке карт NVIDIA SuperNIC и NVIDIA BlueField-3 DPU. Платформа призвана ускорить переход организаций от ИИ-вычислений на базе CPU к средам на основе GPU.

29.05.2025 [13:18], Руслан Авдеев

Перегрев, протечки и нестабильность затормозили массовый выпуск NVIDIA GB200 NVL72, но теперь все проблемы решеныПоставщики ИИ-серверов на базе NVIDIA GB200 NVL72, включая Dell, Foxconn, Inventec и Wistron, увеличили выпуск серверов. Для этого им пришлось решить ряд технических проблем, которые ранее привели к задержкам поставок продуктов клиентам, сообщает The Financial Times. Компании совершили «серии прорывов», что позволило им начать своевременные поставки серверов GB200 NVL72. Как сообщил один из инженеров неназванного производственного партнёра NVIDIA, внутренние тесты выявили «проблемы с подключением» в серверах, но поставщики организовали совместную работу с NVIDIA, и вопрос был решён два или три месяца назад. Впрочем, это не первая проблема с чипами семейства Blackwell. В конце 2024 года стало известно о перегреве суперускорителей NVL72. По слухам, разработчику чипов пришлось просить производителей внести немало изменений в эталонный вариант стоек, чтобы решить проблему. Также поступала информация о проблемах межчипового интерконнекта, программных багах и протечках охлаждающих жидкостей. В результате поставщикам пришлось увеличить число протоколов проверки — оборудование стали тестировать намного внимательнее перед поставками клиентам. При этом производителям уже нужно готовиться к выпуску систем на базе GB300. NVIDIA GB300 NVL72 всё так же использует полностью жидкостное охлаждение. Суперускоритель оснащён 72 чипами Blackwell Ultra и 36 процессорами Grace. В продажу решение должно поступить в III квартале 2025 года.

Источник изображения: NVIDIA Впрочем, как сообщают журналисты, чтобы ускорить внедрение GB300-серверов, NVIDIA отказалась от более совершенного дизайна платы Cordelia позволявшего заменять отдельные компоненты, в пользу текущей версии Bianca, применяемой для GB200. Это решение может усложнить ремонт, но ускорит развёртывание систем. По словам трёх источников, знакомых с вопросом, NVIDIA сообщила поставщикам, что намерена перейти дизайн Cordelia в следующем поколении ИИ-продуктов. |

|