Материалы по тегу: hpc

|

20.03.2024 [15:25], Руслан Авдеев

BNY Mellon стал первым транснациональным банком, внедрившим ИИ-суперкомпьютер NVIDIA на базе DGX SuperPOD H100Банк Bank of New York Mellon Corporation (BNY Mellon) стал первой структурой подобного профиля и масштаба, приступившей к внедрению собственного ИИ-суперкомпьютера на основе систем NVIDIA. Банку получил кластер DGX SuperPOD из нескольких десятков систем DGX H100, объединённых интерконнектом NVIDIA InfiniBand. Основанный в 2007 году в результате слияния The Bank of New York и Mellon Financial Corporation банк намерен использовать новый суперкомпьютер вкупе с NVIDIA AI Enterprise для создания и внедрения ИИ-приложений и управления ИИ-инфраструктурой своего бизнеса. Банк уже использует более 20 ИИ-решений, в том числе для прогнозирования в сфере депозитов, автоматизации платежей, предиктивной торговой аналитики и т.д. Всего же компания нашла более 600 вариантов использования ИИ в своей банковской системе. Как заявляют в руководстве BNY Mellon, внедрение ИИ-суперкомпьютера увеличит возможности по обработке данных и запуску ИИ-проектов, помогающих управлять активами клиентов и обеспечивать их защиту. Компания пока не сообщила, где будет расположен суперкомпьютер и его полные характеристики. Ранее банку принадлежал дата-центр в Нью-Джерси, также он управлял IT-объектами в Пенсильвании и Теннесси.

19.03.2024 [22:37], Сергей Карасёв

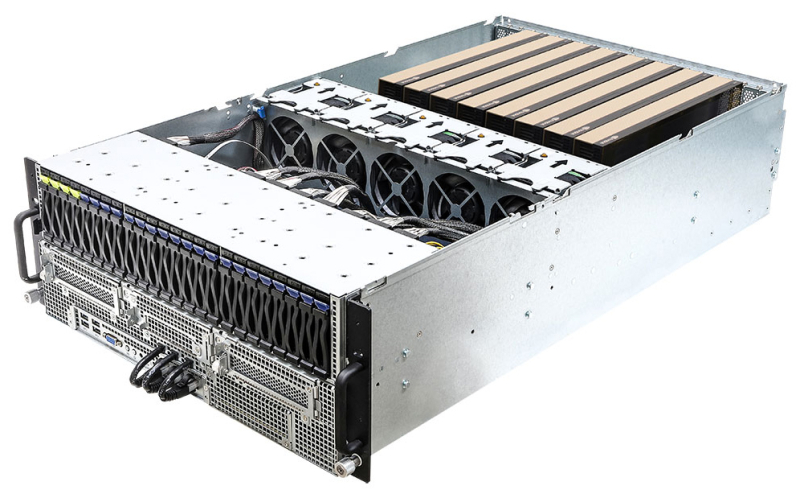

HPE выпустила локальный суперкомпьютер для генеративного ИИКомпания HPE сообщила о доступности модульной суперкомпьютерной системы для генеративного ИИ. Платформа, предназначенная для локального размещения в инфраструктуре заказчика, построена на суперчипах NVIDIA GH200 Grace Hopper. О подготовке системы HPE заявила в ноябре 2023 года. В её основу положены серверы ProLiant DL380a Gen11. В общей сложности могут быть задействованы до 168 суперчипов GH200. Кроме того, применяются Ethernet-платформа NVIDIA Spectrum-X и DPU NVIDIA BlueField-3. Решение дополнено платформой машинного обучения и аналитическим программным обеспечением HPE, платформой для работы с ИИ-приложениями NVIDIA AI Enterprise 5.0, которая включает микросервисы на базе загружаемых программных контейнеров, а также сервисом NVIDIA NeMo Retriever и другими библиотеками для обработки данных и ИИ. Суперкомпьютерная система ориентирована на крупные предприятия, исследовательские институты и правительственные учреждения. Утверждается, что в конфигурации с 16 узлами комплекс может оптимизировать модель Llama 2 с 70 млрд параметров всего за 6 минут. Высокая производительность позволяет клиентам повысить продуктивность бизнеса с помощью приложений генеративного ИИ, таких как виртуальные помощники, умные чат-боты и средства корпоративного поиска. При этом софт HPE Machine Learning Inference позволит предприятиям быстро и безопасно развертывать масштабные модели машинного обучения. Компания HPE также сообщила о намерении выпустить продукты следующего поколения, использующие аппаратные решения NVIDIA на базе архитектуры Blackwell. Речь идёт о гибридных суперчипах GB200, а также изделиях HGX B200 и HGXB100. Подробности о новых системах будут раскрыты позднее.

19.03.2024 [22:31], Сергей Карасёв

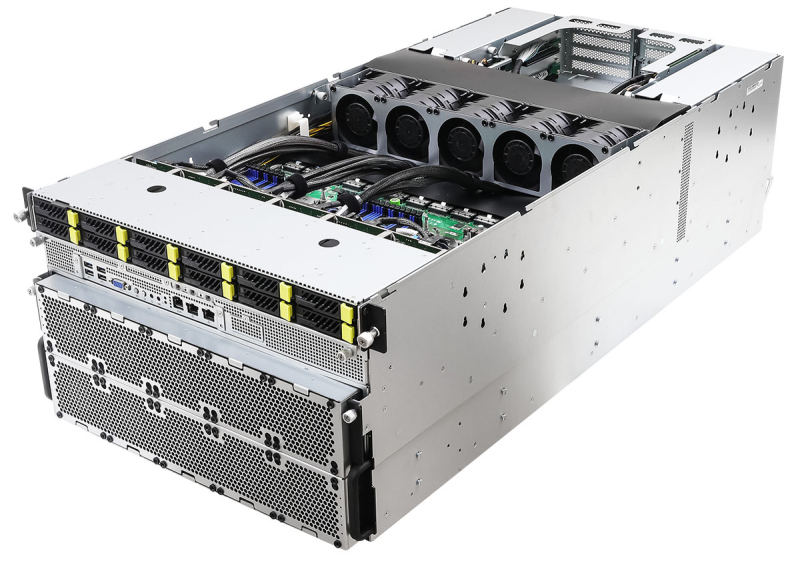

ASRock Rack представила серверы с поддержкой ускорителей NVIDIA Blackwell и HopperКомпания ASRock Rack на конференции GTC 2024 анонсировала свои самые мощные серверы для обучения ИИ-моделей — системы 6U8X-EGS2 NVIDIA H100 и 6U8X-EGS2 NVIDIA H200. Кроме того, дебютировали решения с поддержкой новейших ускорителей NVIDIA Blackwell. Серверы 6U8X-EGS2 NVIDIA H100 и 6U8X-EGS2 NVIDIA H200 выполнены в форм-факторе 6U. Они рассчитаны на установку восьми ускорителей NVIDIA H100 и H200 соответственно. Возможно использование двух процессоров Intel Xeon Sapphire Rapids или Xeon Emerald Rapids с показателем TDP до 350 Вт. Доступны 32 слота для модулей оперативной памяти DDR5-5600, 12 отсеков для SFF-накопителей NVMe с интерфейсом PCIe 5.0 x4 (четыре также имеют поддержку SATA), два коннектора М.2 2280/22110 (PCIe 3.0 x4), восемь слотов HHHL PCIe5.0 x16 и пять слотов FHHL PCIe5.0 x16. Питание обеспечивают восемь блоков мощностью 3000 Вт с сертификатом 80 PLUS Platinum/Titanium. ASRock Rack также представила двухсокетный barebone-сервер 4UMGX с поддержкой восьми ускорителей NVIDIA H100 NVL или H200 в форм-факторе 4U. Система может комплектоваться шестью DPU NVIDIA BlueField-3 или шестью сетевыми адаптерами NVIDIA ConnectX-7. Модель 4UMGX также поддерживает ускорители NVIDIA Blackwell. В основу сервера положена модульная архитектура NVIDIA MGX, предназначенная для создания ИИ-систем на базе CPU, GPU и DPU. Кроме того, дебютировали двухсокетные 4U серверы 4U8G-EGS2, 4U10G-EGS2, 4U8G-GENOA2 и 4U10G-GENOA2. Первые два рассчитаны на чипы Intel Xeon Sapphire Rapids или Xeon Emerald Rapids, два других — на процессоры AMD EPYC 9004 (Genoa). Они могут оснащаться ускорителями NVIDIA H100 NVL и H200 NVL, а в перспективе — NVIDIA Blackwell. Устройства 4U8G поддерживают восемь двухслотовых карт FHFL с интерфейсом PCIe 5.0 x16, решения 4U10G — десять. Intel-системы снабжены 32 слотами для модулей памяти DDR5, AMD-модели — 24-мя. ASRock Rack также готовит суперускоритель GB200 NVL72, серверы с поддержкой конфигурации NVIDIA HGX B200 8-GPU и другие решения на основе аппаратных компонентов NVIDIA.

19.03.2024 [15:06], Сергей Карасёв

Юлихский суперкомпьютерный центр получил 5-кубитную квантовую систему IQMВ июле нынешнего года Юлихский суперкомпьютерный центр в Германии (JSC) намерен ввести в эксплуатацию новый квантовый компьютер — 5-кубитную систему Spark немецко-финского производителя IQM Quantum Computers. Новая система станет частью Унифицированной инфраструктуры квантовых вычислений Юлиха (Jülich UNified Infrastructure for Quantum Computing, JUNIQ). Spark будет работать в тандеме с классическими суперкомпьютерами, что позволит исследователям изучать различные варианты использования гибридных вычислений. Базовая версия IQM Spark стоит менее €1 млн. Система разработана специально для проведения экспериментов, а также для применения в образовательных целях. В этом компьютере кубиты (квантовые биты) генерируются с помощью сверхпроводящих электронных резонансных цепей. Для этого их необходимо охлаждать до температур, близких к абсолютному нулю (-273,15 °C). Платформа IQM Spark отличается гибкими возможностями в плане расширения и подключения, что делает её идеально подходящей для использования в составе инфраструктуры JUNIQ. Отмечается, что квантовые компьютеры способны решать определённые задачи гораздо быстрее, чем это возможно с помощью классических НРС-комплексов. Это может быть, например, моделирование сложных химических реакций и молекул, оптимизация процессов в финансовом секторе и пр. Однако квантовые компьютеры всё ещё находятся на ранней стадии развития. Проект JUNIQ поможет найти новые практические применения концепции гибридных квантово-классических вычислений. IQM развернула локальные квантовые системы в некоторых других университетах и исследовательских институтах, включая Суперкомпьютерный центр Лейбница в Германии (LRZ) и Центр технических исследований VTT в Финляндии.

19.03.2024 [01:02], Сергей Карасёв

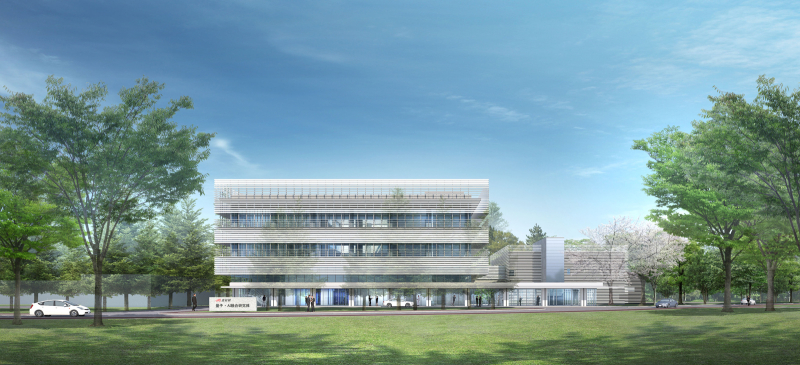

Ускорители NVIDIA H100 лягут в основу японского суперкомпьютера ABCI-Q для квантовых вычисленийКомпания NVIDIA сообщила о том, что её технологии лягут в основу нового японского суперкомпьютера ABCI-Q, предназначенного для проведения исследований в области квантовых вычислений. Платформа, в частности, будет использоваться для тестирования гибридных систем, объединяющих классические и квантовые технологии. Развёртыванием комплекса займётся корпорация Fujitsu. Машина расположится в суперкомпьютерном центре ABCI (AI Bridging Cloud Infrastructure) Национального института передовых промышленных наук и технологий Японии (AIST). Ввод ABCI-Q в эксплуатацию намечен на начало 2025 года. В состав суперкомпьютера войдут более 500 узлов, насчитывающих в общей сложности свыше 2000 ускорителей NVIDIA H100. Говорится о применении интерконнекта NVIDIA Quantum-2 InfiniBand, а также NVIDIA CUDA Quantum — открытой платформы для интеграции и программирования CPU, GPU и квантовых процессоров (QPU). Комплекс ABCI-Q проектируется с прицелом на возможность добавления будущих аппаратных компонентов для квантовых вычислений. Ожидается, что ABCI-Q позволит проводить высокоточное квантовое моделирование в рамках исследовательских проектов в различных отраслях. Учёные смогут тестировать приложения нового типа с целью ускорения их практического внедрения. Кроме того, специалисты смогут прорабатывать передовые алгоритмы для решения специфичных задач. NVIDIA и AIST также планируют сотрудничать при разработке промышленных приложений на базе ABCI-Q. В целом, ABCI-Q является частью стратегии Японии в области квантовых технологий, задачей которой является создание новых возможностей для бизнеса и общества, а также получение выгоды от квантовых технологий, в том числе посредством исследований в области ИИ, энергетики и биологии.

19.03.2024 [01:00], Игорь Осколков

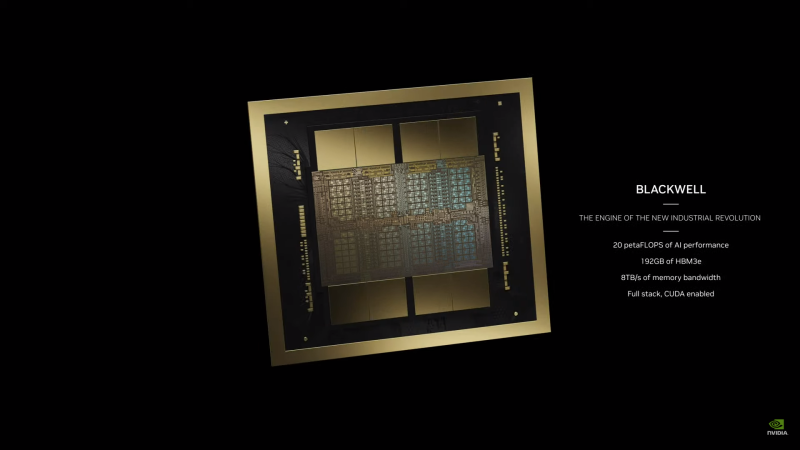

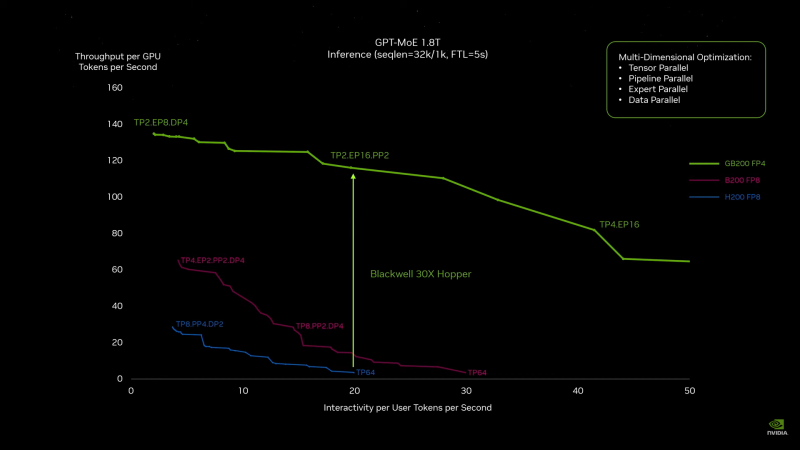

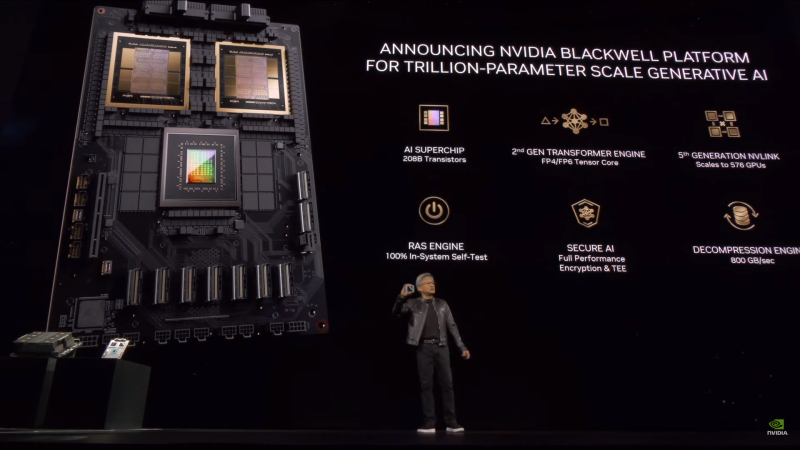

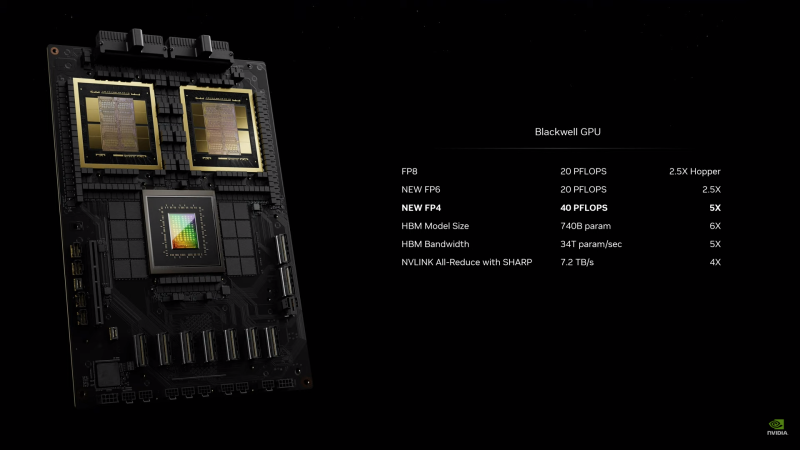

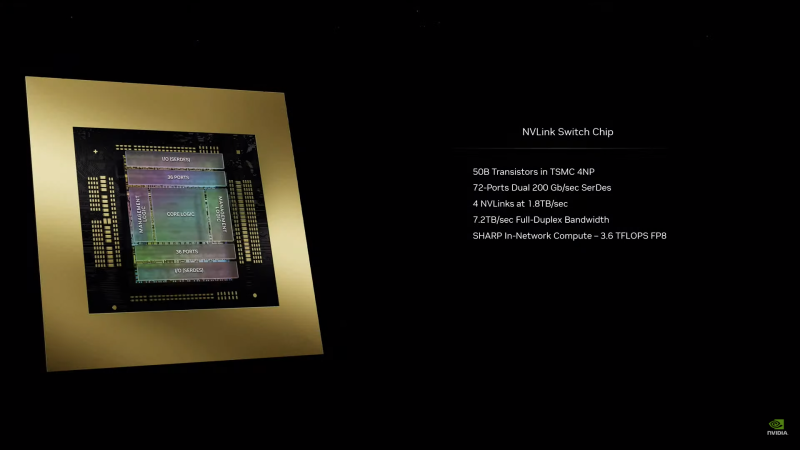

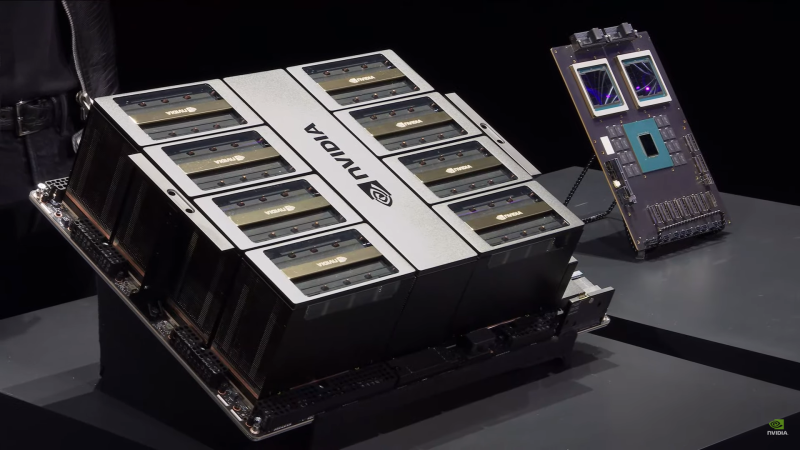

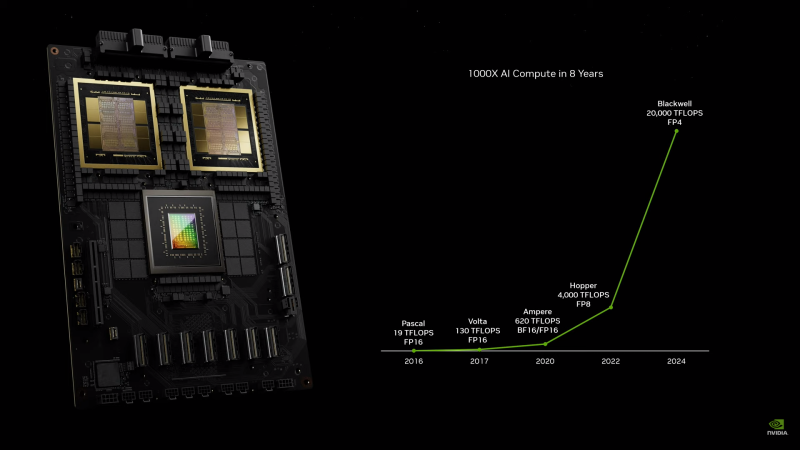

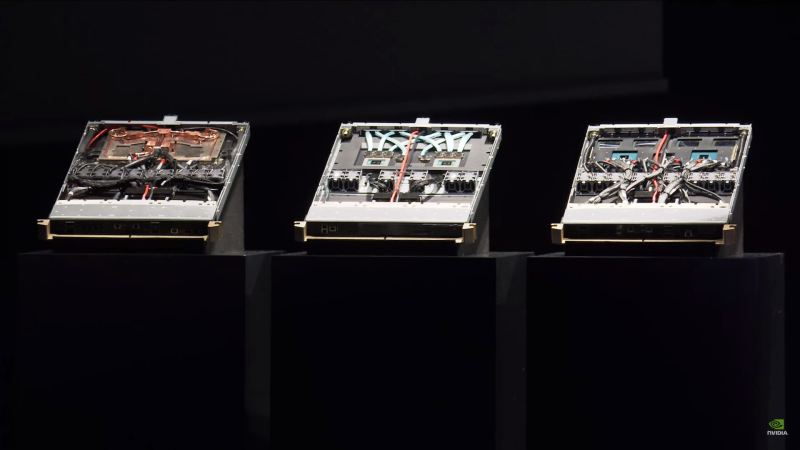

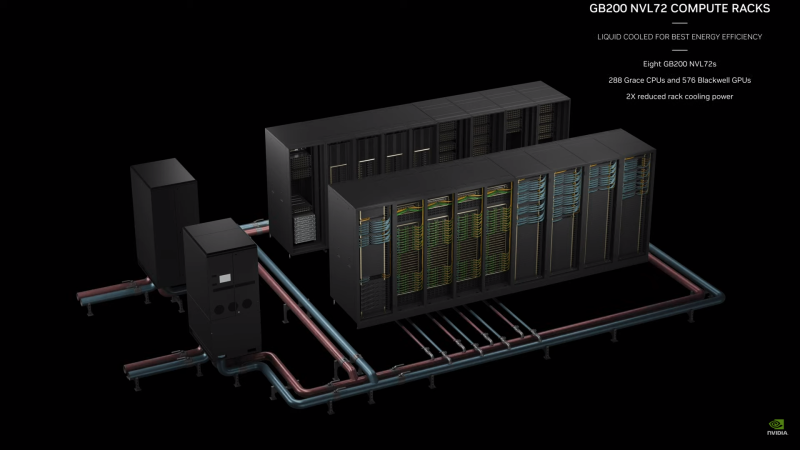

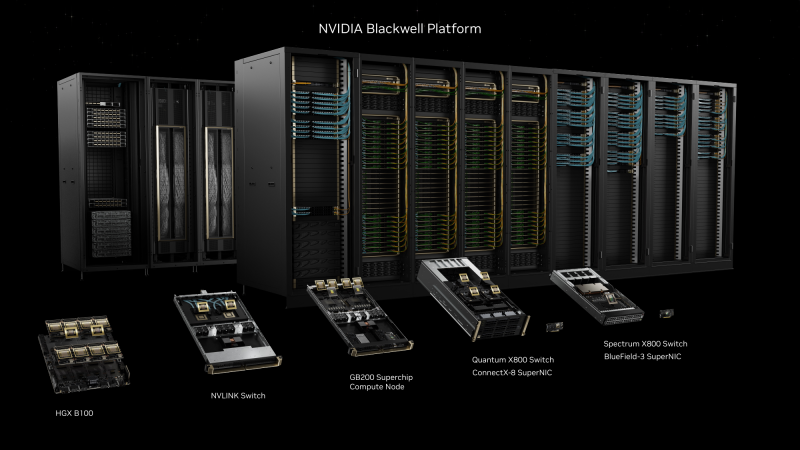

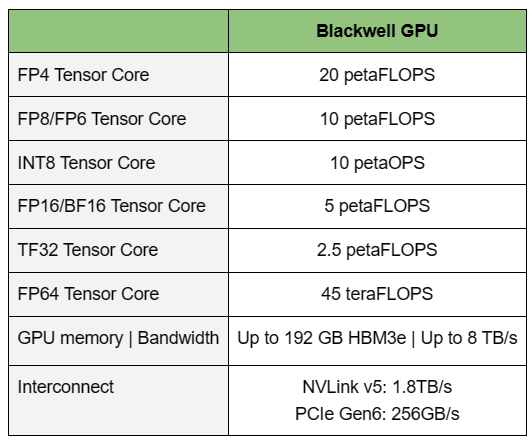

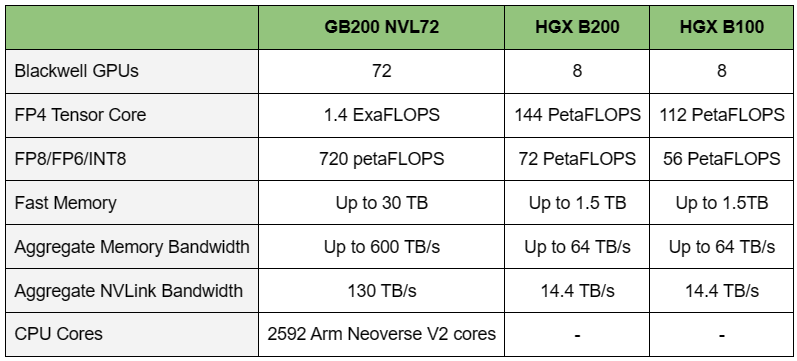

NVIDIA B200, GB200 и GB200 NVL72 — новые ускорители на базе архитектуры BlackwellNVIDIA представила сразу несколько ускорителей на базе новой архитектуры Blackwell, названной в честь американского статистика и математика Дэвида Блэквелла. На смену H100/H200, GH200 и GH200 NVL32 на базе архитектуры Hopper придут B200, GB200 и GB200 NVL72. Все они, как говорит NVIDIA, призваны демократизировать работу с большими языковыми моделями (LLM) с триллионами параметров. В частности, решения на базе Blackwell будут до 25 раз энергоэффективнее и экономичнее в сравнении с Hopper. В разреженных FP4- и FP8-вычислениях производительность B200 достигает 20 и 10 Пфлопс соответственно. Но без толики технического маркетинга не обошлось — показанные результаты достигнуты не только благодаря аппаратным улучшениям, но и программным оптимизациям. Это ни в коей мере не умаляет их важности и полезности, но затрудняет прямое сравнение с конкурирующими решениями. В общем, появление Blackwell стоит рассматривать не как очередное поколение ускорителей, а как расширение всей экосистемы NVIDIA. В Blackwell компания использует тайловую (чиплетную) компоновку — два тайла объединены 2,5D-упаковкой CoWoS-L и на двоих имеют 208 млрд транзисторов, изготовленных по техпроцессу TSMC 4NP. В одно целое со всех точек зрения их объединяет новый интерконнект NV-HBI с пропускной способностью 10 Тбайт/с, а дополняют их восемь стеков HBM3e-памяти ёмкостью до 192 Гбайт с агрегированной пропускной способностью до 8 Тбайт/с. Такой же объём памяти предлагает и Instinct MI300X, но с меньшей ПСП (5,3 Тбайт/с), хотя это скоро изменится. FP8-производительность в разреженных вычислениях у решения AMD составляет 5,23 Пфлопс, но зато компания не забывает и про FP64 в отличие от NVIDIA. Одними из ключевых нововведений, отвечающих за повышение производительности, стали новые Tensor-ядра и второе поколение механизма Transformer Engine, который научился заглядывать внутрь тензоров, ещё более тонко подбирая необходимую точность вычислений, что влияет и на скорость обучения с инференсом, и на максимальный объём модели, умещающейся в памяти ускорителя.  Теперь NVIDIA намекает на то, что обучение можно делать в FP8-формате, а для инференса хватит и FP4. Всё это без потери качества. Но вообще Blackwell поддерживает FP4/FP6/FP8, INT8, BF16/FP16, TF32 и FP64. И только для последнего нет поддержки разреженных вычислений. Дополнительно Blackwell обзавёлся движком для декомпрессии (в первую очередь LZ4, Deflate, Snappy) входящих данных со скоростью до 800 Гбайт/с, что тоже должно повысить производительность, т.к. теперь распаковкой будет заниматься не CPU и, соответственно, ускоритель не будет «голодать». Эта функция рассчитана в основном на Apache Spark и другие системы для аналитики больших данных. Также есть по семь движков NVDEC и NVJPEG. Наконец, NVIDIA упоминает ещё две новых возможности Blackwell: шифрование данных в памяти и RAS-функции. В первом случае речь идёт о защите конфиденциальности обрабатываемых данных, что важно в целом ряде областей. Причём формирование TEE-анклава возможно в рамках группы из 128 ускорителей. MIG-доменов по-прежнему семь. В случае RAS говорится о телеметрии и предиктивной аналитике (естественно, на базе ИИ), которые помогут заранее выявить возможные сбои и снизить время простоя. Это важно, поскольку многие модели могут обучаться неделями и месяцами, так что потеря даже относительно небольшого куска данных крайне неприятна и финансово затратна. Однако всё эти инновации не имеют смысла без возможности масштабирования, поэтому NVIDIA оснастила Blackwell не только интерфейсом PCIe 6.0 (32 линии), который играет всё меньшую роль, но и пятым поколением интерконнекта NVLink. NVLink 5 по сравнению с NVLink 4 удвоил пропускную способность до 1,8 Тбайт/с (по 900 Гбайт/с в каждую сторону), а соответствующий коммутатор NVSwitch 7.2T позволяет объединить до 576 ускорителей в одном домене. SHARP-движки с поддержкой FP8 дополнительно помогут ускорить обработку моделей, избавив ускорители от части работ по предобработке и трансформации данных. Чип коммутатора тоже изготавливается по техпроцессу TSMC N4P и содержит 50 млрд транзисторов. Для дальнейшего масштабирования и формирования кластеров из 10 тыс. ускорителей и более, вплоть до 100 тыс. ускорителей на уровне ЦОД, NVIDIA предлагает 800G-коммутаторы Quantum-X800 InfiniBand XDR и Spectrum-X800 Ethernet, имеющие соответственно 144 и 64 порта. Узлам же полагаются DPU ConnectX-8 SuperNIC и BlueField-3. Правда, последний предлагает только 400G-порты в отличие от первого. От InfiniBand компания отказываться не собирается. С базовыми кирпичиками разобрались, пора переходить к конструированию продуктов. Первым идёт HGX B100, в основе которой всё та же базовая плата с восемью ускорителями Blackwell, точно так же провязанных между собой NVLink 5 с агрегированной скоростью 14,4 Тбайт/с. Для связи с внешним миром предлагается пара интерфейсов PCIe 6.0 x16. HGX B100 предназначена для простой замены HGX H100, поэтому ускорители имеют TDP не более 700 Вт, что ограничивает пиковую производительность в разреженных FP4- и FP8/FP6/INT8-вычислениях до 14 и 7 Пфлопс соответственно, а для всей системы — 112 и 56 Пфлопс соответственно.  У HGX B200 показатель TDP ограничен уже 1 кВт, причём возможность воздушного охлаждения по-прежнему сохраняется. Производительность одного B200 в разреженных FP4- и FP8/FP6/INT8-вычислениях достигает уже 18 и 9 Пфлопс, а для всей системы — 144 и 72 Пфлопс соответственно. DGX B200 повторяет HGX B200 в плане производительности и является готовой системой от NVIDIA, тоже с воздушным охлаждением. В системе используются два чипа Intel Xeon Emerald Rapids. По словам NVIDIA, DGX B200 до 15 раз быстрее в задачах инференса «триллионных» моделей по сравнению с DGX-узлами прошлого поколения. 800G-интерконнект Ethernet/InfiniBand этим трём платформам не достался, только 400G. Основным же строительным блоком сама компания явно считает гибридный суперчип GB200, объединяющий уже имеющийся у неё Arm-процессор Grace сразу с двумя ускорителями Blackwell B200. CPU-часть включает 72 ядра Neoverse V2 (по 64 Кбайт L1-кеша для данных и инструкций, L2-кеш 1 Мбайт), 144 Мбайт L3-кеша и до 480 Гбайт LPDDR5x-памяти с ПСП до 512 Гбайт/с. С двумя B200 процессор связан 900-Гбайт/с шиной NVLink-C2C — по 450 Гбайт/с на каждый ускоритель. Между собой B200 напрямую подключены уже по полноценной 1,8-Тбайт/с шине NVLink 5. Вся эта немаленькая конструкция шириной в половину стойки имеет TDP до 2,7 кВт. 1U-узел с парой чипов GB200, каждый из которых может отъедать до 1,2 кВт, уже требует жидкостное охлаждение. FP4- и FP8/FP6/INT8-производительность (речь всё ещё о разреженных вычислениях) GB200 достигает 40 и 20 Пфлопс. И именно эти цифры NVIDIA нередко использует для сравнения новинок со старыми решениями. 18 узлов с парой GB200 (суммарно 72 шт.) и 9 узлов с парой коммутаторов NVSwitch 7.2T, которые провязывают все ускорители по схеме каждый-с-каждым (агрегированно 130 Тбайт/с, более 3 км соединений), формируют 120-кВт суперускоритель GB200 NVL72 размером со стойку, оснащённый СЖО и единой DC-шиной питания. Всё это даёт до 1,44 Эфлопс в FP4-вычислениях и до 720 Пфлопс в FP8, а также до 13,5 Тбайт HBM3e с агрегированной ПСП до 576 Тбайт/с. Ну а общий объём памяти составляет порядка 30 Тбайт. GB200 NVL72 одновременно является и узлом DGX GB200. Восемь DGX GB200 формируют DGX SuperPOD. Впрочем, будет доступен и SuperPOD попроще, на базе DGX B200. Ускорители B200 появятся в этом году и будут стоить в диапазоне $30–$40 тыс., что ненамного больше начальной цены Hopper в диапазоне $25–$40 тыс. Глава NVIDIA уже предупредил, что Blackwell сразу будут в дефиците. Вероятно, получить доступ к ним проще всего будет в облаках Amazon, Google, Microsoft и Oracle.

16.03.2024 [21:46], Сергей Карасёв

Великобритания рассчитывает снизить стоимость ИИ-инфраструктур в 1000 разАгентство перспективных исследований и инноваций Великобритании (ARIA), по сообщению Datacenter Dynamics, инициировало проект стоимостью приблизительно $53,5 млн, целью которого является «переосмысление парадигмы вычислений». Учёные рассчитывают разработать новые технологии и архитектуры, которые позволят снизить стоимость ИИ-инфраструктур в 1000 раз по сравнению с сегодняшними системами. Стремительный рост востребованности ИИ-приложений и НРС-решений приводит к резкому увеличению нагрузки на дата-центры. Это вынуждает операторов и гиперскейлеров закупать мощные дорогостоящие ускорители, которые оказываются в дефиците. Одновременно растут энергозатраты ЦОД. По оценкам, на дата-центры приходится до 1,5 % мирового потребления электроэнергии и 1 % глобальных выбросов CO2.

Источник изображения: pixabay.com Компании по всему миру предпринимают различные меры по решению проблемы, включая внедрение СЖО и разработку принципиально новых сверхэффекттивных ИИ-чипов. Проект ARIA в данной сфере получил название Scaling Compute — AI at 1/1000th the cost, или «Масштабирование вычислений — ИИ за 1/1000 стоимости». Руководитель проекта Сурадж Брамхавар (Suraj Bramhavar) говорит, что на протяжении более чем 60 лет человечество «извлекало выгоду из экспоненциального увеличения вычислительной мощности при уменьшении затрат». Но, по его словам, такой подход больше не соответствует современным реалиям — особенно в свете повсеместного внедрения ресурсоёмких приложений ИИ. Брамхавар говорит, что специализированные решения, используемые для обучения масштабных ИИ-моделей, невероятно дороги, что может иметь далеко идущие экономические, геополитические и социальные последствия. Например, генеральный директор OpenAI Сэм Альтман ранее заявлял, что обучение GPT-4 обошлось его компании более чем в $100 млн. В рамках нового проекта ARIA будет оказывать финансовую поддержку научным коллективам и компаниям, разрабатывающим перспективные технологии, которые в дальнейшем помогут снизить стоимость ИИ-инфраструктур на порядки. Речь идёт о решениях, сочетающих высокое быстродействие, эффективность и простоту производства. «Природа предоставляет нам, по крайней мере, одно доказательство того, что фундаментально возможно выполнять сложную обработку информации с высокой эффективностью», — отмечает Брамхавар, имея в виду человеческий мозг.

15.03.2024 [23:27], Сергей Карасёв

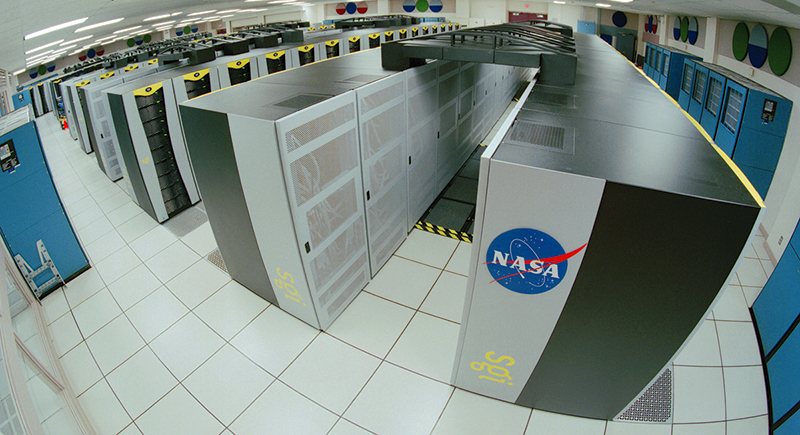

Миссии NASA задерживаются из-за устаревших и перегруженных суперкомпьютеровHPC-инфраструктура NASA нуждается в серьёзной модернизации, поскольку в текущем виде не в состоянии удовлетворить потребности организаций в составе национального управления по аэронавтике и исследованию космического пространства США. К такому выводу, как сообщает The Register, пришло в ходе аудита Управление генерального инспектора. Отмечается, что НРС-инфраструктура NASA морально устарела и не в состоянии эффективно поддерживать современные рабочие нагрузки. Например, в Центре передовых суперкомпьютеров NASA задействованы 18 тыс. CPU и только 48 ускорителей на базе GPU.

Источник изображения: NASA Кроме того, текущих вычислительных мощностей не хватает для всех потребителей. Поэтому некоторые отделы и научные центры NASA вынуждены закупать собственное оборудование и формировать локальную НРС-инфраструктуру. В частности, одна только команда Space Launch System ежегодно тратит на эти цели $250 тыс. вместо того, чтобы подключаться к централизованной системе. Фактически каждое структурное подразделение NASA, за исключением Центра космических полетов Годдарда и Космического центра Стенниса, имеет собственную независимую вычислительную инфраструктуру. Ещё одной причиной развёртывания локальных мощностей является путаница вокруг облачных ресурсов и политики NASA, из-за которой возникают сложности с планированием и оценкой финансовых затрат. Аудит также показал, что есть вопросы к безопасности суперкомпьютерного парка NASA. Например, нет должного мониторинга некоторых систем, доступ к которым имеют иностранные пользователи. В целом, наблюдающаяся картина приводит к задержкам в реализации космических миссий и дополнительным расходам. Для устранения недостатков руководству NASA рекомендовано провести комплексную реформу НРС-сектора, включающую инвентаризацию активов, выявление технологических пробелов и киберрисков. Необходимо также разработать стратегию по улучшению распределения имеющихся вычислительных мощностей.

15.03.2024 [22:50], Сергей Карасёв

Zotac анонсировала GPU-серверы с поддержкой до 10 ускорителейКомпания Zotac объявила о выходе на рынок оборудования корпоративного класса: дебютировали рабочие станции Bolt Tower Workstation башенного типа, а также стоечные GPU-серверы типоразмера 4U и 8U. Устройства рассчитаны на визуализацию данных, обучение ИИ-моделей, моделирование и пр. Новинки получили модульный дизайн, что облегчает замену или установку дополнительных компонентов. Говорится о поддержке различных дистрибутивов Linux корпоративного уровня, включая Red Hat Enterprise Linux, SUSE Linux Enterprise Server, Ubuntu. Продукты разделены на три категории: Essential, Advanced и Premier. В первую входят башенные рабочие станции и серверы 4U, ориентированные на системных интеграторов и предприятия, которым требуется оборудование с оптимальным соотношением цены и производительности. Возможна установка процессоров Intel Xeon Sapphire Rapids и Xeon Emerald Rapids. Системы Bolt Tower Workstation могут нести на борту материнскую плату типоразмера ATX/E-ATX/Micro-ATX/EBB и два блока питания. Возможно развёртывание жидкостного охлаждения. В серию Advanced включены 4U-серверы для более ресурсоёмких приложений. В зависимости от модификации допускается монтаж до 10 ускорителей. Поддерживаются модели в исполнении SXM/OAM. Подсистема питания может быть выполнена по схеме резервирования 4+1 или 2+2. Семейство Premier объединяет наиболее производительные серверы 4U и 8U для самых сложных рабочих нагрузок, таких как большие языковые модели (LLM) и облачный ИИ. Есть до 12 слотов PCIe для высокоскоростных сетевых карт (10 Гбит/с) или DPU. Для некоторых серверов возможно применение процессоров AMD.

12.03.2024 [13:15], Сергей Карасёв

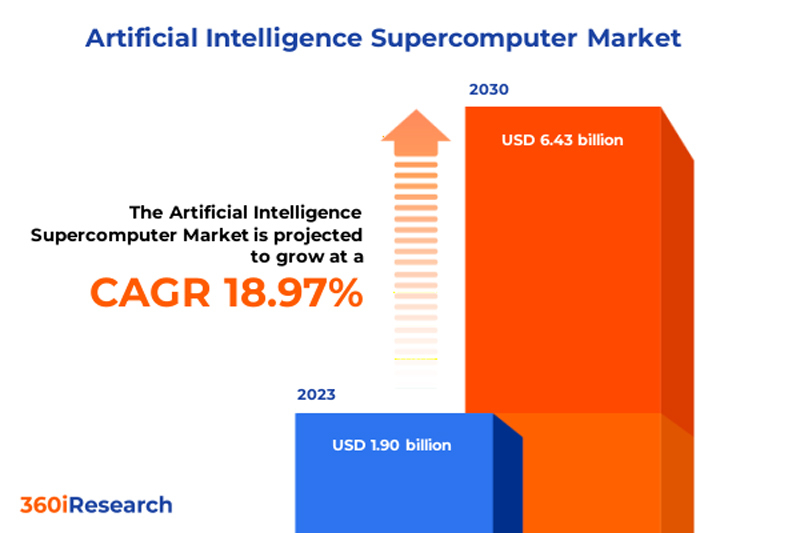

К 2030 году объём мирового рынка ИИ-суперкомпьютеров достигнет $6,43 млрдМаркетинговая и консалтинговая фирма 360iResearch прогнозирует быстрый рост мирового рынка суперкомпьютеров для ИИ-задач. Под такими системами аналитики понимают специализированные платформы с большими вычислительными ресурсами для быстрой обработки огромных объёмов данных. По оценкам 360iResearch, в 2023 году объём глобальной отрасли ИИ-суперкомпьютеров составил приблизительно $1,90 млрд. В 2024-м, как ожидается, затраты поднимутся до $2,26 млрд. В дальнейшем прогнозируется CAGR (среднегодовой темп роста в сложных процентах) на уровне 18,97 %. В результате к 2030 году расходы в рассматриваемом сегменте могут достичь $6,43 млрд.

Источник изображения: 360iResearch Эксперты выделяют несколько ключевых факторов, способствующих быстрому росту рынка. Это, в частности, цифровая трансформация, стремительное увеличение объёма генерируемых данных и потребность в вычислительных мощностях для эффективного использования бизнес-информации. Другими драйверами отрасли названы достижения в области машинного и глубокого обучения, а также нейронных сетей. В свете внедрения различных технологий ИИ растёт потребность в НРС-вычислениях. Плюс к этому реализуются инициативы по поддержке ИИ-рынка на государственном уровне. С другой стороны, существует и ряд сложностей. Сектор ИИ-суперкомпьютеров сталкивается с такими препятствиями, как высокие затраты на исследования, разработки и внедрение, проблемы конфиденциальности и безопасности данных, этические вопросы, нехватка квалифицированных кадров и ограниченные возможности в развивающихся регионах. Аналитики отмечают, что дальнейшему росту во многом будут способствовать достижения в области квантовых компьютеров и вычислительных систем экзафлопсного уровня. В целом, рынок ИИ-суперкомпьютеров демонстрирует рост во всех ключевых регионах. В Северной и Южной Америке, особенно в США, этому способствует внедрение ИИ в различных секторах, включая здравоохранение, финансовые услуги и автомобилестроение. В регионе EMEA (Европа, Ближний Восток и Африка) развитие отрасли стимулируется активными исследованиями в области ИИ и внедрением соответствующих технологий на предприятиях, которые стремятся повысить свою эффективность. В Азиатско-Тихоокеанском регионе наблюдается растущее внедрение ИИ-технологий в электронной коммерции, автомобилестроении и производстве. |

|