Материалы по тегу: mi300

|

11.10.2024 [00:35], Владимир Мироненко

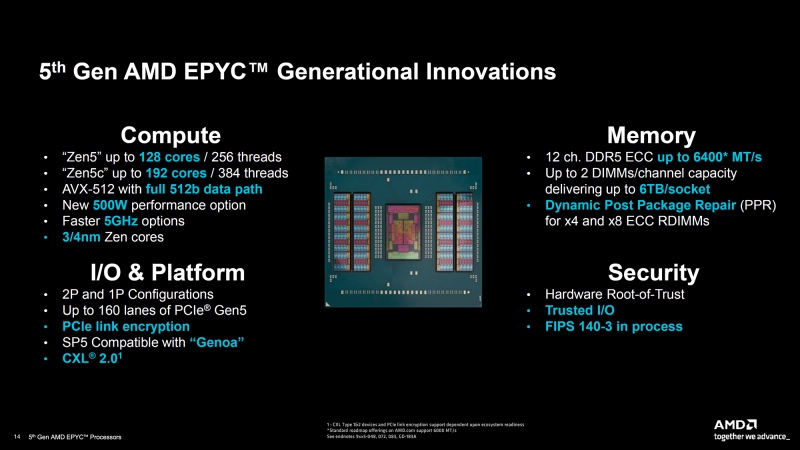

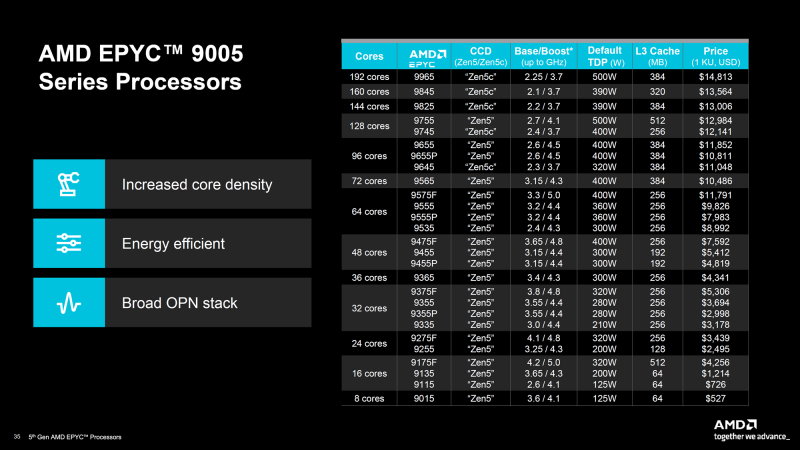

AMD представила серверные процессоры EPYC 9005 Turin и ускорители Instinct MI325XКомпания AMD представила ряд новых решений, включая серверные процессоры серии EPYC 9005 (Turin) и ускорители Instinct MI325X, которые, по словам компании, устанавливают новый стандарт производительности для ЦОД. Процессоры AMD EPYC 5-го поколения под кодовым названием Turin производятся с использованием техпроцесса 3 нм и 4 нм TSMC. Они предлагают тактовую частоту до 5,0 ГГц и от 8 до 192 ядер. AMD сообщила, что новая серия обеспечивает прирост показателя IPC на 17 % по сравнению с EPYC Genoa для корпоративных и облачных рабочих нагрузок и до 37 % в ИИ- и HPC-задачах по сравнению с Zen 4. Серия AMD EPYC 9005 включает 64-ядерный AMD EPYC 9575F, специально разработанный для ИИ-платформ на базе ускорителей, которым требуются максимальные возможности CPU. Турбочастота может достигать 5 ГГц, тогда как решение конкурента ограничено 3,8 ГГц — он до 28 % быстрее обрабатывает и передаёт данные ускорителям, что важно для требовательных рабочих нагрузок ИИ. В серии AMD EPYC 9005 доступны две версии чипов: 128-ядерная версия с классическими ядрами Zen5 и 192-ядерная версия с Zen5c. Оба варианта EPYC 9005 используют сокет SP5 и совместимы с некоторыми существующими платформами для Genoa (Zen4). Новинки поддерживают 12-канальную память DDR5-6400, а также предлагают полноценные обработку инструкций AVX-512 (целиком 512 бит за раз). Как сообщает компания, флагманский процессор серии EPYC 9965 имеет 192 ядра Zen5c и тактовую частоту до 3,7 ГГц. Серверы на базе процессоров AMD EPYC 9965 обеспечивают по сравнению с серверами на базе процессоров Intel Xeon Platinum 8592+ (Emerald Rapids):

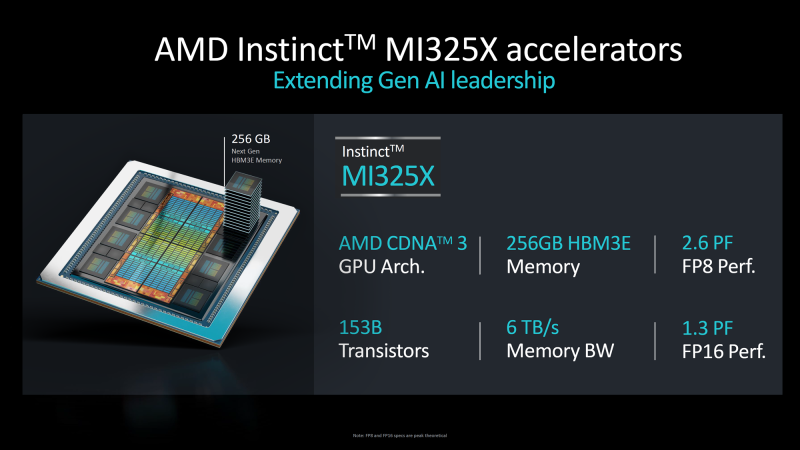

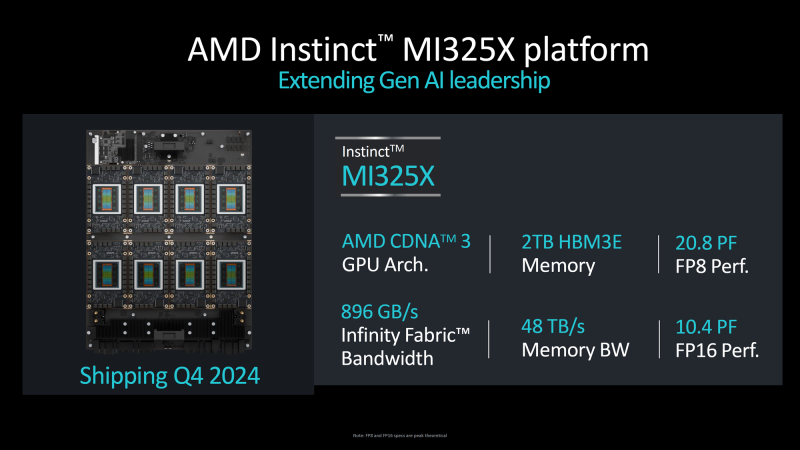

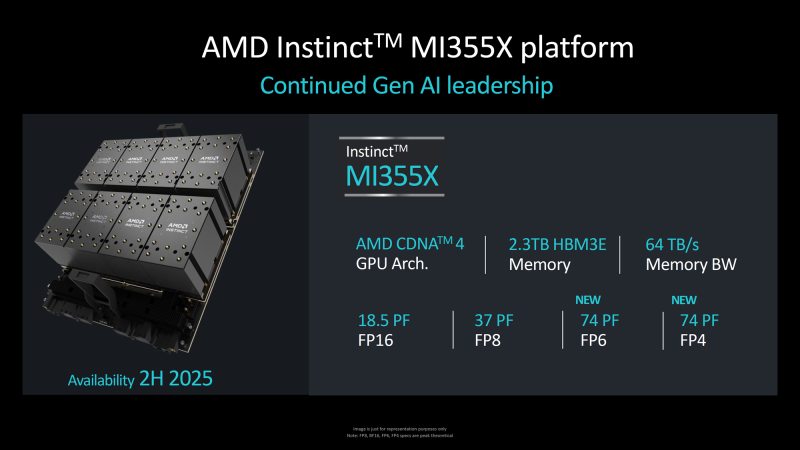

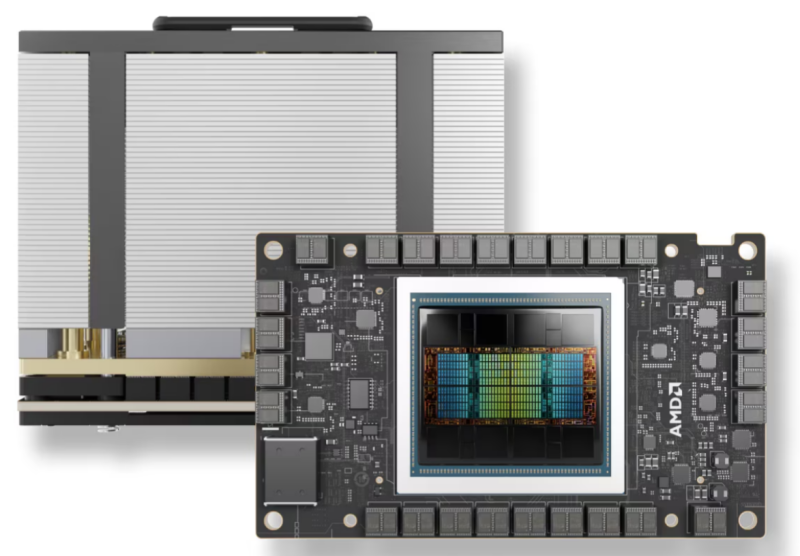

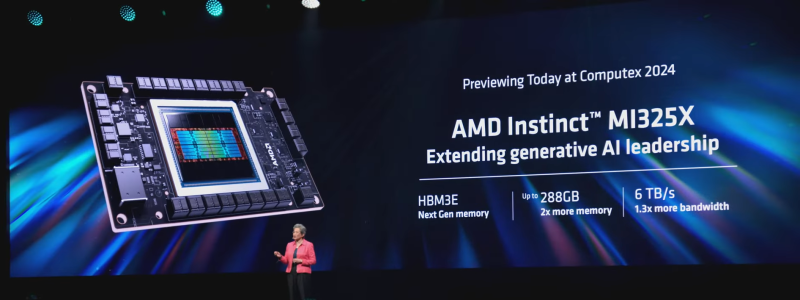

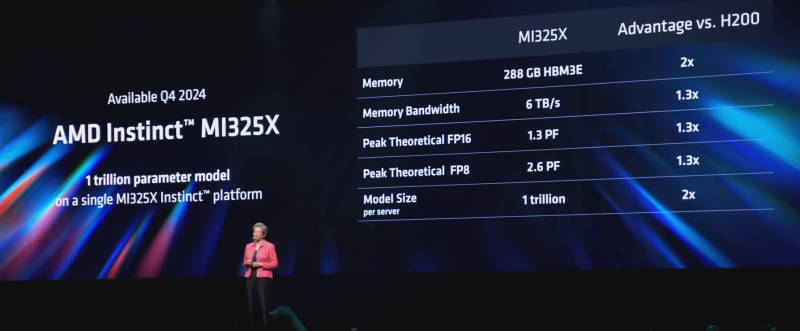

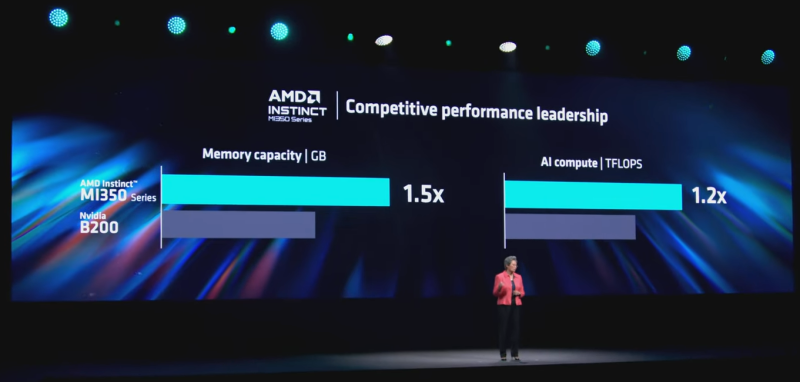

Также сообщается, что в сравнении с конкурентом 192-ядерный процессор EPYC 9965 обеспечивает до 3,7 раза большую производительность на end-to-end рабочих нагрузках ИИ, таких как TPCx-AI, которые имеют решающее значение для эффективного подхода к генеративному ИИ. Что касается AMD Instinct MI325X, то новый ускоритель, построенный на архитектуре AMD CDNA 3, имеет 256 Гбайт памяти HBM3e с пропускной способностью 6,0 Тбайт/с, что соответственно в 1,8 и 1,3 раза больше, чем у NVIDIA H200. Ускоритель обеспечивает 2,6 Пфлопс производительности в режиме FP8, 1,3 Пфлопс производительности в режиме FP16. Как утверждает AMD, по сравнению с H200 новый ускоритель в 1,3 раза быстрее в задачах инференса ИИ-модели Mistral 7B (FP16), в 1,2 раза — Llama 3.1 70B (FP8), в 1,4 раза — Mixtral 8x7B (FP16). Ускорители AMD Instinct MI325X будут доступны с I квартала 2025 года. AMD также анонсировала следующее поколение ускорителей серии AMD Instinct MI350 на основе архитектуры AMD CDNA 4, разработанные для обеспечения 35-кратного улучшения производительности инференса по сравнению с ускорителями на базе AMD CDNA 3. Серия AMD Instinct MI350 получит до 288 Гбайт памяти HBM3e на ускоритель и поддержку форматов FP6/FP4. Новинка будет доступна во II половине 2025 года.

10.10.2024 [19:08], Владимир Мироненко

TensorWave привлёк $43 млн на закупку ускорителей AMD Instinct MI300X для своего ИИ-облака, в том числе от самой AMDСтартап TensorWave из Лас-Вегаса провёл раунд финансирования на условиях SAFE (simple agreements for future equity), в результате которого привлёк $43 млн, сообщили ресурсы DataCenter Dynamics и The Register. Условия SAFE означают, что инвесторы имеют право при определённых обстоятельствах конвертировать свои инвестиции в акции компании, но не смогут потребовать возврат денег. Финансовый раунд возглавил вице-президент Nexus, также в нём приняли участие Maverick Capital, Translink Capital, Javelin Venture Partners, Granite Partners и AMD Ventures. Полученные средства TensorWave планирует использовать для оснащения своего основного ЦОД ускорителями AMD Instinct MI300X, на расширение команды, а также на подготовку к внедрению следующего поколения ускорителей Instinct MI325X и запуска новой корпоративной инференс-платформы Manifest в IV квартале 2024 года. По словам компании, Manifest, разработанная для поддержки более крупных контекстных окон ИИ-моделей с уменьшенной задержкой, помимо быстрого инференса позволяет анализировать сложные документы и безопасно обрабатывать и хранить конфиденциальные данные. Основанный в прошлом году стартап TensorWave, в отличие от большинства участников рынка ИИ, использующих ускорители NVIDIA, делает ставку на ускорители AMD Instinct. Разворачивать системы на базе MI300X стартап начал этой весной. Ускоритель MI300X также получил достаточно широкое распространение среди ряда облачных провайдеров. В частности, его использует Microsoft для обслуживания ИИ-модели OpenAI GPT-4 Turbo и многих сервисов Copilot. Oracle готова развернуть кластер из 16 384 MI300X. Также облачный стартап Vultr начал предлагать инстансы на базе MI300X. MI300X имеет больше памяти, чему у того же NVIDIA H100 — 192 Гбайт против 80 Гбайт. С выпуском ускорителей следующего поколения MI325X в конце этого года AMD ещё больше увеличит преимущество, поскольку ёмкость HBM3e-памяти ускорителя вырастет до 288 Гбайт. Это втрое больше, чем у H100, и наполовину больше, чем у будущих ускорителей NVIDIA Blackwell, говорит компания. Больший объём памяти особенно ценен для тех, кто запускает крупные ИИ-модели в FP16-формате. При 1536 Гбайт на узел система на базе MI300X может легко вместить модель Llama 3.1 405B от Meta✴, тогда как при использовании ускорителей H100 для этого её придётся разделить между несколькими системами или ужать с помощью 8-бит квантования. Можно также «втиснуть» несжатую модель в один узел с ускорителями NVIDIA H200, но тогда не останется достаточно места для большего контекстного окна, поддерживаемого моделью.

30.09.2024 [10:24], Сергей Карасёв

В облаке Vultr появились ускорители AMD Instinct MI300XVultr, крупнейший в мире частный облачный провайдер, объявил о том, что в составе его инфраструктуры теперь доступны ускорители AMD Instinct MI300X и открытый программный стек AMD ROCm. Клиенты могут использовать их для ресурсоёмких задач ИИ и НРС-нагрузок. Отмечается, что благодаря объединению платформы Vultr Serverless Inference с ускорителями Instinct MI300X даже небольшие предприятия получают возможность применять передовые технологии ИИ, которые ранее им были недоступны. Новое решение ориентировано на заказчиков из различных отраслей, включая здравоохранение, финансовые услуги, производство, энергетику, медиа, розничную торговлю и телекоммуникации. На сайте Vultr отмечается, что изделия Instinct MI300X обеспечивают ИИ-производительность в режиме TF32 до 653,7 Тфлопс, FP16 — 1307,4 Тфлопс, INT8 — 2614,9 TOPS, FP8 — 2614,9 Тфлопс. При НРС-нагрузках теоретическое пиковое быстродействие достигает 81,7 Тфлопс FP64 и 163,4 Тфлопс FP32. Ускорители AMD интегрируются с Vultr Kubernetes Engine for Cloud GPU для формирования кластеров Kubernetes с ускорением на базе GPU. Компания Vultr говорит о высоком соотношении цены и производительности, гибких возможностях масштабирования и оптимизации для инференса. Нужно отметить, что ранее об использовании ускорителей Instinct MI300X в составе своей облачной инфраструктуры объявила корпорация Oracle. Новые инстансы BM.GPU.MI300X.8 могут использоваться в том числе для обработки больших языковых моделей (LLM), насчитывающих сотни миллиардов параметров.

27.09.2024 [11:46], Сергей Карасёв

В облаке Oracle можно объединить до 16 тыс. ускорителей AMD Instinct MI300XОблачная платформа Oracle Cloud Infrastructure (OCI) задействовала ускорители AMD Instinct MI300X и открытый программный стек AMD ROCm в составе новейших инстансов BM.GPU.MI300X.8. Они предназначены для ресурсоёмких ИИ-нагрузок, включая обработку больших языковых моделей (LLM), насчитывающих сотни миллиардов параметров. Инстансы BM.GPU.MI300X.8 типа Bare Metal объединяют восемь ускорителей Instinct MI300X, каждый из которых несёт на борту 192 Гбайт памяти HBM3 с пропускной способностью 5,3 Тбайт/с. Утверждается, что модель Hugging Face OPT с 66 млрд параметров может быть запущена на одном Instinct MI300X. В составе инстансов задействованы два процессора Intel Xeon Sapphire Rapids с 56 ядрами. Объём оперативной памяти DDR5 составляет 2 Тбайт. Для хранения данных используются восемь NVMe SSD вместимостью 3,84 Тбайт каждый. Инстансы включают frontend-сеть с пропускной способностью 100 Гбит/с, а в составе кластера применяются соединения уровня 400G (×8). Стоимость подписки на BM.GPU.MI300X.8 составляет $6/час за каждый ускоритель. Платформа OCI Supercluster на базе AMD Instinct MI300X может объединять до 16 384 ускорителей, что позволяет заказчикам гибко масштабировать вычислительные ресурсы под свои задачи, говорит компания. Отмечается, что появление новых инстансов предоставит клиентам OCI больше возможностей в плане организации высокопроизводительных и эффективных вычислений при реализации сложных ИИ-проектов. Кроме того, компания предлагает и кластеры с ускорителями NVIDIA: 32 768 × A100, 16 384 × H100, 65 536 × H200 и 3840 × L40S. А в I половине 2025 года заказчикам станет доступен зеттафлопсный облачный ИИ-суперкомпьютер из 131 072 ускорителей NVIDIA B200 (Blackwell).

17.09.2024 [23:07], Игорь Осколков

Швейцария ввела в эксплуатацию гибридный суперкомпьютер Alps: 11 тыс. NVIDIA GH200, 2 тыс. AMD EPYC Rome и щепотка A100, MI250X и MI300AШвейцарская высшая техническая школа Цюриха (ETH Zurich) провела церемонию официального запуска суперкомпьютера Alps в Швейцарском национальном суперкомпьютерном центре (CSCS) в Лугано. Система, построенная HPE, уже заняла шестую строчку в последнем рейтинге TOP500 и имеет устоявшеюся FP64-производительность 270 Пфлопс (теоретический пик — 354 Пфлопс). К ноябрю будут введены в строй остальные модули машины, и её максимальная производительность составит порядка 500 Пфлопс.

Источник изображений: CSCS В июньском рейтинге TOP500 участвовал раздел из 2688 узлов HPE Cray EX254n с «фантастической четвёркой» NVIDIA Quad GH200. Если точнее, это всё же «старый» вариант ускорителя с H100 (96 Гбайт HBM3), 72-ядерным Arm-процессором Grace и 128 Гбайт LPDDR5x — суммарно 10 752 Grace Hopper. Данный раздел потребляет 5,2 МВт и в Green500 находится на 14 месте. Узлы, конечно же, используют СЖО. Это основной, но не единственный раздел суперкомпьютера. Ещё в 2020 году HPE развернула 1024 двухпроцессорных узла с 64-ядерными AMD EPYC 7742 (Rome) и 256/512 Гбайт RAM. Его производительность составляет 4,7 Пфлопс. Кроме того, в состав Alps входят 144 узла с одним 64-ядерным AMD EPYC, 128 Гбайт RAM и четырьмя NVIDIA A100 (80 или 96 Гбайт HBM2e). Наконец, машина получит 24 узла с одним 64-ядерным AMD EPYC, 128 Гбайт RAM и четырьмя AMD Instinct MI250X (128 Гбайт HBM2e) и 128 узлов с четырьмя гибридными ускорителями AMD Instinct MI300A. Большая часть узлов будет объединена интерконнектом HPE Slingshot-11: 200G-подключение на узел или ускоритель. Более точную конфигурацию системы раскроют в ноябре. Lustre-хранилище для будущей машины обновили ещё в прошлом году. Основной СХД является Cray ClusterStor E1000 с подключением Slingshot-11. Так, было добавлено 100 Пбайт полезной HDD-ёмкости (8480 × 16 Тбайт) с пропускной способностью 1 Тбайт/с (300 тыс. IOPS на запись, 1,5 млн IOPS на чтение) и 5 Пбайт SSD, а также резервные ёмкости. За архивное хранение отвечают две ленточные библиотеки объёмом 130 Пбайт каждая. Особенностью системы является её геораспределённость (фактически узлы размещены в четырёх местах) и облачная модель использования. Так, метеослужба страны MeteoSwiss получила в своё распоряжение выделенный виртуальный кластер, что уже позволило перейти на использование метеомодели более высокого разрешения, которая лучше отражает сложный рельеф Швейцарии. Кроме того, для подстраховки часть узлов Alps размещена на территории Федеральной политехнической школы Лозанны (EPFL). Alps приходит на смену суперкомпьютеру Piz Daint (Cray XC50/40, 21,2 Пфлопс), о завершении жизненного цикла которого было объявлено в конце июля 2024 года. В CSCS пока останутся машины Arolla + Tsa (для нужд MeteoSwiss) и Blue Brain 5 (решает задачи реконструкции и симуляции мозга). Alps же помимо традиционных HPC-нагрузок, будет использоваться для разработки ИИ-решений.

20.08.2024 [23:30], Руслан Авдеев

Суперкомпьютер с лабораторией: Пентагон создаёт новый комплекс защиты США от биологических угрозНовейший проект Министерства обороны США объединит суперкомпьютер и т.н. лабораторию быстрого реагирования (RRL, Rapid Response Laboratory). The Register сообщает, что проект призван укрепить биологическую защиту Соединённых Штатов. Расположенная на территории Ливерморской национальной лаборатории им. Э. Лоуренса (Lawrence Livermore National Laboratory, LLNL) в Калифорнии, машина строится при сотрудничестве с Национальным агентством ядерной безопасности США (National Nuclear Security Agency, NNSA) и будет основана на той же архитектуре, что и грядущий экзафлопсный суперкомпьютер El Capitan на базе ускорителей AMD Instinct MI300A. Спецификации аппаратного обеспечения и ПО не раскрываются. Машина будет использоваться как военными, так и гражданскими специалистами для крупномасштабных симуляций, ИИ-моделирования, классификации угроз, а при сотрудничестве с новой биологической лабораторией — для ускорения разработки контрмер. Некоторые из них, как ожидается, будут чрезвычайно важными, поскольку решения можно будет находить в течение дней, если не часов. Впрочем, новые вычислительные мощности военные биологи намерены использовать на регулярной основе. Конечно, как отмечает The Register, инструменты для разработки средств борьбы могут использоваться и для создания биологического оружия, хотя в самом Пентагоне о подобном применении суперкомпьютера не упоминают. Концепция биологической защиты США представляет собой комплекс мер для борьбы как с естественными, так и рукотворными биологическими угрозами военным и гражданским лицам, природным ресурсам, источникам пищи и воды и т.п., воздействие на которые может негативно сказаться на возможностях воюющей стороны. Поскольку биологические угрозы имеют важное значение для самых разных ведомств, суперкомпьютер будет доступен и прочим правительственным агентствам США, а также союзникам Соединённых Штатов, академическим исследователям и промышленным компаниям. Лаборатория RRL будет находиться буквально в «шаговой доступности» от суперкомпьютера. Она станет дополнением к проекту Пентагона Generative Unconstrained Intelligent Drug Engineering (GUIDE). GUIDE занимается разработкой медицинских и биологических контрмер с использованием машинного обучения для создания анител, структурной биологии, биоинформатики, молекулярного моделирования и т.д. Новый суперкомпьютер позволит Пентагону быстрые и многократные тесты моделируемых вакцин и лекарств. RRL автоматизирована и снабжена роботами и иными инструментами для изучения строения и свойств молекул, для редактирования структуры белков и т.д. По словам экспертов LLNL, лаборатория, подключённая к суперкомпьютеру, позволит изменить всю систему распознавания биологических угроз и ответа на них.

05.06.2024 [11:41], Сергей Карасёв

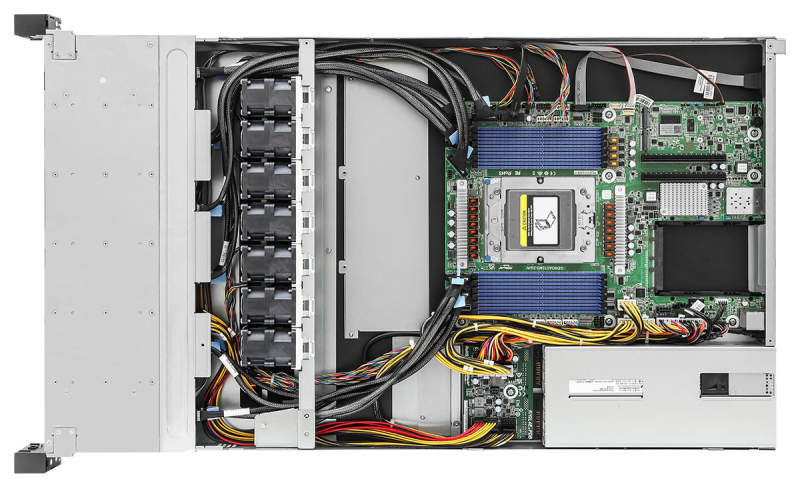

ASRock Rack представила свой первый GPU-сервер на базе AMD Instinct MI300XКомпания ASRock Rack анонсировала систему 6U8M-GENOA2 — свой первый GPU-сервер, оснащённый ускорителями AMD Instinct MI300X. Кроме того, дебютировали новые решения на платформе AMD EPYC 9004 (Genoa) — модели 1U12E-GENOA/EVAC и 1U12L4E-GENOA/2Q. Характеристики 6U8M-GENOA2 полностью пока не раскрываются. Известно, что новинка выполнена в форм-факторе 6U с применением процессоров EPYC 9004. Допускается установка до восьми ускорителей Instinct MI300X, соединённых между собой посредством Infinity Fabric. Общий объём высокопроизводительной памяти HBM3 может достигать 1,5 Тбайт. Сервер ориентирован на приложения генеративного ИИ, задачи НРС и пр. В свою очередь, 1U12E-GENOA/EVAC — это сервер в форм-факторе 1U, предназначенный для построения СХД типа All-Flash. Он допускает установку одного чипа AMD EPYC в исполнении SP5 с показателем TDP до 360 Вт. Доступны 12 слотов для модулей DDR5-4800. Поддерживается использование до 12 накопителей SFF NVMe (PCIe 5.0 x4), а также двух SSD типоразмера М.2 22110/2280/2260 с интерфейсом PCIe 5.0 x4 или SATA-3. Есть два разъёма для карт расширения FHHL PCIe 5.0 x16 и один слот OCP NIC 3.0 (PCIe 5.0 x16). Питание обеспечивают два блока мощностью 1600 Вт с сертификатом 80 PLUS Platinum. Модель 1U12L4E-GENOA/2Q также представляет собой сервер хранения типоразмера 1U. Он может быть оснащён одним чипом AMD EPYC 9004 с TDP до 300 Вт и 12 модулями DDR5-4800. Есть 12 посадочных мест для LFF-накопителей с интерфейсом SATA-3 и четыре посадочных места для SFF-изделий NVMe (PCIe 4.0 x4). Кроме того, предусмотрены два коннектора для SSD стандарта М.2 22110/2280/2260 с интерфейсом PCIe 5.0 x4 или SATA-3. Задействованы два блока питания на 1000 Вт. Есть по одному слоту для карт FHHL PCIe 5.0 x16, HHHL PCIe 5.0 x16 и OCP NIC 3.0 (PCIe 5.0 x16).

03.06.2024 [23:50], Алексей Степин

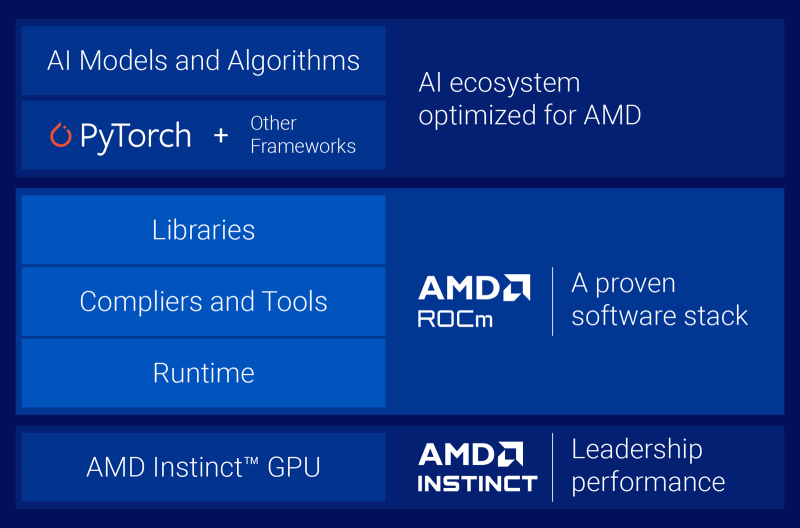

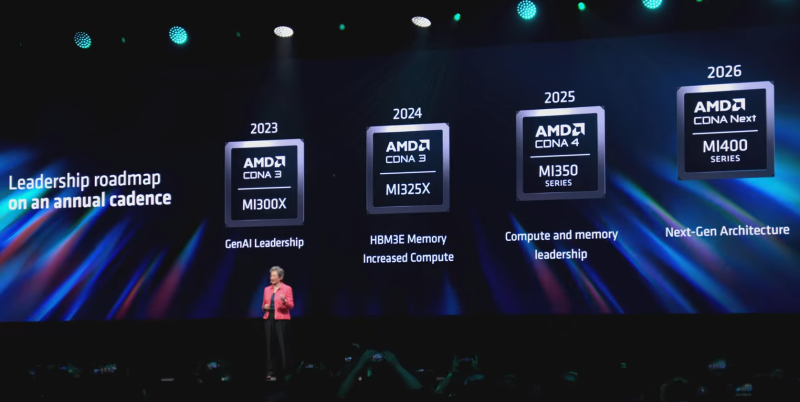

AMD готовит ускорители Instinct MI325X и MI350XВместе с EPYC Turin компания AMD анонсировала и новые ускорители серии Instinct. Так, на смену MI300X компания предложит Instinct MI325X, оснащённый памятью HBM3e. Он должен стать достойным ответом на серию ускорителей NVIDIA Blackwell. Последний также получит память данного типа, тогда как более совершенные NVIDIA Rubin с памятью HBM4 увидят свет лишь в 2026 году. Технически MI325X представляет собой усовершенствованный вариант MI300X. Использование более плотной HBM3e позволило довести объём набортной памяти до 288 Гбайт, что больше, нежели у Blackwell В100 (192 Гбайт) и Hopper H200 (141 Гбайт). Выросла и пропускная способность, с 5,3 до 6 Тбайт/с. В настоящее время тройка главных поставщиков памяти уже готовят HBM3e-сборки 12-Hi ёмкостью до 36 Гбайт. Micron и SK Hynix освоили ПСП 9,2 Гбит/с на контакт, в то время как Samsung планирует достичь 9,8 Гбит/с. Правда, для MI325X эта цифра составит примерно 5,9 Гбит/с на контакт. В остальном конфигурация нового ускорителя осталась прежней в сравнении с MI300X. Под вопросом разве что теплопакет, но вряд ли он так уж значительно превысит уже имеющиеся 750 Вт. AMD Instinct MI325X получит полную совместимость с любой инфраструктурой на базе MI300X, достаточно будет лишь заменить модули OAM. Начало поставок новинки запланировано на IV квартал 2024 года, но, как считают зарубежные обозреватели, AMD придётся конкурировать за поставки памяти с другими разработчиками ускорителей. Вместе с анонсом MI325X компания впервые за два года опубликовала план дальнейшего развития семейства Instinct. Сейчас AMD активно работает над архитектурой CDNA4, которая дебютирует в ускорителях MI350 в 2025 году. Они будут производиться с использованием 3-нм техпроцесса и получат поддержку FP4/FP6. Ожидается повышение как производительности, так и энергоэффективности. Причём AMD намеревается сохранить лидерство по объёму памяти. Следующее поколение архитектуры под условным названием CDNA Next появится лишь в 2026 году в серии Instinct MI400, где AMD ещё более активно задействует чиплетный подход. AMD вслед за NVIDIA переходит к ежегодному выпуску новых ускорителей и к переходу на новую архитектуру каждые два года. Гонка в сфере ИИ ускоряется и взятый темп позволит компании более успешно играть на этом рынке. Работает AMD и над программной составляющей, развивая пакет ROCm, адаптирую и упрощая запуск всё большего количества моделей, сотрудничая с Hugging Face и развивая PyTorch, TensorFlow и JAX.

22.05.2024 [13:49], Сергей Карасёв

1,5 Тбайт HBM3: AMD Instinct MI300X стали доступны в облаке Microsoft AzureКорпорация Microsoft сообщила о доступности инстансов Azure ND MI300X v5 на базе ускорителей AMD Instinct MI300X. Отмечается, что это качественно новое семейство виртуальных машин, предлагающее максимально возможный объём памяти HBM и ведущей в отрасли производительности. О подготовке инстансов ND MI300X v5 компания Microsoft объявила в ноябре прошлого года. В составе одной виртуальной машины объединены восемь ускорителей со 192 Гбайт памяти HBM3, соединённых между собой посредством Infinity Fabric 3.0, а с хостом — по PCIe 5.0. Таким образом, общий объём HBM3 достигает 1,5 Тбайт, а пропускная способность — 5,3 Тбайт/с. Отмечается, что виртуальные машины ND MI300X v5 используют открытую программную платформу AMD ROCm, которая предоставляет полный набор инструментов и библиотек для разработки и развёртывания ИИ. Платформа ROCm поддерживает популярные фреймворки, такие как TensorFlow и PyTorch, а также ИИ-библиотеки Microsoft, включая ONNX Runtime, DeepSpeed и MSCCL. Кроме того, ROCm упрощает перенос моделей с одной платформы на другую, что обеспечивает снижение затрат. Компания Hugging Face портировала свои модели на ND MI300X v5 без какого-либо изменения кода. Это позволило увеличить производительность в 2–3 раза по сравнению с AMD Instinct MI250.

13.05.2024 [11:12], Сергей Карасёв

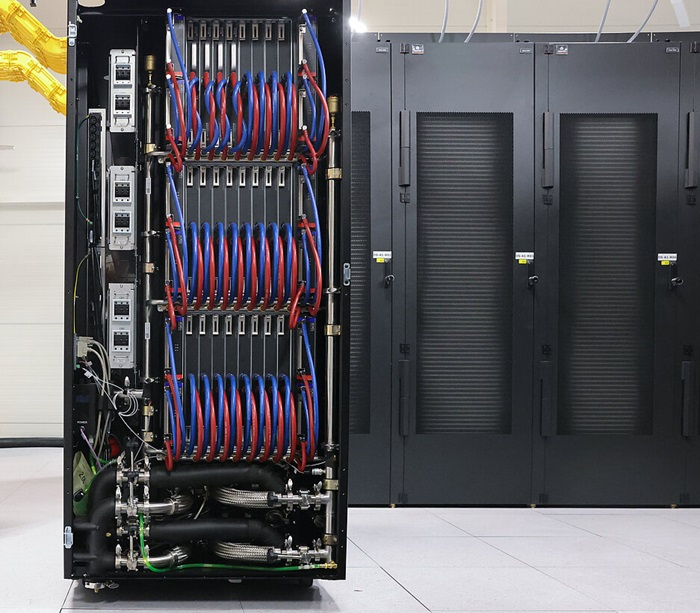

Supermicro представила ИИ-серверы на базе Intel Gaudi3 и AMD Instinct MI300XКомпания Supermicro анонсировала новые серверы для задач ИИ и НРС. Дебютировали системы высокой плотности с жидкостным охлаждением, а также устройства, оборудованные высокопроизводительными ускорителями AMD, Intel и NVIDIA.

Источник изображений: Supermicro В частности, представлены серверы SYS-421GE-TNHR2-LCC и AS-4125GS-TNHR2-LCC в форм-факторе 4U, оснащённые СЖО. Первая из этих моделей рассчитана на установку двух процессоров Intel Xeon Emerald Rapids или Xeon Sapphire Rapids (до 385 Вт), а также 32 модулей DDR5-5600. Второй сервер поддерживает два чипа AMD EPYC 9004 Genoa с показателем TDP до 400 Вт и 24 модуля DDR5-4800. Обе новинки могут быть оборудованы восемью ускорителями NVIDIA H100 (SXM). В одной стойке могут размещаться до восьми серверов, что в сумме даст 64 ускорителя. При этом общая заявленная производительность такого кластера на операциях FP16 превышает 126 Пфлопс. Серверы оборудованы восемью фронтальными отсеками для SFF-накопителей NVMe. Питание обеспечивают четыре блока мощностью 5250 Вт с сертификатом Titanium. Слоты расширения выполнены по схеме 8 × PCIe 5.0 x16 LP и 2 × PCIe 5.0 x16 FHHL. На ISC 2024 компания Supermicro также демонстрирует сервер типоразмера 8U, оборудованный ускорителями Intel Gaudi3. Это одна из первых систем такого рода. Кроме того, представлена система AS-8125GS-TNMR2 формата 8U, рассчитанная на восемь ускорителей AMD Instinct MI300X. Этот сервер может комплектоваться двумя процессорами EPYC 9004 с TDP до 400 Вт, 24 модулями оперативной памяти DDR5-4800, фронтальными накопителями SFF (16 × NVMe и 2 × SATA), двумя модулями M.2 NVMe. Установлены шесть блоков питания на 3000 Вт с сертификатом Titanium. Наконец, Supermicro готовит серверы формата 4U с жидкостным охлаждением, которые могут оснащаться восемью ускорителями NVIDIA H100 и H200. Компания демонстрирует на конференции ISC 2024 и другие системы для приложений ИИ, а также задач НРС. |

|