Материалы по тегу: облако

|

23.10.2024 [14:18], Руслан Авдеев

ByteDance готовится построить дата-центр в ТаиландеВладеющая популярной социальной сетью TikTok компания ByteDance, по слухам, рассчитывает открыть новый дата-центр в Таиланде. Datacenter Dynamics сообщает, что дочерняя структура IT-гиганта BytePlus хочет развернуть в 2025 году новую площадку для поддержки облачных и ИИ-сервисов. Согласно источнику, ByteDance намерена воспользоваться преимуществами развивающейся цифровой экономики Таиланда. В последние году ByteDance активно развивает свою инфраструктуру для удовлетворения растущего спроса, попутно пытаясь убедить власти на местах в том, что персональные данные местных жителей не будут передаваться в Китай — такие опасения особенно характерны для США и Евросоюза. В июне компания сообщила о строительстве ИИ-хаба в Малайзии за RM10 млрд ($2,13 млрд). Также она предположительно рассматривает возможность открытия дата-центра в Австралии для поддержки выполнения задач в Азиатско-Тихоокеанском регионе.

Источник изображения: Andreas Brücker/unsplash.com В Таиланде действительно активно развивается национальная цифровая инфраструктура. Так, в сентябре Google объявила, что намерена инвестировать $1 млрд в дата-центры в Бангкоке, а также находящейся рядом прибрежной провинции Чонбури. В рамках проекта компания намерена сотрудничать с группой Gulf Edge, чтобы создать в Таиланде суверенное облако. AWS также намерена запустить в Таиланде облачный регион в начале 2025 года, а к 2037 году инвестировать $5 млрд. Построить регион ЦОД в стране намерена и Microsoft.

21.10.2024 [17:50], Руслан Авдеев

Вьетнам намерен перевести все сети на IPv6, проложить новые интернет-кабели и возвести ИИ ЦОДВьетнам намерен перевести все сети страны на протокол IPv6, обновить сетевую инфраструктуру и поддержать развитие ЦОД в стране. По данным The Register, новая стратегия правительства отражена в рамках Решения № 1132/QD-TTg, определяющего цели на 2025 и 2030 гг. Так, в течение года страна намерена подключить два новых подводных интернет-кабеля. Ранее в этом году три из пяти кабелей, обеспечивавших Вьетнаму связь с внешним миром, вышли из строя. Также планируется обеспечить домохозяйства FTTH-подключением, покрыть 5G-связью все крупные города и промышленные зоны, а также начать работы над ИИ ЦОД с PUE не выш 1.4. Ещё грандиознее планы на 2030 год. Ожидается, что к этому моменту все сети в стране перейдут на IPv6, скорость широкополосного оптического подключения повсеместно достигнет 1 Гбит/сек, а 5G-сети охватят 99 % населения. Также будут подключены ещё шесть подводных кабелей суммарной ёмкостью 350 Тбайт/сек. Один из них будет находиться в государственной собственности. Население Вьетнама превышает 100 млн человек, при этом количество абонентских договоров составляет 140 на 100 жителей. IPv4-адресов не хватает, поскольку развивающиеся страны и так в своё время получили их не слишком много. Поэтому переход на IPv6 выглядит логичным и своевременным. Например, соседний Китай намерен ускорить внедрение IPv6, причём действует весьма решительно. Ещё с прошлого года поддержка IPv6 стала обязательной для всего нового Wi-Fi оборудования в стране.

Источник изображения: Peter Hammer/unsplash.com Планом предусмотрено строительство ряда ЦОД гиперскейл-уровня, ИИ ЦОД, а также периферийных и региональных дата-центров. Вьетнам также утвердил решение об обеспечении кибербезопасности, в рамках которого организации и частные лица призывают пользоваться услугам местных ЦОД. Предусматривается и поощрение переноса IT-нагрузок бизнеса и властей в облака. Для строительства дата-центров правительство намерено привлечь как местные, так и иностранные инвестиции. Ещё одной целью на 2030 год стало обеспечение каждого жителя Вьетнама четырьмя IoT-подключениями. А 70 % населения к этому времени должны перейти на использование персональных цифровых подписей. Кроме того, правительство решило, что ежегодный оборот полупроводниковой индустрии должен достичь $100 млрд к 2050 году.

17.10.2024 [14:36], Руслан Авдеев

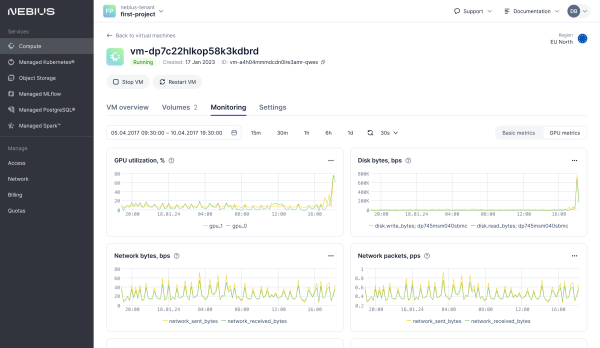

Nebius, бывшая Yandex, представила облачную ИИ-платформу с ускорителями NVIDIA H100 и H200ИИ-компания Nebius, сформированная из бывшей Yandex N.V., представила облачную платформу с современными ускорителями NVIDIA. Как уточняет Datacenter Dynamics, речь идёт о моделях NVIDIA H100 и H200, а также L40S. В скором будущем компания рассчитывает добавить и новейшие суперускорители GB200 NVL72. Облачное хранилище обеспечивает агрегированную скорость чтения до 100 Гбайт/с и 1 млн IOPS. Платформа также предлагает управляемые Apache Spark и MLFlow, а ВМ по умолчанию включают ИИ-библиотеки и драйверы. По словам компании, она прислушалась к запросам клиентов, нуждавшихся в самостоятельном доступе и инфраструктуре, отлично от просто «базовой». Речь идёт о крупномасштабных кластерах с InfiniBand-подключением на базе эталонной архитектуры NVIDIA, но с кастомизированным оборудованием и проприетарной программной облачной платформой. После введения антироссийских санкций Nebius дистанцировалась от «Яндекса», основная часть активов которого была продана группе российских инвесторов. У Nebius остался дата-центр в Финляндии, ёмкость которого она намерена утроить в обозримом будущем. Там разместятся более 60 тыс. ускорителей. В августе сообщалось, что компания увеличила облачную выручку на 60 % год к году во II квартале.

16.10.2024 [12:15], Руслан Авдеев

Crusoe Energy, Blue Owl и Primary Digital Infrastructure построят в Техасе 205-МВт ИИ ЦОД в ТехасеКомпания Crusoe Energy открывает совместное предприятие с Blue Owl Capital и Primary Digital Infrastructure для реализации проекта по строительству ЦОД в Техасе. По данным Silicon Angle, на эти цели будет потрачено $3,4 млрд, специализированный дата-центр должен появиться в кампусе Lancium Clean Campus. Будущий ЦОД Crusoe AI, уже сданный в аренду целиком некому гиперскейлеру из списка Fortune 500, будет кампусом из двух объектов, построенных по индивидуальному проекту. По имеющимся данным, он рассчитан на ёмкость 205 МВт. Конструкция ЦОД оптимизирована для использования систем с прямым жидкостным охлаждением, но будет поддерживаться и воздушное охлаждение. Готовый ЦОД сможет вместить до 100 тыс. ускорителей в составе одной сетевой фабрики. Предполагается, что энергоснабжение кампуса будет обеспечено внутренними и внешними источниками энергии. Освоение мощностей начнётся в I половине 2025 года. Ранее появилась информация, что ключевым арендатором станет компания Oracle, а конечным потребителем вычислительных мощностей — OpenAI. При этом Microsoft, вероятно, станет посредником, сохраняя свой статус поставщика облачных услуг для OpenAI. В руководстве Crusoe подчёркивает, что растущий спрос на ЦОД обусловлен большими перспективами ИИ. Lancium, с которой Crusoe уже сотрудничала, в 2021 году получила одобрение на строительство техасского кампуса ЦОД Project Artemis. Тогда речь шла о кампусе на участке 160–320 га ёмкостью от 200 МВт с возможностью масштабирования до 1 ГВт. Blue Owl Capital управляет активами на $192 млрд. Хотя ранее компания не инвестировала в ЦОД, в последние месяцы она вложила средства в проекты нескольких дата-центров, а недавно создала СП на $5 млрдс Chirisa и PowerHouse для строительства сети ЦОД на территории США, в первую очередь для ИИ-облака CoreWeave. Blue Owl также приобрела владельца Stack и RadiusDC — компанию IPI Partners за $1 млрд. Руководство Primary Digital Infrastructure говорит об инвестиционном буме — только в США в ближайшие четыре-пять лет на ЦОД будет потрачено около $1 трлн. Текущая цель компании — приобретение наиболее стабильных активов на этом рынке, а также инвестиции в строительство собственных облачных и ИИ-объектов. Crusoe Energy, основанная в 2018 году, начинала с доставки контейнерных ЦОД к нефтяным скважинам в США, запитанных от попутного газа. Если изначально Crusoe использовала свои ресурсы для майнинга, то позже появилось предложение Crusoe Cloud для ИИ- и HPC-нагрузок. В конце прошлого года компания занялась стационарными проектами. Компания разместила ускорители в ЦОД ICE02 оператора atNorth в Исландии и объявила о сотрудничестве с Digital Realty.

14.10.2024 [11:44], Руслан Авдеев

CoreWeave получила кредитную линию на $650 млн для развития ИИ-облакаОблачный провайдер CoreWeave привлёк кредитную линию на $650 млн от крупного инвестиционного бизнеса для масштабирования своей деятельности по всему миру. По данным Silicon Angle, лидерами раунда финансирования стали JPMorgan Chase, Goldman Sachs и Morgan Stanley, к ним присоединились Barclays, CitiGroup, Deutsche Bank, Jefferies, Mizuho, MUFG и Wells Fargo. За последние 18 месяцев компания уже привлекла $12,7 млрд в виде акционерного капитала и долговых обязательств, оценка компании составила $19 млрд. В компании утверждают, что новая кредитная линия будет способствовать росту в быстроразвивающейся сфере ИИ. Сегодня CoreWeave выступает оператором публичного облака, обеспечивающего доступ к ускорителям NVIDIA для ИИ и рендеринга — в том числе доступны NVIDIA H100 и H200. Ещё в августе компания заявила, что стала первым облачным провайдером, предоставившим клиентам доступ к новейшим ускорителям NVIDIA H200. Обучение и внедрение больших языковых моделей (LLM) требует больших вычислительных ресурсов, но CoreWeave говорит, что её инфраструктура позволяет легко масштабировать ИИ-нагрузки в облаке.

Источник изображения: CoreWeave На сегодня инвестиции в ИИ-платформы очень популярны, поскольку спрос на вычисления продолжает расти. Например, ранее в этом месяце OpenAI уже привлекла кредитную линию на $4 млрд и ещё $6.6 миллиарда в рамках инвестиционного раунда. При этом в формировании кредитных линий CoreWeave и OpenAI зачастую участвуют одни и те же инвестиционные компании. Недавно CoreWeave открыла европейскую штаб-квартиру в Лондоне. При этом она намерена инвестировать $3,5 млрд в расширение бизнеса в Европе. В том числе речь идёт об открытии двух ЦОД в Великобритании, не считая дата-центров в Норвегии, Швеции и Испании. До конца года компания намерена получить в своё распоряжение до 28 ЦОД по всему миру. В 2025 году запланировано открытие ещё 10 дата-центров. В апреле прошлого года CoreWeave получила $221 млн, а потом — ещё $200 млн. В августе 2023 года было объявлено о долговом финансировании в размере $2,3 млрд под залог ускорителей NVIDIA. В декабре того же года CoreWeave провела раунд финансирования на $642 млн, а в мае текущего года она получила $1,1 млрд. Позже компания привлекла ещё $7,5 млрд. Наконец, в октябре появилась информация о намерении Cisco инвестировать в компанию. При этом в рамках сделки CoreWeave может получить оценку в $23 млрд.

10.10.2024 [19:08], Владимир Мироненко

TensorWave привлёк $43 млн на закупку ускорителей AMD Instinct MI300X для своего ИИ-облака, в том числе от самой AMDСтартап TensorWave из Лас-Вегаса провёл раунд финансирования на условиях SAFE (simple agreements for future equity), в результате которого привлёк $43 млн, сообщили ресурсы DataCenter Dynamics и The Register. Условия SAFE означают, что инвесторы имеют право при определённых обстоятельствах конвертировать свои инвестиции в акции компании, но не смогут потребовать возврат денег. Финансовый раунд возглавил вице-президент Nexus, также в нём приняли участие Maverick Capital, Translink Capital, Javelin Venture Partners, Granite Partners и AMD Ventures. Полученные средства TensorWave планирует использовать для оснащения своего основного ЦОД ускорителями AMD Instinct MI300X, на расширение команды, а также на подготовку к внедрению следующего поколения ускорителей Instinct MI325X и запуска новой корпоративной инференс-платформы Manifest в IV квартале 2024 года. По словам компании, Manifest, разработанная для поддержки более крупных контекстных окон ИИ-моделей с уменьшенной задержкой, помимо быстрого инференса позволяет анализировать сложные документы и безопасно обрабатывать и хранить конфиденциальные данные. Основанный в прошлом году стартап TensorWave, в отличие от большинства участников рынка ИИ, использующих ускорители NVIDIA, делает ставку на ускорители AMD Instinct. Разворачивать системы на базе MI300X стартап начал этой весной. Ускоритель MI300X также получил достаточно широкое распространение среди ряда облачных провайдеров. В частности, его использует Microsoft для обслуживания ИИ-модели OpenAI GPT-4 Turbo и многих сервисов Copilot. Oracle готова развернуть кластер из 16 384 MI300X. Также облачный стартап Vultr начал предлагать инстансы на базе MI300X. MI300X имеет больше памяти, чему у того же NVIDIA H100 — 192 Гбайт против 80 Гбайт. С выпуском ускорителей следующего поколения MI325X в конце этого года AMD ещё больше увеличит преимущество, поскольку ёмкость HBM3e-памяти ускорителя вырастет до 288 Гбайт. Это втрое больше, чем у H100, и наполовину больше, чем у будущих ускорителей NVIDIA Blackwell, говорит компания. Больший объём памяти особенно ценен для тех, кто запускает крупные ИИ-модели в FP16-формате. При 1536 Гбайт на узел система на базе MI300X может легко вместить модель Llama 3.1 405B от Meta✴, тогда как при использовании ускорителей H100 для этого её придётся разделить между несколькими системами или ужать с помощью 8-бит квантования. Можно также «втиснуть» несжатую модель в один узел с ускорителями NVIDIA H200, но тогда не останется достаточно места для большего контекстного окна, поддерживаемого моделью.

09.10.2024 [12:44], Алексей Степин

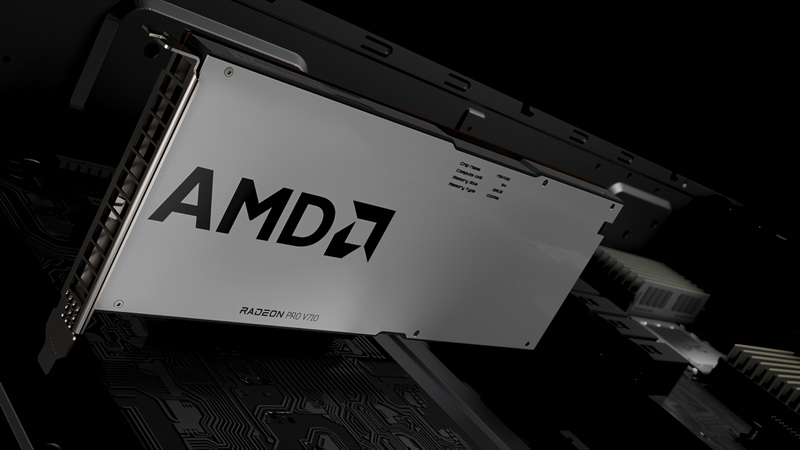

AMD анонсировала ускоритель Radeon PRO V710 для облака Microsoft AzureПосле долгого затишья обновилась серия графических ускорителей AMD Radeon PRO — Advanced Micro Devices представила Radeon PRO V710, созданный специально по заказу Microsoft для размещения в облаке Azure. Новинка характеризуется немалым для своего класса объёмом видеопамяти — она несёт на борту целых 28 Гбайт, то есть, больше, чем у всех сегодняшних игровых GPU, включая GeForce RTX 4090 и Radeon RX 7900 XTX. При этом AMD Radeon PRO V710 не является вычислительным ускорителем в чистом виде, хотя и способен развивать 27,7 Тфлопс в режиме FP16 и 55,3 Топс в режиме INT8 на частоте 2 ГГц. В состав 5-нм новинки, состоящей из 28,1 млрд транзисторов, входят 3456 потоковых процессора, сгруппированных в 54 вычислительных блока RDNA 3. Реализована поддержка аппаратного ускорения трассировки лучей.

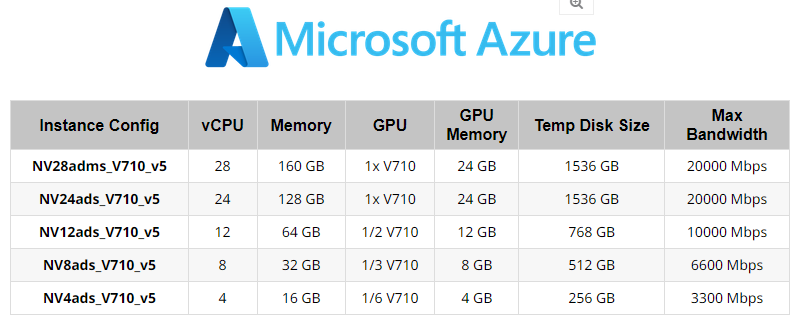

Источник здесь и далее: AMD Памяти, как уже отмечалось, новинка получила 28 Гбайт. Это GDDR6 ECC с 224-битной шиной, обеспечивающей пропускную способность 448 Гбайт/с. При этом 4 Гбайт этой памяти всегда используются для системных нужд, так что пользовательским задачам доступно лишь 24 Гбайт. Графический процессор располагает также 54 Мбайт быстрого кеша AMD Infinity Cache.  Технически Radeon PRO V710 представляет собой полноразмерную плату расширения PCIe 4.0 x16 одинарной высоты с пассивным охлаждением. При теплопакете 158 Вт адаптер полностью полагается на систему охлаждения сервера. Поскольку это, по сути, заказное решение, приобрести отдельно данный ускоритель будет нельзя, а в условиях ЦОД проблем с охлаждением быть не должно, к тому же, частота GPU намеренно ограничена планкой 2 ГГц.  Главной сферой применения Radeon PRO V710 станет его применение в облачных сценариях класса Desktop-as-a-Service и Workstation-as-a-Service, то есть для запуска виртуальных рабочих сред. Набортный кодировщик видео поддерживает сжатие в форматах AV1, HEVC H.265 и AVC H.264. Также озвучены сценарии облачного гейминга и применения ускорителя в инференс-системах. В последнем случае будет актуальна совместимость с AMD ROCm и наличие блоков ускорения перемножения матриц. Microsoft Azure уже анонсировала новые инстансы на основе нового ускорителя. Они поддерживают в качестве гостевых систем как Windows, так и Linux, в последнем случае обеспечена поддержка Azure Kubernetes Service. Количество виртуальных vCPU – от 4 до 28, объёмы пользовательской памяти начинаются с 16 Гбайт и достигают 160 Гбайт, а видеопамяти за счёт поддержки SR-IOV выделяется от 4 до 24 Гбайт. Минимальная ширина сетевого канала при этом составит 3,3 Гбит/с, а максимальная — 20 Гбит/с.

08.10.2024 [14:24], Руслан Авдеев

Квантовое облако — это надёжно: D-Wave анонсировала SLA для своего сервиса квантовых вычислений LeapКомпания D-Wave анонсировала соглашения об уровне обслуживания (SLA) для своего облачного квантового сервиса Leap, что косвенно говорит о желании компании заявить о высоком уровне доступности, надёжности и масштабируемости своих услуг и возможности предоставлять квантовые сервисы коммерческого уровня. Точные условия SLA для Leap не разглашаются, но D-Wave говорит о работоспособности и доступности системы на уровне 99,9 %, при этом время решения задач не превышает 1 с даже в случае больших вычислительных нагрузок. Запущенный в 2018 году сервис Leap обеспечивает облачный доступ в режиме реального времени к квантовым компьютерам D-Wave, работающим в режиме реального времени и использующим технологию т.н. «квантового отжига». В D-Wave утверждают, что в последние два года сервис покзала доступность выше 99,9 % и Solver API, и кластера квантовых компьютеров компании. С момента запуска сервиса Leap клиенты выполнили около 200 млн задач без необходимости предварительного бронирования, ожидания в очереди или попадания в ситуацию недоступности оборудования. В том числе за последние 12 месяцев были поданы 60 млн задач. Как заявляют в компании, с ускорением перехода к коммерческому внедрению квантовых технологий обеспечение бесперебойного доступа к квантовому облаку как никогда важно. SLA разработано именно для того, чтобы поддерживать динамичный переход, способствующий процветанию бизнеса. Большинство провайдеров квантовых вычислений предлагают доступ посредством облачных порталов — или собственных, или созданных в партнёрстве с крупными облаками. При этом уровень доступности таких сервисов пока что гораздо ниже, чем у практически любого другого облачного сервиса, отмечает DataCenter Dynamics. Квантовые системы весьма чувствительны к окружению, где они работают, а из-за своей технической сложности весьма медленно ремонтируются. Кроме того, число квантовых компьютеров ограничено, поэтому задачи клиентов часто приходится выстраивать в очередь. Как заявляют эксперты IDC, интеграция квантовых вычислений в общую IT-инфраструктуру компаний требует использования систем, готовых обеспечить некоторые гарантии на работу в режиме реального времени, вроде SLA. Необходим такой же уровень обслуживания, который предоставляется сегодня, например, SaaS. Впрочем, у D-Wave пока немало проблем. На сегодня компании грозит делистинг с Нью-Йоркской фондовой биржи — акции компании котируются очень низко.

08.10.2024 [12:36], Сергей Карасёв

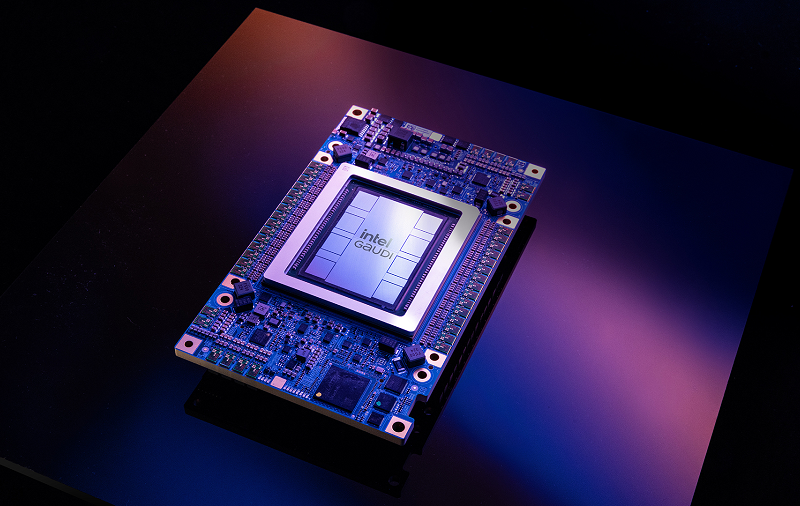

Inflection AI и Intel представили ИИ-систему на базе Gaudi3Стартап Inflection AI и корпорация Intel объявили о сотрудничестве с целью ускорения внедрения ИИ в корпоративном секторе. В рамках партнёрства состоялся анонс Inflection for Enterprise — первой в отрасли ИИ-системы корпоративного класса на базе ускорителей Intel Gaudi3 и облака Intel Tiber AI Cloud (AI Cloud). Inflection AI основана в 2022 году Мустафой Сулейманом (Mustafa Suleyman), одним из основателей Google DeepMind, а также Ридом Хоффманом (Reid Hoffman), одним из учредителей LinkedIn. Стартап специализируется на технологиях генеративного ИИ. В середине 2023 года Inflection AI получила на развитие $1,3 млрд: в число инвесторов вошли Microsoft и NVIDIA. Inflection for Enterprise объединяет Gaudi3 с большой языковой моделью (LLM) Inflection 3.0. Утверждается, что это ПО при использовании на аппаратной платформе Intel демонстрирует вдвое более высокую экономическую эффективность по сравнению с некоторыми конкурирующими изделиями. Заказчики получат LLM, настроенную в соответствии с их пожеланиями. Для удовлетворения потребностей каждого конкретного клиента применяется обучение с подкреплением на основе отзывов людей (RLHF). При этом используются данные, предоставленные самим заказчиком.

Источник изображения: Intel Отмечается, что облако AI Cloud упрощает создание, тестирование и развёртывание ИИ-приложений в единой среде, ускоряя время выхода продуктов на рынок. Тонко настроенные ИИ-модели доступны исключительно клиенту и не передаются в третьи руки. На первом этапе системы Inflection for Enterprise будут предлагаться через облако AI Cloud. В I квартале 2025 года планируется организовать поставки программно-аппаратных комплексов.

07.10.2024 [12:19], Сергей Карасёв

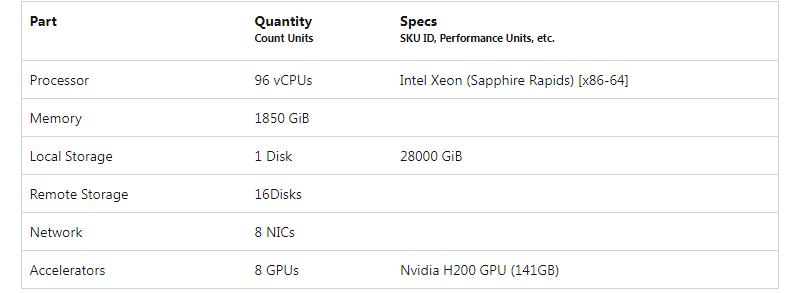

В облаке Microsoft Azure появились инстансы ND H200 v5 на базе NVIDIA H200В августе 2023 года Microsoft развернула в своём облаке Azure инстансы ND H100 v5 на базе NVIDIA H100 для HPC-вычислений и нагрузок ИИ. А теперь запущены машины ND H200 v5 с ускорителями NVIDIA H200, оптимизированные для инференса и обучения больших языковых моделей (LLM). Новые инстансы объединяют восемь ускорителей NVIDIA H200, каждый из которых содержит 141 Гбайт памяти HBM3e с пропускной способностью 4,8 Тбайт/с. По сравнению с NVIDIA H100 объём памяти увеличился на 76 %, пропускная способность — на 43 %. Для ND H200 v5 предусмотрена возможность масштабирования до тысяч ускорителей при помощи интерконнекта на базе NVIDIA Quantum-2 CX7 InfiniBand с пропускной способностью до 400 Гбит/с в расчёте на ускоритель (до 3,2 Тбит/с на виртуальную машину). В составе инстансов задействованы чипы Intel Xeon поколения Sapphire Rapids: каждая виртуальная машина насчитывает 96 vCPU. Объём памяти составляет 1850 Гбайт, вместимость локального хранилища — 28 000 Гбайт. Обеспечивается доступ к 16 облачным накопителям. Кроме того, используются восемь сетевых адаптеров (суммарно до 80 Гбит/c).

Источник изображения: Microsoft Виртуальные машины ND H200 v5 имеют предварительную интеграцию с Azure Batch, Azure Kubernetes Service, Azure OpenAI Service и Azure Machine Learning. Говорится, что инстансы обеспечивают высокую производительность при решении различных задач, связанных с ИИ, машинным обучением и аналитикой данных. |

|