Материалы по тегу: nvidia

|

17.10.2023 [23:59], Владимир Мироненко

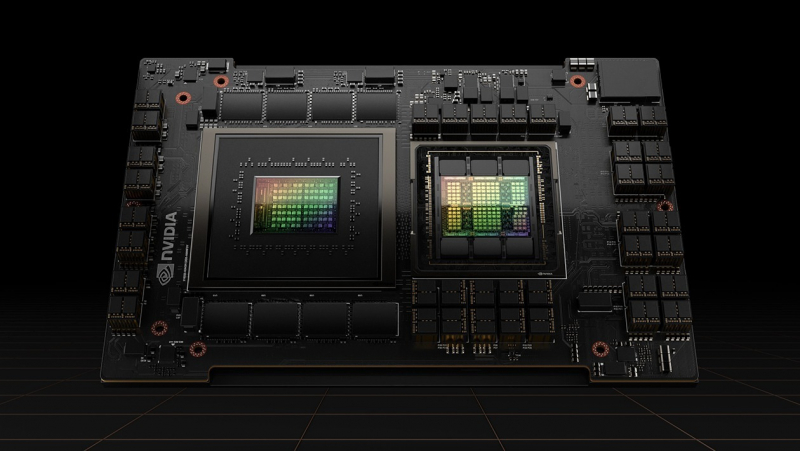

США ввели новые ограничения на поставку передовых чипов NVIDIA в Китай — рынок отреагировал падением акцийСША ввели новые ограничения на поставку чипов NVIDIA в Китай, которые теперь распространяются на ускорители A800 и H800, представляющие собой модифицированные версии A100 и H100, созданные компанией с учётом санкционных требований после объявленного в октябре прошлого года запрета на поставку последних в Поднебесную. Под запрет также попали ускорители L40/L40S и даже игровые RTX 4090. Как сообщает Bloomberg, новые экспортные правила США, опубликованные во вторник, направлены на то, чтобы помешать Китаю получить доступ к передовым технологиям для их военного использования. Касаются ли новые правила урезанных решений Intel и AMD, не уточняется. Также было объявлено о пополнении «чёрного списка» двумя китайскими стартапами по производству ИИ-чипов Shanghai Biren Intelligent Technology Co., который ухудшил характеристики своих ускорителей, чтобы не попасть под санкции, и Moore Threads Intelligent Technology Beijing Co и их дочерними компаниями, для поставки которым теперь придётся получать лицензию правительства США. На рассмотрение запросов отводится 25 дней. Эти стартапы считаются потенциальными конкурентами NVIDIA. Shanghai Biren выразила протест по поводу этого решения, и призвала Министерство торговли США его пересмотреть. За день до этого, в понедельник, выступая на очередном брифинге для прессы в Пекине, пресс-секретарь министерства иностранных дел Китая Мао Нин (Mao Ning) заявила, что КНР выступает против, чтобы США политизировали и превращали в оружие вопросы торговли и технологии.

Источник изображения: NVIDIA Комментируя решение, представитель NVIDIA отметил, что учитывая мировой спрос на продукцию, компания не ожидает существенного влияния ограничений на финансовые результаты в ближайшем будущем. Однако рынок уже утром отреагировал на введение новых экспортных ограничений США падением акций ряда ведущих производителей чипов. Акции NVIDIA упали примерно на 6 %, Broadcom — на 3,5 %. Marvell и Intel — 3,3 и 3,5 % соответственно. Bloomberg отметил, что обновлённые ограничения в целом допускают продажу передовых коммерческих чипов китайским компаниям для использования в потребительских продуктах, таких как смартфоны, компьютеры и электромобили, но ограничивают возможность поставки передовых ИИ-чипов, которые могут использоваться в ЦОД. Администрация Байдена также ввела лицензию на продажу чипов более чем 40 странам, которые могут использоваться китайскими фирмами в качестве посредников для обхода контроля США. Кроме того, заявлено о расширении перечня оборудования для производства чипов, подпадающего под экспортные ограничения по поставке в Китай, хотя конкретные наименования всё ещё согласуются с Нидерландами, где базируется ASML Holding NV. Сама ASML заявила, что новые правила будут применяться к «ограниченному числу» заводов в Китае, связанных с передовым производством полупроводников. Вместе с тем, обновлённые правила пока не включают ограничения на доступ к облачным сервисам компаний из США и их союзников, хотя администрация Белого дома планирует изучить потенциальные риски для национальной безопасности, связанные с этим доступом, а также варианты их потенциального устранения.

10.10.2023 [23:20], Сергей Карасёв

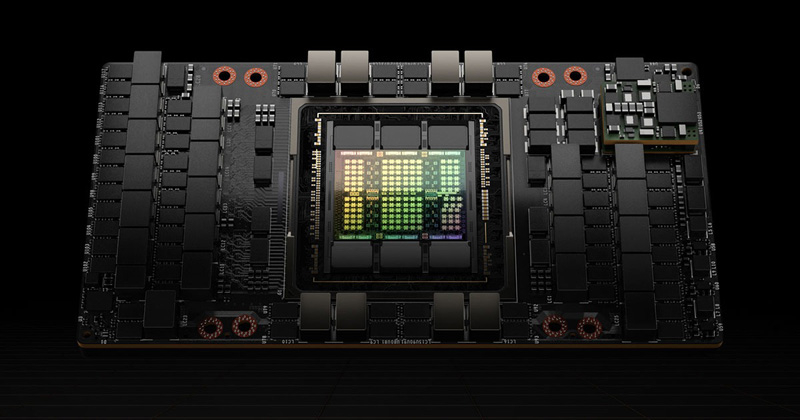

NVIDIA выпустит ускорители GB200 и GX200 в 2024–2025 гг.Компания NVIDIA, по сообщению ресурса VideoCardz, раскрыла планы по выпуску ускорителей нового поколения, предназначенных для применения в ЦОД и на площадках гиперскейлеров. NVIDIA указывает лишь ориентировочные сроки выхода решений, поскольку фактические даты зависят от многих факторов, таких как макроэкономическая обстановка, готовность сопутствующего ПО, доступность производственных мощностей и пр. В конце мая нынешнего года NVIDIA объявила о начале массового производства суперчипов Grace Hopper GH200, предназначенных для построения НРС-систем и платформ генеративного ИИ. Эти изделия содержат 72-ядерный Arm-процессор NVIDIA Grace и ускоритель NVIDIA H100 с 96 Гбайт памяти HBM3. Как сообщается, ориентировочно в конце 2024-го или в начале 2025 года на смену Grace Hopper GH200 придет решение Blackwell GB200. Характеристики изделия пока не раскрываются. Но отмечается, что архитектура Blackwell будет применяться как в ускорителях для дата-центров, так и в потребительских продуктах для игровых компьютеров (предположительно, серии GeForce RTX 50). На 2025 год, согласно обнародованному графику, намечен анонс загадочной архитектуры «Х». Речь, в частности, идёт о решении с обозначением GX200. Изделия GB200 и GX200 подойдут для решения задач инференса и обучения моделей. Примечательно, что старшие чипы также получат NVL-версии. Вероятно, вариант GH200 с увеличенным объёмом набортной памяти как раз и будет называться GH200NVL.

Источник изображения: NVIDIA При этом теперь компания разделяет продукты на Arm- и x86-направления. Первое, судя по всему, так и будет включать гибридные решения GB200 и GX200, а второе, вероятно, вберёт в себя в первую очередь ускорители в форм-факторе PCIe-карт и универсальные ускорители начального уровня серии 40: B40 и X40. Сопутствовать новым чипам будут сетевые решения Quantum (InfiniBand XDR/GDR) и Spectrum-X (Ethernet) классов 800G и 1600G (1.6T). И если в области InfiniBand компания фактически является монополистом, то в Ethernet-сегменте она несколько отстаёт от, например, Broadcom, у которой теперь есть даже выделенные ИИ-решения, Cisco и Marvell. А вот про будущее NVLink компания пока ничего не рассказала.

06.10.2023 [01:01], Владимир Мироненко

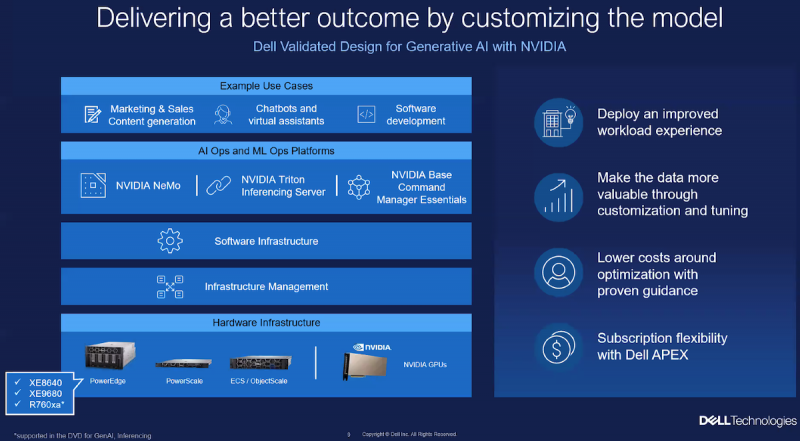

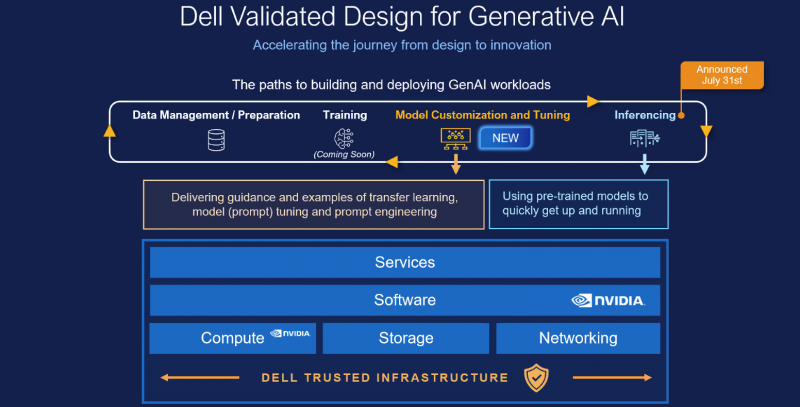

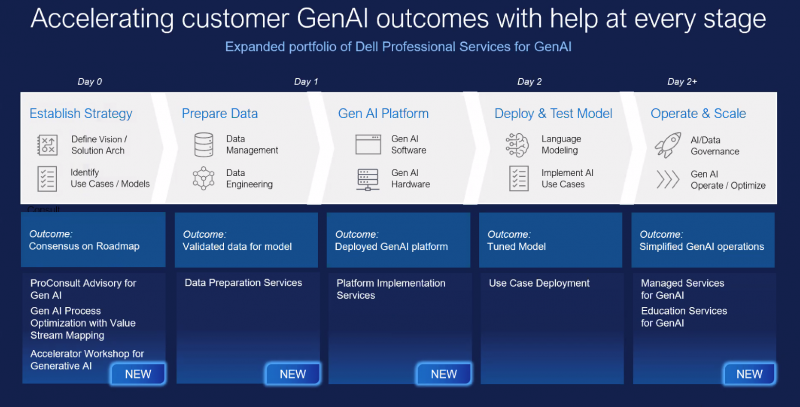

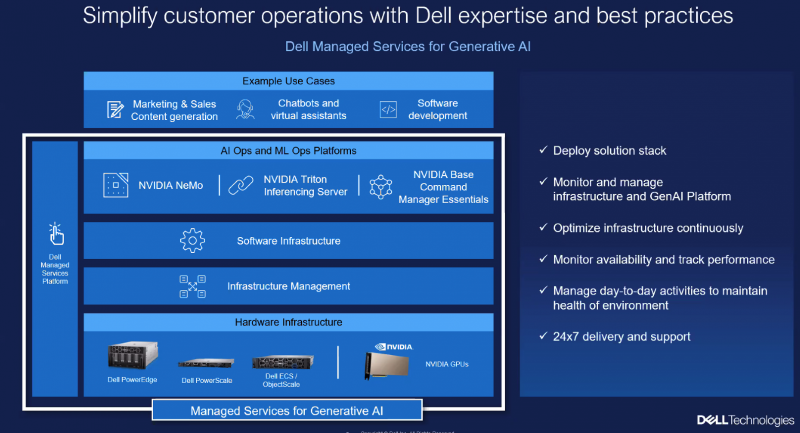

Dell расширила набор комплексных решений и сервисов для «локализации» генеративного ИИDell объявила о расширении портфеля решений Dell Generative AI Solutions с целью поддержки компаний в трансформации методов работы с генеративным искусственным интеллектом (ИИ). Первоначально в разработанном совместно с NVIDIA решении Dell Validated Design for Generative AI основное внимание уделялось обучению ИИ, но теперь продукт также поддерживает тюнинг моделей и инференс. Это, в частности, означает, что у клиентов есть возможность развёртывать модели в собственных ЦОД, передаёт StorageReview. Dell Validated Design for Generative AI with NVIDIA for Model Customization предлагает предварительно обученные модели, которые извлекают знания из данных компания без необходимости создания моделей с нуля и обеспечивают безопасность информации. Благодаря масштабируемой схеме тюнинга у организаций теперь есть множество способов адаптировать модели генеративного ИИ для выполнения конкретных задач с использованием своих собственных данных. Инфраструктура базируется на GPU-серверах Dell PowerEdge XE9680 и PowerEdge XE8640 с ускорителями NVIDIA, стеком NVIDIA AI Enterprise и фирменным ПО Dell. Компания позиционирует это как идеальное решение для компаний, которые хотят создавать генеративные ИИ-модели, сохраняя при этом безопасность своих данных на собственных серверах. Для хранения данных предлагаются различные конфигурации Dell PowerScale и Dell ObjectScale. Доступ к этой инфраструктуре также возможен по подписке в рамках Dell APEX. Dell также расширила портфолио профессиональных сервисов. Так, появились сервисы по подготовке данных (Data preparation Services), разработанные специально для предоставления клиентам тщательно подготовленных, очищенных и корректно отформатированных наборов данных. А с помощью сервисов по внедрению (Dell Implementation Services) для компании в короткие сроки создадут полностью готовую платформу генеративного ИИ, оптимизированную для инференса и подстройки моделей. Dell также предлагает новые образовательные сервисы (Education Services) для клиентов, которые хотят обучить своих сотрудников современным ИИ-технологиям. Наконец, было объявлено о партнёрстве Dell и Starburst, в рамках которого Dell интегрирует платформы PowerEdge и СХД с аналитическим ПО Starburst, чтобы помочь клиентам создать централизованное хранилище данных и легче извлекать необходимую информацию из своих данных. Энди Турай (Andy Thurai), вице-президент и главный аналитик Constellation Research, сообщил в интервью SiliconANGLE, что наиболее мощные LLM, такие как GPT-4, обучаются в специально созданных облачных окружениях из-за их огромных размеров и требований к ресурсам. Вместе с тем некоторые компания ищут способы обучения своих собственных, гораздо меньших по размеру LLM в локальных средах. Турай отметил, что Dell потребуется время, чтобы добиться каких-либо успехов в «локализации» генеративного ИИ, поскольку настройка инфраструктуры, перемещение подгтовка данных — занятие не для слабонервных. Как сообщается, решение Dell Validated Design for Generative AI with NVIDIA for Model Customization будет доступно глобально позже в октябре. Профессиональные сервисы появятся тогда же, но только в некоторых странах. А решение Dell для озера данных на базе Starburst станет глобально доступно в I половине 2024 года. Фактически новые решения Dell являются развитием совместной с NVIDIA инициативы Project Helix.

05.10.2023 [21:30], Сергей Карасёв

Британская NexGen Cloud вложит $1 млрд в создание европейского ИИ-супероблака из 20 тыс. NVIDIA H100Британская компания NexGen Cloud, по сообщению ресурса Datacenter Dynamics, намерена инвестировать $1 млрд в проект AI Supercloud: речь идёт о развёртывании так называемого ИИ-супероблака в Европе. Создание платформы начнётся в текущем месяце. NexGen Cloud уже оформила заказы на оборудование на сумму приблизительно $576 млн. В полностью завершённом виде система объединит 20 тыс. ускорителей NVIDIA H100. Завершение создания платформы запланировано на июнь 2024 года. Доступ к системе будет предоставляться через гиперстек NexGen Cloud. Ресурсы AI Supercloud будут доступны предприятиям и государственным заказчикам, которые должны оставаться в европейской юрисдикции. Предполагается, что супероблако позволит клиентам решать ресурсоёмкие задачи ИИ, оставаясь конкурентоспособными на глобальном рынке.

Источник изображения: NVIDIA Проект финансируется благодаря партнёрству NexGen Cloud и Moore and Moore Investments Group (MMI) за счёт средств частных инвесторов. Отмечается, что NexGen Cloud является участником партнёрской сети NVIDIA. Компания, основанная в 2020 году, предоставляет услуги по модели «инфраструктура как сервис» (IaaS): заказчикам предлагаются высокопроизводительные решения для облачных вычислений на базе GPU.

05.10.2023 [13:06], Сергей Карасёв

ИИ-провайдер 6Estates развернул свою первую систему NVIDIA DGX BasePOD на базе DGX H100Компания 6Estates, сингапурский провайдер ИИ-решений для корпоративных заказчиков, объявила о развёртывании первой системы NVIDIA DGX BasePOD на основе DGX H100. Кластер будет применяться для решения ресурсоёмких задач в области ИИ. Фирма 6Estates, созданная на базе Национального университета Сингапура и Университета Цинхуа, специализируется на предоставлении предприятиям решений, использующих LLM. Кроме того, 6Estates является участником программы NVIDIA Inception по поддержке стартапов в области ИИ. DGX BasePOD — это референсная архитектура, которая объединяет вычислительные мощности, сетевые инструменты, СХД, необходимое ПО и другие компоненты в интегрированную ИИ-инфраструктуру на основе NVIDIA DGX. 6Estates планирует использовать BasePOD на базе DGX H100 для своего нового предложения Model Solutions, которое даёт предприятиям возможность создавать персонализированные LLM и приложения для конкретных задач. Кроме того, 6Estates получит доступ к комплексному пакету фреймворков и ИИ-инструментов NVIDIA AI Enterprise.

Источник изображения: 6Estates Используя DGX H100, 6Estates существенно сократит время обучения моделей и обеспечит более быстрое предоставление услуг Model Solutions корпоративным клиентам. Кластер также будет поддерживать существующие решения 6Estates в области ИИ, в частности, специализированную платформу, которая автоматизирует обработку и анализ неструктурированных документов без шаблонов, а также автоматизирует рабочие процессы для кредиторов и торговых компаний.

05.10.2023 [13:00], Сергей Карасёв

Первый европейский суперкомпьютер экзафлопсного класса Jupiter получит Arm-чипы SiPearl Rhea и ускорители NVIDIAЕвропейское совместное предприятие по развитию высокопроизводительных вычислений (EuroHPC JU) заключило контракт на создание НРС-комплекса Jupiter с консорциумом, в который входят Eviden (подразделение IT-услуг французской корпорации Atos) и ParTec, немецкая компания по производству суперкомпьютерного оборудования. Проект Jupiter был анонсирован ещё в июне 2022 года. Речь идёт о создании первого в Европе суперкомпьютера экзафлопсного класса. Система расположится в Юлихском исследовательском центре (FZJ) в Германии. В основу ляжет специализированная модульная архитектура на базе платформы Eviden BullSequana XH3000 с прямым жидкостным охлаждением. По оценкам, общая стоимость проекта составит €273 млн, включая доставку, установку и обслуживание Jupiter. Половина средств поступит непосредственно от EuroHPC JU, а остальная часть — от Федерального министерства образования и исследований Германии и Министерства культуры и науки земли Северный Рейн-Вестфалия. Eviden полагает, что создание суперкомпьютера обойдётся суммарно в €500 млн с учётом затрат на производство системы и её эксплуатацию в течение пяти лет. Строительство НРС-комплекса стартует в начале 2024 года.

Источник изображения: europa.eu Полностью характеристики Jupiter пока не раскрываются. Но говорится, что суперкомпьютер будет состоять из высокомасштабируемого блока ускорителей (Booster) и тесно связанного с ним кластера общего назначения (Cluster). В состав первого войдут неназванные ускорители NVIDIA и решения Mellanox. Говорится об использовании более 260 км высокопроизводительных кабелей, что обеспечит пропускную способность сети свыше 2000 Тбит/с. В свою очередь, модуль Cluster получит энергоэффективные высокопроизводительные Arm-процессоры SiPearl Rhea, которые специально разработаны для европейских суперкомпьютеров. Ожидается, что производительность Jupiter превысит 1 Эфлопс. Для сравнения: в нынешнем рейтинге TOP500 самым быстрым европейским суперкомпьютером является Lumi в Финляндии. Этот комплекс занимает в списке третье место с быстродействием 309,1 Пфлопс (пиковый показатель достигает 428,7 Пфлопс). Таким образом, Jupiter превзойдёт Lumi по производительности более чем в три раза. Выбор EuroHPC JU в пользу Arm-процессоров SiPearl Rhea — разочарование для AMD и Intel. В частности, Intel в 2022 году объявила о намерении инвестировать €33 млрд в создание исследовательских центров и производственных объектов на территории Европы, включая Германию, Францию, Ирландию, Италию, Польшу и Испанию. Модульная конструкция Jupiter предполагает, что в будущем к системе могут быть добавлены дополнительные узлы, в частности, на процессорах х86, но пока о таких планах ничего не говорится. В любом случае Европа стремится к аппаратной независимости, а поэтому выбор чипов Rhea для Jupiter не является неожиданным. Как и все суперкомпьютеры EuroHPC, комплекс Jupiter будет доступен широкому кругу пользователей в научном сообществе, промышленности и государственном секторе на территории Европы. Мощности системы планируется использовать для задач ИИ, высокоточного моделирования, медицинских исследований, изучения глобальных изменений климата, разработки передовых материалов и других ресурсоёмких задач.

04.10.2023 [14:59], Сергей Карасёв

Без гиперскейлеров: NVIDIA хочет арендовать ЦОД для облачного сервиса DGX CloudКомпания NVIDIA, по сообщению ресурса The Information, ведёт переговоры об аренде площадей у одного из операторов ЦОД, но о ком именно идёт речь, не сообщается. Предполагается, что площадка будет использоваться для поддержания работы собственного облачного сервиса DGX Cloud, предназначенного для обучения передовых моделей для генеративного ИИ. О доступности облака DGX Cloud компания NVIDIA объявила в июле нынешнего года. Тогда сообщалось, что соответствующая вычислительная инфраструктура достанется в первую очередь США и Великобритании. Стоимость доступа к DGX Cloud начинается с $36 999 в месяц. Говорилось, что NVIDIA намерена продвигать DGX Cloud в партнёрстве с ведущими гиперскейлерами. Первым сервис появился в облаке Oracle Cloud Infrastructure (OCI), на очереди Microsoft Azure, Google Cloud Platform и другие. Большая часть выручки в этом случае достаётся именно NVIDIA, а не облакам.

Источник изображения: NVIDIA Теперь же, судя по всему, NVIDIA решила частично отказаться от услуг облачных провайдеров и развернуть DGX Cloud на арендованных ЦОД-площадях. Впрочем, как отмечается, переговоры всё ещё находятся на начальной стадии, а поэтому говорить о том, что NVIDIA сама превратится в гиперскейлера, преждевременно. При этом компания неоднократно упрекали в том, что в последнее время она более благосклонна к небольшим и специализированным облачным провайдерам, которые не пытаются создавать собственные ИИ-ускорители, могущие составить прямую конкуренцию продуктам NVIDIA.

03.10.2023 [17:09], Руслан Авдеев

Microsoft: приобрести ИИ-ускорители NVIDIA становится всё проще и прощеКак заявил недавно на конференции Code Conference технический директор Microsoft Кевин Скотт (Kevin Scott), приобрести ускорители компании NVIDIA для ИИ и HPC-вычислений уже не так сложно, как ещё несколько месяцев назад. По данным портала Tom’s Hardware, проблема доступности и поставок активно решается производителем. По словам того же Скотта, ещё не так давно спрос намного превышал предложение всех производителей ускорителей. Хотя дефицит ещё не исчез, ситуация улучшается буквально с каждой неделей. В последнее время драйвером огромного спроса на ускорители были техногиганты, включая Microsoft, активно осваивающие рынок ИИ-продуктов, в том числе для сторонних клиентов. Для тренировки больших языковых моделей (LLM), обычно используются ускорители именно NVIDIA, в результате чего спрос на них в 2023 году стремительно взлетел, а рост стоимости акций «зелёных» с начала года составил 190 %. В ходе недавнего отчёта о доходах NVIDIA сообщила о намерении повысить объёмы поставок в следующем году. Параллельно появилась информация о том, что трафик одного из самых популярных чат-ботов, ChatGPT от OpenAI, существенно падал в течение трёх месяцев подряд. OpenAI использует облачную платформу Microsoft Azure, так что нагрузка на неё в последнее время не столь велика. По словам Скотта, занимающегося в числе прочего и распределением ресурсов, эта задача в последние кварталы была чрезвычайно трудной, но теперь выполнять свои обязанности стало намного легче. Скотт не стал комментировать слухи о том, что Microsoft якобы разрабатывает собственные ИИ-чипы, но подтвердил, что компания прилагает немалые усилия в работе над полупроводниковыми проектами и инвестировала в них немало средств. При этом он признал, что в последние годы NVIDIA остаётся ведущим партнёром Microsoft в ИИ-секторе, но подчеркнул, что компания будет выбирать наилучшие решения для своих систем, какое бы происхождение они ни имели.

30.09.2023 [16:02], Сергей Карасёв

ИИ за углом: Cloudflare внедрит ускорители NVIDIA в своей глобальной edge-сетиАмериканская компания Cloudflare, предоставляющая услуги CDN, по сообщению Datacenter Dynamics, будет использовать ускорители NVIDIA в своей глобальной edge-сети для обработки ресурсоёмких нагрузок ИИ, в частности, больших языковых моделей (LLM). Как отмечает ресурс NetworkWorld, инициатива носит название Workers AI. Заказчики смогут получать доступ к мощностям устройств NVIDIA для реализации своих ИИ-проектов. Cloudflare также задействует коммутаторы NVIDIA Ethernet и полный набор софта NVIDIA для инференса, включая TensorRT-LLM и Triton Inference. Поначалу не планируется поддержка пользовательских ИИ-моделей: клиентам будет предоставляться доступ только к Meta✴ Llama 2 7B и M2m100-1.2, OpenAI Whisper, Hugging Face Distilbert-sst-2-int8, Microsoft Resnet-50 и Baai bge-base-en-v1.5. В будущем этот перечень планируется расширять. О моделях ускорителей, которые возьмёт на вооружение Cloudflare, ничего не говорится. Но отмечается, что к концу 2023 года решения NVIDIA будут внедрены более чем в 100 городах, а в течение 2024-го они появятся почти во всех зонах присутствия Cloudflare. Глобальная edge-сеть компании использует ЦОД более чем в 300 городах по всему миру.

Источник изображения: NVIDIA Ещё одной новой инициативой Cloudflare в области ИИ является Vectorize — векторная база данных. Она поможет разработчикам создавать приложения на основе ИИ полностью на платформе Cloudflare. Говорится, что Vectorize получит интеграцию с Workers AI. Наконец, готовится AI Gateway — система оптимизации и управления производительностью, предназначенная для работы с ИИ-приложениями, развёрнутыми в сети Cloudflare.

29.09.2023 [22:57], Руслан Авдеев

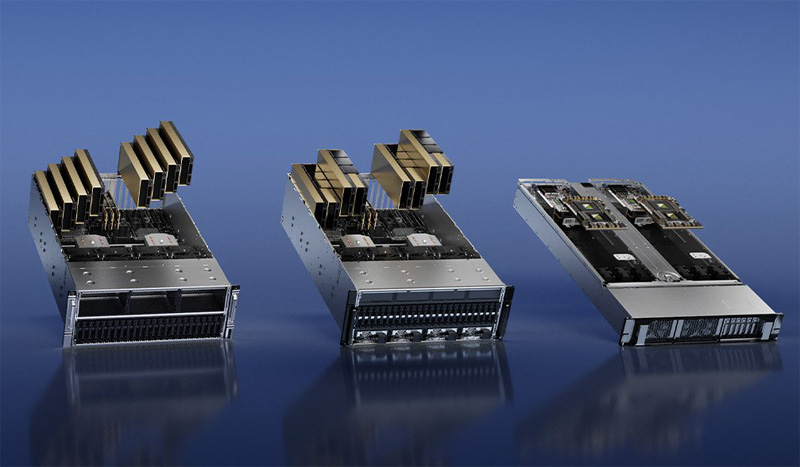

Французская iliad Group приобрела ИИ-кластер NVIDIA DGX SuperPOD из 1016 ускорителей H100 и задумала создать универсальный ИИФранцузская ГК iliad Group заявила о приобретении системы NVIDIA DGX SuperPOD для предоставления участникам европейского рынка IT «самого мощного» в регионе облачного ИИ-суперкомпьютера, включающего 1016 ускорителей H100 (127 систем DGX последнего поколения). За покупку отвечал облачный провайдер Scaleway, а сама машина разместилась в ЦОД Datacenter 5 в окрестностях Парижа. Это только первый шаг компании на пути к достижению краткосрочной цели по предоставлению новых вычислительных мощностей клиентам. Для того, чтобы удовлетворить любые запросы клиентов, Scaleway обеспечила предоставление вычислительных мощностей небольшими блоками, по паре связанных серверов DGX H100 в каждом. В ближайшие месяцы Scaleway продолжит наращивать вычислительные способности платформы. Кроме того, iliad анонсировала создание в Париже ИИ-лаборатории, в которую уже инвестировано более €100 млн. Её главой стал миллиардер Ксавье Ниль (Xavier Niel), фактически контролирующий iliad Group. Лаборатория, как сообщается, привлекла известных исследователей из крупнейших международных компаний. Основной целью лаборатории станет помощь в создании универсального ИИ, а результаты исследований в этом направлении будут доступны публично. |

|