Материалы по тегу: 100gbe

|

10.10.2025 [12:00], Сергей Карасёв

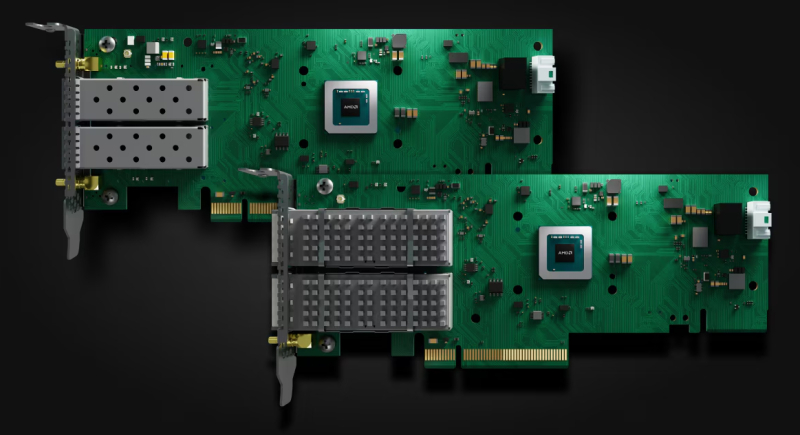

AMD представила Ethernet-адаптеры Solarflare X4 со сверхнизкой задержкойКомпания AMD анонсировала Ethernet-адаптеры Solarflare X4 для систем, в которых критическое значение имеет минимальная задержка. Это могут быть платформы для трейдинга, анализа финансовых данных в реальном времени и других задач, где, как подчеркивается, важна каждая наносекунда. В семейство Solarflare X4 вошли две модели — X4542 и X4522. По сравнению с изделиями Solarflare предыдущего поколения новинки, по заявлениям AMD, обеспечивают уменьшение задержки до 40 %. Производительность на системном уровне увеличилась на 200 % по отношению к адаптерам Solarflare X2. Обе новинки выполнены в виде низкопрофильных карт расширения половинной длины с интерфейсом PCIe 5.0 x8. В основу положена кастомизированная ASIC, обеспечивающая сверхнизкие задержки. AMD уверяет, что при использовании адаптеров в связке с процессорами EPYC 4005 Grado достигается снижение задержки до 12 % по сравнению с аналогичными по классу решениями конкурентов. Версия Solarflare X4542 оснащена двумя разъёмами QSFP с поддержкой двух портов 40/50/100GbE или четырёх портов 1/10/25GbE. Модификация Solarflare X4522, в свою очередь, получила два разъёма SFP с поддержкой пары портов 1/10/25/50GbE. Карты оснащены пассивным охлаждением. Энергопотребление составляет менее 25 Вт. Для адаптеров доступно фирменное ПО AMD Solarflare Onload, которое отвечает за повышение производительности при работе с ресурсоёмкими сетевыми приложениями, такими как резидентные базы данных, программные балансировщики нагрузки и веб-серверы. Solarflare Onload помогает поднять эффективность обработки огромных объёмов небольших пакетов данных — даже в периоды пиковой нагрузки. AMD отмечает, что 9 из 10 крупнейших мировых фондовых бирж используют решения Solarflare для обеспечения работы своих торговых платформ.

12.07.2025 [15:13], Сергей Карасёв

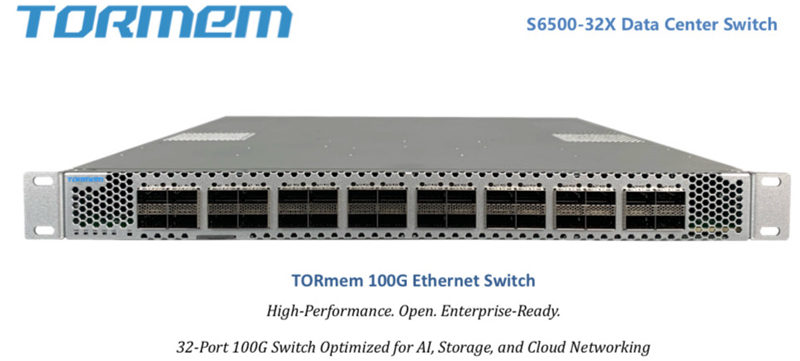

От 100GbE до 800GbE, недорого: стартап TORmem обещает трансформировать рынок ЦОД-коммутаторовСтартап TORmem, специализирующийся на решениях для дезагрегации памяти в дата-центрах, обнародовал планы по выпуску коммутаторов для сетей с высокой пропускной способностью. В семейство войдут модели с поддержкой стандартов от 100GbE до 800GbE. По утверждениям TORmem, она потратила четыре года на разработку «революционной технологии дезагрегации», которая позволяет реализовывать концепцию вычислений в оперативной памяти (IMC) в масштабах ЦОД. Полученный опыт стартап намерен использовать для решения другой проблемы современных дата-центров — высокой стоимости корпоративной сетевой инфраструктуры. TORmem обещает трансформировать сегмент коммутаторов корпоративного класса, выпустив высокопроизводительные устройства по цене в два раза меньше по сравнению с аналогичными решениями, уже представленными на рынке. В частности, TORmem предлагает для заказа модель стандарта 100GbE (S6500-32X) с 32 портами на основе ASIC Marvell: устройство стоит $7 тыс. против $14 тыс. или более у «стандартных продуктов», говорит компания.

Источник изображений: TORmem В конце текущего года стартап намерен подготовиться к началу производства коммутаторов 200GbE/400GbE, которые, как ожидается, также окажутся на 50 % дешевле конкурирующих изделий: их цена составит от $12 тыс. до $20 тыс. против $25–$40 тыс., которые, как утверждается, будут просить конкуренты. Кроме того, в разработке находятся модели класса 800GbE.  На сайте Unipoe.net удалось обнаружить описание коммутатора RZ-S6500-32X. Он располагает 32 портами 40/100GbE QSFP28, а коммутируемая ёмкость достигает 6,4 Тбит/с. Устройство выполнено в форм-факторе 1U с габаритами 440 × 470 × 43 мм. Предусмотрены сетевой порт управления, консольный порт и разъём USB 2.0. В оснащение входят два блока питания и пять модульных вентиляторов с возможностью горячей замены. Максимальное энергопотребление составляет менее 650 Вт. Диапазон рабочих температур — от 0 до +40 °C. Упомянута поддержка протоколов RIP, IS-IS, RIPng, OSPFv3, BGP4+ и пр. Отраслевые аналитики прогнозируют, что объём глобального рынка высокоскоростных коммутаторов увеличится с примерно $8 млрд в 2025 году до более чем $15 млрд в 2027-м. Основным драйвером отрасли называется внедрение решений стандарта 200GbE и выше.

16.06.2025 [09:20], Владимир Мироненко

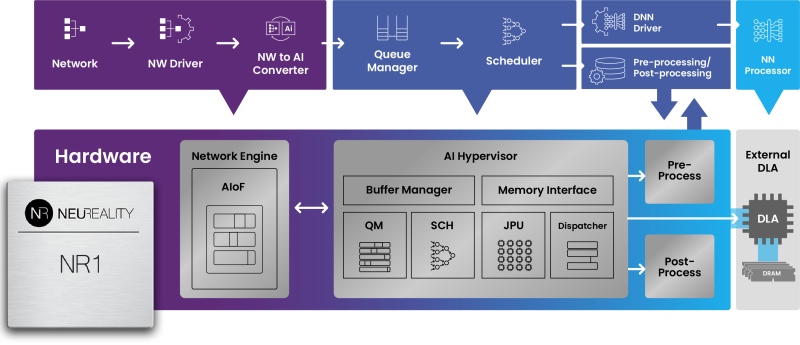

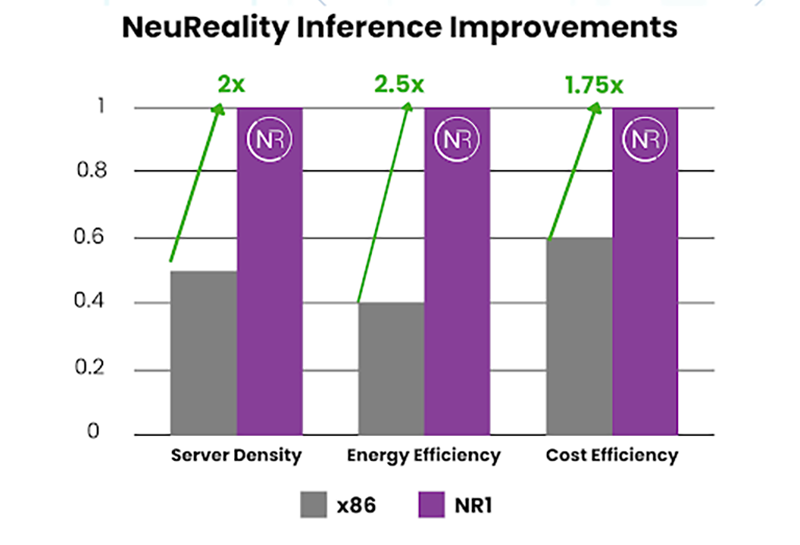

x86 не нужен: «недопроцессор» NeuReality NR1 кратно ускоряет инференс на любых GPUNeuReality объявила о выходе чипа NR1, специально созданного для оркестрации инференса, передаёт HPCwire. Он сочетается с любым GPU или ИИ-ускорителем, позволяя повысить эффективность использование GPU почти до 100 % по сравнению со средним показателем в 30–50 % при традиционном сочетании классического процессора и сетевого адаптера в современных серверах. Чип NR1 призван заменить традиционные CPU и NIC, которые являются узким местом для ИИ-нагрузок, предлагая вместе с тем шестикратное увеличение вычислительной мощности для обеспечения максимальной пропускной способности ускорителей и масштабного ИИ-инференса, утверждает разработчик. Как отметила компания, в течение многих лет разработчики развивали GPU, чтобы соответствовать требованиям ИИ, делая их быстрее и мощнее. Но традиционные CPU, разработанные для эпохи интернета, а не эпохи ИИ, в основном не менялись, становясь узким местом, поскольку ИИ-модели становятся всё более сложными, а запросы ИИ-нагрузок растут в объёме. NR1 включает все базовые функции CPU, необходимые для работы с ИИ-задачами, выделенные обработчики мультимедиа и данных, аппаратный гипервизор и комплексные сетевые IP-блоки, что обеспечивает значительно более высокую производительность, более низкое энергопотребление и окупаемость инвестиций. В тестах самой компании исполнение одной и той же модели на базе генеративного ИИ на одном и том же ИИ-ускорителе её чип NR1 позволяет получить в 6,5 раза больше токенов, чем x86-сервер при той же стоимости и энергопотреблении.  В соответствии с текущей тенденцией на разделение ресурсов хранения и вычислений, дезагрегация ИИ-ресурсов обеспечивает оптимизированную изоляцию ИИ-вычислений, отметила NeuReality. Такое разделение особенно важно в ЦОД и облаках. Традиционные программно-управляемые платформы, ориентированные на CPU, сталкиваются с такими проблемами, как высокая стоимость, энергопотребление и узкие места в системе при обработке задач ИИ-инференса. Сложность современной инфраструктуры и высокая стоимость часто ограничивают использование всех возможностей инференса, утверждает NeuReality. NR1 ориентирован на комплексную разгрузку ИИ-конвейера. Аппаратный ИИ-гипервизор отвечает за обработку путей данных и планирование заданий, охватывая механизмы пред- и постобработки данных, а также сетевой движок AI-over-Fabric. Благодаря этому достигнуто оптимальное соотношение цены и производительности и самые низкие эксплуатационные расходы, характеризующиеся низким энергопотреблением, минимальной задержкой и линейной масштабируемостью, говорит компания. Для DevOps и MLOps компания предоставляет полный SDK и сервисный слой на основе Kubernetes. Новый чип предлагается использовать для решения задач в сфере финансов и страхования, здравоохранении и фармацевтике, госуслугах и образовании, телекоммуникации, ретейле и электронной коммерции, для нагрузок генеративного и агентного ИИ, компьютерного зрения и т.д. NeuReality NR1 включает:

14.04.2025 [08:10], Владимир Мироненко

На 40 % быстрее и дешевле обычного интернета: Google предложила компаниям доступ к своей сетевой инфраструктуре планетарного масштабаGoogle объявила о запуске Cloud WAN, полностью управляемой корпоративной WAN-платформы, которая делает доступной для всех компаний и организаций всемирную сетевую инфраструктуру Google, поддерживающую собственные сервисы компании, включая поисковик, Google Cloud Platform, Gmail, YouTube и т.п. Как отмечалось в исследовании ASPI, в настоящее время гиперскейлеры владеют около 71 % международных подводных линий связи. В то же время они стремительно наращивают ёмкость и количество дата-центров, отмечает Synergy Research. Всё это обеспечивает им практически полный контроль над всей цепочкой предоставления интернет-услуг, от создания до хранения, обработки и передачи данных. Однако Google, представив Cloud WAN, намекнула, что готова «отобрать хлеб» у традиционных телеком-операторов. Компания также запустила программу Verified Peering Provider (VPP), которая ранжирует операторов по качеству и глубине связи с сетями Google, и поменяла подход к работе с IX. Сейчас у Google более 5700 прямых пиринговых подключений и доступ к более чем 60 тыс. ASN. Сеть Google занимает первое место среди провайдеров облачных услуг и шестое место в мировом пиринге. Благодаря 202 точкам присутствия (PoP), более 3,2 млн км оптоволокна и 33 подводным кабелям сеть Google предлагает надёжную отказоустойчивую (заявленный SLA 99,99 %) глобальную WAN-платформу для критически важных для бизнеса приложений, сообщает компания.

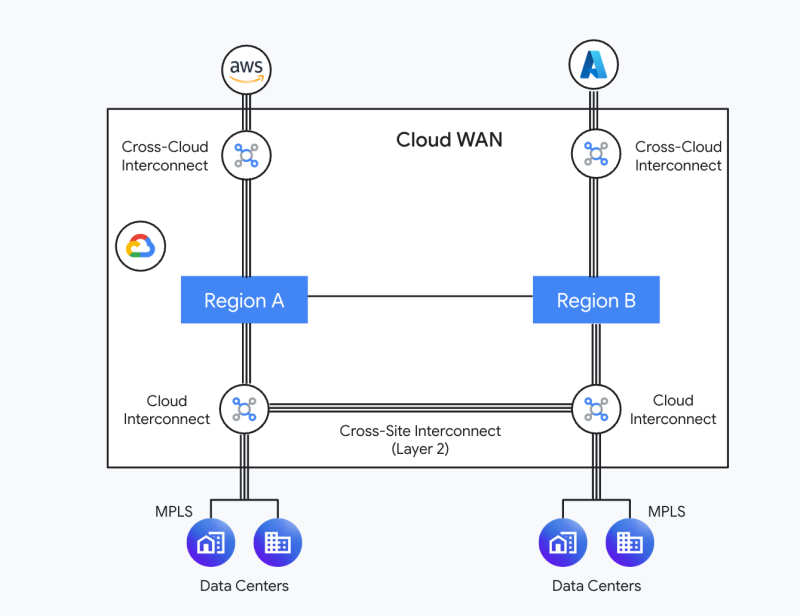

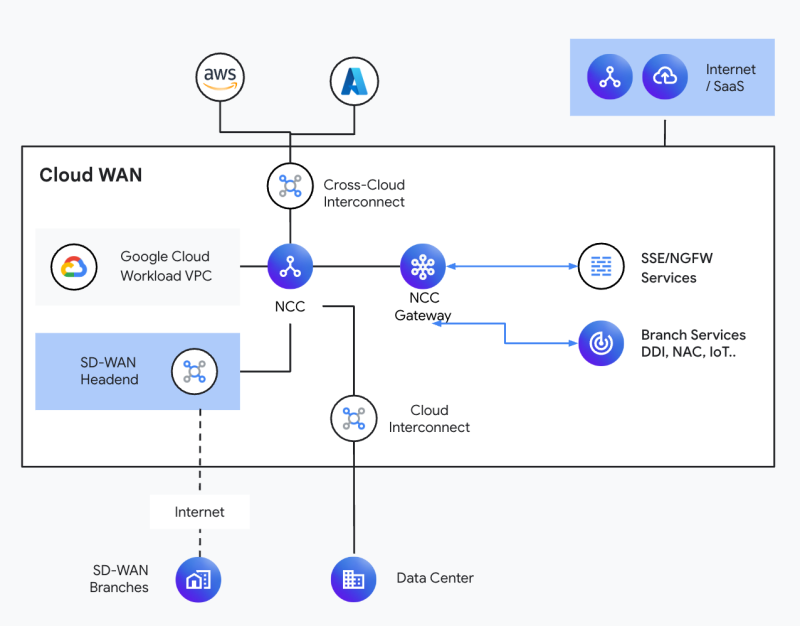

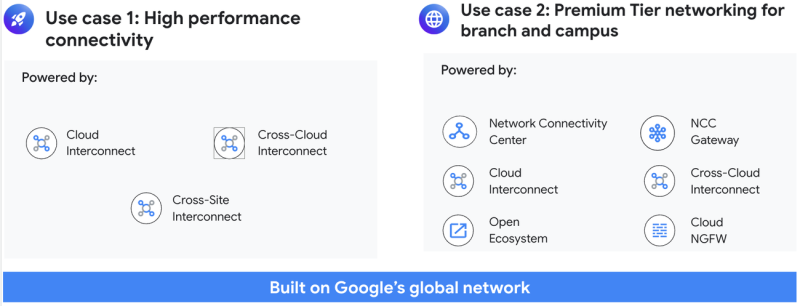

Источник изображений: Google Google Cloud WAN была специально разработана для замены традиционных корпоративных архитектур WAN. Сеть Google подключена ко всем основным игрокам облачных вычислений в мире и всем известным провайдерам крупных ЦОД, что позволяет ей доставлять трафик с высокой скоростью близко к конечному пункту назначения. По словам компании, Cloud WAN обеспечивает до 40 % более низкую задержку по сравнению с общедоступным интернетом и до 40 % экономии общей стоимости владения (TCO) по сравнению с решением WAN, управляемым клиентом (с учётом брандмауэров). Компания отметила, что быстрое развитие ИИ-технологий предъявило дополнительные требования к корпоративным сетям. ИИ-приложения требуют высокораспределённой инфраструктуры. Cloud WAN предлагает унифицированное корпоративное сетевое решение для безопасного и надёжного подключения между любыми корпоративными локациями, приложениями и пользователями, помогая при этом обеспечивать оптимальную производительность и сокращать расходы, говорит Google. Cloud WAN обеспечивает два основных варианта использования: предоставление высокопроизводительного подключения между географически распределёнными ЦОД организаций, которым необходимо надёжно и экономически эффективно передавать значительные объёмы данных, и подключение филиалов и кампусов через сеть Premium Tier. В первом случае Cloud WAN предлагает несколько сервисов. В рамках Cloud Interconnect предлагаются прямые соединения с низкой задержкой между облачными регионами и собственными ЦОД заказчика в 159 точках по всему миру. Cross-Cloud Interconnect обеспечивает связь облачных регионов Google Cloud Platform с регионами AWS, Microsoft Azure и Oracle Cloud Infrastructure в 21 точке по всему миру. Новая функция Cross-Site Interconnect, которая пока доступна только в некоторых странах в режиме превью, предлагает L2-соединения «точка-точка» между ЦОД заказчика на скорсти 10 Гбит/с или 100 Гбит/с. Така функциональность, по словам Google, нужна для государственных учреждений, операторов связи и предприятий, которым требуется прозрачное L2-подключение. Трафик идёт по каналам с резервированием, так что в случае сбоя какого-либо участка ВОЛС он будет автоматически направлен по другому физическому маршруту. Кроме того, в рамках NCC (Network Connectivity Center) доступна и L3-маршрутизация. Второй вариант использования Cloud WAN — сеть Premium Tier. Она ориентирована на защищённое подлючение филиалов к публичным облакам, ЦОД заказчика и публичному интернету с низкой задержкой. NCC действует как централизованный концентратор, работающий с Cloud VPN и решениями SD-WAN от сторонних поставщиков. NCC доступен в 20 странах мира. В данном случае присоединение к Cloud WAN происходит в географически ближайшей точке доступа. В 2025 году в некоторых регионах Lumen предложит выделенное оптическое подключение («последнюю милю») к Cloud WAN. Lumen также строит выделенные ВОЛС для AWS, Meta✴ и Microsoft.

19.03.2025 [11:25], Руслан Авдеев

Nokia обновит сети в дата-центрах HetznerФинская Nokia заключила соглашение с европейским хостинг-провайдером Hetzner для обновления сетей в ЦОД компании и её ключевой сетевой инфраструктуры в целом. Это последнее из партнёрств, анонсированных Nokia в последние месяцы и связанных с дата-центрами, сообщает пресс-служба Nokia. По данным Nokia, апгрейд обеспечит Hetzner возможность эффективно масштабировать проекты, совершенствовать автоматизацию и поддерживать наиболее передовое в индустрии время безотказной работы. Как сообщает Datacenter Dynamics, основанная в 1997 году немецкая Hetzner управляет ЦОД в Нюрнберге (Nuremberg) и Фалькенштайне (Falkenstein) в Германии, а также Хельсинки (Helsinki) в Финляндии. Также у неё есть площадки в Сингапуре и США. Внедрение новых решений Nokia уже началось в Германии и Финляндии, на очереди — расширение на другие европейские рынки для удовлетворения растущего спроса на цифровую инфраструктуру. Nokia поставит Hetzner энергоэффективные маршрутизаторы, решения для автоматизации и сбора телеметрии. В частности, будут развёрнуты маршрутизаторы 7750 SR-1x. В Nokia отмечают, что Hetzner сможет 100G-трансиверы, работающие на одной длине волны, но в целом новая архитектура рассчитана на апгрейд до 400G и 800G. Ещё в прошлом году Nokia начала активно заниматься проектами для дата-центров, а в прошлом месяце назначила бывшего топ-менеджера Intel Джастина Хоттарда (Justin Hottard), занимавшегося ЦОД-направлением, своим генеральным директором — он сменил на этом посту Пекку Лундмарка (Pekka Lundmark). До этого Лундмарк заявлял, что Nokia видит «значительную возможность» расширения своего присутствия на рынке дата-центров. После его комментариев Nokia расширила существующее соглашение о снабжении облака Microsoft Azure маршрутизаторами и коммутаторами. В сентябре Nokia также анонсировала запуск платформы автоматизации работы ЦОД, которую в компании называют «событийно-ориентированной автоматизацией» ( Event-Driven Automation, EDA). В ходе MWC 2025 представитель Nokia заявил, что ИИ стал «единственным за поколение» катализатором бума дата-центров.

26.02.2025 [08:32], Сергей Карасёв

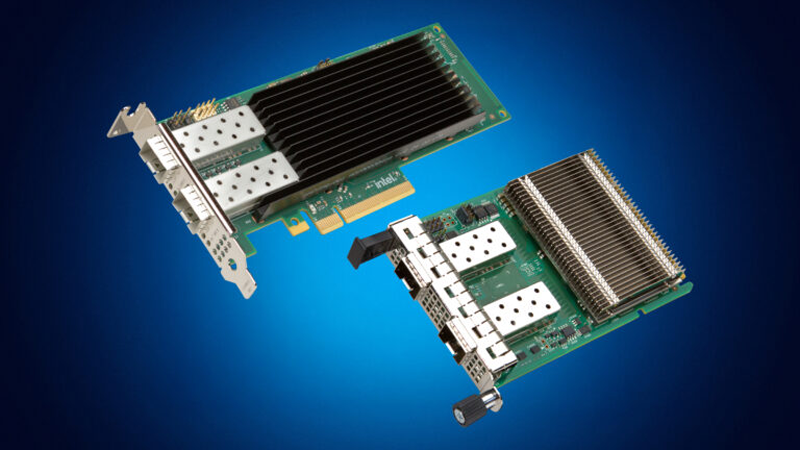

Intel представила 200GbE-адаптеры E830 и 10GbE-адаптеры E610Корпорация Intel анонсировала сетевые контроллеры и адаптеры серий Ethernet E830 и Ethernet E610, разработанные для удовлетворения растущих потребностей в пропускной способности каналов связи. Решения могут применяться в том числе в составе облачных платформ, систем НРС, ИИ и пр. По заявлениям Intel, Ethernet-изделия нового поколения вкупе с серверными процессорами Xeon 6 закладывают основу для масштабируемых приложений с интенсивным использованием данных. Адаптеры обеспечивают надёжное подключение на высоких скоростях при одновременном повышении энергоэффективности и снижении совокупной стоимости владения (TCO). Устройства серии Intel Ethernet E830 оптимизированы для высокоплотных виртуализированных рабочих сред. Эти контроллеры и адаптеры подходят для корпоративных, облачных и периферийных развёртываний. Кроме того, они могут применяться в составе телекоммуникационных инфраструктур. На начальном этапе будут доступны двухпортовые адаптеры 25GbE PCIe и OCP 3.0. В дальнейшем появятся модели в других конфигурациях, включая 1 × 200GbE, 2 × 100/50/25/10GbE и 8 × 25/10GbE. В целом, пропускная способность может достигать 200 Гбит/с при использовании интерфейса PCIe 5.0. Для изделий Intel Ethernet E830 заявлена поддержка различных функций обеспечения безопасности, включая Secure Boot, Secure Firmware Upgrade и Root of Trust на аппаратном уровне. Среди прочего заявлена поддержка PTM (Precision Time Measurement), 1588 PTP, SyncE и GNSS, что важно для финансовых и телекоммуникационных приложений, а также обучения моделей ИИ и инференса. Говорится о совместимости на уровне программного обеспечения и драйверов с продуктами серии Intel Ethernet E810.

Источник изображений: Intel В свою очередь, решения семейства Intel Ethernet E610 предлагают оптимальное сочетание управляемости, энергоэффективности и безопасности. Такие изделия могут применяться в рабочих станциях и на периферии. Заявлена поддержка стандартов 10GbE, 5GbE, 2.5GbE и 1GbE. Устройства будут доступны в различных форм-факторах. Intel говорит о сокращении энергопотребления на 50 % по сравнению с адаптерами предыдущего поколения. Реализована поддержка Root of Trust и современных криптографических функций.

12.02.2025 [16:44], Сергей Карасёв

Cisco представила умные коммутаторы N9300 на базе DPU AMD Pensando и ASIC Silicon One E100Компания Cisco анонсировала интеллектуальные коммутаторы семейства N9300 Series Smart Switches, которые, как утверждаются, позволяют переосмыслить подход к обеспечению безопасности в ИИ ЦОД путём интеграции средств защиты непосредственно в сетевую структуру. В серию N9300 вошли модели Cisco 9324C-SE1U и Cisco 9348Y2C6D-SE1U типоразмера 1U. Они оснащены неназванным процессором Intel с 16 вычислительными ядрами, 96 Гбайт системной памяти и SSD вместимостью 480 Гбайт. Есть порт USB 3.0, а также порты управления RJ-45 и SFP (1 × 1GbE SFP у первой из названных версий и 2 × 10GbE SFP+ у второй). Коммутаторы несут на борту ASIC Cisco Silicon One E100, которая отвечает за сетевые функции. Кроме того, имеются сетевые сопроцессоры (DPU) AMD Pensando второго поколения: четыре чипа Elba у модели Cisco 9324C-SE1U и два чипа Giglio у модификации Cisco 9348Y2C6D-SE1U. Эти DPU отвечают за такие задачи, как распределение данных, балансировка нагрузки, обеспечение безопасности, шифрование и пр. По заявлениям Cisco, трафик интеллектуально перенаправляется между ASIC и DPU для достижения оптимальной производительности. Такой подход обеспечивает экономию средств благодаря консолидации оборудования, снижению энергопотребления и упрощению сетевой инфраструктуры. Клиенты получают возможность масштабировать сервисы и быстро адаптироваться к меняющимся бизнес-потребностям без необходимости в каких-либо дополнительных аппаратных решениях. В составе коммутаторов DPU обеспечивают сервисную пропускную способность до 800 Гбит/с. Устройство Cisco 9324C-SE1U оснащено 24 портами 100G, а ToR-вариант Cisco 9348Y2C6D-SE1U — 48 портами 25G, двумя портами 100G и шестью портами 400G. За охлаждение отвечают шесть вентиляторов, а питание обеспечивает блок мощностью 1400 Вт. Диапазон рабочих температур — от 0 до +40 °C. На устройствах применяется программная платформа Cisco NX-OS. Задействована фирменная система безопасности Cisco Hypershield на основе ИИ. По заявлениям разработчика, Hypershield интегрируется в коммутационный уровень, позволяя операторам дата-центров создавать защитный «микропериметр» вокруг каждой службы. Продажи младшей модели коммутатора начнутся предстоящей весной, старшей — летом.

11.08.2024 [22:03], Сергей Карасёв

Western Digital представила NVMe-oF-платформу OpenFlex Data24 4000 вместимостью до 368 ТбайтКомпания Western Digital анонсировала платформу хранения данных OpenFlex Data24 4000 класса NVMe-oF JBOF с возможностью установки 24 NVMe SSD стандарта U.2. Например, могут применяться накопители Ultrastar DC SN655 вместимостью 15,36 Тбайт, что в сумме даст около 368 Тбайт ёмкости. Система выполнена в форм-факторе 2U с размерами 85,5 × 491,1 × 628,65 мм. Задействованы хост-адаптеры RapidFlex на основе фирменных ASIC A2000 с возможностью использования в общей сложности до 12 портов 100GbE. Говорится о поддержке TCP и RoCEv2. Производительность RoCEv2 достигает 27 млн операций ввода/вывода в секунду (IOPS) при произвольном чтении данных блоками по 4 Кбайт и 3 млн операций при произвольной записи. Скорость последовательного чтения и записи — до 135 и 92 Гбайт/с соответственно. В случае TCP показатель IOPS составляет до 21 млн при произвольном чтении и до 3 млн при произвольной записи. Скорость последовательного чтения и записи — до 113 и 86 Гбайт/с.

Источник изображения: Western Digital Устройство OpenFlex Data24 4000 несёт на борту чип BMC с ядром Arm; имеется выделенный порт 1GbE для удалённого мониторинга и управления. Диапазон рабочих температур — от +10 до +35 °C. Питание обеспечивают два блока мощностью 800 Вт с сертификатом Titanium. Производитель предоставляет пятилетнюю гарантию.

25.06.2024 [21:49], Алексей Степин

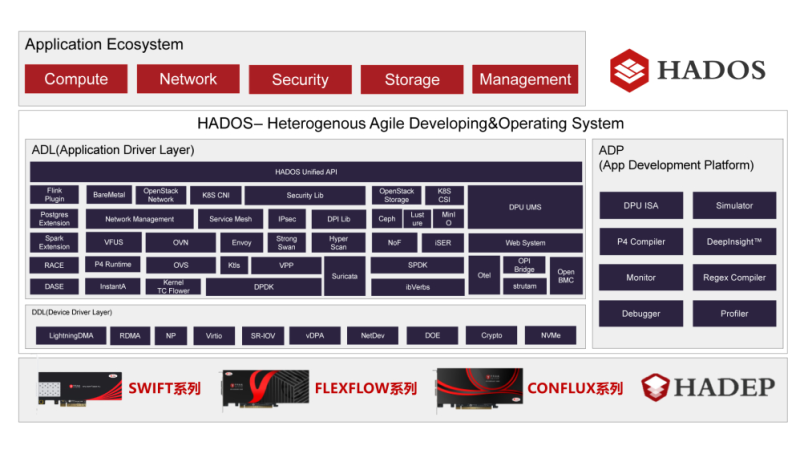

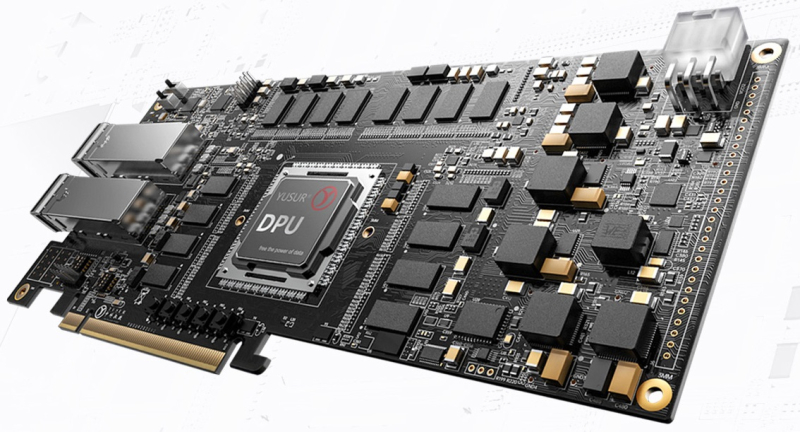

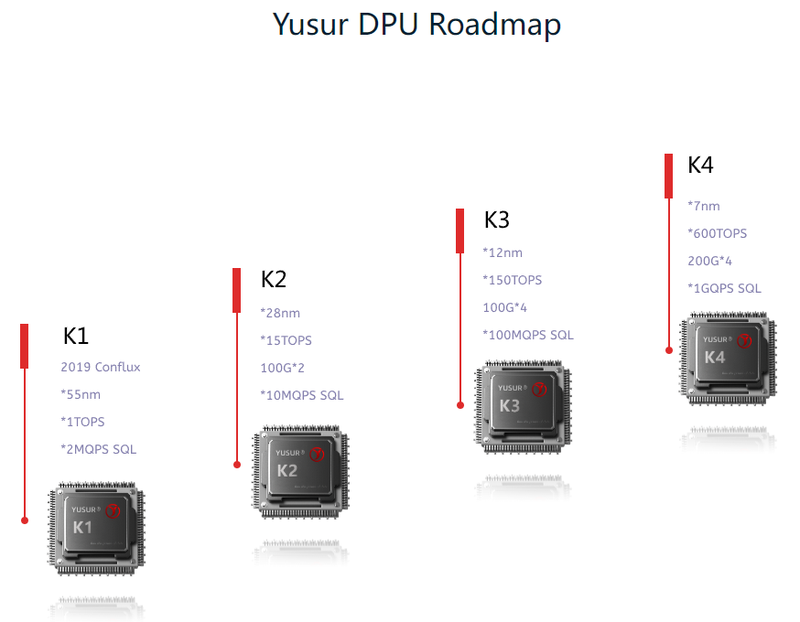

Китайский стартап Yusur наладил массовое производство DPU третьего поколения K2-ProСопроцессоры DPU уже нельзя назвать какой-то экзотикой. Их разрабатывают многие компании, преимущественно американские. Несмотря на растущее давление со стороны западных стран, не собирается проигрывать в этой гонке и Китай. Разработчик сопроцессоров и программно определяемых ускорителей из КНР, стартап Yusur, работающий в союзе с Китайской Академии Наук уже шесть лет, представил третье поколение DPU под названием K2-Pro. При этом, по словам компании, уже налажено массовое производство новинки. Первый DPU Yusur K1 был представлен ещё в 2019 году. И это была «проба пера», проверка самой возможности создания собственного DPU, способного ускорять работу сети, СУБД и ИИ. Чип использовал 55-нм техпроцесс, обеспечивал обработку 2 млн запросов SQL в секунду и имел производительность порядка 1 Топс. Уже в 2022 году был представлен полноценный DPU Yusur K2. Созданный с использованием 28-нм техпроцесса, он уже имел пару собственных интерфейсов 100GbE, мог обрабатывать 10 млн запросов SQL и развивал мощность 15 Топс. K2-Pro имеет схожие характеристики, но, как сообщает глава Yusur, на 30% экономичнее предшественника. Что касается сетевой производительности, то речь идёт об обработке до 80 млн пакетов в секунду при совокупной пропускной способности интерфейсов 200 Гбит/с.

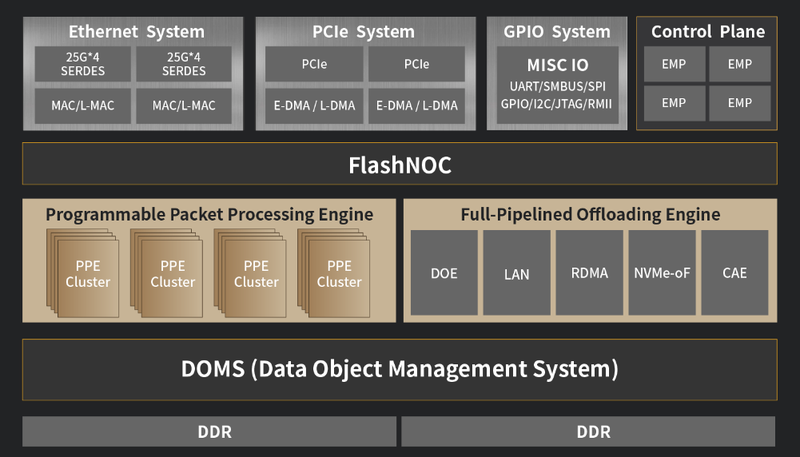

Архитектура K2-Pro. Источник: Yusur Технически в основе DPU Yusur серии K лежит программно-определяемая архитектура KPU с набором инструкций собственной разработки, работающая под управлением программной платформы HADOS, сочетающей в себе операционную систему, набор движков и API для реализации самых различных функций, а также все необходимые средства разработки. Поддерживается совместимость с P4, что упрощает разработку сетевых приложений для данной архитектуры. Также в составе K2-Pro имеется квартет управляющих ядер и набор движков, отвечающих за поддержку сетевых интерфейсов, разгрузку ряда сетевых операций, криптографии, SR-IOV, RDMA и NVMe-oF. В состав DPU входит BMC-контроллер на базе OpenBMC. Есть и два набора по 16 линий PCIe 3.0.

Планы Yusur относительно разработки следующих поколений DPU. Источник: Yusur Планы по дальнейшему развитию данной серии DPU весьма серьёзные: в следующем поколении, K3, вычислительная мощность должна вырасти в 10 раз, с 15 до 150 Топс. В поколении K4 производительность как минимум утроится, а сетевая часть будет включать уже четыре интерфейса 200GbE. Конкретных сроков исполнения своих планов Yusur не приводит, однако серьёзные намерения КНР в этой сфере очевидны. Представитель Китайской инженерной академии, профессор Чжэн Вэйминь (Zheng Weimin) отметил, что КНР обязана покончить с монополией на иностранные чипы класса DPU, дабы обеспечить суверенность и независимость в сфере ИТ-технологий.

24.11.2023 [09:00], Сергей Карасёв

QNAP выпустила управляемый 100GbE-коммутатор половинной шириныКомпания QNAP Systems анонсировала управляемый L2-коммутатор QSW-M7308R-4X, предназначенный для использования в составе платформ виртуализации, систем ИИ, инфраструктур хранения и обработки больших данных и пр. Новинка имеет половинную ширину, благодаря чему два таких устройства могут монтироваться в стандартную серверную стойку бок о бок. Коммутатор заключён в корпус с габаритами 207 × 248,8 × 43,3 мм и весит 1,78 кг. Во фронтальной части расположены четыре порта 100GbE QSFP28 и восемь портов 25GbE SFP28. Сзади находятся порт управления и консольный порт с гнёздами RJ-45. Устройство может быть подключено к сетевому хранилищу QNAP стандарта 25GbE или к NAS, оборудованному картой 100GbE. Реализована поддержка стандартов IEEE 802.3x Full-Duplex Flow Control, 802.1Q VLAN Tagging, 802.1w RSTP, 802.3ad LACP, 802.1AB LLDP, 802.1p Class of Service и др. Коммутационная способность достигает 1200 Гбит/с. Коммутатор QSW-M7308R-4X оборудован внутренним блоком питания. Максимальное энергопотребление составляет 100 Вт. В системе охлаждения применены два вентилятора с ШИМ-управлением. Диапазон рабочих температур — от 0 до +40 °C. На устройство предоставляется двухлетняя гарантия. |

|