Материалы по тегу: ии

|

11.09.2025 [23:19], Владимир Мироненко

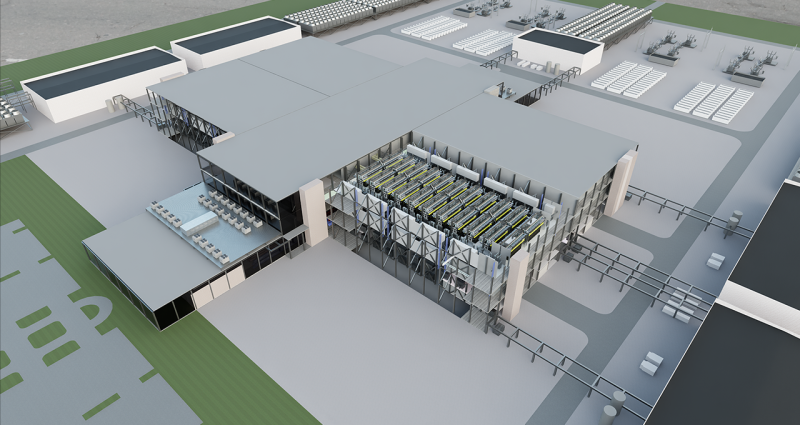

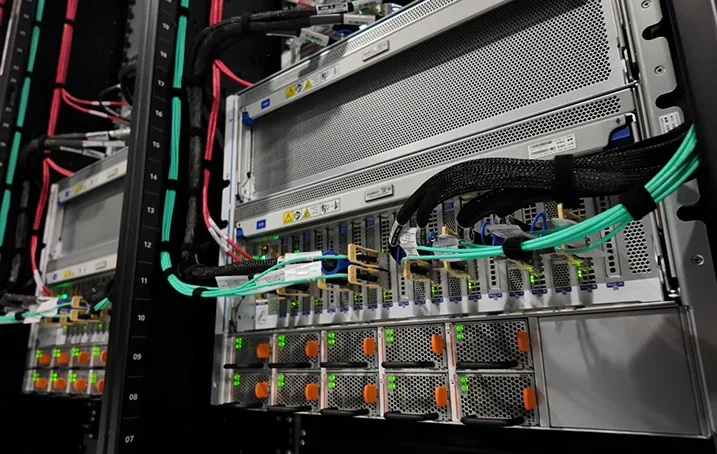

Nebius привлекла $3,75 млрд после заключения контракта с MicrosoftПоставщик облачных решений для ИИ Nebius (бывшая материнская структура «Яндекса» Yandex N.V.) привлёк $3,75 млрд благодаря размещению конвертируемых облигаций и продаже акций. Ранее сообщалось, что компания намерена увеличить капитальные затраты в 2025 году. В ходе размещения компания увеличила предложение конвертируемых ценных бумаг с первоначально объявленной суммы $2,0 млрд до $2,75 млрд, распределив её поровну между двумя траншами по $1,375 млрд в рамках закрытого предложения квалифицированным институциональным покупателям в соответствии с Правилом 144A Закона о ценных бумагах 1933 года. Первый транш со ставкой купона 1,0 % должен быть погашен в 2030 году, второй со ставкой купона 2,75 % подлежит погашению в 2032 году. Цена конвертации облигаций составляет $138,75 за единицу, что соответствует 50-% премии к цене их размещения. Также было продано акций класса А по цене $92,5 за единицу на сумму $1,0 млрд. Согласно пресс-релизу Nebius, привлечённые средства будут использованы «для финансирования дальнейшего роста бизнеса, включая приобретение дополнительных вычислительных мощностей и оборудования, приобретение стратегически важных высококачественных и удобно расположенных земельных участков у надежных поставщиков, расширение сети своих центров обработки данных, а также для общих корпоративных целей». Привлечение средств Nebius последовало после заключения крупного контракта с Microsoft на предоставление технологическому гиганту в течение пяти лет доступа к выделенной ИИ-инфраструктуре в новом ЦОД в Винеленде (Vineland) в Нью-Джерси (на изображении выше). Стоимость контракта составляет $17,4 млрд с возможностью увеличения суммы сделки до $19,4 млрд за счёт увеличения предоставляемых мощностей и услуг. О планах Nebius по созданию ЦОД в Нью-Джерси, который теперь будет по крайней мере частично сдан в аренду Microsoft, стало известно в марте. Первоначальная мощность ЦОД составляет 300 МВт с возможностью расширения ещё на 400 МВт. Также у компании есть площадки в Финляндии, где она в прошлом году пообещала увеличить мощность до 75 МВт, и во Франции. Как сообщает Datacenter Dynamics, компания также развёртывает кластеры в ЦОД Patmos в Канзас-Сити (штат Миссури), в ЦОД Verne Global в Исландии, в ЦОД Ark в Великобритании и на новом объекте в Израиле.

11.09.2025 [14:09], Сергей Карасёв

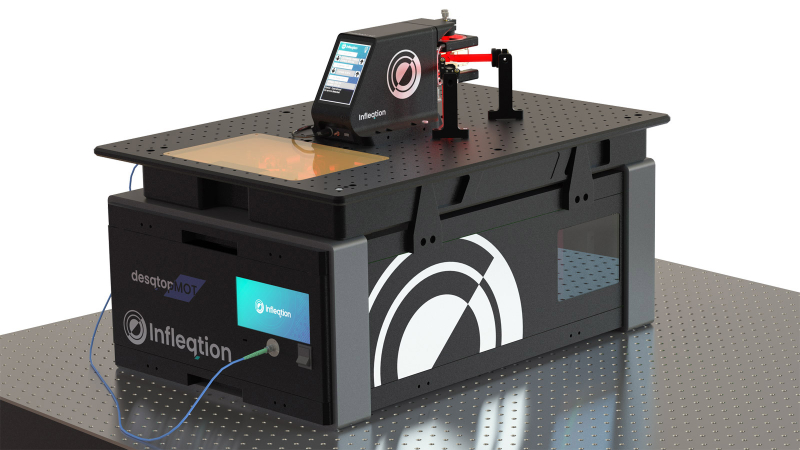

Разработчик квантовых технологий Infleqtion выйдет на биржуКомпания Infleqtion, занимающаяся разработкой квантовых систем, по сообщению Datacenter Dynamics, намерена выйти на биржу Nasdaq. Ожидается, что эта процедура принесёт более $540 млн, что позволит ускорить разработку продуктов и укрепить рыночное положение. Infleqtion была основана в 2007 году под именем ColdQuanta на базе Университета Колорадо (CU) в США. Она разрабатывает приборы и системы на основе квантовых технологий. Это, в частности, квантовые компьютеры Sqale, а также компактные оптические атомные часы Tiqker, которые можно использовать для позиционирования, навигации и синхронизации времени (PNT). Выход на биржу планируется осуществить посредством SPAC-сделки с Churchill Capital Corp X. По сути SPAC (Special-Purpose Acquisition Company) — это компания-пустышка, которая уже торгуется на бирже. Слияние с такой структурой позволяет ускорить и упростить процедуру выхода на биржу по сравнению с традиционным первичным публичным размещением акций (IPO). Советы директоров Infleqtion и Churchill Capital Corp X единогласно одобрили сделку. Предполагается, что она принесёт Infleqtion около $416 млн на трастовом счете Churchill Capital Corp X и более $125 млн в виде полностью подписанного договора PIPE (private investment in public equity, частные инвестиции в публичный капитал) от таких инвесторов, как Maverick Capital, Counterpoint Global (Morgan Stanley), Glynn Capital, BOKA Capital, LCP Quantum и др. После закрытия сделки объединенная компания продолжит работать под названием Infleqtion и, как ожидается, будет котироваться на бирже Nasdaq под тикером INFQ. Отмечается, что на сегодняшний день Infleqtion продала три квантовых компьютера и сотни квантовых датчиков. Выручка компании за двенадцать месяцев по состоянию на конец июня 2025 года составила около $29 млн. Infleqtion рассчитывает получить примерно $50 млн от готовящихся и уже оформленных заказов к концу 2025 года.

11.09.2025 [14:04], Сергей Карасёв

Стартап Mistral AI привлёк на развитие €1,7 млрд при участии ASMLФранцузская компания Mistral AI, специализирующаяся на технологиях ИИ и разработке больших языковых моделей (LLM), провела раунд финансирования Series C, в ходе которого на развитие привлечено €1,7 млрд. При этом стартап получил оценку на уровне €11,7 млрд. Mistral AI была основана в 2023 году. Она рассматривается в качестве европейского конкурента таким крупным американским компаниям в области ИИ, как OpenAI и Anthropic. В число разработок Mistral AI входит интеллектуальный чат-бот Le Chat. Кроме того, стартап вместе с NVIDIA представил большую языковую модель (LLM) Mistral NeMo 12B, которая насчитывает 12 млрд параметров и использует контекстное окно в 128 тыс. токенов. Эта модель предназначена для решения различных задач корпоративного уровня. Изначально Mistral AI использовала инфраструктуру Microsoft Azure и Google Cloud для обучения и запуска своих моделей ИИ, а впоследствии обратилась к услугам CoreWeave. Кроме того, Mistral AI управляет собственным облаком ИИ — Mistral Compute. В феврале нынешнего года компания объявила о размещении своего ИИ-кластера на площадке французского оператора модульных дата-центров Eclairion. Помимо этого, Mistral AI объявила об объединении усилий с инвестиционным банком Bpifrance, инвестиционным фондом ОАЭ MGX и NVIDIA для строительства ИИ ЦОД мощностью 1,4 ГВт в районе Парижа: этот объект планируется ввести в эксплуатацию к 2028 году. Раунд финансирования Series C возглавил нидерландский производитель литографического оборудования для микроэлектронной промышленности ASML. Кроме того, в инвестиционной программе приняли участие DST Global, Andreessen Horowitz, Bpifrance, General Catalyst, Index Ventures, Lightspeed и NVIDIA. Полученные средства стартап намерен направить на дальнейшее развитие передовых технологий ИИ для «решения критически важных и сложных технологических задач, стоящих перед стратегическими отраслями».

11.09.2025 [14:01], Сергей Карасёв

OpenAI заключила контракт стоимостью $300 млрд на покупку вычислительных мощностей у OracleКомпания OpenAI, по сообщению газеты The Wall Street Journal, заключила пятилетнее соглашение о приобретении вычислительных мощностей у Oracle для задач ИИ. Стоимость контракта составляет $300 млрд, что многократно превышает годовую выручку OpenAI, которая по итогам 2025-го ожидается на уровне $12,7 млрд. Сама Oracle на днях сообщила, что объём заказов (RPO) достиг почти $0,5 трлн. Стартап OpenAI в настоящее время использует облачную инфраструктуру Microsoft Azure, но этих ресурсов недостаточно для обслуживания масштабных ИИ-нагрузок. В сложившейся ситуации в марте нынешнего года OpenAI заключила соглашение по использованию облачной инфраструктуры CoreWeave: договор стоимостью $11,9 млрд подписан на пять лет. Позднее OpenAI заключила ещё одну сделку с CoreWeave — на $4 млрд. Вместе с тем OpenAI активно развивает партнёрские отношения с Oracle. В октябре прошлого года сообщалось, что ИИ-стартап намерен арендовать у Oracle кампус ЦОД мощностью 2 ГВт. Кроме того, OpenAI объявила о заключении соглашения с Oracle о строительстве дополнительных дата-центров мощностью 4,5 ГВт в США в рамках расширенного партнёрства, что является частью масштабного проекта Stargate. Сама Oracle рассчитывает найти для OpenAI 5 ГВт на обучение ИИ к концу 2026 года. Как отмечает The Wall Street Journal, контакт на $300 млрд между OpenAI и Oracle является одной из крупнейших сделок в истории облачных вычислений. Соглашение вступит в силу в 2027 году. По оценкам, речь идёт о мощностях на уровне 4,5 ГВт, что сопоставимо с суммарным потреблением энергии примерно 4 млн среднестатистических домохозяйств. Ресурс TechCrunch подчёркивает, что OpenAI остро нуждается в дополнительных вычислительных ресурсах, в связи с чем активно заключает партнёрские соглашения. Так, минувшим летом стартап подписал договор об использовании облачной платформы Google Cloud для обработки своих ИИ-нагрузок — несмотря на то, что Google является прямым конкурентом OpenAI в сфере ИИ. Предполагается, Google Cloud поможет в поддержании операций OpenAI в США, Великобритании, Нидерландах, Норвегии и Японии.

11.09.2025 [10:51], Руслан Авдеев

Индия изучит возможность переоборудования старых угольных шахт в дата-центрыИндийская государственная компания Coal India Limited (CIL) рассматривает возможность переоборудования выведенных из эксплуатации уголных шахт в дата-центры. Компания начала разработку технико-экономического обоснования с привлечением консультантов, сообщает Datacenter Dynamics. В расчёт будут приниматься прогнозы спроса, региональные и иные тенденции, проблемы с законодательством и иные потенциальные препятствия для развёртывания объектов — включая доступность энергии, охлаждения и сетей связи. Как сообщают источники Times of India, предстоит комплексное исследование рынка дата-центров. Его целью является изучение текущего состояния индустрии, сравнение его с мировыми стандартами и анализ различных моделей ЦОД (гиперскейл-класса, колокейшн, для периферийных вычислений) с последующей оценкой влияния на спрос со стороны ИИ-технологий, облаков, IoT, 5G и др. CIL управляет сотнями угольных шахт с помощью дочерних компаний. По данным Times of India, пока в «шорт-лист» вошли четыре участка: угольный разрез Umrer в штате Махараштра под управлением Western Coalfields Limited (WCL); участок Saraipali около Корбы (штат Чхаттисгарх) под управлением South Eastern Coalfields Limited (SECL); участок Himgir–Rampur возле Джарсугуды (штат Одиша) под управлением Mahanadi Coalfields Limited (MCL); угольный разрез Nigahi в районе Синграули (штат Мадхья-Прадеш) под управлением Northern Coalfields Limited (NCL). Компания не исключает использования на объектах энергии из возобновляемых источников. Пока же Индия сильно зависит в генерации от угля, обеспечивающего около 60 % потребления. Хотя в последнее время использование угля несколько сократилось, планы полного отказа от этого энергоносителя не озвучиваются. В 2023 году правительство призвало коммунальные компании отложить прекращение эксплуатации угольных электростанций до 2030-х гг. Страна даже увеличила добычу угля для удовлетворения растущего спроса, в 2023–2024 гг. зарегистрирован абсолютный исторический максимум в 997 млн тонн. Особо интересным уголь стал в 2024 году, поскольку для дата-центрам остро не хватает электроэнергии. В декабре 2024 года Международное энергетическое агентство (IEA) объявило, что из-за развития рынка ИИ растёт и потребление угля, в первую очередь в Китае и Индии. А в апреле 2025 года президень США Дональд Трамп (Donald Trump) поддержал угольный сектор в США ради удовлетворения спроса ИИ ЦОД на энергию. Впрочем, в случае с CIL шахты планируется использовать не по прямому назначению. Похожие прецеденты уже есть. В январе 2024 года сообщалось, что заброшенные шахты могут стать хранилищами «мусорного» тепла эдинбургского суперкомпьютера. В марте 2025-го появилась информация, что Public Power Corp (PPC) представила план строительства ЦОД в старых угольных шахтах Греции.

11.09.2025 [08:48], Руслан Авдеев

NVIDIA работает над эталонным дизайном гигаваттных ИИ-фабрикNVIDIA анонсировала разработку эталонного дизайна дата-центров гигаваттного уровня с использованием технологии цифровых двойников. Эталонные проекты ИИ ЦОД будут доступны компаниям-партнёрам по всему миру. В разработке нового решения компании помогают Schneider Electric, Siemens, Vertiv, Cadence, emeraldai, E Tech Group, phaidra.ai, PTC и Vertech. Для создания высокопроизводительной ИИ-инфраструктуры будет предложена технология цифровых двойников Omniverse Blueprint, позволяющая создавать высокопроизводительную и энергоэффективную ИИ-инфраструктуру. Технология позволяет заказчикам объединять все данные, связанные с созданием дата-центра, в единую универсальную модель, отражающую как можно больше деталей виртуального и физического строения объектов. Благодаря этому можно проектировать и моделировать оборудование с высокой энергетической и вычислительной плотностью. Модели ИИ-фабрики можно подключить к более масштабным системам: энергосетям, системам водоснабжения и транспортным артериям, что требует координации и моделирования на протяжении всего жизненного цикла кампусов ЦОД. В модель включаются локальные генерирующие мощности, энергохранилища, технологии охлаждения и даже ИИ-агенты для управления работой ЦОД. В компании заявляют, что только одновременное проектирование инфраструктуры и технологического стека обеспечивает настоящую оптимизацию, при которой питание, охлаждение, ускорители и ПО рассматриваются как единое целое.

Источник изображения: NVIDIA В марте 2024 года сообщалось, что NVIDIA и Siemens внедрят ИИ в промышленное проектирование и производство с помощью интеграции NVIDIA Omniverse Cloud API в платформу Xcelerator. Тогда же Schneider Electric и NVIDIA объявили о разработке эталонных проектов инфраструктур ИИ ЦОД. В рамках объявленного сотрудничества AVEVA, дочерняя компания Schneider Electric, должна была подключить свою платформу цифровых двойников к NVIDIA Omniverse, создав единую среду для виртуального моделирования и совместной работы.

10.09.2025 [18:51], Владимир Мироненко

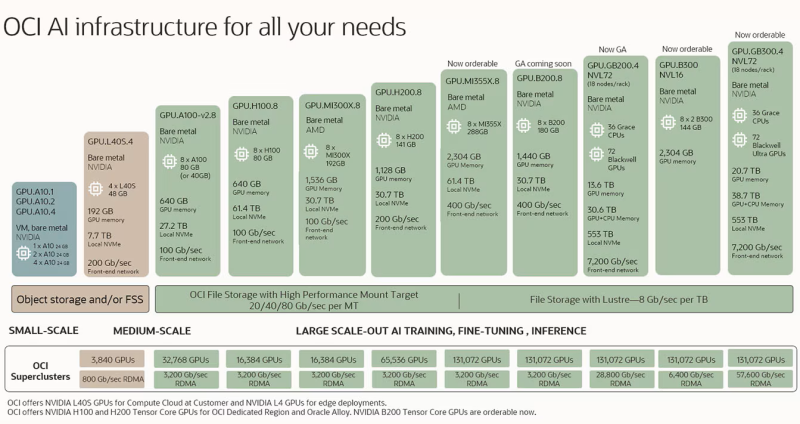

Новость о заказах на $0,5 трлн привела к рекордному за 26 лет росту акций OracleOracle сообщила финансовые результаты I квартала 2026 финансового года, закончившегося 31 августа 2025 года. Несмотря на то, что прибыль и выручка оказались ниже прогнозов Уолл-стрит, акции Oracle взлетели на 27 %, продемонстрировав самый большой однодневный рост за 26 лет (с июня 1999 года, согласно данным FactSet, приведенным SiliconANGLE), поскольку инвесторов впечатлил её прогноз по доходам от облачных технологий, сообщил CNBC. Основатель компании Ларри Эллисон (Larry Ellison) стал самым богатым человеком Земли — благодаря росту акций его доля в Oracle теперь оценивается в $393 млрд. Общая выручка за I квартал составила $14,93 млрд увеличившись год к году на 12 % при консенсус-прогнозе аналитиков, опрошенных LSEG, в размере $15,04 млрд. Скорректированная чистая прибыль (Non-GAAP) за квартал выросла на 8 % до $4,28 млрд или $1,47 на разводнённую акцию, что ниже консенсус-прогноза от LSEG в размере $1,48 на разводнённую акцию. Чистая прибыль (GAAP) осталась на прежнем уровне, составив $2,93 млрд, или $1,01 на акцию, по сравнению с $2,93 млрд, или $1,03 на акцию, за аналогичный квартал предыдущего финансового года. Выручка облачного сегмента составила 7,19 млрд, в том числе выручка от облачной инфраструктуры (OCI, IaaS) — $3,3 млрд (рост год к году на 55 %), выручка от облачных приложений — (OCA, SaaS) — $3,8 млрд (рост — 11 %). Выручка от разработки ПО равняется $5,72 млрд (снижение на 1 %). Продажи оборудования выросли на 2 % до $670 млн, сервисы принесли компании $1,35 млрд (рост — 7 %). Во II финансовом квартале Oracle ожидает общую скорректированную прибыль (Non-GAAP) на акцию в размере $1,61–1,65 при росте выручки на 14–16 %. Аналитики прогнозируют прибыль в размере $1,62 на акцию при выручке в $16,21 млрд, что предполагает рост на 15 %. Гендиректор Oracle Сафра Кац (Safra Catz) сообщила, что в отчётном квартале компания подписала четыре многомиллиардных контракта с тремя клиентами. В результате объём оставшихся обязательств по контрактам (RPO) вырос год к году на 359 % до $455 млрд. Она отметила, что спрос на инфраструктуру будет расти и дальше. «В ближайшие несколько месяцев мы ожидаем привлечения нескольких новых многомиллиардных клиентов, и RPO, вероятно, превысит полтриллиона долларов», — сообщила Кац.  По её словам, такой рост показателя RPO позволяет компании существенно пересмотреть свой долгосрочный прогноз выручки от облачной инфраструктуры в сторону повышения. Она сообщила, что выручка от OCI, как ожидается, достигнет $18 млрд в текущем финансовом году, затем вырастет до $32 млрд в 2027 финансовом году, до $73 млрд в 2028 финансовом году, до $114 млрд в 2029 финансовом году и до $144 млрд к 2030 финансовому году. Прогноз Evercore на 2029 год чуть меньше — $108 млрд выручки. Прогноз Oracle демонстрирует существенный рост её облачного бизнеса по сравнению с основными конкурентами. В июле корпорация Microsoft сообщила о выручке от Azure за 12 месяцев в размере $75 млрд, в то время как выручка AWS за тот же период составила около $112 млрд. Капитальные затраты Oracle в 2026 финансовом году составят около $35 млрд, что соответствует росту на 65 %, сообщила Кац. Однако затраты других игроков намного выше. По словам Дэйва Велланте (Dave Vellante), главного аналитика CUBE Research (SiliconANGLE Media), цифры свидетельствуют о том, что Oracle вошла в число гиперскейлеров. «Бизнес набирает обороты, поэтому инвесторы не будут обращать внимания на этот квартал», — отметил он. Аналитик Valoir Ребекка Веттеманн сообщила SiliconANGLE, что цифры отражают то, что огромные инвестиции Oracle в облачную инфраструктуру за последние несколько лет действительно начинают ей приносить дивиденды: «Рынок реагирует как на уверенность Oracle, так и на её квартальные отчёты». «Oracle прогнозирует рост прибыли в сфере инфраструктуры на годы вперёд, что действительно необычно для этой отрасли, особенно учитывая неопределённость относительно объёма и роста будущих рабочих ИИ-нагрузок, зависящих от облачной инфраструктуры», — добавила аналитик. Председатель и технический директор Oracle Ларри Эллисон (Larry Ellison) сообщил, что выручка от баз данных MultiCloud в облаках Amazon, Google и Azure в I финансовом квартале росла невероятными темпами — на 1529 %.«Мы ожидаем, что выручка от MultiCloud будет существенно расти каждый квартал в течение нескольких лет, поскольку мы предоставим ещё 37 ЦОД нашим трём партнёрам-гиперскейлерам, доведя их общее количество до 71», — завил он. В октябре корпорация представит облачный сервис Oracle AI Database, который позволит клиентам использовать выбранную ими LLM, включая Gemini, ChatGPT, Grok и т.д., непосредственно поверх Oracle Database для лёгкого доступа и анализа всей информации в базах данных. «Этот революционный облачный сервис позволит десяткам тысяч наших клиентов мгновенно раскрывать ценность своих данных, делая их легкодоступными для самых передовых ИИ-моделей. Oracle AI Cloud Infrastructure и Oracle MultiCloud AI Database внесут свой вклад в резкое увеличение спроса и потребления облачных услуг в течение следующих нескольких лет. ИИ меняет всё», — заявил Эллисон.

10.09.2025 [17:29], Сергей Карасёв

CoreWeave сформировала венчурное подразделение для поддержки проектов в области ИИПровайдер облачных услуг для ИИ-задач CoreWeave объявил о создании венчурного подразделения CoreWeave Ventures, которое займётся поддержкой компаний и основателей проектов в области искусственного интеллекта и перспективных вычислительных технологий. Отмечается, что на фоне стремительного развития ИИ спрос на специализированные инструменты и приложения, а также сопутствующую инфраструктуру продолжает расти. CoreWeave Ventures поможет ускорить вывод новых разработок на коммерческий рынок путём предоставления финансирования, технической экспертизы и вычислительных мощностей. Поддержку планируется оказывать по нескольким направлениям. Это, в частности, различные модели капиталовложений, которые помогут компаниям в разработке продуктов и масштабировании операций. Кроме того, CoreWeave будет предоставлять упрощённый доступ к своей облачной платформе, специально оптимизированной для ИИ-нагрузок. Компании также смогут воспользоваться средами тестирования для оценки реальных сценариев использования ИИ-решений. Дополнительно CoreWeave предоставит аналитику стратегий создания продуктов и их вывода на рынок на основе сотрудничества с сотнями предприятий и организаций в сфере ИИ. В целом, CoreWeave Ventures в обмен на акционерный капитал планирует обеспечивать поддержку на протяжении всего жизненного цикла проекта — от начала реализации до выхода на рынок. Новое венчурное подразделение уже сотрудничает с рядом компаний, включая разработчиков больших языковых моделей (LLM) и инфраструктурных решений. Отметим, что во II квартале текущего года CoreWeave получила $1,21 млрд выручки, что в три раза больше по сравнению с результатом годичной давности, когда показатель составлял $395,37 млн. При этом компания понесла чистые убытки в размере $290,51 млн против $323,02 млн во II четверти 2024 года. Более того, CoreWeave продолжает наращивать долги, хотя до конца 2026 года обязана вернуть кредиторам порядка $8 млрд.

10.09.2025 [13:35], Сергей Карасёв

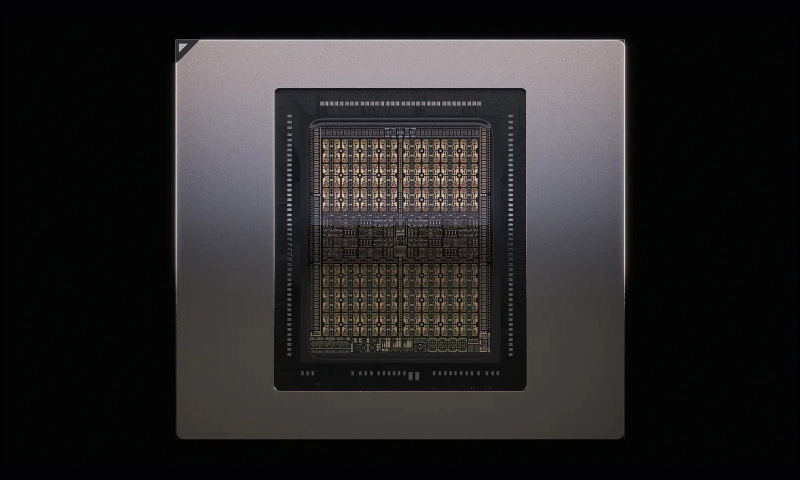

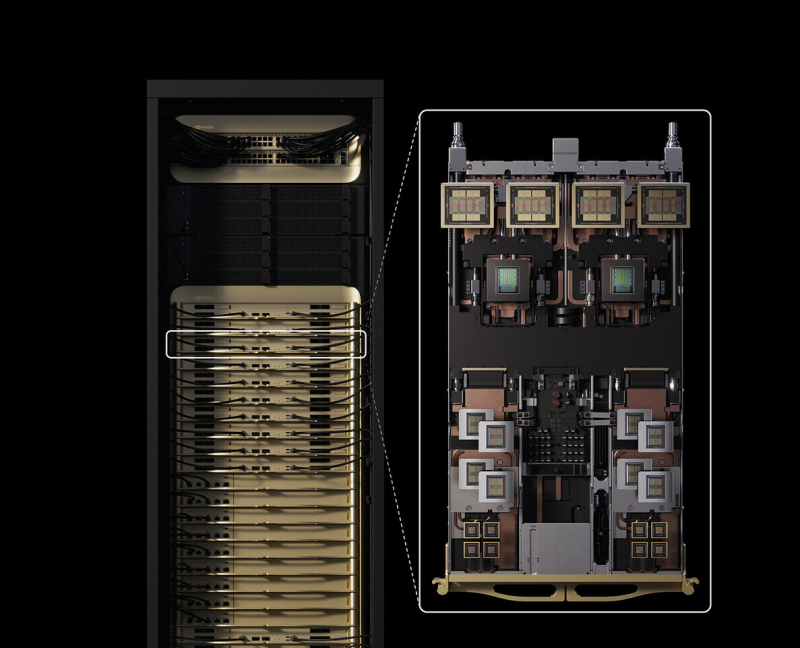

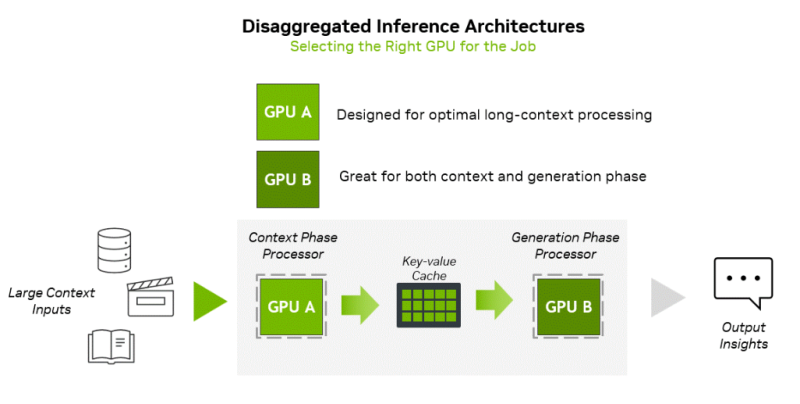

NVIDIA представила соускоритель Rubin CPX со 128 Гбайт GDDR7 для масштабных задач ИИ-инференсаNVIDIA неожиданно анонсировала чип Rubin CPX — GPU нового класса, спроектированный для масштабных задач ИИ-инференса и работы с моделями, использующими длинный контекст. Поставки решения планируется организовать в конце 2026 года. Чип Rubin CPX выполнен в виде монолитного кристалла и оснащён 128 Гбайт памяти GDDR7. Заявленная ИИ-производительность достигает 30 Пфлопс в режиме NVFP4. Предусмотрены по четыре блока NVENC и NVDEC для кодирования и декодирования видеоматериалов. Новинка дополнит другие ускорители компании. Оркестрацией нагрузок будет заниматься платформа NVIDIA Dynamo, распределяющая нагрузки между подходящими для каждой задачи ускорителями. Изделие Rubin CPX предназначено для использования вместе с Arm-процессорами Vera и ускорителями Rubin в составе новой стоечной платформы NVIDIA Vera Rubin NVL144 CPX. Эта система будет объединять 144 чипа Rubin CPX, 144 чипа Rubin и 36 процессоров Vera (88 кастомных 3-нм Arm-ядер). Говорится об использовании суммарно 100 Тбайт памяти с агрегированной пропускной способностью 1,7 Пбайт/с. Общая производительность на операциях NVFP4 — до 8 Эфлопс, что примерно в 7,5 раза больше по сравнению с системами NVIDIA GB300 NVL72. Задействована система жидкостного охлаждения. Кроме того, NVIDIA планирует выпуск двухстоечного решения, включающего стойку Vera Rubin NVL144 CPX и «обычную» стойку Vera Rubin NVL144. «Платформа Vera Rubin ознаменует собой новый скачок производительности в области вычислений ИИ, предлагая как GPU следующего поколения Rubin, так и чип нового класса CPX. Это первый CUDA GPU, специально разработанный для ИИ с длинным контекстом, когда модели одновременно обрабатывают миллионы токенов», — отмечает Дженсен Хуанг (Jensen Huang), основатель и генеральный директор NVIDIA. Основная задача Rubin CPX — работа с контекстом в больших моделях и создание KV-кеша. Эта операция ограничена вычислительными способностями чипа, тогда как генерация токенов зависит уже от пропускной способности памяти и интерконнекта для быстрого обмена данными. NVIDIA предложила разделить эти этапы и на аппаратном уровне. CPX лишён HBM, зато операции возведения в степень он делает втрое быстрее, чем Blackwell Ultra.

10.09.2025 [12:52], Руслан Авдеев

Microsoft уменьшит зависимость от OpenAI, подключив ИИ Anthropic к Office 365Компания Microsoft намерена снизить зависимость от давнего партнёра в лице OpenAI, прибегнув к помощи стартапа Anthropic. В частности, его технологии будут применяться в приложениях Office 365 для реализации новых функций наряду с решениями OpenAI, сообщает TechCrunch со ссылкой на данные источников The Information. Использование конкурентного ИИ в Word, Excel, Outlook и PowerPoint положит конец монополии OpenAI в этой сфере. Ранее Microsoft фактически зависела от разработчика ChatGPT для обеспечения ИИ-функций в своём офисном пакете. Попытки Microsoft диверсифицировать партнёрство в сфере ИИ происходят на фоне растущих разногласий с OpenAI, реализующей собственные инфраструктурные проекты. Кроме того, компания является потенциальным конкурентом LinkedIn, социальная сеть почти десять лет принадлежит Microsoft. Сделка с Anthropic состоялась на фоне переговоров с OpenAI об обновлении соглашения, которое, вероятно, позволит IT-гиганту получать доступ к новейшим технологиям OpenAI и в будущем, даже после реструктуризации последней в коммерческую компанию. Впрочем, по данным The Information, в Microsoft считают, что новейшие модели Anthropic, включая Claude Sonnet 4, фактически лучше решений OpenAI по ряду параметров, например — при создании презентаций PowerPoint.

Источник изображения: BoliviaInteligente/unsplash.com Это не первый эпизод расширения ИИ-сотрудничества Microsoft. Хотя модели OpenAI предлагаются «по умолчанию», через GitHub Copilot можно получить доступ и к моделям Grok (xAI) и Claude (Anthropic). Также компания не так давно представила и собственные модели — MAI-Voice-1 и MAI-1-preview. OpenAI може стремится выйти из сферы влияния Microsoft. На прошлой неделе компания запустила платформу для поиска работы, способную конкурировать с LinkedIn, а СМИ сообщают, что OpenAI намерена наладить выпуск собственных ИИ-чипов совместно с Broadcom в 2026 году. Другими словами, компания сможет обучать и запускать ИИ-модели на собственном оборудовании, не полагаясь на ресурсы Microsoft Azure. Впрочем, по словам представителя Microsoft, OpenAI продолжит быть партнёром компании в области передовых ИИ-моделей, и техногигант по-прежнему привержен долгосрочному сотрудничеству. |

|