Материалы по тегу: hpe

|

19.10.2023 [00:41], Руслан Авдеев

Crusoe предложит экобезопасное облако для генеративного ИИ на базе суперкомпьютеров HPE Cray XDСтроитель и оператор модульных дата-центров Crusoe, безопасных для климата планеты, как сообщает HPC Wire, выбрала суперкомпьютеры HPE Cray XD для создания новых облачных сервисов для работы с генеративным ИИ и иными HPC-нагрузками. Для питания своих ЦОД Crusoe использует генераторы, работающие на факельном газе, и иные источники возобновляемой энергии. Попутный газ сжигался бы в любом случае, но его применение для получения электроэнергии позволяет «сэкономить» углеродный выброс. Сообщается, что эта технология помогла предотвратить выброс в атмосферу в 2022 году метана в объёме, эквивалентном устранению с дороги 170 тыс. машин с бензиновыми ДВС. Компания размещает контейнерные ЦОД на нефтяных месторождениях в США и Аргентине, где метан и другие газы сжигаются в генераторах с выделением CO2, который считается менее вредным парниковым газом. Начав с проектов по майнингу биткоинов, Crosoe перешла к работе над HPC и ИИ.

Источник изображения: Crusoe Energy Благодаря новому сотрудничеству Crusoe и HPE, первая получит энергоэффективные суперкомпьютеры HPE Cray XD на основе ускорителей NVIDIA H100 и интерконнекта NVIDIA Quantum-2 InfiniBand. Как заявили в HPE, её суперкомпьютерные решения обеспечивают высокий уровень энергоэффективности, что очень важно, поскольку ИИ-проекты, если не управлять ими правильно, могут значительно повысить углеродный выброс. В компании отметили, что горды сотрудничеством с Crusoe. Целью Crusoe является «преобразование отходов производства энергии в вычислительные ресурсы», которые корпорации, научные и исследовательские учреждения, а также предприниматели смогут использовать для разработки продуктов и решений, способных изменить жизни людей. По словам главы Crusoe, HPE является идеальным партнёром для выполнения миссии, в ходе которой планируется связать будущее вычислительных технологий с будущим климатом планеты.

10.11.2022 [17:15], Владимир Мироненко

HPE анонсировала недорогие, энергоэффективные и компактные суперкомпьютеры Cray EX2500 и Cray XD2000/6500Hewlett Packard Enterprise анонсировала суперкомпьютеры HPE Cray EX и HPE Cray XD, которые отличаются более доступной ценой, меньшей занимаемой площадью и большей энергоэффективностью по сравнению с прошлыми решениями компании. Новинки используют современные технологии в области вычислений, интерконнекта, хранилищ, питания и охлаждения, а также ПО.

Изображение: HPE Суперкомпьютеры HPE обеспечивают высокую производительность и масштабируемость для выполнения ресурсоёмких рабочих нагрузок с интенсивным использованием данных, в том числе задач ИИ и машинного обучения. Новинки, по словам компании, позволят ускорить вывода продуктов и сервисов на рынок. Решения HPE Cray EX уже используются в качестве основы для больших машин, включая экзафлопсные системы, но теперь компания предоставляет возможность более широкому кругу организаций задействовать супервычисления для удовлетворения их потребностей в соответствии с возможностями их ЦОД и бюджетом. В семейство HPE Cray вошли следующие системы:

Все три системы задействуют те же технологии, что и их старшие собратья: интерконнект HPE Slingshot, хранилище Cray Clusterstor E1000 и пакет ПО HPE Cray Programming Environment и т.д. Система HPE Cray EX2500 поддерживает процессоры AMD EPYC Genoa и Intel Xeon Sapphire Rapids, а также ускорители AMD Instinct MI250X. Модель HPE Cray XD6500 поддерживает чипы Sapphire Rapids и ускорители NVIDIA H100, а для XD2000 заявлена поддержка AMD Instinct MI210. В качестве примеров выгод от использования анонсированных суперкомпьютеров в разных отраслях компания назвала:

14.06.2022 [16:33], Владимир Мироненко

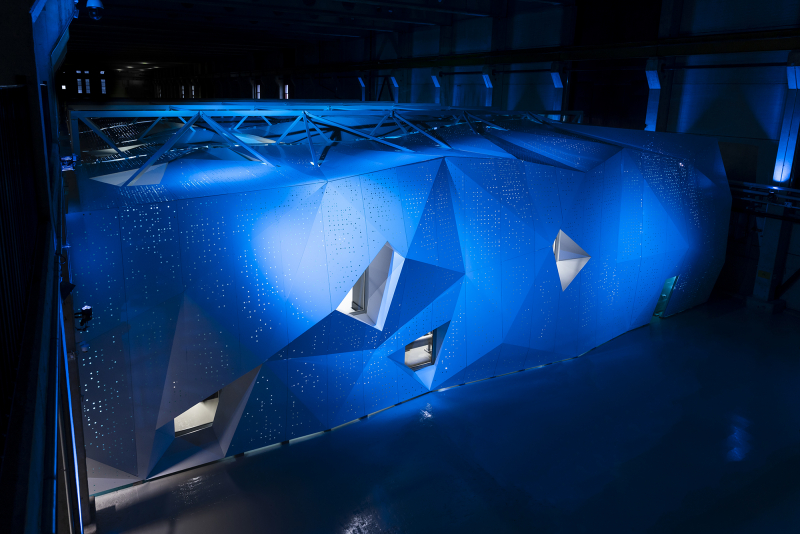

В Финляндии официально запущен LUMI, самый мощный суперкомпьютер в ЕвропеHPE и EuroHPC официально ввели в эксплуатацию вычислительную систему LUMI, установленную в ЦОД центре IT Center for Science (CSC) в Каяани (Финляндия), которая на данный момент считается самым мощным суперкомпьютером в Европе. LUMI — это первая система предэкзафлопсного класса, созданная в рамках совместного европейского проекта EuroHPC. LUMI будет в основном использоваться для решения важных для общества задач, включая исследования в области изменения климата, медицины, наук о жизни и т.д. Система будет применяться для приложений, связанных с высокопроизводительными вычислениями (HPC), искусственным интеллектом и аналитикой данных, а также в областях их пересечения. Для отдельных пользователей суперкомпьютер будет доступен в рамках второй пилотной фазы в августе, а полностью укомплектованная система станет общедоступной в конце сентября. Суперкомпьютер стоимостью €202 млн принадлежит EuroHPC (JU). Половина из этой суммы была предоставлена Евросоюзом, четверть — Финляндией, а остальная часть средств поступила от остальных членов консорциума, включающего 10 стран. По состоянию на 30 мая LUMI занимал третье место в списке TOP500 самых быстрых суперкомпьютеров мира. Сейчас его производительность составляет 151,9 Пфлопс при энергопотреблении 2,9 МВт. LUMI (снег в переводе с финского) базируется на системе HPE Cray EX. Система состоит из двух комплексов. Блок с ускорителями включает 2560 узлов, каждый из которых состоит из одного 64-ядерного кастомного процессора AMD EPYC Trento и четырёх AMD Instinct MI250X. Второй блок под названием LUMI-C содержит только 64-ядерные CPU AMD EPYC Milan в 1536 двухсокетных узлах, имеющих от 256 Гбайт до 1 Тбайт RAM. LUMI также имеет 64 GPU NVIDIA A40, используемых для рабочих нагрузок визуализации, и узлы с увеличенным объёмом памяти (до 32 Тбайт на кластер). Основной интерконнект — Slingshot 11. Хранилище LUMI построено на базе СХД Cray ClusterStor E1000 c ФС Lustre: 8 Пбайт SSD + 80 Пбайт HDD. Также есть объектное Ceph-хранилище ёмкостью 30 Пбайт. Агрегированная пропускная способность СХД составит 2 Тбайт/с. В ближайшее время суперкомпьютер получит дополнительные узлы. После завершения всех работ производительность суперкомпьютера, как ожидается, вырастет примерно до 375 Пфлопс, а пиковая производительность потенциально превысит 550 Пфлопс. Общая площадь комплекса составит порядка 300 м2, а энергопотребление вырастет до 8,5 МВт. Впрочем, запас у площадки солидный — от ГЭС она может получить до 200 МВт. «Мусорное» тепло идёт на обогрев местных домов.

16.04.2022 [23:54], Алексей Степин

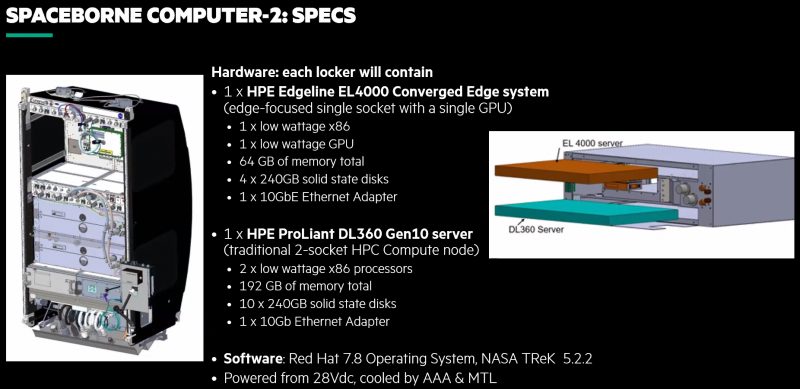

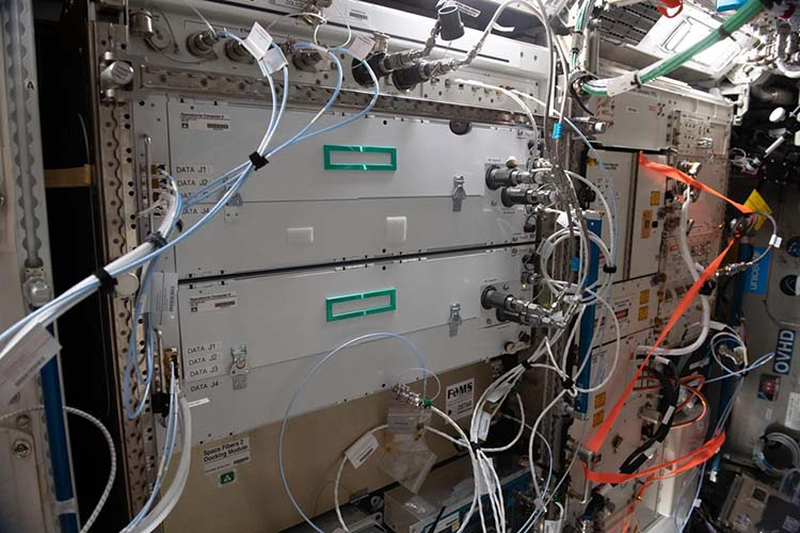

Космический суперкомпьютер HPE Spaceborne-2 успешно завершил 24 эксперимента на МКСПериферийные вычисления подразумевают работу достаточно мощных серверов в нестандартных условиях. Казалось бы, 400 километров — не такое уж большое расстояние. Но если это высота орбиты космической станции, то более «периферийное» место найти будет сложно. А ведь если человечество планирует и далее осваивать космос, оно неизбежно столкнётся и с проблемами, свойственными космическим ЦОД. Первый космический суперкомпьютер, как его окрестили создатели из HPE, появился в 2017 году и успешно проработал на орбите 615 дней. Инженеры учли выявленные особенности работы такой системы на орбите и в прошлом году отправили на МКС Spaceborne-2 (SBC-2), который стал вдвое производительнее предшественника. Хотя SBC-2 по земным меркам и невелик и состоит всего из двух вычислительных узлов (HPE Edgeline EL4000 и HPE ProLiant DL360 Gen10, совокупно чуть более 2 Тфлопс), это самая мощная компьютерная система, когда-либо работавшая в космосе. К тому же, это единственная космическая вычислительная система, оснащённая ИИ-ускорителем NVIDIA T4.

HPE Spaceborne-2 (Изображения: HPE) Теперь же HPE сообщает, что эта машина меньше чем за год помогла в проведении 24 важных научных экспериментов. Всё благодаря достаточно высокой производительности. Одним из первых стал стал анализ генов — обработка данных непосредственно на орбите позволила снизить объём передаваемой информации с 1,8 Гбайт до 92 Кбайт. Но это далеко не единственный результат. Так, ИИ-ускорители были задействованы для визуального анализа микроскопических повреждений скафандров, используемых для выхода в открытый космос. Они же помогли в обработке данных наблюдения за крупными погодными изменениями и природными катаклизмами. Также был проведён анализ поведения металлических частиц при 3D-печати в невесомости, проверена возможность работы 5G-сетей космических условиях, ускорены расчёты требуемых объёмов топлива для кораблей и т.д. Ряд проблем ещё предстоит решить: в частности, в условиях повышенной космической радиации существенно быстрее выходят из строя SSD, что естественно для технологии, основанной на «ловушках заряда». По всей видимости, для дальнего космоса целесообразнее будет использовать накопители на базе иной энергонезависимой памяти. Впрочем, при освоении Луны или Марса полагаться на земные ЦОД тоже будет трудно, а значит, достаточно мощные вычислительные ресурсы придётся везти с собой.

29.01.2022 [01:26], Владимир Мироненко

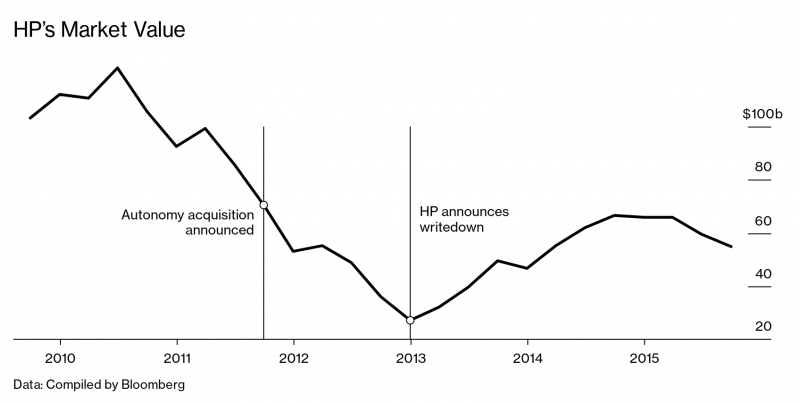

Майк Линч проиграл судебную тяжбу с HP на $5 млрд из-за AutonomyСтало известно, что компания Hewlett Packard (теперь уже HPE) выиграла многомиллиардный иск против британского предпринимателя Майка Линча (Mike Lynch). Девятимесячный судебный процесс, который обошёлся в £40 млн, был одним из самых продолжительных и дорогостоящих в современной британской истории. HP приобрела в 2011 году крупнейшую британскую софтверную компанию Autonomy, основанную Линчем, за $11 млрд, т.е. переплатив почти ⅔ от стоимости акций компании на момент сделки. А год спустя HP была вынуждена списать в убытки активы Autonomy в размере $8,8 млрд, отправив до этого инициатора покупки гендиректора Лео Апотекера (Leo Apotheker) в отставку. HP обвинила Майка Линча в мошенничестве, утверждая, что он и финансовый директор Сушован Хуссейн (Sushovan Hussain) искусственно завышали заявленные доходы Autonomy, показатели роста доходов и валовую прибыль. HP утверждала, что ответчики искажали отчётность с помощью непрофильных продаж, фиктивных транзакций и махинаций с бухгалтерской отчётностью. Иск против Линча и Хуссейна был подан в 2015 году. Хуссейн в 2019 году уже был приговорен в США к 5 годам заключения.

Источник: Bloomberg Quint Судья Роберт Хилдъярд (Robert Hildyard) зачитал в пятницу решение суда, в котором отметил, что HP «склонили к покупке» Autonomy. Он сообщил, что продажа аппаратного обеспечения «позволила Autonomy покрыть недостающие доходы от продаж ПО», и это пришлось скрыть от рынка, чтобы получить одобрение сделки. «Намерения были нечестными — подсудимые прекрасно знали об этом», — подчеркнул судья. Судья также отметил, что сумма компенсации может быть существенно меньше $5 млрд, указанных в иске HP. Адвокат Майка Линча, Келвин Николлс (Kelwin Nicholls) из Clifford Chance заявил, что его клиент намерен подать апелляцию, и назвал результаты слушаний «разочаровывающими». Сегодня же министром внутренних дел Великобритании была одобрена экстрадиции Линча в США, где он предстанет перед американским судом по ещё 17 обвинениям. Сейчас Линч совместно с супругой владеет 16 % компании DarkTrace, капитализация которой составляет около $3,6 млрд.

04.10.2021 [10:00], Алексей Степин

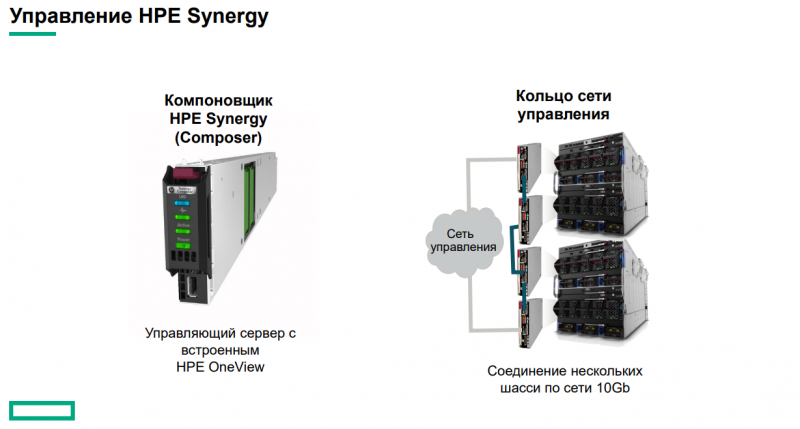

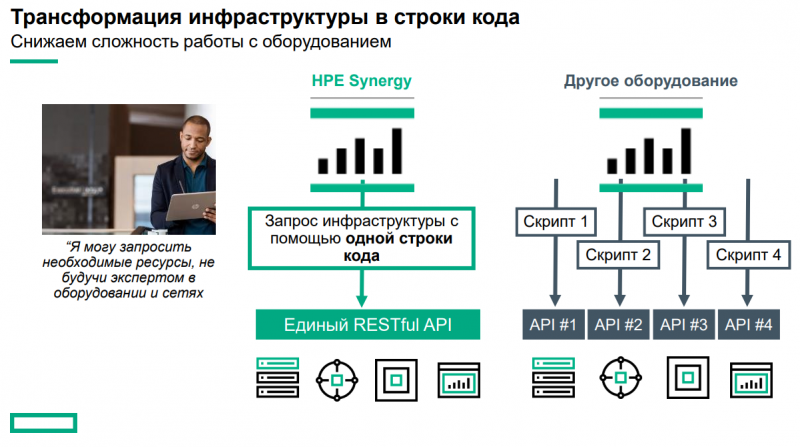

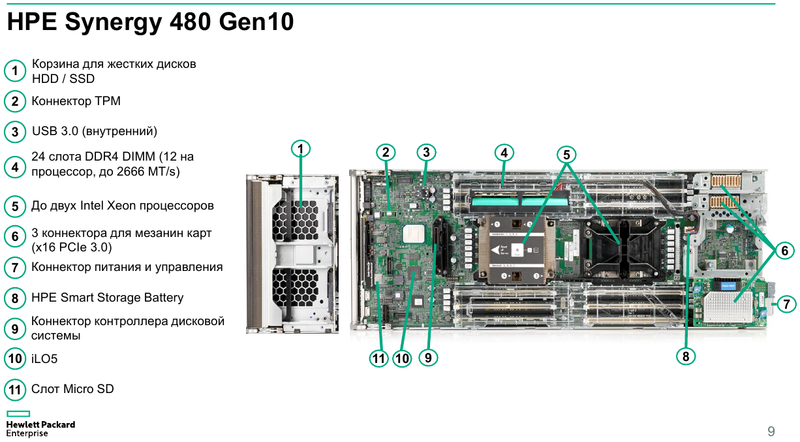

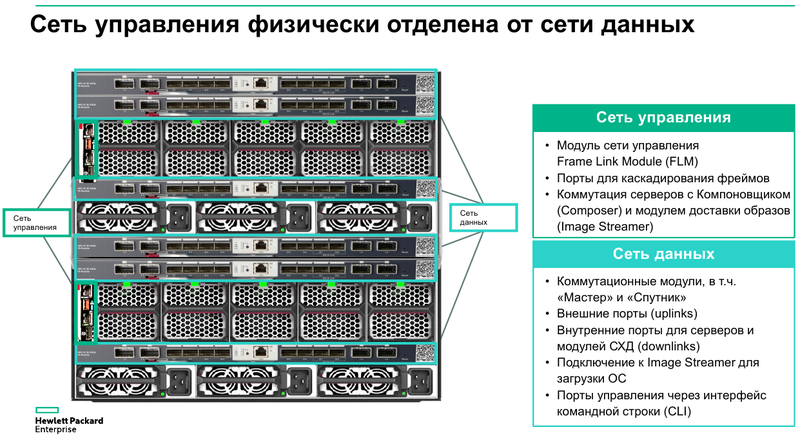

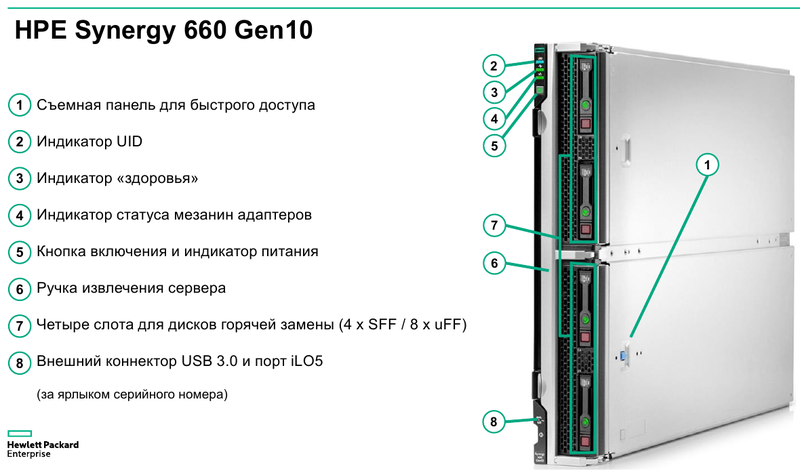

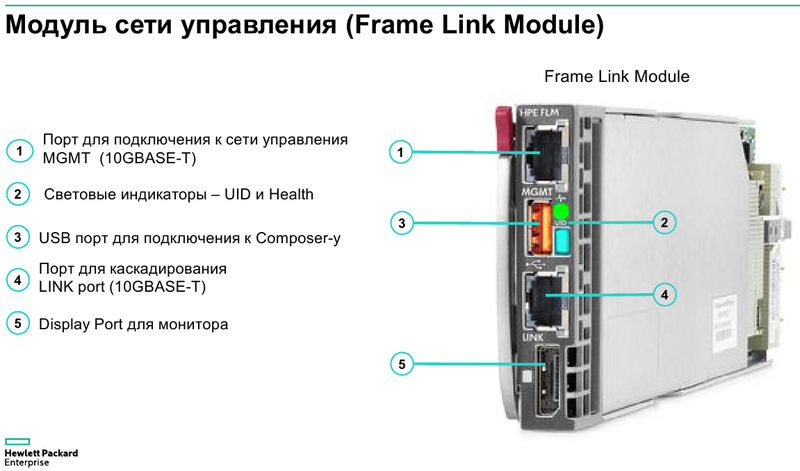

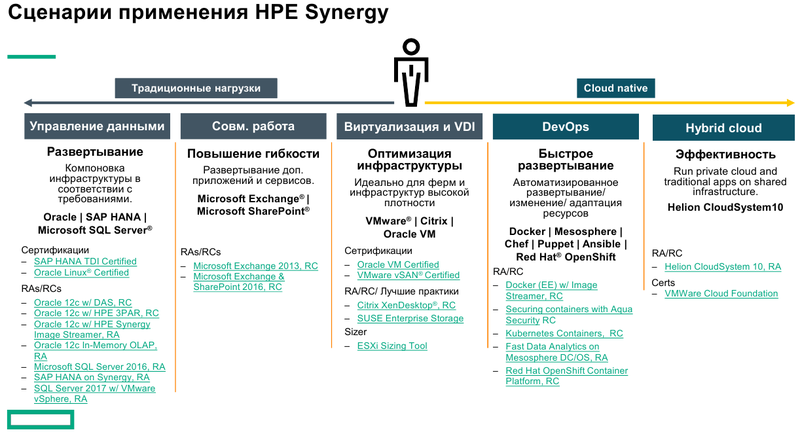

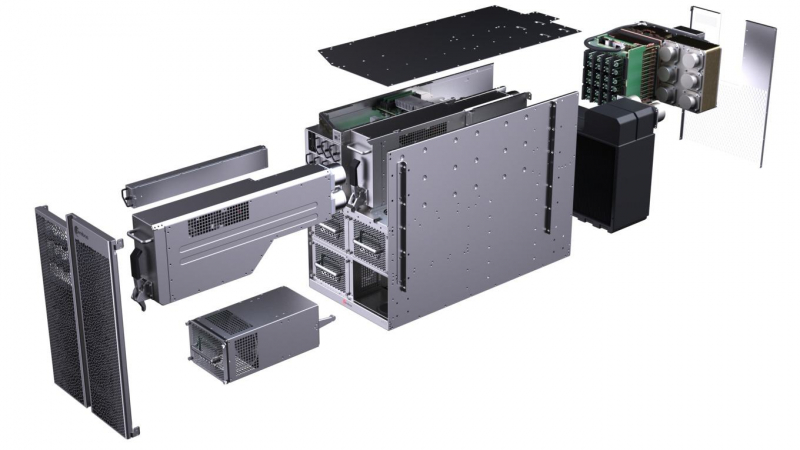

HPE Synergy 12000 как гимн модульности: новая единая ИТ-инфраструктура для любых задачСинергия — эффект совместного действия двух и более факторов, превышающий простую сумму их действий. Слово это пришло к нам из древнегреческого, где означало «единое дело». Но в обычных ЦОД «старой школы» она проявляется далеко не всегда, и расширение, переконфигурирование или смена задачи может стать долгим, затратным предприятием. К тому же в облачную эпоху каждый час простоя инфраструктуры может обернуться серьёзными убытками. Создавая Synergy, HPE позаботилась о том, чтобы максимально унифицировать новую ЦОД-платформу, способную справиться с любым приложением. В основу легла модульно-лезвийная (blade) компоновка, компания называет её «компонуемой». Такая инфраструктура Synergy — это шаг вперёд от обычных гиперконвергентных систем в сторону большей оптимизации и аппаратных, и программных средств.  Единая структура Synergy одинаково хорошо подойдет для любых типов нагрузок. За счёт использования программно определяемой логики, паттернов автоматизации и единой платформы управления OneView затраты на обслуживание ЦОД на базе новой платформы можно существенно снизить, направив высвободившиеся ресурсы на более важные для компании проекты и задачи. Не возникнет и проблем с совместимостью — все компоненты Synergy изначально созданы в рамках единого форм-фактора и являются взаимозаменяемыми. Имеется также задел на будущее: с появлением новых высокоскоростных технологий (фотоники) платформа не устареет, но может быть легко модернизирована. Основные узлы Synergy представляют собой компонуемые модули лезвийного типа Synergy 480 Gen10. Они полностью поддерживают возможность «горячей замены», но самое интересное скрыто внутри: компактная системная плата с двумя Intel Xeon Scalable в окружении 24 слотов DDR4. Поддерживаются все процессоры с теплопакетом до 205 Ватт включительно (до 3,8 ГГц), также поддерживаются модули Optane DCPMM. Имеется специальный слот для дискового контроллера. Само «лезвие» оснащено или двумя SFF-дисками, или четырьмя SSD формата uFF.  Также к узлу можно подключать до трёх мезаниновых карт расширения с интерфейсом PCI Express x16, правда, только версии 3.0. Эти карты предельно компактны. Так, основой для сетевой инфраструктуры может служить адаптер Synergy 6810C, поддерживающий стандарты Ethernet со скоростями 25 и 50 Гбит/с. Он базируется на технологиях Mellanox и поддерживает RoCEv2.  В конструкции изначально предусмотрена резервная батарея (BBU) для сохранения дисковых кешей, тогда как обычный RAID-контроллер не во всякой комплектации имеет BBU. Из прочего отметим наличие системы удалённого мониторинга и управления HPE iLO5 и продвинутую реализацию подключения к системе: за управление данными и питанием отвечает выделенный чип-контроллер.  Есть в вариантах Synergy 480 Gen10 и модуль двойной ширины, предназначенный специально для установки графических или вычислительных ускорителей. Несмотря на скромные габариты, он может принять в себя шесть ускорителей в формате Multi MXM, либо две мощные видеокарты в классическом исполнении. Ещё более производительны модули HPE Synergy 660 Gen10. Они вдвое выше Synergy 480, так что внутри может размещаться уже восемь uFF-накопителей, либо четыре SFF и четыре M.2. Процессорных разъёмов четыре, а количество слотов памяти равно 48. Мезонинов тоже вдвое больше, то есть шесть.  Для высокоплотного хранения данных предлагается использовать модуль Synergy D3940. В нём размещается до 40 накопителей общим объёмом 612 Тбайт, причём поддерживается любое сочетание дисков SAS и SATA. Реализованы операции как на файловом уровне, так и на блочном и даже объектном. Предусмотрено два адаптера ввода/вывода, которые при необходимости быстро заменяются. Сами накопители физически отделены от RAID-контроллеров и связаны с ними независимыми модулями коммутации. Модуль коммутации поддерживает 48 портов SAS, обслуживает до 40 SSD на модуль с производительностью до 50 тыс. IOPS на каждый SSD. Компания хорошо понимает, что за счёт совместимости с оборудованием других производителей охват рынка будет шире, поэтому Synergy легко интегрируется с системами хранения данных, разработанными вне стен HPE. Поддерживаются решения Fibre Channel, FC over Ethernet и iSCSI таких компаний, как Hitachi Data Systems, Net App, IBM и даже извечного конкурента HPE — Dell EMC. На программном уровне обеспечена совместимость с виртуальными SAN Scality, VMWare, Ceph и Microsoft.  Для связи с SAN и LAN предлагаются различные коммутационные модули с портами вплоть до FC32 и 100GbE. Все эти модули объединяются в рамках 10U-шасси HPE Synergy 12000: до 12 вычислительных, 6 коммутационных и 5 модулей хранения данных. Новое шасси во всём лучше HPE Blade System c7000 прошлого поколения. Оно мощнее, лучше охлаждается, имеет более эффективную систему питания, а общая коммутационная плата для узлов поддерживает суммарную скорость передачи данных до 16 Тбит/с и изначально готова к переходу на использование высокоскоростной фотоники.  Шасси позволяет сформировать шасси с оптимальным набором компонентов, и HPE предлагает типовые варианты конфигураций в зависимости от задачи: базы данных, виртуальные машины, платформы аналитики, максимально ёмкие СХД или платформа для вычислений на графических ускорителях. Все компоненты предельно унифицированы, все базовые функции являются программно-определяемыми и унифицированными. Даже кабели придётся подключить только во время установки. После этого систему можно «нарезать» на отдельные фабрики с нужным набором дискового пространства, числа ядер CPU и GPU, объёмом памяти и сетевых подключений.  На уровне фабрик HPE позаботилась о резервировании и физическом разделении сетей управления и данных. Есть отдельное подключение к серверу образов для загрузки операционных систем и отдельные порты управления. Сетевые коммутаторы могут быть типов «Мастер» или «Спутник». Первый отвечает за весь сетевой трафик и обладает минимальными задержками, а второй является повторителем сигнала и содержит ретаймеры; задержка в передаче сетевого пакета не превышает 8 нс. Поддерживаются порты со скоростью 10 и 20 Гбит/с. Дирижёром всего этого оркестра является модуль компоновщика (composer). Он базируется на фирменном управляющем ПО HPE OneView. При необходимости настроить систему на месте в дело вступает модуль сети управления (frame link module), который имеет разъём Display Port для монитора и порт USB. Если обычная процедура ввода в строй нового сервера содержит множество пунктов, от установки его в стойку до настроек BIOS и установки ОС, то в Synergy достаточно установить новый модуль в шасси и применить нужный серверный профиль из шаблона. Остальное система сделает сама.  Компоновщик поддерживает форматы виртуализации Hyper-V и ESXi, а фирменное ядро OneView работает с аппаратными и сетевыми компонентами, но наружу информация предоставляется посредством стандартного API RESTful. Предусмотрено управление как с помощью веб-интерфейса, так и с помощью различного ПО — CHEF, Microsoft PowerShell или System Center; имеется также и фирменное приложение HPE OneView для VMWare. Таким образом, перед нами действительно уникальная, инновационная технология. HPE Synergy образует совершенно новый класс систем, по-настоящему универсальных на всех уровнях построения и конфигурации. Образуемая этим «конструктором» инфраструктура подходит для выполнения любого класса задач, причём разворачивается она по меркам мира ИТ практически мгновенно, буквально одной строкой кода, и сразу в нужных заказчику масштабах, в том числе облачных.  Простои практически исключены, все элементы унифицированы и легко заменяются, управление аппаратными серверами в облаке так же просто, как и традиционными виртуальными машинами. Использование HPE Synergy или модернизация ИТ-экосистемы этой новинкой означает сокращение как финансовых затрат, так и трудовых ресурсов, а единый API позволяет провести такую модернизацию постепенно, но в кратчайшие сроки за счёт совместимости с оборудованием СХД других поставщиков. Кому подойдёт HPE Synergy? Всем, но особенно крупным компаниям, специализирующимся на ресурсоёмких ИТ-задачах любого класса, включая телеком, CAD/CAM, VDI, 3D-моделирование, а также медицину. Более того, именно медикам новинка подойдёт особенно хорошо. Об этом хорошо рассказывает нижеприведённое видео: Сценариев развёртывания Synergy может быть множество, вот лишь некоторые из них:  Сама HPE называет десять причин для выбора Synergy. Они просты и понятны:

При этом заказать Synergy весьма просто: компания готова как к немедленной отправке оплаченного оборудования со склада, так и к компоновке под заказ. В России поставкой систем HPE Synergy занимается компания OCS, авторизованный партнёр Hewlett Packard Enterprise с опытом работы более 25 лет. Системы могут поставляться во все регионы страны, партнёрам предоставляются дополнительные удобные сервисы. Также отметим, что 12 октября в 10:00 по московскому времени состоится веб-семинар, посвящённый новой модульной платформе HPE. Записаться на него можно здесь.

08.09.2021 [19:31], Алексей Степин

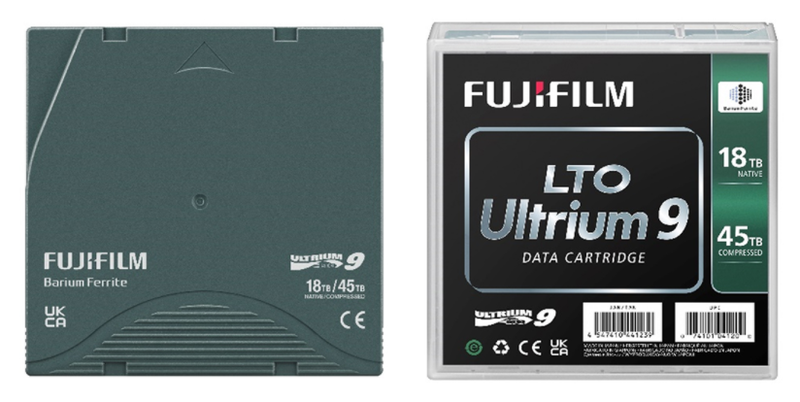

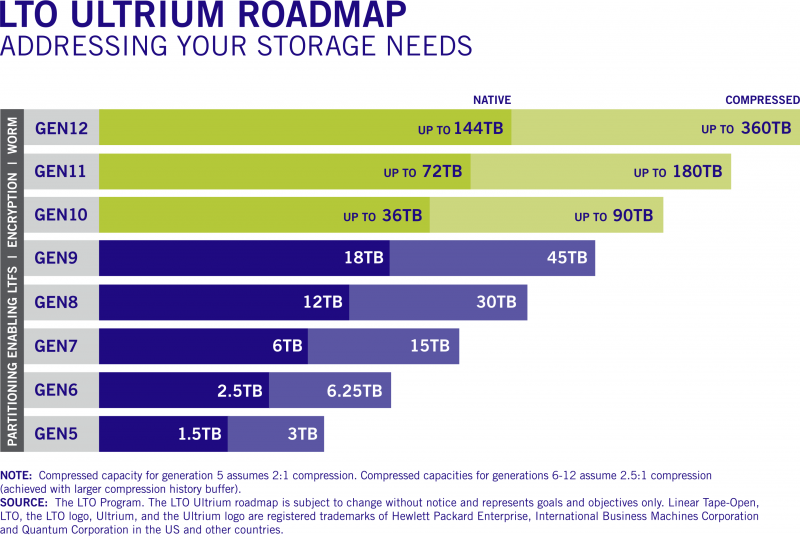

Fujifilm и HPE представили ленточные картриджи LTO-9 ёмкостью 45 ТбайтЛенточные накопители и библиотеки остаются одним из самых популярных вариантов для «холодного» хранения больших объёмов данных, и новые технологии в этой сфере продолжают активно развиваться. Компании Fujifilm и HPE объявили о выпуске ленточных картриджей LTO-9 Ultrium, эффективная ёмкость которых достигает 45 Тбайт. Правда, эта цифра относится к режиму со сжатием данных, «чистая» же ёмкость LTO-9 составляет 18 Тбайт. Для сравнения, картриджи LTO-8 могут хранить до 12 и 30 Тбайт несжатых и сжатых данных соответственно, Хотя налицо паритет с традиционными HDD, темпы прироста ёмкости LTO замедлились: так, при переходе от седьмого поколения к восьмому «чистый» объём вырос вдвое (с 6 до 12 Тбайт), а сейчас мы видим лишь 50% прирост. Тем не менее, в будущем планируется вернуться к удвоению ёмкости в каждом новом поколении. Скорость передачи данных LTO-9 в сравнении c LTO-8 выросла, но ненамного: с 360/750 Мбайт/с до 440/1000 Мбайт/с в режимах без сжатия и со сжатием соответственно.  В новых картриджах Fujifilm используется лента на основе феррита бария (BaFe), покрытие формируется с использованием фирменной технологии NANOCUBIC. Компания заявляет о 50 годах стабильного хранения данных с использованием новой ленты. HPE пока что ограничилась коротким сообщением о выходе RW- и WORM-картриджей. Quantum анонсировала приводы LTO-9, а IBM объявила о совместимости ПО Spectrum Archive с новым стандартом. Наконец, Spectra Logic сообщила о поддержке нового стандарта в своих ленточных библиотеках. Ленточные накопители, пожалуй, являются своеобразными патриархами в мире систем хранения данных — магнитная лента использовалась ещё в первых компьютерах IBM. Однако даже сегодня именно они могут похвастаться одной из самых больших ёмкостей в пересчёте на единицу носителя, а кроме того, имеют и ряд других достоинств, например, повышенную надёжность хранения данных за счёт «пассивного» характера хранения записанной информации.

В будущем темпы роста ёмкостей картриджей LTO будут восстановлены Также ленточные библиотеки могут похвастаться меньшей стоимостью владения, нежели HDD-фермы или облачные хранилища. Среди областей применения ленточных накопителей и библиотек называется сценарий защиты данных от «шифровальщиков» и вымогательства, поскольку при необходимости уцелевшую копию можно просто восстановить с картриджа. Однако при современных объёмах данных даже скорость 3,6 Тбайт/час может оказаться недостаточно быстрой.

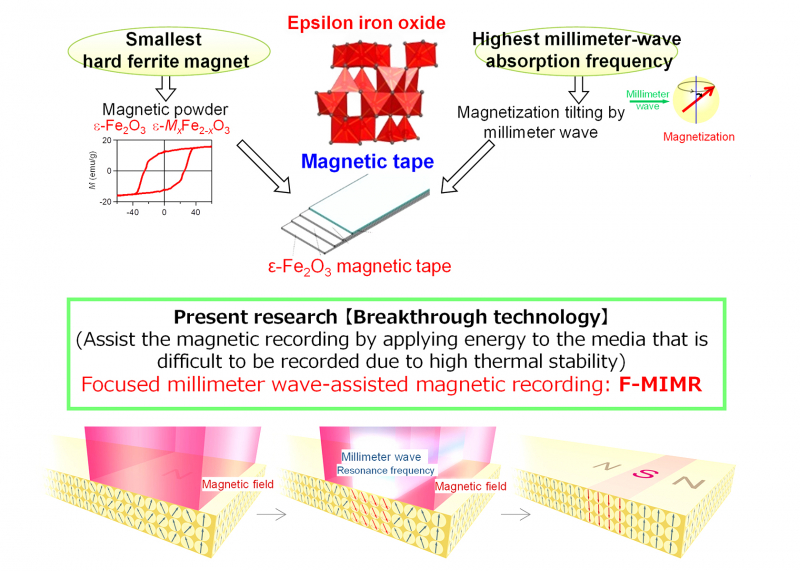

Петабайтные ёмкости потребуют перехода от феррита бария к эпсилон-ферриту железа (ɛ-Fe2O3) Тем не менее, развитие LTO не останавливается. В экспериментальных устройствах ещё в конце 2020 года была достигнута ёмкость 580 Тбайт, а уже 2021 году было объявлено уже о разработке лент и накопителей, способных хранить до 2,5 Пбайт сжатых данных. Так что говорить о смерти ленточных накопителей не приходится, хотя пандемия и повлияла отрицательно на объёмы продаж оборудования LTO.

28.05.2021 [00:33], Владимир Мироненко

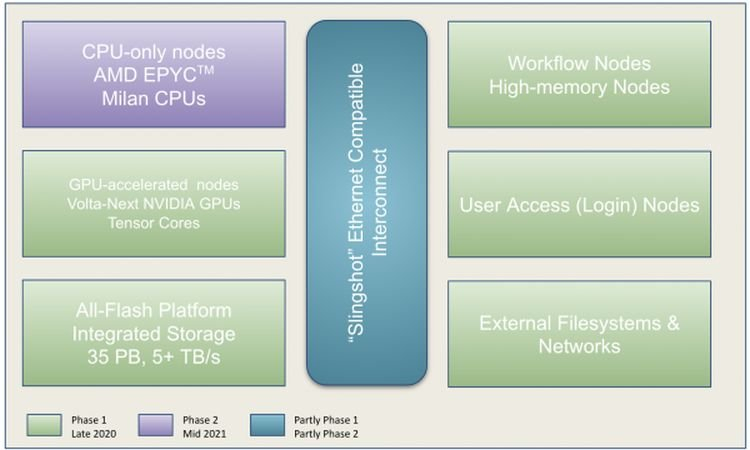

Perlmutter стал самым мощным ИИ-суперкомпьютером в мире: 6 тыс. NVIDIA A100 и 3,8 ЭфлопсВ Национальном вычислительном центре энергетических исследований США (NERSC) Национальной лаборатории им. Лоуренса в Беркли состоялась торжественная церемония, посвящённая официальному запуску суперкомпьютера Perlmutter, также известного как NERSC-9, созданного HPE в партнёрстве с NVIDIA и AMD. Это самый мощный в мире ИИ-суперкомпьютер, базирующийся на 6159 ускорителях NVIDIA A100 и примерно 1500 процессорах AMD EPYC Milan. Его пиковая производительность в вычислениях смешанной точности составляет 3,8 Эфлопс или почти 60 Пфлопс в FP64-вычислениях. Perlmutter основан на платформе HPE Cray EX с прямым жидкостным охлаждением и интерконнектом Slingshot. В состав системы входят как GPU-узлы, так и узлы с процессорами. Для хранения данных используется файловая система Lustre объёмом 35 Пбайт скорость обмена данными более 5 Тбайт/с, которая развёрнута на All-Flash СХД HPE ClusterStor E1000 (тоже, к слову, на базе AMD EPYC). Установка Perlmutter разбита на два этапа. На сегодняшней презентации было объявлено о завершении первого (Phase 1) этапа, который начался в ноябре прошлого года. В его рамках было установлено 1,5 тыс. вычислительных узлов, каждый из которых имеет четыре ускорителя NVIDIA A100, один процессор AMD EPYC Milan и 256 Гбайт памяти. На втором этапе (Phase 2) в конце 2021 года будут добавлены 3 тыс. CPU-узлов c двумя AMD EPYC Milan и 512 Гбайт памяти., а также ещё ещё 20 узлов доступа и четыре узла с большим объёмом памяти.

NERSC Также на первом этапе были развёрнуты служебные узлы, включая 20 узлов доступа пользователей, на которых можно подготавливать контейнеры с приложениями для последующего запуска на суперкомпьютере и использовать Kubernetes для оркестровки. Среда разработки будет включать NVDIA HPC SDK в дополнение к наборам компиляторов CCE (Cray Compiling Environment), GCC и LLVM для поддержки различных средств параллельного программирования, таких как MPI, OpenMP, CUDA и OpenACC для C, C ++ и Fortran. Сообщается, что для Perlmutter готовится более двух десятков заявок на вычисления в области астрофизики, прогнозирования изменений климата и в других сферах. Одной из задач для новой системы станет создание трёхмерной карты видимой Вселенной на основе данных от DESI (Dark Energy Spectroscopic Instrument). Ещё одно направление, для которого задействуют суперкомпьютер, посвящено материаловедению, изучению атомных взаимодействий, которые могут указать путь к созданию более эффективных батарей и биотоплива.

19.06.2020 [18:09], Юрий Поздеев

HPE анонсировала Superdome Flex 280: 224 ядра Cooper Lake и 24 Тбайт RAMHPE анонсировала Superdome Flex 280 с поддержкой процессоров Intel Xeon третьего поколения, которые вышли недавно. Данная модель дополняет портфель HPE Superdome Flex и ориентирована на средние предприятия, для которых избыточна масштабируемость до 32 сокетов. Оптимально данная модель подойдет для больших баз Oracle, SAP HANA или SQL-сервера. Новинка выпускается в форм-факторе 5U и поддерживает установку 2 или 4 процессоров Intel Xeon Gold или Intel Xeon Platinum. Это выгодно отличает Superdome Flex от других подобных систем, в которых можно использовать только Intel Xeon Platinum, который стоит значительно дороже.  Недавно анонсировали новые процессоры Intel Xeon третьего поколения, в которых не только добавили функции ускорения ИИ, но и поддержку более быстрой памяти DDR4-3200, что должно положительным образом сказаться на производительности. Максимально в одну платформу можно установить до 24 Тбайт оперативной памяти, а если и этого недостаточно, то можно использовать Intel Optane PMem 200 .  Слотов расширения PCIe тоже достаточно для большинства задач — до 32 на одну платформу, при этом можно установить до 16 графических ускорителей NVIDIA. Для локального хранилища можно использовать до 20 накопителей SAS/SATA/NVMe. Масштабируется платформа Superdome Flex 280 до 8 процессоров с шагом в 2 CPU, что позволяет работать с большими базами данных и моделями для ИИ, для которых требуется большой объем оперативной памяти. Суммарно можно получить до 224 ядер и до 24 Тбайт общей памяти. HPE Superdome Flex 280 будет доступен в 4 квартале 2020 года.

09.06.2020 [19:49], Юрий Поздеев

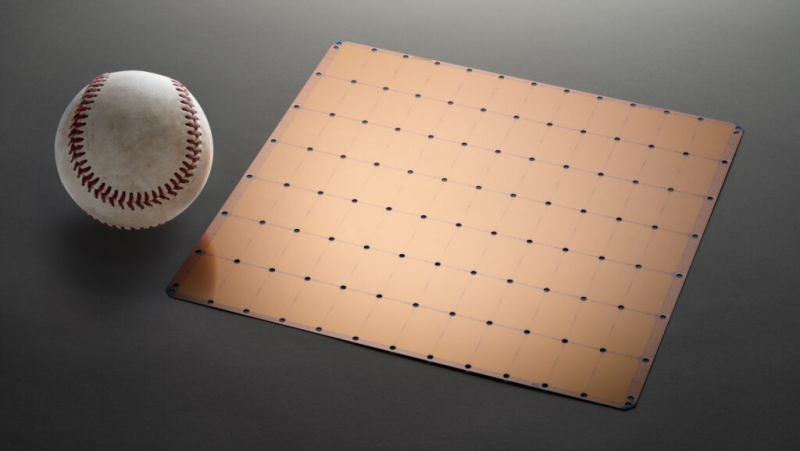

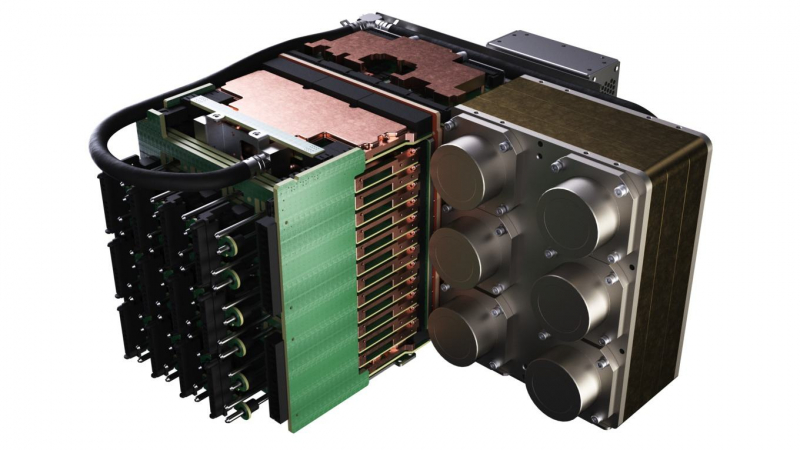

Суперкомпьютер Neocortex: 800 тыс. ядер Cerebras для ИИПиттсбургский суперкомпьютерный центр (PSC) получит $5 млн от Национального научного фонда на создание суперкомпьютера нового типа Neocortex, который объединяет ИИ-серверы Cerebras CS-1 и HPE SuperDome Flex в единую систему с общей памятью. Планируется, что решение будет введено в эксплуатацию до конца 2020 года.  Каждый сервер Cerebras CS-1 имеет процессор Cerebras Wafer Scale Engine (WSE), который содержит 400 000 ядер, оптимизированных для работы с ИИ (46 225 мм2, 1,2 трлн транзисторов). В паре с ними работает HPE SuperDome Flex, который используется для предварительной обработки информации и постобработки после Cerebras. SuperDome Flex представлен в максимальной комплектации, то есть с 32 процессорами Intel Xeon, 24 Тбайт оперативной памяти, 205 Тбайт флеш-памяти и 24 интерфейсными картами.  Каждый сервер Cerebras CS-1 подключается к SuperDome Flex через 12 каналов со скоростью 100 Гбит/с каждый. Процессор WSE способен обрабатывать 9 Пбайт данных в секунду, что, по подсчетам Nystrom, эквивалентно примерно миллиону фильмов в HD-качестве. Характеристики решения действительно впечатляют!

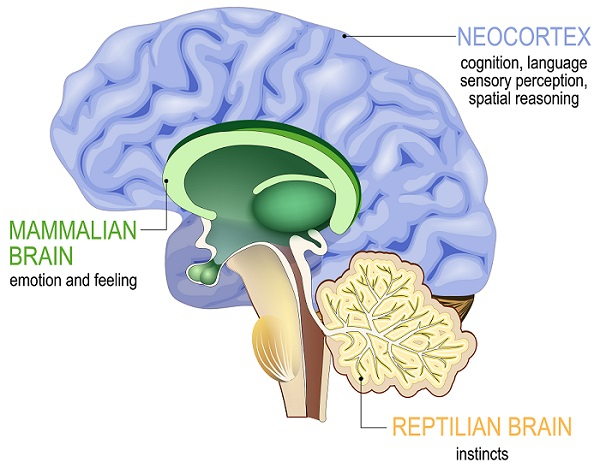

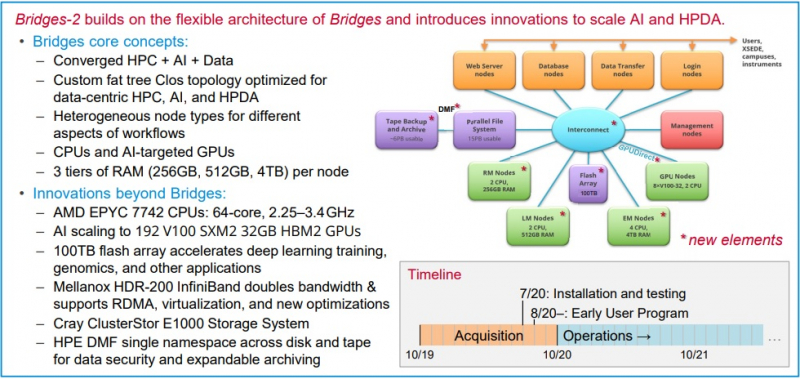

Neocortex назван в честь области мозга, отвечающей за функции высокого порядка, включая когнитивные способности, сновидения и формирование речи Архитектура решения строилась таким образом, чтобы не пришлось разбивать вычислительные блоки на множество узлов — это позволило снизить задержки в обработке информации и ускорить обучение моделей ИИ. Cerebras CS-1 разрабатывался специально для ИИ, поэтому он имеет преимущества перед серверами с графическими ускорителями, которые хорошо справляются с матричными операциями, но имеют многие конструктивные ограничения.  По заявлениям Neocortex, сервер CS-1 будет на несколько порядков мощнее системы PSC Bridges-AI. Один сервер Neocortex CS-1 будет эквивалентен примерно 800-1500 серверов с традиционной архитектурой с использованием графических ускорителей. Задачи, в которых Neocortex покажет себя максимально эффективно относятся к классу нейронных сетей DCIGN (deep convolutional inverse graphics networks) и RNN (recurrent neural networks). Если говорить простыми словами, то это более точное прогнозирование погоды, анализ геномов, поиск новых материалов и разработка новых лекарств.  PSC, помимо Neocortex, запускает еще и новое поколение системы Bridges-2, которое будет развернуто осенью 2020 года. Таким образом, до конца этого года будут введены в эксплуатацию два мощных суперкомпьютера для ИИ. Neocortex и Bridges-2 будут поддерживать самые популярные фреймворки машинного обучения, что позволит создать гибкую и мощную экосистему для ИИ, анализа данных, моделирования и симуляции. До 90% машинного времени Neocortex будет выделяться через XSEDE (Extreme Science and Engineering Discovery Environment), финансируемую NSF организацию, которая координирует совместное использование передовых цифровых услуг, включая суперкомпьютеры и ресурсы для визуализации и анализа данных, с исследователями на национальном уровне. |

|