Материалы по тегу: оптоволокно

|

26.11.2024 [22:44], Владимир Мироненко

На фоне ажиотажа вокруг ИИ акции японского производителя оптических кабелей выросли с начала года на 400 %Акции японской компании Fujikura, которая производит оптоволокно и кабели, выросли в этом году более чем на 400 %. 25 ноября её акции включили в глобальный стандартный индекс MSCI 25. Компания стала единственным новичком индекса из Японии, тогда как акции восьми других японских компаний из индекса были убраны, пишет Bloomberg. Fujikura является классическим примером стратегии инвестиций «кирки и лопаты», когда деньги вкладывают не в конечный продукт, а в технологии для его производства, говорят эксперты. Аналитики Bloomberg News оценили расходы на строительство ЦОД и соответствующей инфраструктуры, необходимой для работы с ИИ, в не менее чем $1 трлн. Согласно прогнозу McKinsey & Company, глобальная мощность ЦОД будет расти в среднем на 33 % в год до 2030 года. Fujikura, среди крупнейших клиентов которой значится Apple, специализируется в том числе на производстве оптоволокна, кабелей из него и иных сопутствующих продуктов и решений. Продукция компании отличается одним из самых маленьких диаметров в отрасли, что позволяет использовать кабели в узких пространствах, говорит представитель Fujikura. Ранее в этом месяце компания повысила прогноз по операционному доходу на текущий финансовый год на 17 % до ¥104 млрд ($674 млн). Благодаря буму ИИ прогноз продаж повысила и Corning. Более 70 % выручки Fujikura получает от поставок за рубеж, причем около 38 % приходится на США. Текущий бум резко контрастирует с 2020 годом, когда компания впервые за более чем десять лет сообщила об убытках. Пандемия COVID и торговая война США и Китая негативно отразились на продажах Fujikura. Компания не волнуется о смене президента в США, поскольку она приняла меры для соблюдения американского законодательства, требующего во избежание пошлин, чтобы не менее 55 % готовой продукции и строительных материалов, используемых в инфраструктурных проектах, производились в США. «Мы только что завершили создание производственной базы, соответствующей BABA (закон Build America, Buy America Act), для сверхплотных оптоволоконных кабелей в Соединённых Штатах», — сообщил финансовый директор Fujikura Казухито Иидзима (Kazuhito Iijima). Это защитит бизнес компании «даже если возникнут новые проблемы, связанные с поставкой импортных материалов», отметил он. Fujikura заявила, что уже определила следующую большую возможность роста — термоядерный синтез. Перспектива выработки теоретически безграничного объёма чистой энергии получила поддержку многих миллиардеров, включая Сэма Альтмана (Sam Altman), Джеффа Безоса (Jeff Bezos) и Билла Гейтса (Bill Gates). Хотя пока не доказано, что технология работает для крупномасштабного производства электроэнергии, но когда её начнут применять в промышленных масштабах, возникнет потребность в кабелях и проводах. «Мы надеемся, что это станет опорой отрасли с 2030 года», — сказал Иидзима.

07.11.2024 [08:54], Руслан Авдеев

Microsoft Research создала двух роботов для обслуживания сети в ЦОДКоманда Microsoft Research поделилась информацией о прототипах робототехники, предназначенной для обслуживания дата-центров. Соответствующую команду компания сформировала год назад. Как передаёт Datacenter Dynamics, её представители заявили о самом начале «фундаментального сдвига» в принципах разработки оборудования и ПО для ЦОД. Ключевым, по мнению исследователей Microsoft, является отход от попыток создания гуманоидных роботов. Вместо них предлагается использование самодостаточных модульных роботов для узкопрофильных задач, способных заниматься как ремонтом оборудования, так и его текущим обслуживанием. А мониторинг и автоматизация позволят проактивно выявлять возможное поломки до наступления инцидентов. Увы, развитие технологий не привело к существенному снижению отказов в сложных системах, констатируют исследователи. А человеческий фактор становится всё более значимым. В Microsoft Research рассказали о прототипах двух роботов, предназначенных для обслуживания ЦОД. Первый оснащён рукой-манипулятором и захватом для обслуживания отдельных трансиверов. Захват позволяет аккуратно поправлять, вставлять и вынимать трансиверы из корзин, не задевая кабели и соседние трансиверы, что нередко случается, когда обслуживанием занимается живой техник. Система машинного зрения позволяет роботу оценивать сложную окружающую среду и автономно ориентироваться в скоплениях кабелей. Второй робот предназначен для очистки волокон и трансиверов. Трансивер с подключённым кабелем достаточно поместить внутрь робота, что может сделать человек или роборука. Робот способен самостоятельно вынимать кабель из трансивера и осматривать торец кабеля и гнездо в трансивере, при необходимости очищая их. Для человека это довольно трудоёмкий процесс, особенно в случае MPO-кабелей. Робот использует камеры и специальные модули распознавания для определения типа кабеля. Дисплей на роботе позволяет получать вспомогательную информацию оператору и крупным планом осматривать проверяемые подключения. Теперь компания концентрирует усилия на создании малых модулей для минимизации количества форм-факторов машин, необходимых для поддержки широкого спектра операций. Многие из участников нового проекта работали над роботами для хранилищ Project Silica. Такие роботы способны автономно передвигаться между стойками, а также вверх и вниз по самим стойкам. Команда разделила процесс эволюции робототехники для ЦОД на четыре этапа. Level 1 предусматривает использование машин для помощи людям, Level 2 допускает частичную автоматизацию, где роботы могут выполнять специальные задачи под наблюдением людей, Level 3 предусматривает высокий уровень автоматизации с ограниченным контролем со стороны людей. Наконец, на уровне Level 4 обеспечена полная автоматизация, все операции по ремонту и обслуживанию ЦОД не нуждаются в человеческом участии. На уровне Level 4 речь идёт о полностью «самодостаточных» дата-центрах, физически не рассчитанных на участие в процессах людей и оптимизированных для работы в условиях высокой плотности стоек и высокой энергетической эффективности. Люди смогут наблюдать за ЦОД без личного присутствия в помещениях. Учёные подчёркивают, что даже создание роботов первого и второго уровней — непростая задача, и сейчас их усилия направлены именно на такие системы. Тем не менее считается, что после достижения второго уровня переход к Level 3–4 будет легче. Конечно, над проектами роботизации ЦОД работают не только в Microsoft. Google тоже создаёт технологии, способные заменить людей при обслуживании дата-центров, а роботов-сопровождающих и робособак-патрульных уже используют довольно широко по всему миру разные вендоры. Интересно, что Meta✴ тоже начала создание роботов с систем TopoOpt для обслуживания сетей.

09.07.2024 [15:59], Руслан Авдеев

Да будет свет: Corning повысила прогноз продаж благодаря буму ИИCorning повысила прогноз продаж во II квартале 2024 года на $200 млн. Datacenter Knowledge сообщает, что во многом это обусловлено недооценённым ранее спросом на оптоволоконные соединения в дата-центрах для ИИ-задача. Теперь квартальные продажи должны достичь $3,6 млрд, тогда как ранее ожидалось, что они не превысят $3,4 млрд. Также компания прогнозирует возвращение роста выручки год к году. Как заявили в компании, рост во многом связан с большой востребованностью новых оптоволоконных решений для генеративного ИИ. В следующие три года ожидается увеличение годовых продаж более чем на $3 млрд под влиянием «циклических факторов и долговременных трендов». Итоговые финансовые результаты II квартала будут объявлены 30 июля. На фоне этих заявлений акции Corning выросли в цене. В компании связывают более оптимистичные прогнозы с рядом факторов, в первую очередь — успешными продажами оптоволокна для интерконнекта. Так, по данным Corning, параллельные ИИ-вычисления с помощью современных ускорителей требуют в 10 раз больше оптоволокна, чем традиционные облачные сети. Согласен расчётам компании, NVIDIA GB200 NVL72 требуется 576 волокон, то есть в 18 раз больше, чем в стойке с классическими серверными CPU. Corning является стратегическим активом для США, поскольку выпускает значительную часть оптоволокна для американских ВОЛС. Оптоволокно также является и важнейшим компонентом в самих ЦОД. А гиперскейлеры сейчас активно вкладываются в развитие инфраструктуры. Одна только Microsoft ежемесячно развёртывает по пять ИИ-суперкомпьютеров и рассчитывает до конца года иметь до 1,8 млн ускорителей на базе GPU, практически каждому из которых требуется собственное сетевое подключение. По данным Synergy Research Group, количество крупных ЦОД, управляемых гиперскейлерами, достигло 992 шт. ещё в конце 2023 года. Ожидается, что ежегодно они будут вводить в строй ещё 120–130 дата-центров, а генеративный ИИ называют первоочередной причиной такого взрывного роста. Рост инвестиций в ЦОД совпадает со значительным падением трат телеком-операторов по всему миру — это отчасти сказалась на показателях вендоров от Ericsson до Crown Castle и Corning. В результате многие вендоры стали искать новые возможности для роста. Так, Nokia назвала желание укрепиться на рынке ЦОД первоочередной причиной покупки Infinera за $2,3 млрд — это увеличит влияние компании на рынке ЦОД. Большие планы, связанные с развитием ИИ, вынашивают и в Cisco. Тем не менее, поставщики уверены, что телеком-операторы со временем возобновят закупки оптоволокна. Пока они используют избыточные запасы, накопленные во время пандемии COVID-19, но скоро эти резервы истощатся. Кроме того, в последние месяцы ведутся переговоры о развёртывании новых широкополосных телеком-магистралей. Corning подтвердила эти ожидания, во многом связанные с масштабной государственной программой США Broadband Equity Access and Deployment (BEAD).

27.03.2024 [14:48], Владимир Мироненко

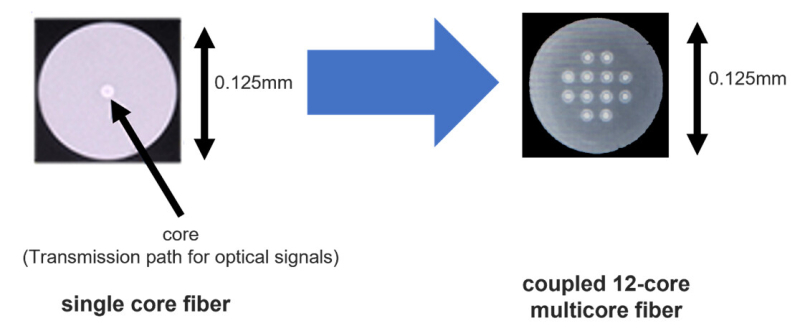

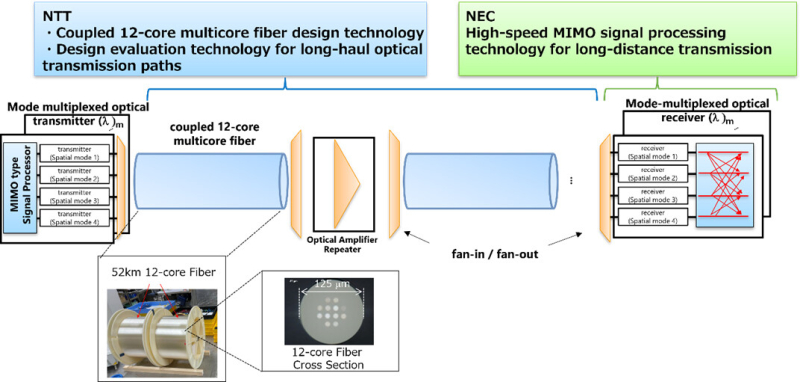

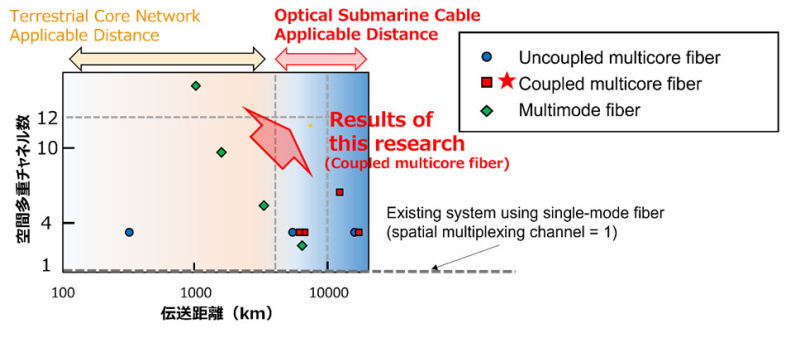

NTT и NEC успешно протестировали технологию, позволяющую увеличить пропускную способность подводных кабелейЯпонские компании NTT и NEC объявили об успешном тестировании новой оптоволоконной технологии, которая позволяет существенно увеличить пропускную способность подводных кабелей. Испытания проводились на спаренном 12-жильном волоконно-оптическом кабеле длиной 7280 км, пишет DataCenter Knowledge. Компании отметили, что в существующих оптических подводных кабелях используется волокно с одной сердцевиной, которое имеет один оптический путь передачи. Исследователи во всем мире работают над созданием волокон с несколькими сердцевинами, имеющих больше путей передачи сигнала без увеличения размера стандартной оболочки диаметром 125 мкм. В частности, NTT и NEC работают над созданием оптоволокна с 12 сердцевинами. «Ожидается, что это достижение станет технологией инфраструктуры передачи следующего поколения, которая будет способствовать реализации оптических сетей большой пропускной способности, включая будущие оптические подводные кабели», — указано в заявлении NTT и NEC. В пресс-релизе отмечено, что при передаче на большие расстояния возникают сложности с корректностью приёма передаваемых сигналов из-за неравномерности задержки и потерь. Чтобы решить эту проблему, компании разработали для оптических систем механизм Multiple Input Multiple Output (MIMO), широко используемой в беспроводной связи. Кроме того, компании разработали технологии проектирования интегрированных IO-блоков, которые могут уменьшить влияние неравномерности задержки и потерь сигнала. NTT и NEC планируют подготовить новую оптоволоконную технологию к коммерческому внедрению к концу десятилетия, как раз к запуску 6G-сетей.

25.10.2023 [22:15], Руслан Авдеев

Великобритания введёт заградительные пошлины на дешёвое китайское оптоволокноБританские власти готовы принять суровые меры, признанные защитить страну от импорта дешёвых китайских оптоволоконных изделий. По данным The Register, в 2021 году на британском рынке продано 5,7 млн км продуктов соответствующего назначения. Новость не сулит ничего хорошего не только китайским вендорам, но и зарубежным производителям оптоволоконного кабеля вообще. По имеющейся статистике, в Великобритании производится только половина необходимого оптоволокна — совокупная стоимость местного продукта составляет $107 млн, остальное поставляется как из Китая, так и из Индии, США, Германии и Польши. Причём в последней «дочка» японской Fujikura намерена к середине следующего года открыть новую фабрику.

Источник изображения: Compare Fibre/unsplash.com Управление торговой защиты (TRA) Великобритании приготовило поставщикам неприятный сюрприз. Во-первых, в скором будущем по его совету введут антидемпинговые заградительные пошлины в размере 23—46,2 % от стоимости кабелей и, во-вторых, новые «компенсационные» пошлины — от 10,62 % до 11,79 %. TRA изучает проблему поставок одномодового оптического волокна из Китая как минимум с прошлого года, пытаясь выяснить, не продаются ли кабели китайского производства в Соединённом Королевстве дешевле, чем они стоят на китайском рынке. Расследуются как минимум два отдельных случая демпинга. Местные производители жалуются, что китайские конкуренты стали причиной обвала цен во время тендеров. Более того, даже если их не выбрали по тем или иным причинам, они всё равно продолжают снижать цены до «неустойчивого» уровня. Одно из расследований связано с деятельностью китайской Prysmian Group, которая не только имеет контракт на поставку продукции для инфраструктурных проектов Openreach, но и стоит за как минимум четвертью компаний, связанной с выпуском оптоволоконной продукции на территории Великобритании, а потому считающихся местными. TRA отметило, что в следующие пять лет рынок ВОЛС будет существенно расти благодаря обновлению сетей связи. Сейчас только пятая часть домохозяйств страны имеет оптоволоконные подключения.

22.04.2023 [00:15], Алексей Степин

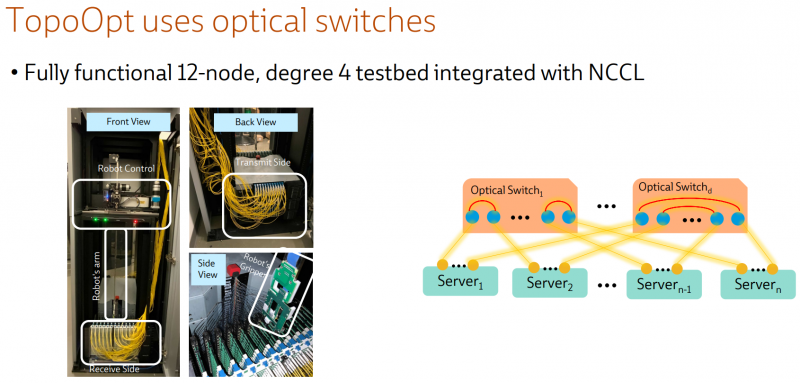

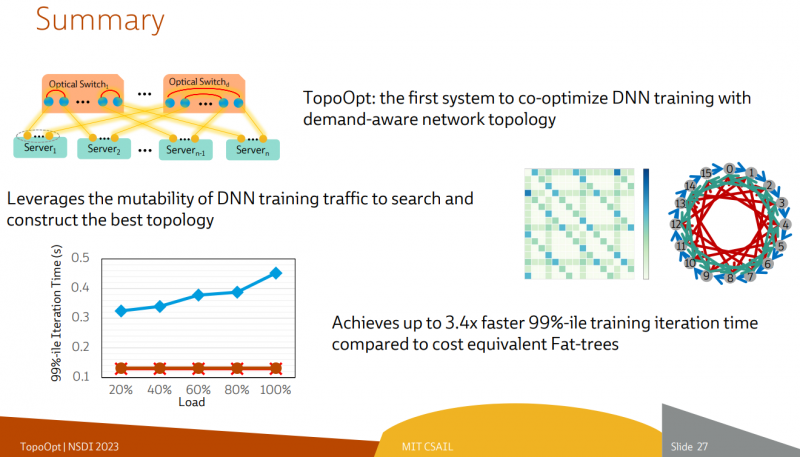

Ловкость роборук: TopoOpt от Meta✴ и MIT поможет ускорить и удешевить обучение ИИТехнологии искусственного интеллекта (ИИ) сегодня бурно развиваются и требуют всё более серьёзных вычислительных мощностей. Но наряду с наращиванием этих мощностей растут требования и к сетевой подсистеме, поэтому крупные компании и исследовательские организации ищут всё новые способы оптимизации инфраструктуры. Компания Meta✴ в сотрудничестве с Массачусетским технологическим институтом (MIT) и рядом прочих исследовательских организаций опубликовала данные любопытного эксперимента, в котором ИИ-кластер мог менять топологию своего интерконнекта с помощью механической «роборуки». Система получила название TopoOpt, поскольку вычислительные узлы в ней использовали полностью оптическую сеть с оптической же патч-панелью. Эта сеть объединяла 12 вычислительных узлов ASUS ESC4000A-E10, каждый из которых был оснащён ускорителем NVIDIA A100, сетевыми адаптерами HPE и Mellanox ConnectX-5 (100 Гбит/с) с оптическими трансиверами. Наиболее интересное устройство в эксперименте — оптическая патч-панель Telescent, оснащённая механическим манипулятором, способным производить перекоммутацию на лету. Эта «роборука» работала под управлением специализированного ПО, целью которого ставилось нахождение оптимальной сетевой топологии и сегментации сети применительно к различным задачам машинного обучения.

Система с перекоммутируемой оптической сетью не требует энергоёмких высокоскоростных коммутаторов и обеспечивает ряд других преимуществ Такая роботизированная патч-панель не столь расторопна, как оптические коммутаторы Google с микрозеркальной механикой, но стоит впятеро дешевле и имеет больше портов. Опубликованные экспериментальные данные уверенно свидетельствуют о том, что топология «толстого дерева» (fat tree), использующая несколько слоёв коммутаторов, не оптимальна и даже избыточна для ряда нейросетевых задач. К тому же перекоммутируемая оптическая сеть без традиционных высокоскоростных коммутаторов требует меньше оборудования, а значит, может быть не только быстрее сети fat tree в ряде ИИ-задач, но и существенно дешевле в развёртывании и поддержании в рабочем состоянии — как минимум за счёт отсутствия затрат на питание множества коммутаторов.

14.12.2022 [15:31], Сергей Карасёв

Microsoft купила разработчика необычного оптоволокна LumenisityКорпорация Microsoft объявила о заключении соглашения о покупке компании Lumenisity, базирующейся в Великобритании. Этот стартап, основанный в 2017 году, специализируется на разработке решений для высокоскоростной передачи данных с применением технологии полого оптоволокна HCF (Hollow Core Fiber). Компания Lumenisity создана как дочерняя структура Исследовательского центра оптоэлектроники (ORC) Саутгемптонского университета. Конструкцией HCF предусмотрено наличие заполненного воздухом канала, окружённого кольцом стеклянных трубок, похожим на соты. Свет проходит не через обычное волокно, а через воздушный канал, так что, по словам Lumenisity, он распространяется по HCF-кабелям примерно на 47 % быстрее, чем через волокно из кварцевого стекла. Хотя это и не новая технология, интерес к ней растёт по мере улучшения пропускной способности и надёжности. Такая конструкция позволяет не только повысить скорость передачи данных и снизить задержки, но и открывает путь к созданию протяжённых ВОЛС без использования репитеров благодаря более низким потерям энергии. Кроме того, Lumenisity говорит, что её решение дешевле аналогов и лучше защищено от вторжений. Microsoft заявляет, что приобретение Lumenisity расширит возможности по дальнейшей оптимизации глобальной облачной инфраструктуры Azure. Lumenisity привлекла на развитие в общей сложности около $15,5 млн, а недавно открыла производственное предприятие HCF в Ромси, Великобритания. Финансовые условия сделки не раскрываются. Важно отметить, что волокно Lumenisity не требует для развёртывания специального оборудования и работает со многими оптическими системами, которые сегодня используются в телекоммуникационных сетях. По всей видимости, Microsoft будет применять технологию Lumenisity для объединения своих ЦОД. Также Microsoft по неподтверждённым пока официально данным приобрела Fungible, разработчика DPU. Компания, судя по всему, намерена задействовать эти DPU только для собственных нужд.

28.10.2021 [17:02], Алексей Степин

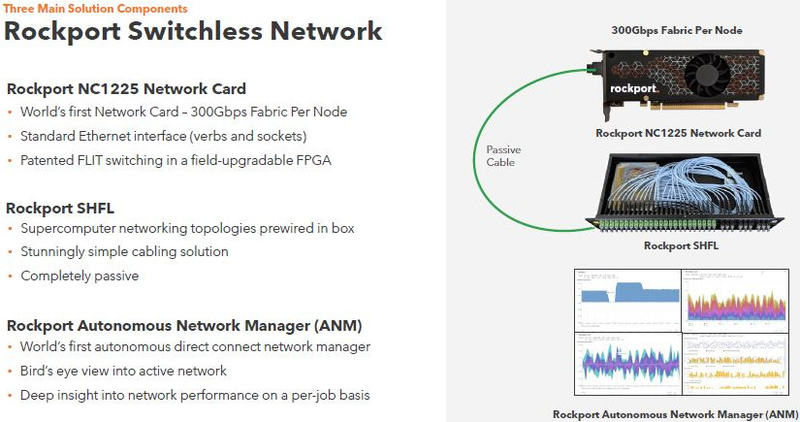

Rockport Networks представила интерконнект с пассивным оптическим коммутаторомПроизводительность любого современного суперкомпьютера или кластера во многом зависит от интерконнекта, объединяющего вычислительные узлы в единое целое, и практически обязательным компонентом такой сети является коммутатор. Однако последнее не аксиома: компания Rockport Networks представила своё видение HPC-систем, не требующее использования традиционных коммутирующих устройств. Проблема межсоединений существовала в мире суперкомпьютеров всегда, даже в те времена, когда сам процессор был набором более простых микросхем, порой расположенных на разных платах. В любом случае узлы требовалось соединять между собой, и эта подсистема иногда бывала неоправданно сложной и проблемной. Переход на стандартные сети Ethernet, Infiniband и их аналоги многое упростил — появилась возможность собирать суперкомпьютеры по принципу конструктора из стандартных элементов.

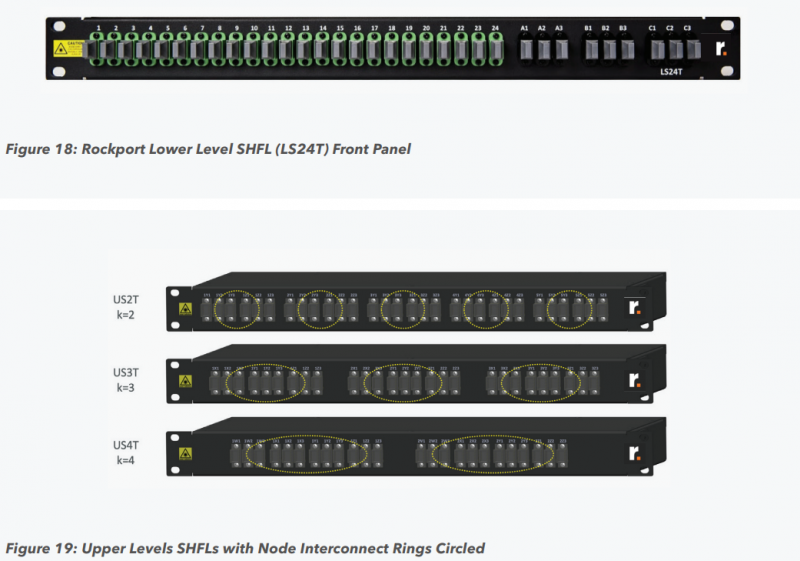

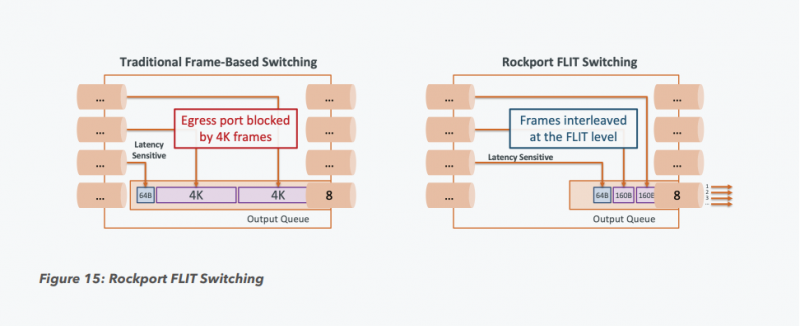

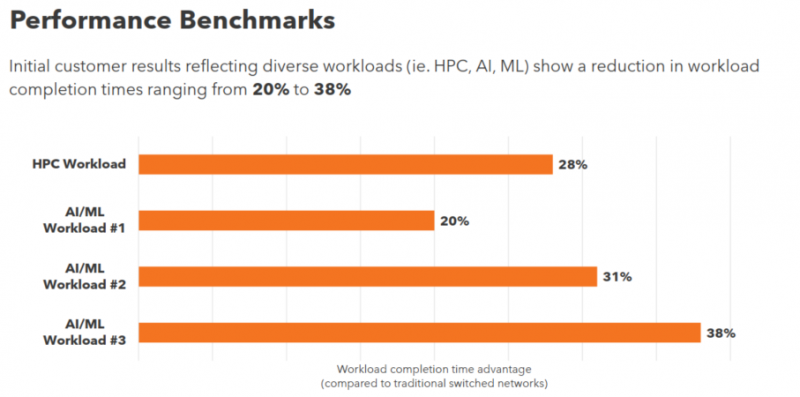

Пассивный оптический коммутатор SHFL Тем не менее, проблема масштабирования (в том числе и на физическом уровне кабельной инфраструктуры), повышения скорости и снижения задержек никуда не делась. У DARPA даже есть особый проект FastNIC, нацеленный на 100-кратное ускорение сетевых интерфейсов, чтобы в конечном итоге сгладить разницу в скорости обмена данными внутри узлов и между ними.  Сам по себе высокоскоростной коммутатор для HPC-систем — устройство непростое, требующее использования недешёвого и сложного кремния, и вкупе с остальными компонентами интерконнекта может составлять заметную долю от стоимости всего кластера в целом. При этом коммутаторы могут вносить задержки, по определению являясь местами избыточной концентрации данных, а также требуют дополнительных мощностей подсистем питания и охлаждения.  Подход, продвигаемый компанией Rockport Networks, свободен от этих недостатков и изначально нацелен на минимизацию точек избыточности и возможных коллизий. А достигнуто это благодаря архитектуре, в которой концепция традиционного сетевого коммутатора отсутствует изначально. Вместо этого имеется специальный модуль SHFL, в котором топология сети задаётся оптически, а все логические задачи берут на себя специализированные сетевые адаптеры, работающие под управлением фирменной ОС rNOS и имеющие на борту сконфигурированную нужным образом ПЛИС. Модуль SHFL даже не требует отдельного электропитания, а вот адаптеры Rockport NC1225 его хотя и требуют, но умещаются в конструктив низкопрофильного адаптера с разъёмом PCIe x16 и потребляют всего 36 Вт. Правда, в настоящий момент речь идёт только о PCIe 3.0, поэтому полнодуплексного подключения на скорости 200 Гбит/с пока нет. Тем не менее, Техасский центр передовых вычислений (TACC) посчитал, что этого уже достаточно и стал одним из первых заказчиков — 396 узлов суперкомпьютера Frontera используют решение Rockport. Использование не совсем традиционной оптической сети, впрочем, накладывает свои особенности: вместо популярных *SFP-корзин используются разъёмы MTP/MPO-24, а каждый кабель даёт для подключения 12 отдельных волокон, что при скорости 25 Гбит/с на волокно позволит достичь совокупной пропускной способности 300 Гбит/с. ОС и приложениям адаптер «представляется» как чип Mellanox ConnectX-5, который и входит в его состав, а потому не требует каких-то особых драйверов или модулей ядра. Rockport фактически занимается транспортировкой Ethernet и реализует уровень OSI 1/1.5, однако традиционной коммутации как таковой нет — адаптеры самостоятельно определяют конфигурацию сети и оптимальные маршруты передачи сигнала по отдельным волокнам с возможностью восстановления связности на лету при каких-либо проблемах. Весь трафик разбивается на маленькие кусочки (FLIT'ы) и отправляется по виртуальным каналам (VC) с чередованием, что позволяет легко управлять приоритизацией (в том числе на L2/L3) и снизить задержки. SHFL имеет 24 разъёма для адаптеров и ещё 9 для объединения с другими SHFL и Ethernet-шлюзами для подключения к основной сети ЦОД (в ней сеть Rockport видна как обычная L2). Таким образом, в составе кластера каждый узел может быть подключён как минимум к 12 другим узлам на скорости 25 Гбит/с. Однако топологию можно менять по своему усмотрению. Компания-разработчик заявляет о преимуществе своего интерконнекта на классических HPC-задачах, могущем достигать почти 30% при сравнении c InfiniBand класса 100G и даже 200G. Кроме того, для Rockport требуется на 72% меньше кабелей. |

|