Материалы по тегу: trainium

|

01.07.2025 [09:02], Владимир Мироненко

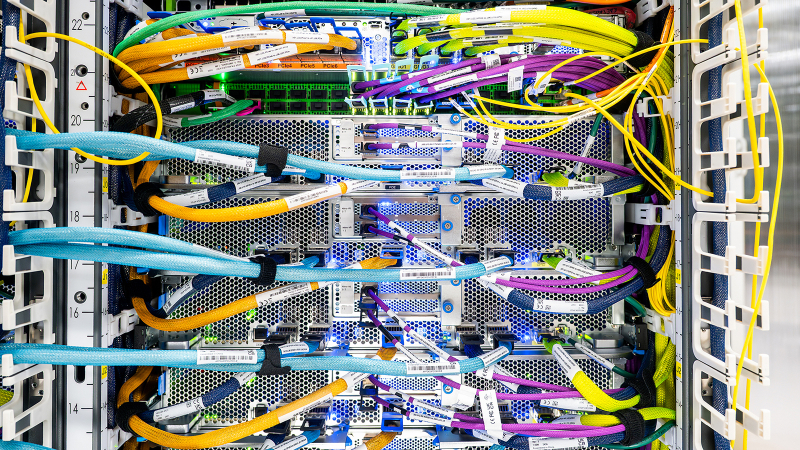

Крупнейший в истории AWS ИИ-суперкомпьютер Project Rainier охватит несколько ЦОД, но будет экологичнымВ настоящее время Amazon Web Services (AWS) занимается строительством ИИ-суперкомпьютера Project Rainier. Проект, охватывающий несколько ЦОД в США, по своим масштабам не похож ни на что, что когда-либо пыталась реализовать AWS. Этот огромный уникальный суперкомпьютер разработан для создания и работы ИИ-моделей следующего поколения. Партнёром AWS в реализации проекта выступает ИИ-стартап Anthropic, который будет использовать новый ИИ-кластер для создания и развёртывания будущих версий LLM Claude. У компаний довольно тесные отношения, а появление Project Rainier снизит зависимость Anthropic и AWS от дефицитных ускорителей NVIDIA, которых не хватает и для собственных нужд Amazon. «Rainier обеспечит в пять раз больше вычислительной мощности по сравнению с крупнейшим в настоящее время кластером Anthropic», — сообщил Гади Хатт (Gadi Hutt), директор по разработке и проектированию продуктов Annapurna Labs, подразделения AWS по разработке чипов. Чем больше вычислений вложить в обучение Claude, тем умнее и точнее будет модель. «Мы создаём вычислительную мощность в масштабах, которых никогда не было раньше, и мы делаем это с беспрецедентной скоростью и гибкостью», — подчеркнул Хатт. Сообщается, что Project Rainier спроектирован как огромный кластер EC2 UltraCluster, состоящий из серверов UltraServers с Trainium2. Trainium2 — ИИ-ускоритель собственной разработки Amazon, предназначенный для обучения ИИ-моделей. UltraServer — новый тип вычислительной системы, которая объединяет четыре физических сервера, каждый из которых содержит 16 ускорителей Trainium2, взаимодействие между которыми осуществляется с помощью интерконнекта NeuronLinks (кабели синего цвета на фото). Связь между компонентами суперкомпьютера реализуется на двух критических уровнях: NeuronLinks обеспечивают высокоскоростные соединения внутри UltraServer, в то время как DPU Elastic Fabric Adapter (EFA) объединяет UltraServer внутри ЦОД и между ЦОД. Этот двухуровневый подход позволяет максимизировать скорость в местах, где в этом больше всего есть потребность, сохраняя гибкость масштабирования в рамках нескольких дата-центров. Эксплуатация и обслуживание такого огромного вычислительного кластера отличается повышенной сложностью. И в данном случае надёжность системы имеет первостепенное значение. Именно здесь подход компании к разработке оборудования и ПО действительно выходит на первый план, говорит компания. Благодаря тому, что AWS сама занимается разработкой оборудования, она может контролировать каждый аспект технологического стека, от мельчайших компонентов чипа до ПО и архитектуры самого ЦОД. Это также позволяет ускорить внедрение технологий и снизить затраты при внедрении ИИ. «Когда у вас есть полная картина, от чипа до ПО и самих серверов, вы можете проводить оптимизацию там, где это имеет наибольший смысл», — говорит директор по инжинирингу Annapurna Labs Рами Синно (Rami Sinno). «Иногда лучшим решением может быть перепроектирование того, как подаётся питание серверов, или переписывание ПО, которое всё координирует. Это может происходить и одновременно. Поскольку у нас есть обзор всего на каждом уровне, мы можем быстро устранять неполадки и внедрять инновации гораздо быстрее», — добавил он. Вместе с тем, по словам Amazon, внедрение мощной ИИ-инфраструктуры будет достаточно экологичным. Вся электроэнергия, потребляемая Amazon, включая её ЦОД, в 2023 году была полностью компенсирована закупками из возобновляемых источников энергии. В течение последних пяти лет Amazon была крупнейшим корпоративным покупателем возобновляемой энергии в мире. Компания инвестирует миллиарды долларов в ядерную энергию и использование аккумуляторов, а также в финансирование масштабных проектов возобновляемой энергии по всему миру. Amazon по-прежнему намерена добиться нулевого уровня выбросов углерода к 2040 году. И Project Rainier ей в этом поможет. В прошлом году AWS объявила, что будет развёртывать новые компоненты, которые объединяют достижения в области питания и охлаждения, не только в строящихся, но и в существующих ЦОД. Их использование, как ожидается, позволит снизить потребление энергии механизмами до 46 % и сократить выбросы парниковых газов при производстве бетона на 35 %. Новые объекты для Project Rainier будут включать в себя различные усовершенствования для повышения энергоэффективности и экологичности с акцентом на сокращение потребления водных ресурсов и использованию забортного воздуха для охлаждения. Например, в ЦОД в округе Сент-Джозеф (St. Joseph), штат Индиана, с октября по март ЦОД вообще не будут использовать воду для охлаждения, а с апреля по сентябрь питьевая вода будет нужна только в течение нескольких часов в день. Amazon не уточняет, о каком именно кампусе идёт речь, но уже известно, что компания строит в Индиане дата-центр, который будет потреблять энергии как половина населения штата. Благодаря инженерным инновациям AWS является лидером отрасли по эффективности использования воды, заявляет компания. На основании результатов недавнего исследования Национальной лаборатории Лоуренса в Беркли, посвящённого эффективности использования воды в ЦОД, отраслевой стандартный показатель составляет 0,375 л/кВт·ч, тогда как у AWS он равен всего 0,15 л/кВт·ч. Компания улучшила этот параметр на 40 % по сравнению с 2021 годом.

19.06.2025 [11:21], Сергей Карасёв

AWS готовит чип Graviton и ускоритель Trainium следующего поколенияОблачная платформа Amazon Web Services (AWS), по сообщению ресурса CNBC, готовит обновлённую модификацию своего серверного процессора Graviton4, а также ускоритель Trainium следующего поколения, предназначенный для ресурсоёмких приложений ИИ. Оригинальная версия Graviton4 дебютировала в конце 2023 года. Изделие, разработанное подразделением Annapurna Labs в составе AWS, содержит 96 ядер Neoverse V2 Demeter с 2 Мбайт кеша L2 в расчёте на ядро. Используются 12 каналов памяти DDR5-5600. В общей сложности чип насчитывает 73 млрд транзисторов и изготавливается по 4-нм техпроцессу TSMC. По имеющейся информации, у инстансов на базе обновлённой версии Graviton4 пропускная способность сетевой подсистемы увеличится в 12 раз — с нынешних 50 Гбит/с до 600 Гбит/с. Прочие технические характеристики готовящегося изделия не раскрываются, но известно, что информацию о сроках его доступности AWS раскроет до конца текущего месяца. Сообщается также, что ускоритель Trainium следующего поколения выйдет до конца текущего года. Нынешнее решение Trainium2, основанное на ядрах NeuronCore-V3, было представлено в ноябре 2023-го. Его производительность достигает 1,29 Пфлопс в режиме FP8. Утверждается, что быстродействие Trainium3 увеличится в два раза, то есть будет составлять до 2,58 Пфлопс (FP8). Ранее появлялась информация, что энергопотребление Trainium3 может достигать 1000 Вт. Теперь говорится, что в плане энергетической эффективности ИИ-ускоритель нового поколения на 50 % превзойдёт предшественника. Возможно, имеется в виду быстродействие в расчёте на 1 Вт затрачиваемой энергии.

04.12.2024 [17:43], Сергей Карасёв

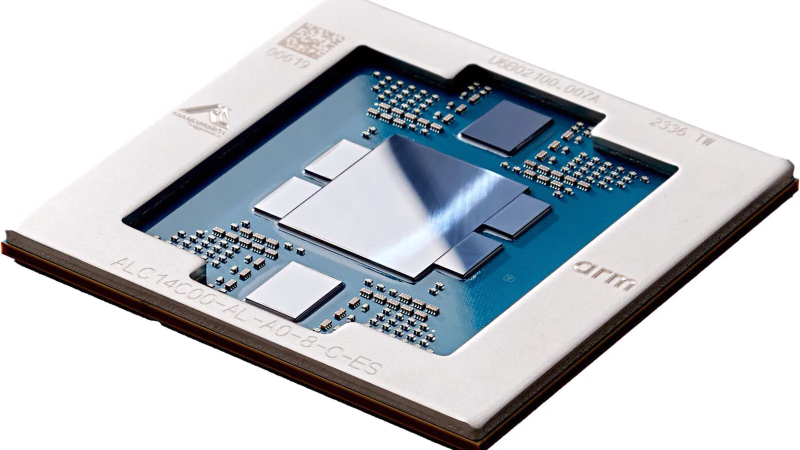

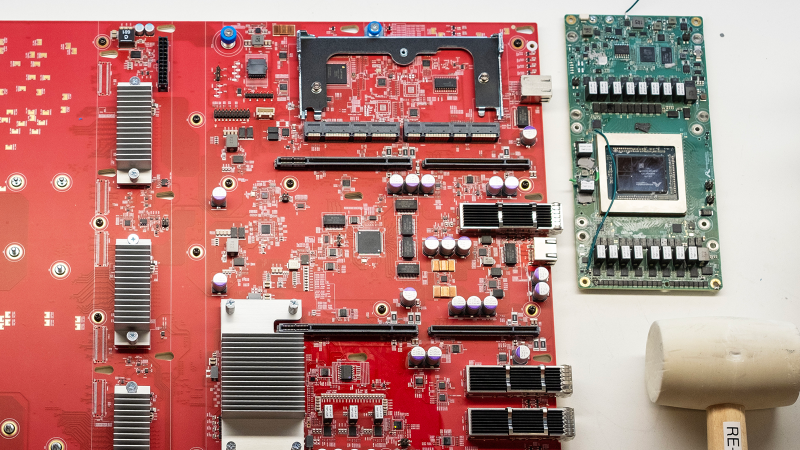

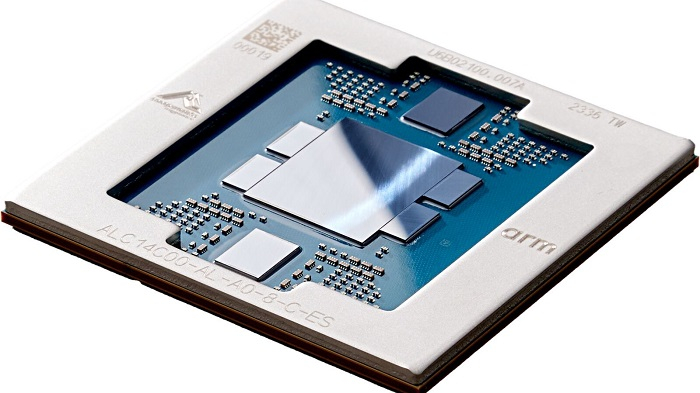

AWS построит распределённый ИИ-суперкомпьютер Project Rainier с десятками тысяч ИИ-ускорителей Trainium2Облачная платформа AWS официально представила инстансы EC2 Trn2 и Trn2 UltraServer — самые высокопроизводительные решения EC2, ориентированные на ИИ-приложения, машинное обучение и задачи инференса. В основу положены фирменные ускорители Amazon Trainium2 второго поколения. ИИ-ускорители Trainium2 содержат восемь ядер NeuronCore и 96 ГиБ памяти HBM с пропускной способностью 2,9 Тбайт/с. Ядра могут адресоваться и использоваться по отдельности или же пары физических ядер могут быть сгруппированы в один логический блок. Trainium2 обеспечивает FP8-быстродействие до 1,3 Пфлопс, а FP8-производительность в разреженных вычислениях достигает 5,2 Пфлопс. Инстансы EC2 Trn2 содержат 16 ускорителей Trainum2, связанных посредством интерконнекта NeuronLink. В сумме это даёт 128 ядер NeuronCore и 1,5 ТиБ памяти HBM с суммарной пропускной способностью 46 Тбайт/с. Производительность на операциях FP8 достигает 20,8 Пфлопс. Каждый инстанс включает 192 vCPU, 2 ТиБ памяти и адаптеры AWS Elastic Fabric Adapter (EFA) v3 на 3,2 Тбит/с. Утверждается, что инстансы Trn2 обеспечивают в четыре раза более высокую производительность, в четыре раза большую пропускную способность памяти и в три раза большую ёмкость памяти, нежели инстансы Trn1. Кроме того, экземпляры Trn2 предлагают на 30–40 % лучшее соотношение цены и производительности, чем EC2 P5e и P5en на базе GPU. Инстансы Trn2 доступны в регионе AWS US East (Огайо), а в ближайшем будущем появятся и в других зонах. В свою очередь, платформа UltraServer включает четыре инстанса Trn2 (64 ускорителя Trainum2) с интерконнектом NeuronLink с низкой задержкой. В сумме это даёт 512 ядер NeuronCore и 6 ТиБ памяти HBM с суммарной пропускной способностью 185 Тбайт/с. Быстродействие на операциях FP8 составляет 83 Пфлопс (332 Пфлопс в разреженных вычислениях). Новые узлы используют СЖО. Десятки тысяч ускорителей Trainium2 могут формировать кластеры EC2 UltraCluster. В частности, такую систему в рамках инициативы Project Rainier компания Amazon намерена создать в партнёрстве со стартапом Anthropic, который специализируются на технологиях генеративного ИИ. Интересно, что ИИ-суперкомпьютер Project Rainier будет распределённым — его узлы разместятся сразу в нескольких ЦОД. ВОЛС между дата-центрами организует Lumen. Одной из причин от попытки построить один гигантский кампус называется невозможность быстро получить достаточно энергии в одном месте, хотя у компании уже есть площадка рядом с АЭС. Недавно Amazon объявила о намерении удвоить инвестиции в Anthropic, доведя их до $8 млрд. Создание системы Rainier планируется завершить в следующем году. Ожидается, что она станет одним из крупнейших в мире вычислительных кластеров для обучения моделей ИИ. По заявлениям AWS, комплекс обеспечит в пять раз более высокую производительность по сравнению с платформой, которую Anthropic использовала до сих пор для разработки своих языковых моделей. Достанутся ли Anthropic и ресурсы ещё облачного ИИ-суперкомпьютера Project Ceiba, который получит 21 тыс. суперчипов NVIDIA Blackwell, не уточняется. Кроме того, по сообщению The Register, компания Amazon приоткрыла завесу тайны над ИИ-ускорителями следующего поколения — изделиями Trainium3. По сравнению с предшественниками они, как утверждается, обеспечат четырёхкратное увеличение быстродействия. Говорится, что Trainium3 станет первым специализированным ускорителем для ИИ и машинного обучения, созданным на основе 3-нм техпроцесса. Эффективность по сравнению с Trainium2 увеличится примерно на 40 %. Ожидается, что на коммерческом рынке изделия Trainium3 появятся в конце 2025 года.

25.11.2024 [20:50], Руслан Авдеев

Amazon вложит ещё $4 млрд в Anthropic и снизит её зависимость от NvidiaКомпания Amazon (AWS) раскрыла планы удвоить инвестиции в Anthropic, доведя их до $8 млрд. Объявление о новых вложениях было сделано через год после того, как гиперскейлер сообщил о выделении стартапу $4 млрд, сообщает Silicon Angle. На тот момент главный конкурент OpenAI назвал AWS своим ключевым облачным провайдером. С новой сделкой роль AWS в обучении моделей Anthropic только усилится. Anthropic представила свою наиболее передовую модель Claude 3.5 Sonnet в прошлом месяце — это улучшенная версия большой языковой модели (LLM) той же серии, дебютировавшей несколько месяцев назад. Новая Claude 3.5 Sonnet лучше предшественницы в выполнении некоторых задач, включая написание кода. Она также обошла OpenAI GPT-4o в нескольких бенчмарках. Anthropic предлагает свои LLM через сервис Amazon Bedrock, обеспечивающий доступ к управляемым ИИ-моделям. Расширенное сотрудничество обеспечит пользователям ранний доступ к функции, позволяющей настраивать модели Claude с использованием кастомных датасетов. Также планируется поддержать друг друга в разработках. Anthropic будет использовать ИИ-ускорители Trainium и Inferentia для внутренних задач. В компании подчеркнули, что задействуют ускорители для крупнейших базовых моделей. В то же время специалисты Anthropic поддержат AWS в разработке новых чипов Tranium. Стек ПО Neutron включает компилятор, оптимизирующий ИИ-модели для работы на инстансах Tranium, и некоторые другие инструменты. Компания также работает над низкоуровневыми программными ядрами, распределяющими задачи между вычислительными ядрами ускорителей. Последний раунд финансирования Anthropic состоится через два месяца после того, как OpenAI привлекла рекордные для стартапа $6,6 млрд. Также она получила кредитную линию на $4 млрд от группы банков. OpenAI, оцениваемая в $157 млрд, будет инвестировать средства в ИИ-исследования и вычислительную инфраструктуру.

13.11.2024 [22:21], Руслан Авдеев

Поработайте за нас: AWS предоставит учёным кластеры из 40 тыс. ИИ-ускорителей TrainiumAWS намерена привлечь больше людей к разработке ИИ-приложений и фреймворков, использующих разработанные Amazon ускорители семейства Tranium. В рамках нового инициативы Build on Trainium с финансированием в объёме $110 млн академическим кругам будет предоставлен доступ к кластерам UltraClaster, включающим до 40 тыс. ускорителей, сообщает The Register. В рамках программы Build on Trainium предполагается обеспечить доступ к кластеру представителям университетов, которые заняты разработкой новых ИИ-алгоритмов, которые позволяет повысить эффективность использования ускорителей и улучшить масштабирование вычислений в больших распределённых системах. На каком поколении чипов, Trainium1 или Trainium2, будут построены кластеры, не уточняется. Как поясняют в самом блоге AWS, исследователи могут придумать новую архитектуру ИИ-моделей или новую технологию оптимизации производительности, но у них может не оказаться доступа к HPC-ресурсам для крупных экспериментов. Не менее важно, что плоды трудов, как ожидается, будут распространяться по модели open source, поэтому от этого выиграет вся экосистема машинного обучения. Впрочем, со стороны AWS альтруизма мало. Во-первых, $110 млн будут выданы выбранным проектам в виде облачных кредитов, такое происходит не впервые. Во-вторых, компания фактически пытается переложить часть своих задач на других людей. Кастомные чипы AWS, включая ИИ-ускорители для обучения и инференса, изначально разрабатывались для повышения эффективности выполнения внутренних задач компании. Однако низкоуровневые фреймворки и т.п. ПО не предназначены для того, чтобы с ними мог свободно работать широкий круг лиц как, например, происходит с NVIDIA CUDA. Иными словам, AWS для популяризации Trainium необходимо более простое в освоение ПО, а ещё лучше готовые решения прикладных задач. Неслучайно Intel и AMD склонны предлагать разработчикам готовые оптимизированные под их ускорители фреймворки вроде PyTorch и TensorFlow, а не пытаться заставить их заниматься достаточно низкоуровневым программированием. AWS занимается тем же самым, предлагая продукты вроде SageMaker. Во многом реализация проекта возможна благодаря новому интерфейсу Neuron Kernel Interface (NKI) для AWS Tranium и Inferentia, обеспечивающему прямой доступ к набору инструкций чипов и позволяющему исследователям строить оптимизированные вычислительные ядра для работы новых моделей, оптимизации производительности и инноваций в целом. Впрочем, учёным — в отличие от обычных разработчиков — часто интересно работать именно с низкоуровневыми системами.

29.06.2024 [13:08], Сергей Карасёв

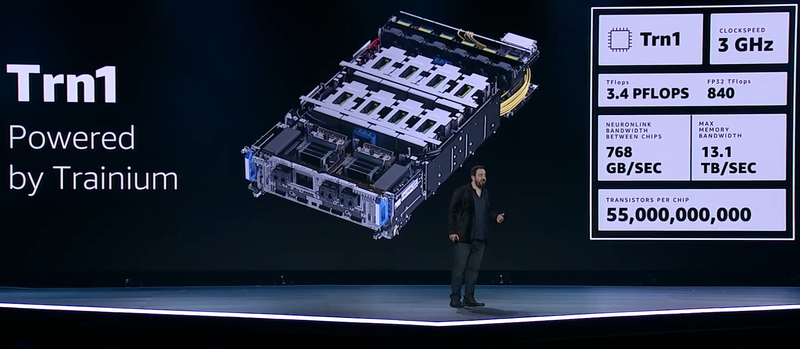

Энергопотребление ИИ-ускорителя AWS Trainium 3 может достигать 1000 ВтОблачная платформа Amazon Web Services (AWS) готовит ИИ-ускоритель нового поколения — изделие Trainium 3. Завесу тайны над этим решением, как сообщает ресурс Fierce Networks, приоткрыл вице-президент компании по инфраструктурным услугам Прасад Кальянараман (Prasad Kalyanaraman). Оригинальный ускоритель AWS Trainium дебютировал в конце 2021 года. Его производительность — 3,4 Пфлопс на вычислениях малой точности и до 840 Тфлопс в FP32-расчётах. В ноябре 2023-го было представлено решение AWS Trainium 2, которое, как утверждается, вчетверо производительнее первой версии. Теперь AWS готовит изделие третьего поколения. Кальянараман намекнул, что энергопотребление Trainium 3 достигнет 1000 Вт или более. Он не стал называть конкретные цифры, но сказал, что для ускорителя планируется применение СЖО. «Текущее поколение ускорителей не требует СЖО, но следующему она понадобится. Когда мощность чипа превышает 1000 Вт, ему необходимо жидкостное охлаждение», — отметил Кальянараман.

Источник изображения: AWS В настоящее время единственными ИИ-изделиями, показатель TDP которых достигает 1000 Вт, являются ускорители NVIDIA Blackwell. Вместе с тем, по имеющимся сведениям, Intel разрабатывает устройство в соответствующей категории с энергопотреблением на уровне 1500 Вт. На текущий момент почти все дата-центры AWS используют технологию воздушного охлаждения. Но Кальянараман сказал, что компания рассматривает возможность внедрения технологии однофазной СЖО (а не иммерсионного охлаждения) для поддержки ресурсоёмких рабочих нагрузок. К внедрению СЖО вынужденно пришли и Meta✴ с Microsoft — компании используют гибридный подход с водоблоками на чипах и теплообменниками на дверях стойки или же в составе отдельной стойки. Кроме того, отметил Кальянараман, AWS стремится к дальнейшей оптимизации своих ЦОД путём «стратегического позиционирования стоек» и модернизации сетевой архитектуры. Речь идёт о применении коммутаторов следующего поколения с пропускной способностью до 51,2 Тбит/с, а также оптических компонентов.

29.11.2023 [03:43], Владимир Мироненко

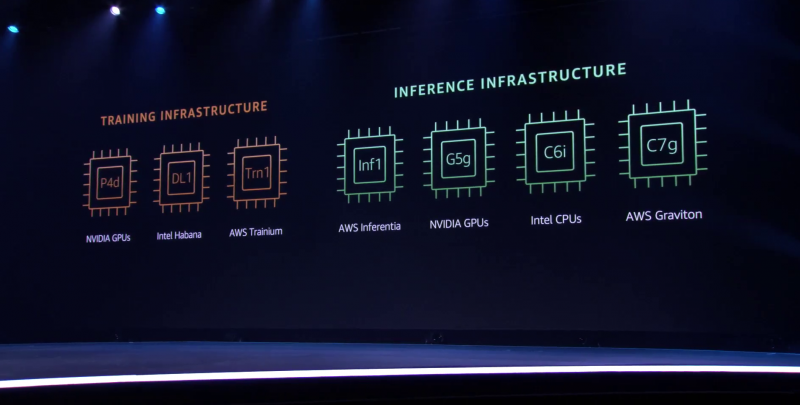

AWS представила 96-ядерный Arm-процессор Graviton4 и ИИ-ускоритель Trainium2Amazon Web Services представила Arm-процессор нового поколения Graviton4 и ИИ-ускоритель Trainium2, предназначенный для обучения нейронных сетей. Всего к текущему моменту компания выпустила уже 2 млн Arm-процессоров Graviton, которыми пользуются более 50 тыс. клиентов. «Graviton4 представляет собой четвёртое поколение процессоров, которое мы выпустили всего за пять лет, и это самый мощный и энергоэффективный чип, который мы когда-либо создавали для широкого спектра рабочих нагрузок», — отметил Дэвид Браун (David Brown), вице-президент по вычислениям и сетям AWS. По сравнению с Graviton3 новый чип производительнее на 30 %, включает на 50 % больше ядер и имеет на 75 % выше пропускную способность памяти. Graviton4 будет иметь до 96 ядер Neoverse V2 Demeter (2 Мбайт L2-кеша на ядро) и 12 каналов DDR5-5600. Кроме того, новый чип получит поддержку шифрования трафика для всех своих аппаратных интерфейсов. Процессор изготавливается по 4-нм техпроцессу TSMC и, вероятно, имеет чиплетную компоновку. Возможно, это первый CPU компании, ориентированный на работу в двухсокетных платформах. Поначалу Graviton4 будет доступен в инстансах R8g (пока в статусе превью), оптимизированных для приложений, интенсивно использующих ресурсы памяти — высокопроизводительные базы данных, in-memory кеши и Big Data. Эти инстансы будут поддерживать более крупные конфигурации, иметь в три раза больше vCPU и в три раза больше памяти по сравнению с инстансами Rg7, которые имели до 64 vCPU и 512 Гбайт ОЗУ. В свою очередь, Trainium 2 предназначен для обучения больших языковых моделей (LLM) и базовых моделей. Сообщается, что ускоритель в сравнении с Trainium 1 вчетверо производительнее и при этом имеет в 3 раза больший объём памяти и в 2 раза более высокую энергоэффективность. Инстансы EC2 Trn2 получат 16 ИИ-ускорителей с возможностью масштабирования до 100 тыс. единиц в составе EC2 UltraCluster, которые суммарно дадут 65 Эфлопс, то есть по 650 Тфлопс на ускоритель. Как утверждает Amazon это позволит обучать LLM с 300 млрд параметров за недели вместо месяцев. Со временем на Graviton4 заработает SAP HANA Cloud, портированием и оптимизацией этой платформы уже занимаются. Oracle также перенесла свою СУБД на Arm, а заодно перевела все свои облачные сервисы на чипы Ampere, в которую в своё время инвестировала. Microsoft же пошла по пути AWS и недавно анонсировала 128-ядерый Arm-процессор (Neoverse N2) Cobalt 100 и ИИ-ускоритель Maia 100 собственной разработки. Всё это может представлять отдалённую угрозу для AMD и Intel. С NVIDIA же все всё равно пока что продолжают дружбу — именно в инфраструктуре AWS, как ожидается, появится самый мощный в мире ИИ-суперкомпьютер на базе новых GH200.

07.12.2021 [00:36], Алексей Степин

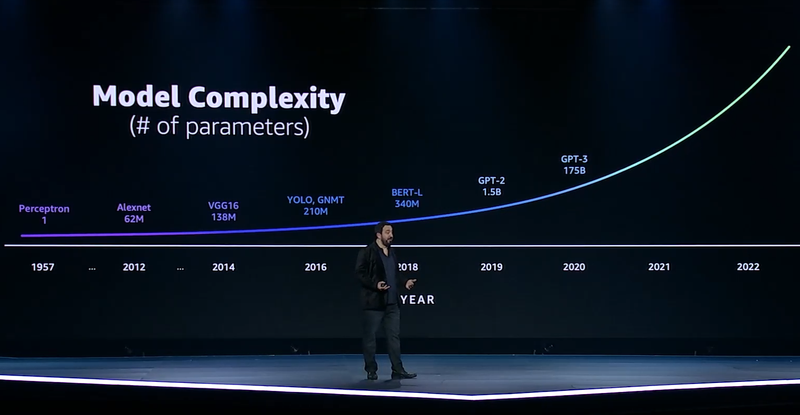

ИИ-ускорители AWS Trainium: 55 млрд транзисторов, 3 ГГц, 512 Гбайт HBM и 840 Тфлопс в FP32GPU давно применяются для ускорений вычислений и в последние годы обросли поддержкой специфических форматов данных, характерных для алгоритмов машинного обучения, попутно практически лишившись собственно графических блоков. Но в ближайшем будущем их по многим параметрам могут превзойти специализированные ИИ-процессоры, к числу которых относится и новая разработка AWS, чип Trainium. На мероприятии AWS Re:Invent компания рассказала о прогрессе в области машинного обучения на примере своих инстансов P3dn (Nvidia V100) и P4 (Nvidia A100). Первый вариант дебютировал в 2018 году, когда модель BERT-Large была примером сложности, и благодаря 256 Гбайт памяти и сети класса 100GbE он продемонстрировал впечатляющие результаты. Однако каждый год сложность моделей машинного обучения растёт почти на порядок, а рост возможностей ИИ-ускорителей от этих темпов явно отстаёт.

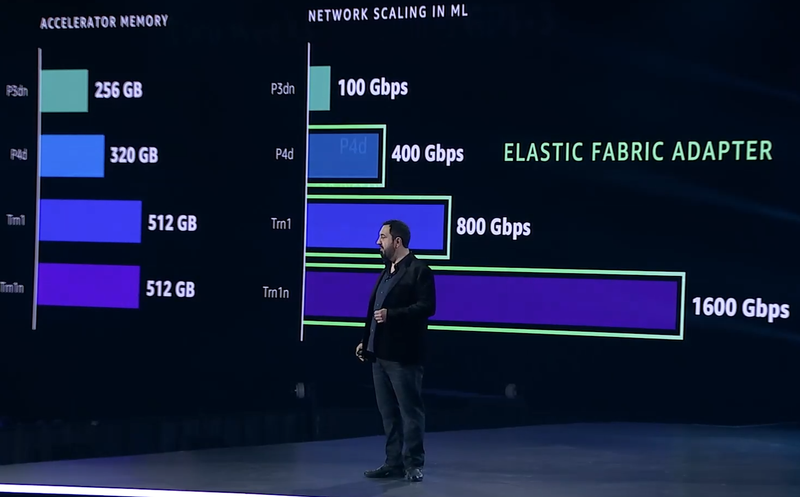

Сложность моделей машинного обучения будет расти всё быстрее Когда в прошлом году был представлен вариант P4d, его вычислительная мощность выросла в четыре раза, а объём памяти и вовсе на четверть, в то время как знаменитая модель GPT-3 превзошла по сложности BERT-Large в 500 раз. А теперь и 175 млрд параметров последней — уже ничто по сравнению с 10 трлн в новых моделях. Приходится наращивать и объём локальной памяти (у Trainium имеется 512 Гбайт HBM с суммарной пропускной способностью 13,1 Тбайт/с), и активнее использовать распределённое обучение.  Для последнего подхода узким местом стала сетевая подсистема, и при разработке стека Elastic Fabric Adapter (EFA) компания это учла, наделив новые инстансы Trn1 подключением со скоростью 800 Гбит/с (вдвое больше, чем у P4d) и с ультранизкими задержками, причём доступен и более оптимизированный вариант Trn1n, у которого пропускная способность вдвое выше и достигает 1,6 Тбит/с. Для связи между самими чипами внутри инстанса используется интерконнект NeuroLink со скоростью 768 Гбайт/с.

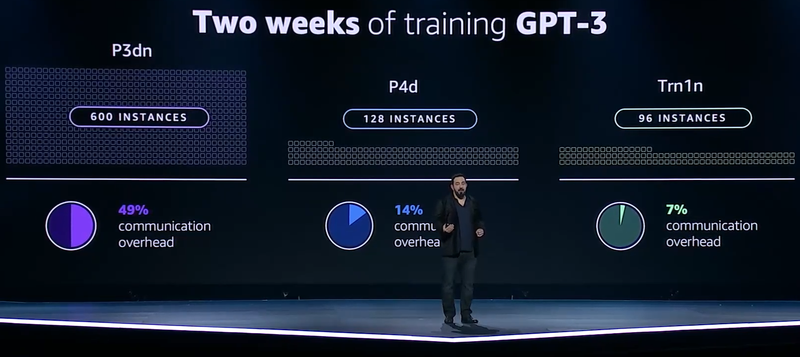

Прогресс подсистем сети и памяти в ИИ-инстансах AWS Но дело не только в возможности обучить GPT-3 менее чем за две недели: важно и количество используемых для этого ресурсов. В случае P3d это потребовало бы 600 инстансов, работающих одновременно, и даже переход к архитектуре Ampere снизил бы это количество до 200. А вот обучение на базе чипов Trainium требует всего 130 инстансов Trn1. Благодаря оптимизациям, затраты на «общение» у новых инстансов составляют всего 7% против 14% у Ampere и целых 49% у Volta.

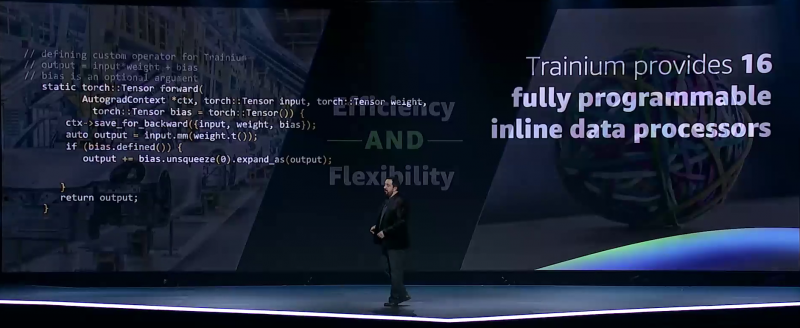

Меньше инстансов, выше эффективность при равном времени обучения — вот что даст Trainium Trainium опирается на систолический массив (Google использовала тот же подход для своих TPU), т.е. состоит из множества очень тесно связанных вычислительных блоков, которые независимо обрабатывают получаемые от соседей данные и передают результат следующему соседу. Этот подход, в частности, избавляет от многочисленных обращений к регистрам и памяти, что характерно для «классических» GPU, но лишает подобные ускорители гибкости. В Trainium, по словам AWS, гибкость сохранена — ускоритель имеет 16 полностью программируемых (на С/С++) обработчиков. Есть и у него и другие оптимизации. Например, аппаратное ускорение стохастического округления, которое на сверхбольших моделях становится слишком «дорогим» из-за накладных расходов, хотя и позволяет повысить эффективность обучения со смешанной точностью. Всё это позволяет получить до 3,4 Пфлопс на вычислениях малой точности и до 840 Тфлопс в FP32-расчётах. AWS постаралась сделать переход к Trainium максимально безболезненным для разработчиков, поскольку SDK AWS Neuron поддерживает популярные фреймворки машинного обучения. Впрочем, насильно загонять заказчиков на инстансы Trn1 компания не собирается и будет и далее предоставлять на выбор другие ускорители поскольку переход, например, с экосистемы CUDA может быть затруднён. Однако в вопросах машинного обучения для собственных нужд Amazon теперь полностью независима — у неё есть и современный CPU Graviton3, и инфереренс-ускоритель Inferentia. |

|