Материалы по тегу: in-memory

|

08.09.2025 [17:26], Владимир Мироненко

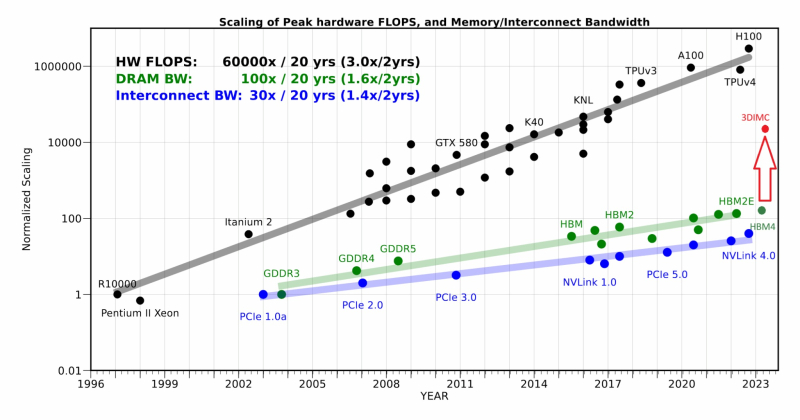

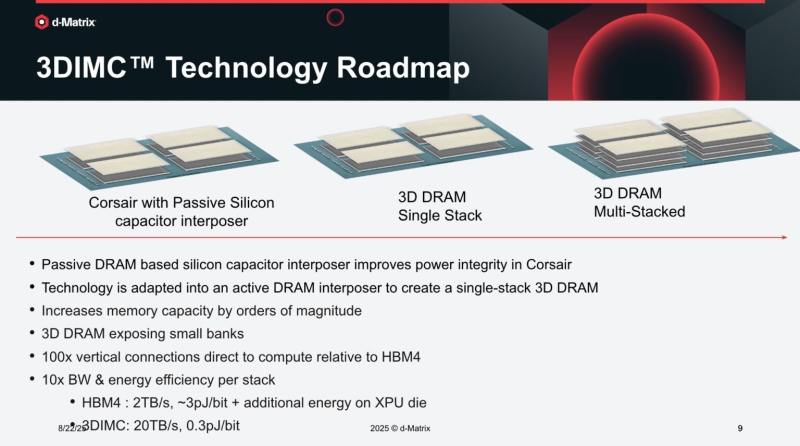

d-Matrix начала тестирование чипа Pavehawk с поддержкой 3DIMCСтартап d-Matrix объявил о разработке новой реализации технологии 3D-вычислений в памяти (3DIMC), которая обещает в 10 раз ускорить работу ИИ-моделей и в 10 раз повысить энергоэффективность по сравнению с текущим отраслевым стандартом HBM4, пишет ресурс SiliconANGLE. Технический директор Судип Бходжа (Sudeep Bhoja) сообщил в блоге, что первый чип компании с поддержкой 3DIMC, d-Matrix Pavehawk, разработка которого заняла более двух лет, сейчас проходит тестирование. В Pavehawk логический блок, изготовленный с использованием 5-нм техпроцесса TSMC, располагается поверх чипа памяти и интегрирован с ним посредством технологии F2F (face-to-face). По словам Бходжи, отраслевые тесты показывают, что производительность вычислений растёт примерно в 3 раза каждые два года, в то время как пропускная способность памяти — всего в 1,6 раза. Этот разрыв постоянно увеличивается, память уже стала узким местом в масштабировании ИИ. Компания утверждает, что простое увеличение количества ускорителей в ЦОД не решит проблему «стены памяти». HPCwire цитирует гендиректора: d-Matrix Сида Шета (Sid Sheth): «Модели быстро развиваются, и традиционные системы памяти HBM становятся очень дорогими, энергоёмкими и ограниченными по пропускной способности». По его словам, узким местом ИИ-инференса является память, а не только количество операций с плавающей запятой, но 3DIMC меняет правила игры. «Стекируя память в трёх измерениях и обеспечивая её более тесную интеграцию с вычислениями, мы значительно сокращаем задержку, увеличиваем пропускную способность и открываем новые возможности повышения эффективности», — подчеркнул он. Компания отметила, что инференс, а не обучение, быстро становится доминирующей рабочей ИИ-нагрузкой. По словам Бходжи, CoreWeave недавно заявила, что 50 % её рабочих нагрузок теперь приходится на инференс, и аналитики прогнозируют, что в течение следующих двух-трех лет инференс будет составлять более 85 % всех корпоративных рабочих ИИ-нагрузок. Он подчеркнул, что компания не занимается перепрофилированием архитектур, созданных для обучения ИИ-моделей, — она с нуля разрабатывает решения, ориентированные на инференс. Бходжа сообщил, что первые пользователи ИИ-ускорителей Corsair, среди которых есть и гиперскейлеры, и неооблака, убедились, что архитектура с упором на память может значительно повысить пропускную способность, энергоэффективность и скорость генерации токенов по сравнению с GPU. Он также отметил, что конструкция на основе чиплетов обеспечивает не только большую пропускную способность памяти, но и «невероятную» гибкость, позволяя внедрять технологии памяти нового поколения быстрее и эффективнее, чем монолитные архитектуры. Бходжа заявил, что 3DIMC на порядок увеличит пропускную способность памяти и производительность для задач ИИ-инференса и обеспечит провайдерам сервисов и предприятиям возможность масштабировать их эффективно и экономично по мере появления новых моделей и приложений. С выводом Pavehawk на рынок компания занялось созданием следующего поколения архитектуры обработки в оперативной памяти, использующей 3DMIC, под названием Raptor. «Наша архитектура следующего поколения Raptor будет включать 3DIMC и опираться на опыт, полученный нами и нашими клиентами в ходе тестирования Pavehawk. Благодаря вертикальному размещению памяти и тесной интеграции с вычислительными чиплетами, Raptor обещает преодолеть барьер в области памяти и выйти на совершенно новый уровень производительности и совокупной стоимости владения», — утверждает Бходжа. Он добавил, что, поставив требования к памяти во главу угла при разработке своих решений — от Corsair до Raptor и далее — компания гарантирует, что инференс будет быстрее, доступнее и стабильнее при масштабировании. d-Matrix провела два раунда финансирования. В раунде A в 2022 году было привлечено $44 млн, а в раунде B в 2023 году – $110 млн, что в общей сложности составляет $154 млн. Компания сотрудничает с поставщиком решений компонуемых систем GigaIO.

08.08.2025 [10:44], Сергей Карасёв

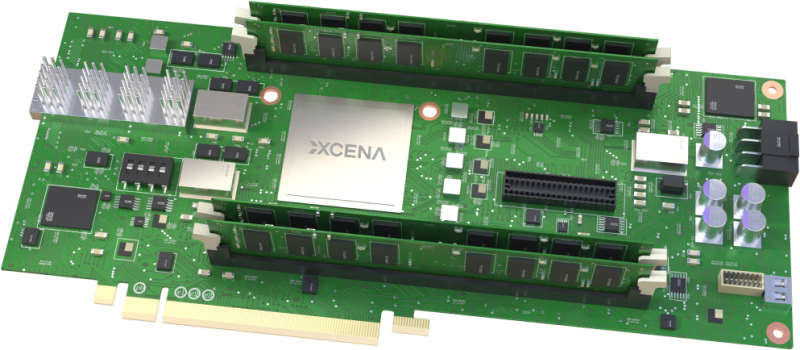

Стартап Xcena представил вычислительную память MX1 с поддержкой PCIe 6.0 и CXL 3.2Южнокорейский стартап Xcena анонсировал свой первый продукт — вычислительную память MX1. Избранные партнёры начнут получать образцы изделий с октября, тогда как массовое производство запланировано на 2026 год. Решение MX1 обладает поддержкой PCIe 6.0 и CXL 3.2. Новинка позволяет расширить основную память системы, добавив до 1 Тбайт в виде четырёх модулей DDR5 DIMM ёмкостью 256 Гбайт каждый. Реализована технология NDP (Near Data Processing), которая сводит к минимуму задержку при перемещении данных между интерфейсами и значительно снижает совокупную стоимость владения для приложений, требующих обработки больших объемов информации. Для выполнения вычислений в оперативной памяти используются «тысячи ядер» на открытой архитектуре RISC-V. Изделия MX1 позволяют существенно ускорить выполнение таких задач, как операции с векторными и графовыми базами данных, анализ информации и пр. При этом снижается нагрузка на CPU. Прототип на базе FPGA продемонстрировал сокращение времени обработки запросов при работе с базами данных на 46 % по сравнению с серверными CPU. Теоретически выигрыш может достигать 95 % при реализации в виде ASIC. Чип задействует 4-нм техпроцесс Samsung Foundry. Упомянута поддержка ECC. Компания Xcena предоставляет полностью интегрированный комплект для разработчиков (SDK), состоящий из низкоуровневых драйверов, библиотек среды выполнения и вспомогательных инструментов, которые помогают создавать прототипы и развертывать MX1 с минимальными усилиями по интеграции.

18.07.2025 [10:36], Сергей Карасёв

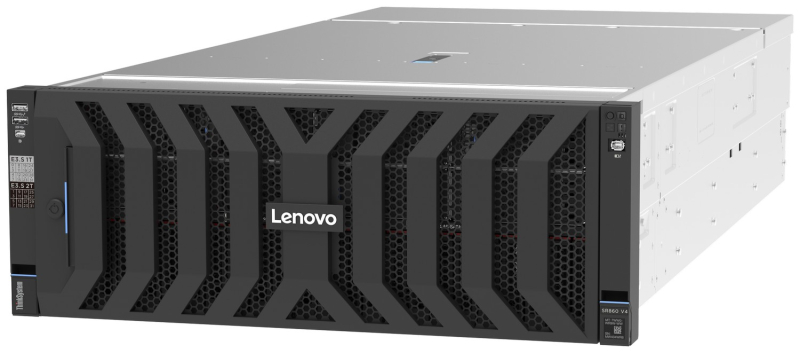

Lenovo анонсировала четырёхсокетные серверы ThinkSystem SR850 V4 и SR860 V4 на базе Intel Xeon 6Компания Lenovo анонсировала серверы ThinkSystem SR850 V4 и ThinkSystem SR860 V4 для ресурсоёмких рабочих нагрузок, которые предъявляют высокие требования к объёму оперативной памяти. Новинки получили четырёхсокетное исполнение с возможностью установки процессоров Intel Xeon 6700 с показателем TDP до 350 Вт. Обе системы поддерживают 64 модуля TruDDR5-6400 суммарной ёмкостью до 16 Тбайт. Может использоваться память CXL 2.0 в форм-факторе E3.S 2T (до 12 модулей). Есть два слота OCP 3.0 для сетевых адаптеров 1GbE, 10GbE, 25GbE, 100GbE, 200GbE и 400GbE. Модель ThinkSystem SR850 V4 имеет исполнение 2U. Могут быть реализованы до 12 разъёмов PCIe в конфигурации 11 × PCIe 5.0 и 1 × PCIe 4.0. Поддерживается установка двух GPU-ускорителей двойной ширины с TDP до 400 Вт или четырёх ускорителей одинарной ширины с TDP до 75 Вт. Подсистема хранения данных может включать 32 накопителя E3.S 1T или до 24 устройств формата SFF (NVMe). Кроме того, предусмотрены два коннектора М.2 для загрузочных SSD. Питание обеспечивают два блока с сертификатом 80 Plus Platinum или Titanium мощностью до 2600 Вт (с возможностью горячей замены). В свою очередь, сервер ThinkSystem SR860 V4 получил исполнение 4U. Машина располагает 18 слотами PCIe в конфигурации 16 × PCIe 5.0 и 2 × PCIe 4.0. Допускается монтаж четырёх GPU-ускорителей двойной ширины с TDP до 400 Вт или восьми карт одинарной ширины с TDP до 75 Вт. Поддерживаются до 56 накопителей в конфигурации 24 × SFF и 32 × E3.S 1T, а также два загрузочных SSD формата М.2. Могут использоваться до четырёх блоков питания 80 Plus Platinum или Titanium с горячей заменой. Серверы оснащены двумя портами USB 3.0 и двумя разъёмами USB 3.1, интерфейсом Mini-DP, последовательным портом и выделенным сетевым портом управления 1GbE. Заявлена совместимость с Windows, Red Hat Enterprise Linux, SUSE Linux и продуктами VMware. Возможно использование системы прямого жидкостного охлаждения Neptune Core.

02.06.2025 [09:02], Сергей Карасёв

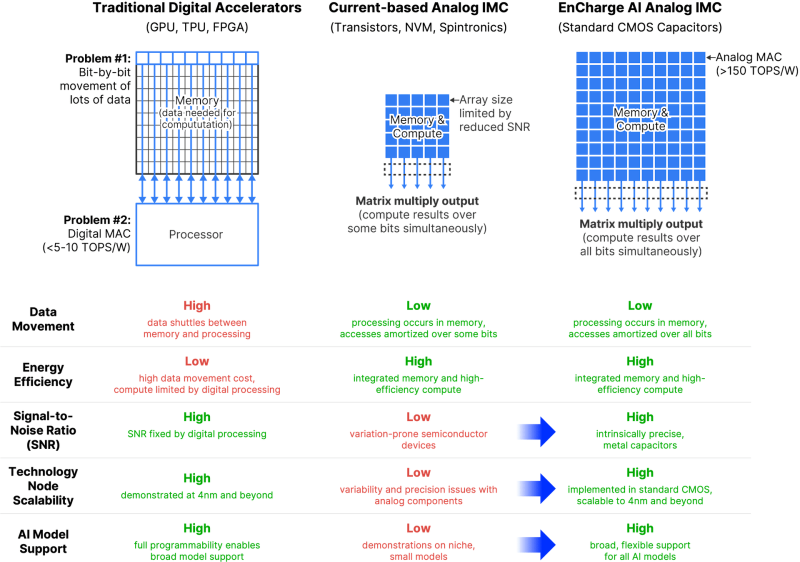

EnCharge AI представила аналоговые ИИ-ускорители EN100Компания EnCharge AI анонсировала изделия семейства EN100 — аналоговые ИИ-ускорители для in-memory вычислений. Дебютировали устройства в форм-факторе M.2 для ноутбуков и карты расширения PCIe для настольных рабочих станций. Стартап EnCharge AI, основанный в 2022 году, разрабатывает чипы, которые дают возможность перенести ИИ-нагрузки из облака на локальные платформы. Для этого применяется концепция вычислений в оперативной памяти, позволяющая увеличить эффективность и устранить узкие места, связанные с перемещением данных. NPU-ядра EnCharge AI, как утверждает сам разработчик, обеспечивают производительность на уровне 40 Топс/Вт (8-бит точность). Ускоритель EN100 для ноутбуков имеет типоразмер M.2 2280. В оснащение входят 32 Гбайт памяти с пропускной способностью до 68 Гбайт/с. Быстродействие превышает 200 Топс при общем энергопотреблении не более 8,25 Вт. Для оркестрации задействована многопоточная архитектура RISC-V. На рабочие станции ориентированы ускорители EN100 в виде карт расширения PCIe HHHL. Они несут на борту 128 Гбайт памяти с суммарной пропускной способностью 272 Гбайт/с. Производительность составляет около 1 Попс. Изделия обоих типов изготавливаются с применением 16-нм CMOS-технологии. Навин Верма (Naveen Verma), генеральный директор EnCharge AI, заявляет, что решения компании позволят выполнять ресурсоёмкие задачи ИИ локально, не полагаясь на облачную инфраструктуру. Утверждается, что такие устройства по сравнению с современными ИИ-ускорителями обеспечат в 20 раз более высокую энергоэффективность (Топс/Вт) и в 9 раз более высокую плотность вычислений (Топс/мм2) при 10-кратном снижении совокупной стоимости владения (TCO).

24.01.2025 [14:33], Сергей Карасёв

Бывший гендиректор Intel Пэт Гелсингер инвестировал средства в ИИ-стартап FractileЭкс-гендиректор Intel Пэт Гелсингер, по сообщению TrendForce, стал инвестором британского стартапа Fractile.ai, который специализируется на разработках в области ИИ. Сумма, которую предоставил бывший глава Intel на развитие этой компании, не раскрывается. Fractile.ai основана в 2022 году Уолтером Гудвином (Walter Goodwin) — специалистом, получившим докторскую степень в области искусственного интеллекта и робототехники в Оксфордском университете. Стартап разрабатывает специализированные ИИ-чипы, использующие метод вычислений в оперативной памяти. Такой подход может существенно повысить скорость инференса и выполнения других задач, связанных с интенсивными вычислениями. Утверждается, что по сравнению с традиционными ИИ-ускорителями на базе GPU решения Fractile.ai обеспечат ряд значительных преимуществ. В частности, говорится, что новые чипы позволят поднять производительность больших языковых моделей (LLM) в 100 раз при одновременном 10-кратном снижении затрат по сравнению с решениями NVIDIA. При этом чипы Fractile.ai обеспечат в 20 раз более высокую производительность в расчёте на 1 Вт затрачиваемой энергии по сравнению с любым другим оборудованием ИИ, представленным в настоящее время на рынке. Однако пока Fractile.ai не изготовила тестовые образцы изделий, а оценка их характеристик и возможностей проводится путём компьютерного моделирования. Тем не менее, Гелсингер говорит, что ни один подход в отношении ИИ-вычислений не воодушевляет его больше, чем тот, который предлагает Fractile.ai. По его словам, для дальнейшего масштабирования ИИ большое значение имеет снижение как энергопотребления, так и стоимости вычислений. Отмечается также, что стартап Fractile.ai ранее привлек в общей сложности $17,5 млн финансирования. В число инвесторов входят Kindred Capital, NATO Innovation Fund, Oxford Science Enterprises и несколько бизнес-ангелов.

20.01.2025 [07:53], Владимир Мироненко

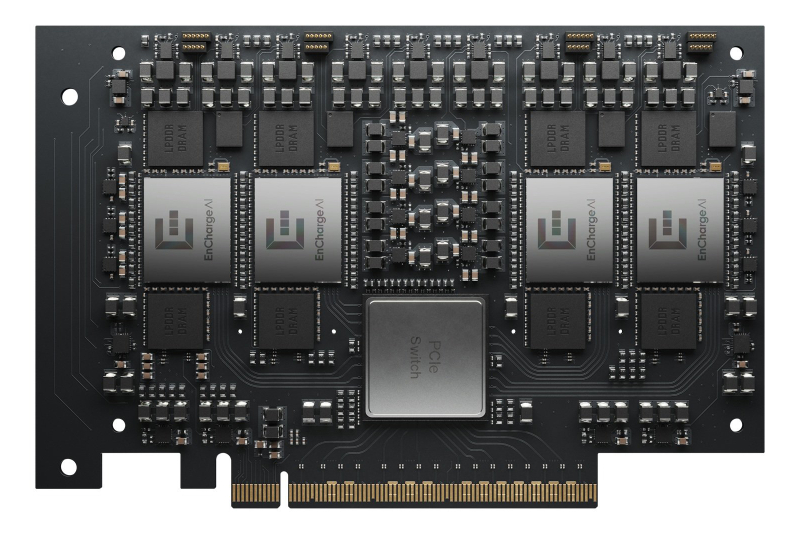

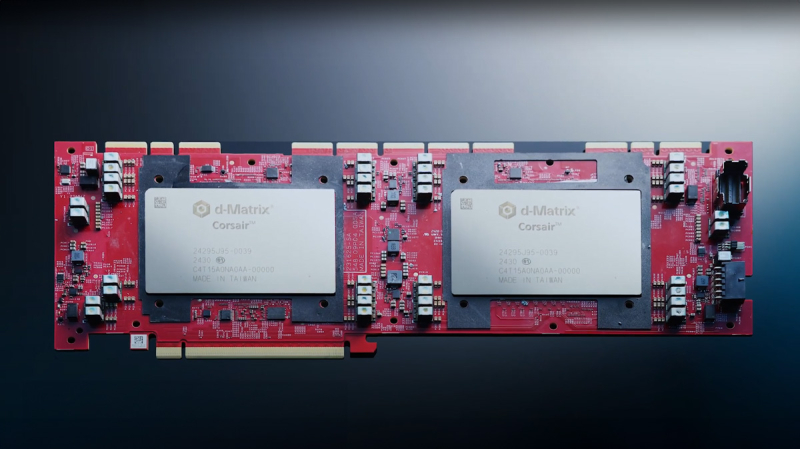

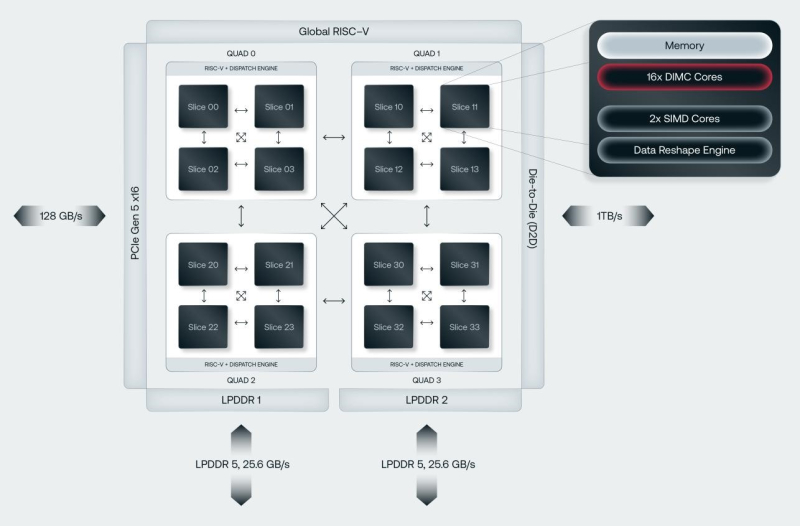

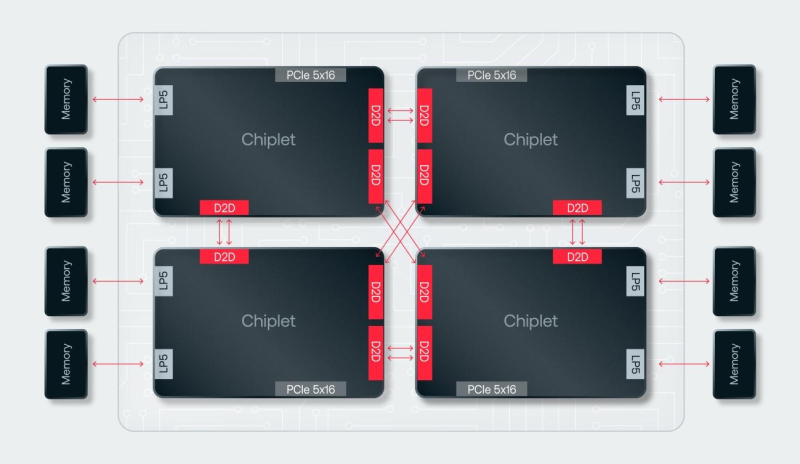

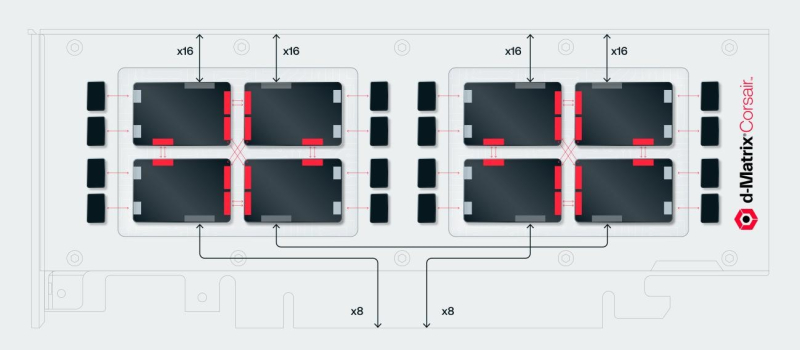

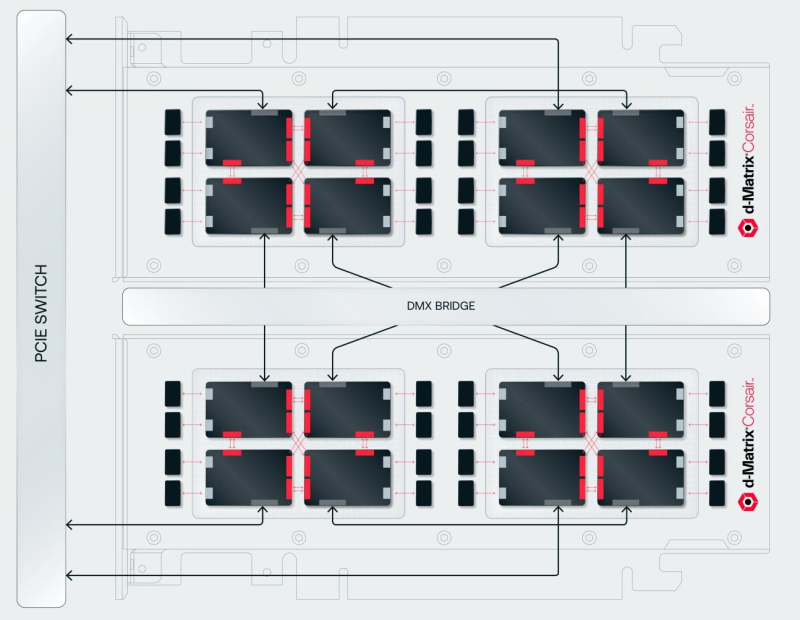

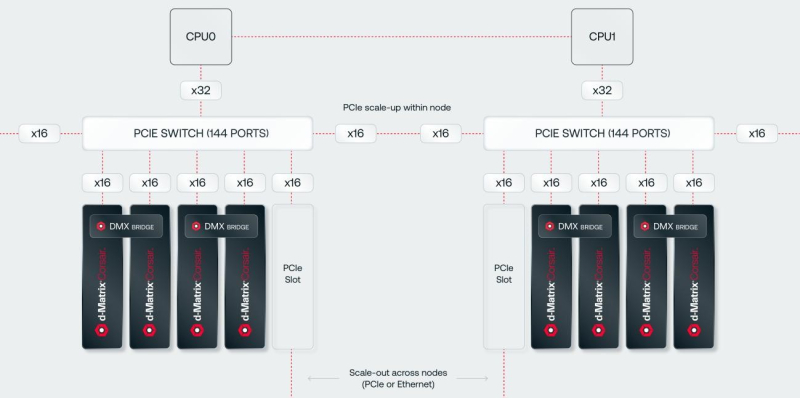

SRAM, да и только: d-Matrix готовит ИИ-ускоритель CorsairСтартап d-Matrix создал ИИ-ускоритель Corsair, оптимизированный для быстрого пакетного инференса больших языковых моделей (LLM). Архитектура ускорителя основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости порядка 150 Тбайт/с. Новинка, по словам компании, отличается производительностью и энергоэффективностью, пишет EE Times. Массовое производство Corsair начнётся во II квартале. Среди инвесторов d-Matrix — Microsoft, Nautilus Venture Partners, Entrada Ventures и SK hynix. d-Matrix фокусируется на пакетном инференсе с низкой задержкой. В случае Llama3-8B сервер d-Matrix (16 четырёхчиплетных ускорителей в составе восьми карт) может производить 60 тыс. токенов/с с задержкой 1 мс/токен. Для Llama3-70B стойка d-Matrix (128 чипов) может производить 30 тыс. токенов в секунду с задержкой 2 мс/токен. Клиенты d-Matrix могут рассчитывать на достижение этих показателей для размеров пакетов порядка 48–64 (в зависимости от длины контекста), сообщила EE Times руководитель отдела продуктов d-Matrix Шри Ганесан (Sree Ganesan). Производительность оптимизирована для исполнения моделей в расчёте до 100 млрд параметров на одну стойку. По словам Ганесан, это реалистичный сценарий использования LLM. В таких сценариях решение d-Matrix обеспечивает 10-кратное преимущество в интерактивности (время до получения токена) по сравнению с решениями на базе традиционных ускорителей, таких как NVIDIA H100. Corsair ориентирован на модели размером менее 70 млрд параметров, подходящих для генерации кода, интерактивной генерации видео или агентского ИИ, которые требуют высокой интерактивности в сочетании с пропускной способностью, энергоэффективностью и низкой стоимостью. Ранние версии архитектуры d-Matrix использовали MAC-блоки на базе SRAM-ячеек, дополненных большим количеством транзисторов для операций умножения. Сложение же выполнялось в аналоговом виде с использованием разрядных линий, измерения тока и аналого-цифрового преобразования. В 2020 году компания выпустила чиплетную платформу Nighthawk на основе этой архитектуры. «[Nighthawk] продемонстрировал, что мы можем значительно повысить точность по сравнению с традиционными аналоговыми решениями, но мы всё ещё отстаем на пару процентных пунктов от традиционных решений типа GPU», — сказал EE Times генеральный директор d-Matrix Сид Шет (Sid Sheth). Однако потенциальным клиентам не понравилось, что при таком подходе возможно снижение точности, так что в Corsair компания вынужденно сделала выбор в пользу полностью цифрового сумматора. ASIC d-Matrix включает четыре чиплета, каждый из которых содержит по четыре вычислительных блока, объединённых посредством DMX Link по схеме каждый-с-каждым, и по одному планировщику и RISC-V ядру. Внутри каждого вычислительного блока есть 16 DIMC-ядер, состоящих из наборов SRAM-ячеек (64×64), а также два SIMD-ядра и движок преобразования данных. Суммарно доступен 1 Гбайт SRAM с пропускной способностью 150 Тбайт/с. ASIC объединён со 128 Гбайт LPDDR5 (до 400 Гбайт/с) посредством органической подложки (без дорогостоящего кремниевого интерпозера). Хотя текущее поколение ASIC включает только четыре чиплета именно из-за ограничений подложки, в будущем их количество увеличится. Внешние интерфейсы ASIC представлены стандартным PCIe 5.0 x16 (128 Гбайт/с) и фирменным интерконнектом DMX Link (1 Тбайт/с) для объединения чиплетов. FHFL-карта Corsair включает два ASIC d-Matrix (т.е. всего восемь чиплетов) и имеет TDP на уровне 600 Вт. Ускоритель работает с форматами данных OCP MX (Microscaling Formats) и обеспечивает до 2400 Тфлопс в MXINT8-вычислениях или 9600 Тфолпс в случае MXINT4. Две карты Corsair можно объединить посредством 512-Гбайт/с мостика DMX Bridge. Их, по словам компании, достаточно для задействования тензорного параллелизма. Дальнейшее масштабирование возможно посредством PCIe-коммутации. Именно поэтому d-Matrix работает с GigaIO и Liqid. В одно шасси можно поместить восемь карт Corsair, а в стойку, которая будет потреблять порядка 6–7 кВт — 64 карты. d-Matrix уже разрабатывает ASIC следующего поколения Raptor, который должен выйти в 2026 году. Raptor будет ориентирован на «думающие» модели и получит ещё больше памяти за счёт размещения DRAM непосредственно поверх вычислительных чиплетов. SRAM-чиплеты Raptor также перейдут с 6-нм техпроцесса TSMC, который используется при изготовлении Corsair, к 4 нм без существенных изменений микроархитектуры. По словам компании, она потратила два года на работу с TSMC, чтобы создать 3D-упаковку для нового поколения ASIC. Как отмечает EETimes, команда разработчиков ПО d-Matrix в два раза больше команды разработчиков оборудования (120 против 60). Стратегия компании в области ПО заключается в максимальном использовании open source экосистемы, включая PyTorch, OpenAI Triton, MLIR, OpenBMC и т.д. Вместе они образуют программный стек Aviator, который отвечает за конвертацию моделей в числовые форматы d-Matrix, применяет к ним фирменные методы разрежения, компилирует их, распределяет нагрузку по картам и серверам, а также управляет исполнением моделей, включая обслуживание большого количества запросов.

17.12.2024 [12:30], Сергей Карасёв

1920 vCPU и 32 ТиБ RAM: AWS запустила инстансы EC2 U7inh на базе суперсерверов HPEОблачная платформа AWS объявила о доступности инстансов EC2 U7inh с сертификацией SAP. Эти экземпляры, построенные на серверах HPE, предлагают клиентам мощное и эффективное решение для запуска резидентных баз данных и приложений SAP в облаке. Задействована аппаратная платформа HPE Compute Scale-up Server 3200. Применяются серверы с 16 процессорами Intel Xeon Sapphire Rapids, насчитывающими до 60 вычислительных ядер каждый. Такие машины могут нести на борту до 32 Тбайт оперативной памяти DDR5. Допускается применение накопителей SATA/SAS HDD и SATA/SAS/NVMe SSD. Новые инстансы поддерживают Amazon Linux, Red Hat Enterprise Linux и SUSE Enterprise Linux Server. Сертификация SAP гарантирует, что экземпляры соответствуют строгим требованиям к производительности, объёму памяти и другим критическим характеристикам. Говорится о возможности использования SAP Business Suite on HANA (SoH), Business Suite S/4HANA, Business Warehouse on HANA (BW), SAP BW/4HANA. Несмотря на работу в виртуализированной среде, инстансы EC2 U7inh обеспечивают производительность, сопоставимую с bare metal.

Источник изображения: HPE Конфигурация EC2 U7inh включает 1920 vCPU и 32 768 ГиБ памяти DDR5. Пропускная способность сетевого подключения составляет 200 Гбит/с, пропускная способность EBS — 160 Гбит/с. Подчёркивается, что инстансы EC2 U7inh предоставляют заказчикам высоконадёжное решение для поддержки масштабных рабочих нагрузок SAP, гарантируя бесшовную интеграцию и работу в облачной инфраструктуре AWS. Более того, возможно даже объедиение четырёх инстансов в кластер, что в сумме даёт уже 7680 vCPU и 128 ТиБ RAM.

13.06.2024 [10:48], Сергей Карасёв

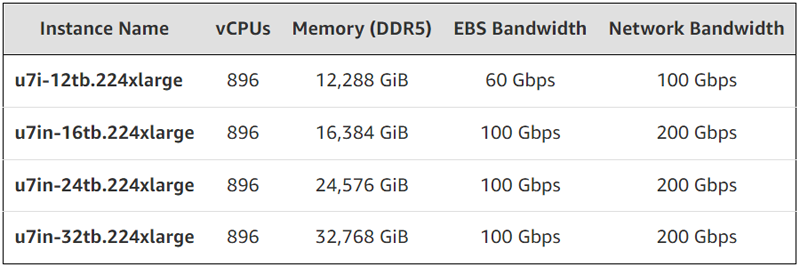

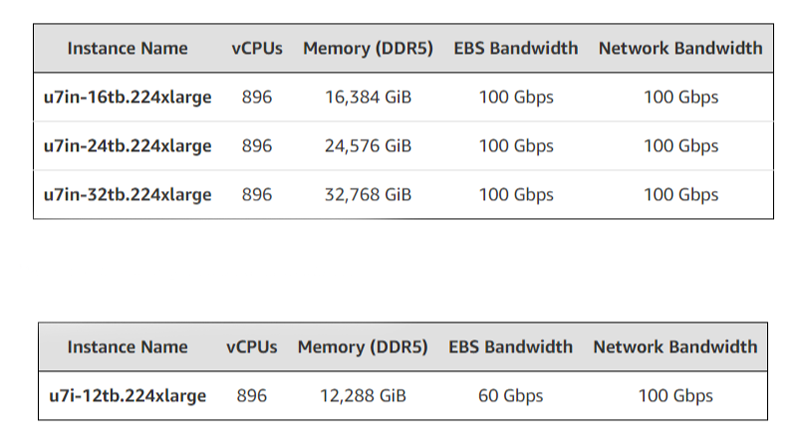

896 vCPU и 32 Тбайт памяти: AWS объявила о доступности сверхбольших инстансов EC2 U7iОблачная платформа Amazon Web Services (AWS) сообщила о доступности инстансов Elastic Compute Cloud (EC2) U7i, оптимизированных для резидентных (in-memory) баз данных. В основу положены кастомизированные процессоры Intel Xeon поколения Sapphire Rapids. Утверждается, что по сравнению с инстансами EC2 High Memory предыдущего поколения экземпляры U7i обеспечивают на 135 % более высокую вычислительную производительность и на 115 % большую производительность памяти. При этом пропускная способность EBS-томов увеличена в 2,5 раза. Инстансы поддерживают подключение до 128 томов EBS gp2/gp3 или io1/io2. Каждый том io2 Block Express может иметь размер до 64 ТиБ и обеспечивать производительность до 256 тыс. IOPS со скоростью до 32 Гбит/с. Все конфигурации включают 896 vCPU, а объём оперативной памяти варьируется от 12 288 до 32 768 ГиБ. Благодаря системе AWS Nitro вся память доступна для использования. Пропускная способность EBS составляет 60 Гбит/с у младшей версии и 100 Гбит/с у всех остальных. Пропускная способность сети — соответственно 100 и 200 Гбит/с.

Источник изображения: AWS Среди поддерживаемых ОС названы Amazon Linux, Red Hat Enterprise Linux, SUSE Linux Enterprise Server, Ubuntu и Windows Server. Говорится о возможности работы с крупными СУБД, в частности, SAP HANA, Oracle и SQL Server. Инстансы EC2 U7i были представлены в качестве предварительной версии в ноябре 2023 года. Теперь они доступны для клиентов в американских регионах AWS US East (Северная Вирджиния) и US West (Орегон), а также в Азиатско-Тихоокеанском регионе (Сеул, Сидней). Позднее в текущем году будут запущены более мощные инстансы с увеличенной вычислительной производительностью.

28.11.2023 [16:28], Владимир Мироненко

896 vCPU и 32 Тбайт RAM: AWS анонсировала самые крупные инстансы EC2 U7i для in-memory баз данныхОблачная платформа AWS представила инстансы Amazon EC2 U7i, предназначенные для поддержки крупных in-memory СУБД, включая SAP HANA, Oracle и SQL Server. Новые инстансы используют кастомные процессоры Intel Xeon Sapphire Rapids и обеспечивают по сравнению с инстансами EC2 High Memory первого поколения до 125 % большую вычислительную производительность и до 120 % большую производительность памяти. EC2 U7i также обеспечивают в 2,5 раза большую пропускную способность EBS-томов, позволяя наполнять базы данных in-memory со скоростью до 44 Тбайт/час. Инстанс U7i поддерживает подключение до 128 томов EBS gp2/gp3 или io1/io2. Каждый том io2 Block Express может иметь размер до 64 ТиБ и обеспечивать производительность до 256 тыс. IOPS со скоростью до 32 Гбит/с.  Инстансы поддерживают адаптеры ENA Express, обеспечивающем пропускную способность до 25 Гбит/с на каждый сетевой поток. Всего же каждый инстанс может получить 100-Гбит/с подключение для работы с сетью и EBS. Максимальная конфигурация включает 896 vCPU и 32768 ГиБ оперативной памяти. В число поддерживаемых U7i операционных систем входят Red Hat Enterprise Linux и SUSE Enterprise Linux Server. Инстансы U7i в виде превью доступны в регионах US West (Орегон), Азиатско-Тихоокеанском (Сеул) и Европейском (Франкфурт).

24.08.2022 [22:42], Владимир Мироненко

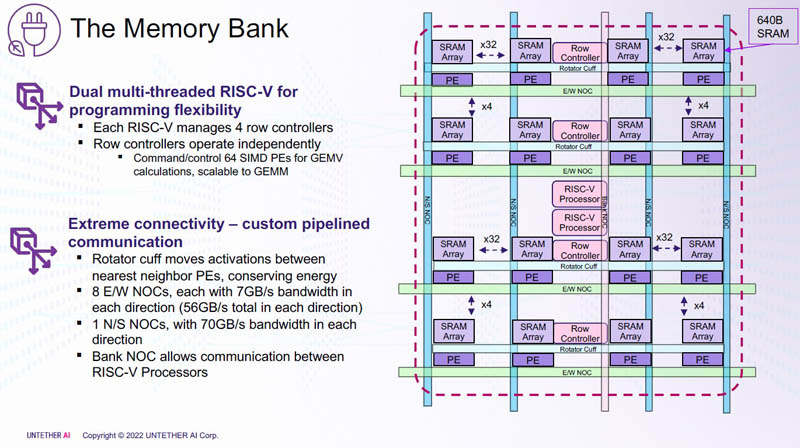

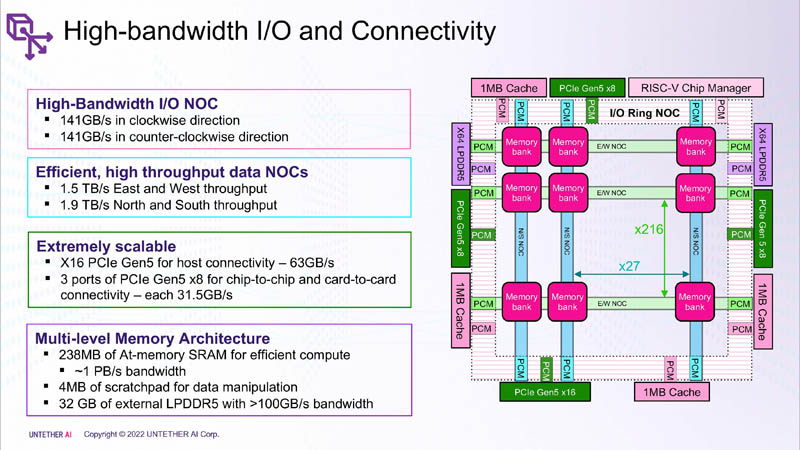

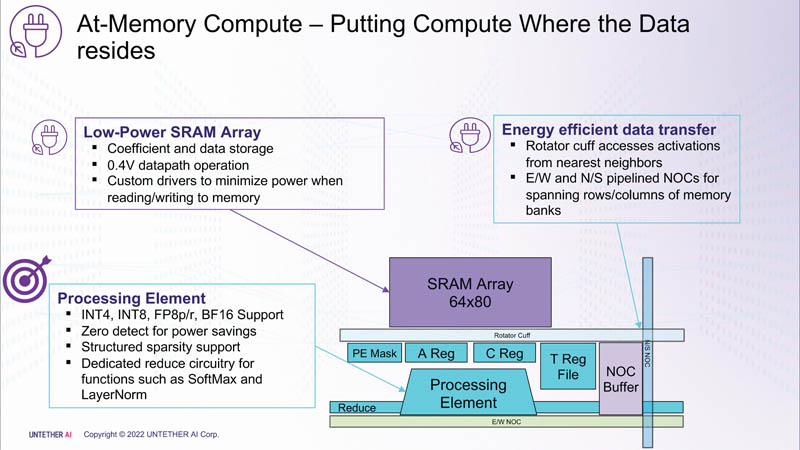

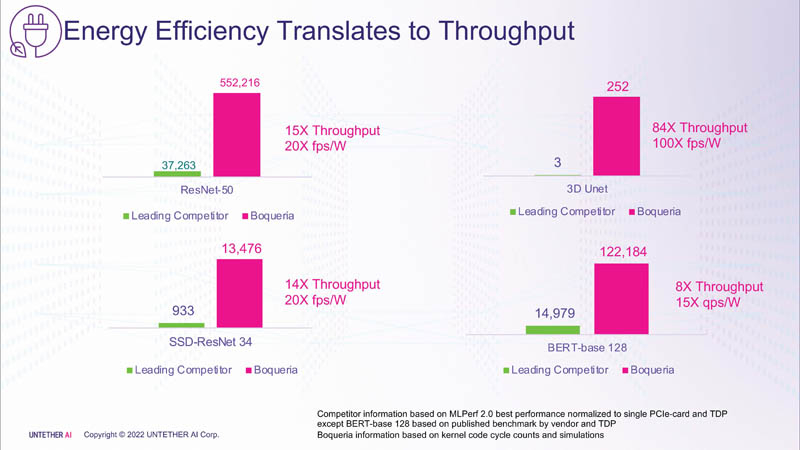

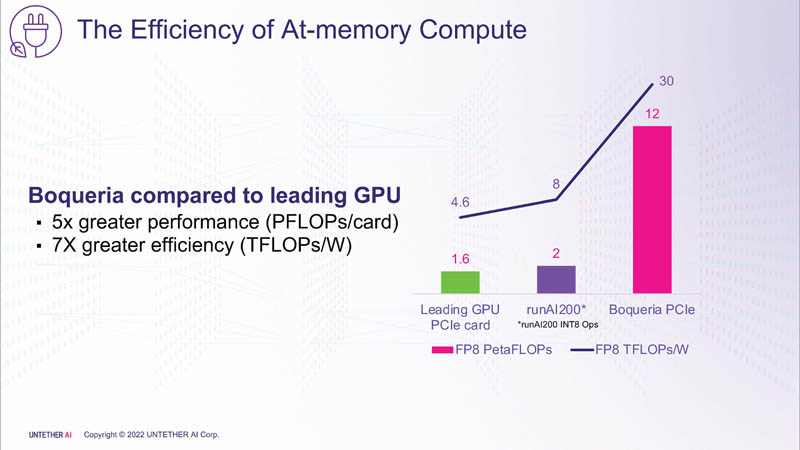

Untether AI представила ИИ-ускоритель speedAI240 — 1,5 тыс. ядер RISC-V и 238 Мбайт SRAM со скоростью 1 Пбайт/сКомпания Untether AI анонсировала ИИ-архитектуру следующего поколения speedAI (кодовое название «Boqueria»), ориентированную на инференс-нагрузки. При энергоэффективности 30 Тфлопс/Вт и производительности до 2 Пфлопс на чип speedAI устанавливает новый стандарт энергоэффективности и плотности вычислений, говорит компания. Поскольку at-memory вычисления в ряде задач значительно энергоэффективнее традиционных архитектур, они могут обеспечить более высокую производительность при одинаковых затратах энергии. Первое поколение устройств runAI в 2020 году Untether AI достигла энергоэффективности на уровне 8 Тфлопс/Вт для INT8-вычислений. Новая архитектура speedAI обеспечивает уже 30 Тфлопс/Вт. .jpg)

Изображения: Untether AI (via ServeTheHome)  Этого удалось добиться благодаря архитектуре второго поколения, использованию более 1400 оптимизированных 7-нм ядер RISC-V (1,35 ГГц) с кастомными инструкциями, энергоэффективному управлению потоком данных и внедрению поддержки FP8. Вкупе это позволило вчетверо поднять эффективность speedAI по сравнению с runAI. Новинка может быть гибко адаптирована к различным архитектурам нейронных сетей. Концептуально speedAI напоминает ещё один тысячеядерный чип RISC-V — Esperanto ET-SoC-1.   Первый член семейства speedAI — speedAI240 — обеспечивает 2 Пфлопс вычислениях в FP8-вычислениях или 1 Пфлопс для BF16-операций. Благодаря этому обеспечивается самая высокая в отрасли эффективность — например, для модели BERT заявленная производительность составляет 750 запросов в секунду на Вт (qps/w), что, по словам компании, в 15 раз выше, чем у современных GPU. Добиться повышения производительности удалось благодаря тесной интеграции вычислительных элементов и памяти.   На каждый блок SRAM объёмом 328 Кбайт приходится 512 вычислительных блоков, поддерживающих работу с форматами INT4, INT8, FP8 и BF16. Каждый вычислительный блок имеет два 32-бит (RV32EMC) кастомных ядра RISC-V с поддержкой четырёх потоков и 64 SIMD. Всего есть 729 блоков, так что суммарно чип несёт 238 Мбайт SRAM и 1458 ядер. Блоки провязаны между собой mesh-сетью, к которой также подключены кольцевая IO-шина, несущая четыре 1-Мбайт блока общего кеша, два контроллера LPDRR5 (64 бит) и порты PCIe 5.0: один x16 для подключения к хосту и три x8 для объединения чипов. Суммарная пропускная способность SRAM составляет около 1 Пбайт/с, mesh-сети — от 1,5 до 1,9 Тбайт/с, IO-шины — 141 Гбайт/c в обоих направлениях, а 32 Гбайт DRAM — чуть больше 100 Гбайт/с. PCIe-интерфейсы позволяют объединить до трёх ускорителей, с шестью speedAI240 чипами у каждого. Решения speedAI будут предлагаться как в виде отдельных чипов, так и в составе готовых PCIe-карт и M.2-модулей. Ожидается, что первые поставки избранным клиентам начнутся в первой половине 2023 года. |

|