Материалы по тегу: aws

|

06.02.2024 [23:09], Владимир Мироненко

AWS будет зарабатывать до $1 млрд в год на одних только IPv4-адресахКак и было объявлено, с 1 февраля облачный провайдер Amazon Web Services (AWS) ввёл плату за аренду публичных IPv4-адресов. Хотя размер платы невелик — всего $0,005/час или $43,80 за год аренды, выручка AWS от этого бизнеса, по оценкам гендиректора провайдера сетевых сервисов Border0 Андре Тунка (Andree Toon), может составить от $400 млн до $1 млрд в год, пишет The Register. Тунк использовал данные Amazon о принадлежащих ей подсетях, согласно которым у неё есть как минимум 131 932 752 IPv4-адреса. При текущей средней рыночной цене адреса на уровне $35/шт. всё IPv4-богатство AWS стоит порядка $4,6 млрд. Тунк также прозондировал все адреса компании и выявил, что около 6 млн из них доступны в Сети. Впрочем, политики безопасности могут скрывать многие из них, так что фактическое количество активных адресов IPv4 может быть намного больше. В итоге Тунк предложил консервативную оценку выручки AWS от аренды IPv4, согласно которой от 10 до 30 % адресов действительно используются в течение целого года. Amazon скупала IPv4-адреса не один год, расходуя на их приобретение значительные средства. Например, в 2020 году президент неправительственной организации радиолюбителей Amateur Radio Digital Communications (ARDC) подтвердил получение от Amazon $108 млн за 4 млн адресов IPv4. В 2018 году она купила у GE 16 млн адресов, а в 2017-м — 8 млн адресов у MIT. За три последних года Amazon суммарно выкупила не менее 30 млн адресов. При этом, как ранее отмечал Тунк, некоторые приобретённые IPv4-блоки представлены в списке подсетей Amazon лишь частично. «Хотя это новая дополнительная плата, которая в некоторой степени снижает ценность, которую клиент получает от сервисов AWS, это вполне реалистичная сумма, учитывая дороговизну и ограниченность IPv4-адресов, а также тот факт, что он предоставляется клиенту как услуга, аналогичная инфраструктурному оборудованию», — отметил старший директор по исследованиям IDC Эндрю Басс (Andrew Buss).

05.02.2024 [18:08], Владимир Мироненко

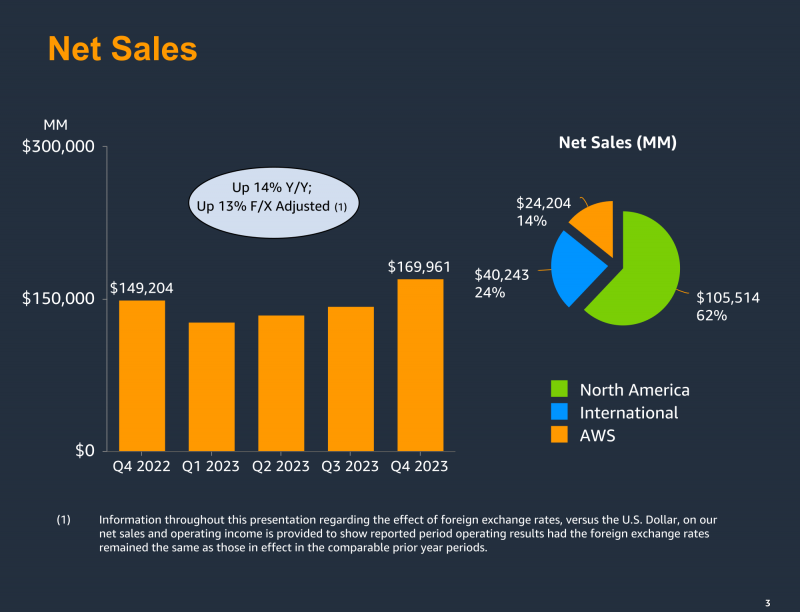

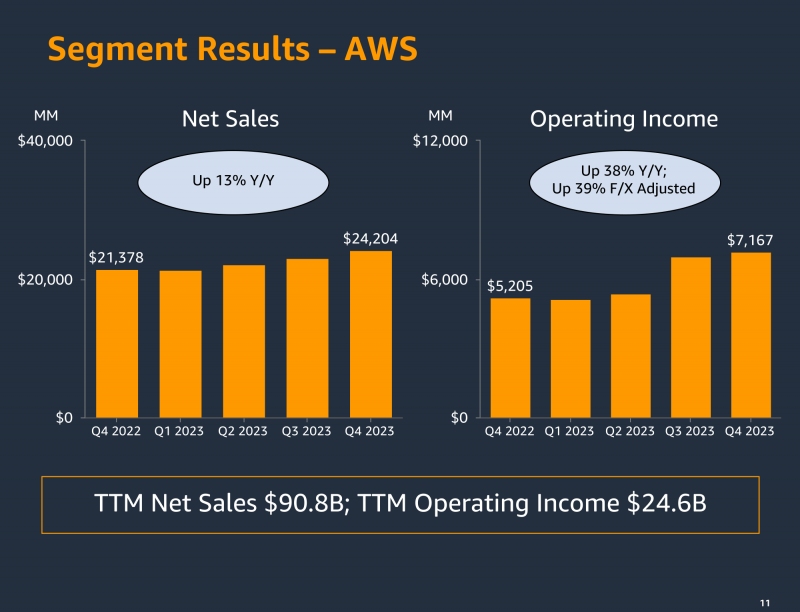

AWS увеличила квартальную выручку до $24,2 млрд, оправдав ожидания Уолл-стритКомпания Amazon.com, Inc. объявила результаты IV квартала и 2023 года в целом, завершившегося 31 декабря 2023 года, которые оказались выше прогнозов экспертов Уолл-стрит. Выручка облачного подразделения Amazon Web Services (AWS) за отчётный квартал выросла год к году на 13 % до $24,2 млрд, что совпало с прогнозом аналитиков StreetAccount. Два предыдущих квартала выручка увеличивалась на 12 %. Умеренное ускорение «оставляет некоторые сомнения относительно того, сможет ли облачное подразделение противостоять конкурентам», — цитирует ресурс Bloomberg заявление Скай Канавес (Sky Canaves), старшего аналитика Insider Intelligence. Также следует отметить, что год назад квартальная выручка AWS выросла на 20 %. В свою очередь, финансовый директор Amazon Брайан Олсавски (Brian Olsavsky) выразил оптимизм по поводу перспектив роста AWS в течение года. «Мы начинаем видеть, что клиенты сокращают свою работу по оптимизации затрат и переводят обсуждение в сторону возобновления миграции в облако, которую они, возможно, отложили в прошлом году», — сказал Олсавски, добавив, что существует большой интерес к продуктам генеративного ИИ облачного подразделения. Гендиректор Amazon Энди Ясси (Andy Jassy) заявил в ходе телефонной конференции с аналитиками, что сервисы генеративного ИИ остаются «относительно небольшим» бизнесом, но компания считает, что они могут приносить «десятки миллиардов долларов» дохода в течение следующих нескольких лет. Операционная прибыль AWS за IV квартал составила $7,2 млрд, в то время как годом ранее этот показатель был равен $5,2 млрд. В целом за 2023 год выручка AWS составила $90,8 млрд (рост 13 % год к году), операционная прибыль — $24,6 млрд ($22,8 млрд в 2022 году). При этом подразделение сбавило темпы роста и уступило долю глобального рынка Microsoft Azure и Google Cloud. В числе достижений в минувшем году AWS назвала запуск суверенного облака для Европы, расширение сотрудничества с Amgen в разработке технологий генеративного ИИ, а также заключение соглашений по поводу статуса предпочтительного провайдера облачных сервисов с рядом компаний, включая автопроизводителя SAIC MOTOR, телекоммуникационную компанию Axiata Group Berhad и производителя электромобилей BYD. Что касается результатов Amazon в целом, что в IV квартале компания получила выручку в размере $170,0 млрд (рост 14 %). За год выручка составила $574,8 млрд (рост 12 %). Операционная прибыль за квартал выросла до $13,2 млрд с $2,7 млрд годом ранее, за год показатель составил $36,9 млрд ($12,2 млрд в 2022 году). Чистая прибыль выросла в IV квартале до $10,6 млрд или $1,0 на разводнённую акцию с $0,3 млрд или $0,003 на разводнённую акцию годом ранее. За год чистая прибыль компании составила $30,4 млрд или $2,90 на разводнённую акцию по сравнению с $2,7 млрд убытков или $0,27 на разводнённую акцию в 2022 году. В текущем квартале Amazon планирует получить выручку в размере $138–$143,5 млрд (рост 8–13 %) и операционную прибыль в пределах от $8 до $12 млрд. Аналитики, опрошенные LSEG (ранее Refinitiv), ожидают выручку в размере 141,2 млрд. В свою очередь, по данным опроса аналитиков ресурсом Bloomberg, прогноз по выручке равен $142 млрд, по операционной прибыли — $9,12 млрд.

29.01.2024 [16:46], Руслан Авдеев

AWS получила разрешение на строительство кампуса ЦОД в чилийской столицеAmazon Web Services (AWS) получила «добро» на реализацию в столице Чили проекта строительства ЦОД стоимостью $205 млн. По данным Datacenter Dynamics, кампус в Сантьяго будет первым, построенным Amazon в Южной Америке. Строительство будет проводиться в два этапа и начнётся уже в марте 2024-го. Ёмкость ЦОД объявят позже. Кампус будет построен на участке площадью 18,7 га в районе Padre Hurtado. Там разместятся здания ЦОД, а также 12 резервных дизельных генераторов и система кондиционирования с низким уровнем потребления воды. Наконец, на объекте будут смонтированы системы охлаждения и пожарной безопасности. Возведение первой очереди ЦОД площадью 4630 м2 намерены завершить в апреле следующего года, а в эксплуатацию его введут месяцем позже. Вторая очередь площадью 3470 м2 будет готова в 2028 году. Возможность строительства дата-центра в Чили рассматривалась как минимум с 2017 года. В январе прошлого года компания запустила в Сантьяго небольшую локальную зону. Проект крупного ЦОД был предложен в 2022 году, но только сейчас его, наконец, одобрил местный природоохранный надзорный орган Servicio de Evaluación Ambiental de la República de Chile (SEA). Oracle тем временем запустила в Чили уже второй облачный регион.

28.01.2024 [00:16], Сергей Карасёв

AWS потратит $10 млрд на создание в США кампусов ЦОД общей площадью 688 гаОблачная платформа Amazon Web Services (AWS), по сообщению ресурса Datacenter Dynamics, займётся реализацией крупного проекта по строительству сети дата-центров в округе Мадисон (Миссисипи, США). Инициатива получила название «Проект Атлас» (Project Atlas). Суммарные затраты оцениваются в $10 млрд. «Проект Атлас» уже одобрен на законодательном уровне, причём власти утвердили ряд стимулирующих мер. Это, в частности, 100 % освобождение от корпоративного подоходного налога на 10 лет, а также налоговые льготы на продажи и любые инвестиции, сделанные в течение 12 месяцев после завершения проекта. Amazon также получит возврат в размере 3,15 % от затрат на строительство и полное освобождение от налога на продажи и использование оборудования. Более того, компания получит 30-летнее освобождение от налогов при условии, что будет ежегодно инвестировать в регионе как минимум $500 млн и открывать по 50 дополнительных рабочих мест. В результате Amazon начнёт платить подоходный налог через 10 лет, а все налоговые льготы прекратят своё действие только в 2057 году. Согласно обнародованным данным, инвестиции Amazon предусматривают создание ряда кампусов ЦОД в двух промышленных зонах округа Мэдисон, что позволит сформировать не менее 1 тыс. рабочих мест. Эти дата-центры займут в общей сложности площадь около 688 га. Ожидается, что в проект будут вовлечены 6–7 тыс. строителей. Завершить работы планируется к 2027 году. Питанием новые объекты обеспечит энергетическая компания Entergy Mississippi. Для этого будут развёрнуты дополнительные солнечные фермы в Хиндсе, Вашингтоне и Таллахатчи. Ожидается, что Entergy Mississippi вложит в эти площадки от $2 до $3 млрд. Amazon утверждает, что с 2010 года она инвестировала $2,3 млрд в проекты, включающие пять солнечных ферм и ветряную электростанцию в Миссисипи. Кроме того, Amazon пообещала создать различные обучающие программы, в том числе бесплатные, в области сетевых инфраструктур, дата-центров и облаков для старшеклассников, студентов и преподавателей местных образовательных организаций.

26.01.2024 [21:42], Руслан Авдеев

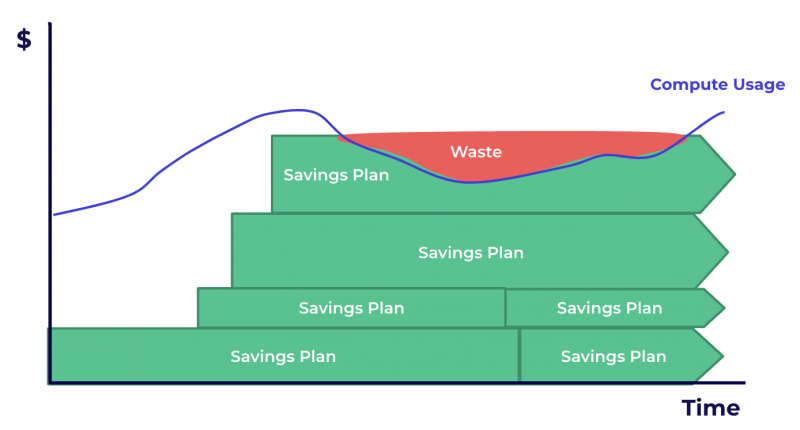

Клиенты AWS ежегодно теряют миллиарды долларов из-за неоптимального использования облакаБолее половины организаций, пользующихся облачными сервисами AWS, могли бы существенно сэкономить, следует из доклада ProsperOps — в совокупности клиенты ежегодно теряют до $20 млрд из-за недостаточного внимания к тарификации. В рамках исследования были изучены обезличенные данные сотен аккаунтов AWS. Выяснилось, что менее половины компаний использовали доступные им скидки или иные возможности для сокращения расходов. При этом «облачный перерасход» — хорошо задокументированный феномен. Проведённое в прошлом году компанией HashiCorp исследование показало, что 94 % предприятий признали тот факт, что они зря тратят часть денег на облачные сервисы из-за избыточного выделения ресурсов или недоиспользования имеющихся. Дело осложняется и крайне запутанной системой тарификации облачных ресурсов. Между тем у AWS имеются разнообразные методы формирования цен. Наиболее известны т.н. Savings Plans, в рамках которых можно заказать заданный объём ресурсов на длительный срок, получив существенную скидку. В докладе указывается, что 38 % организаций пользуются подобной скидкой — поскольку её легко применять и рассчитывать. Однако если фактическое использование окажется ниже ожидаемого, разницу в расходах AWS не вернёт. 18 % организаций прибегают к планам Standard Reserved Instances, где также даётся существенная скидка в обмен на заблаговременное резервирование EC2-инстансов. Ограничений в случае применения подобного тарифа больше, но имеются и некоторые преимущества, вроде возможности как покупать, так и продавать инстансы другим клиентам AWS. Наконец, реже всего используются Convertible Reserved Instances, хотя как раз они обеспечивают наиболее гибкий подход к освоению ресурсов, но ими пользуются только 14 % из опрошенных организаций. Эксперты уверены, что наиболее эффективными в плане экономии являются Convertible Reserved Instances и Savings Plans. Однако на практике не всем умеют грамотно пользоваться этими опциями. Более того, компании, расходующие в год менее $1 млн на облачную инфраструктуру, как выяснилось, ещё и наименее эффективно расходуют средства, тогда как крупные заказчики (более $5 млн/год) гораздо более аккуратно подходят к тратам.

23.01.2024 [14:30], Руслан Авдеев

Amazon претендует на звание крупнейшего покупателя возобновляемой энергии в 2023 годуAmazon утверждает, что в 2023 году компания стала крупнейшим корпоративным покупателем возобновляемой энергии в мире и инвестировала в более 100 новых проектов, связанных с ветряными и солнечными электростанциями. Как сообщает пресс-служба Amazon, IT-гигант заключил за год больше соглашений о покупке энергии (PPA), чем любой другой бизнес с 2020 года. В своё время компания объявила о намерении добиться нулевых выбросов в атмосферу к 2040 году, но её нередко критикуют за недостаточную прозрачность отчётности, связанной с «зелёной» повесткой. На сегодня Amazon утверждает, что поддержала более 500 ветряных и солнечных проектов по всему миру. Когда все из них будут введены в эксплуатацию, то станут поставлять свыше 77 тыс. ГВт∙ч «чистой» энергии ежегодно — такого объёма, например, достаточно, чтобы удовлетворить потребности 7,2 млн домохозяйств США. В числе новых инициатив Amazon за последние 12 месяцев — проект, в результате которого загрязнённую территорию старой угольной шахты в Мэриленде (США) перепрофилировали в солнечную электростанцию. Дополнительно компания поддержала свой первый проект по генерации возобновляемой энергии в Южной Корее, а также реализовала 10 похожих схем в Техасе. Все они уже прямо или косвенно снабжают ЦОД, офисы и другие объекты Amazon и поставляют чистую энергию в местные электросети. Кроме того, только в 2022 году экологические схемы Amazon обеспечили поддержку занятости, эквивалентной 39 тыс. рабочих мест. В AWS уже заявили, что ещё в прошлом году более 90 % её операций выполнялись за счёт «зелёной» энергии и компания намерена оптимизировать производство и потребление таким образом, чтобы добиться 100 % использования возобновляемой энергии к 2025 году. При этом многие эксперты скептически относятся к энергетическим инициативам компании. В отличие от соперников вроде Microsoft Azure и Google Cloud, AWS не предлагают клиентам выбора ЦОД в зависимости от уровня выбросов. Более того, компания не публикует PUE своих объектов. Эффективность PPA в качестве инструмента сокращения выбросов тоже остаётся под вопросом. Как сообщает Datacenter Dynamics, опубликованное в прошлом году исследование лаборатории ZERO Lab Принстонского университета свидетельствует, что покупка «зелёной» энергии в больших объёмах ведёт к непредвиденным последствиям. Поскольку PPA предусматривает закупку энергии без привязки к региону, генерация вредных выбросов просто смещается, а производство чистой энергии не развивается. Исследователи считают, что закупки должны осуществляться с учётом времени генерации «зелёной» энергии, с почасовым сопоставлением потребления и производства. Некоторые игроки вроде Google и Microsoft уже заключили соглашения с соответствующими условиями, но в Amazon такие меры всё ещё не приняты.

19.01.2024 [19:54], Руслан Авдеев

В ожидании ИИ: Amazon инвестирует $15,5 млрд в японские ЦОДAmazon Web Services (AWS) до конца 2027 года инвестирует ¥2,3 трлн ($15,5 млрд) в строительство новых ЦОД и усиление деловой активности в Японии, сообщает Reuters. AWS ускорила инвестиции в Японию в ожидании взрывного роста спроса на обработку данных, в первую очередь благодаря масштабному внедрению генеративного ИИ. В 2011–2022 гг. Amazon вложила в развитие ЦОД, облака и иных направлений ¥1,51 трлн иен. В Японию AWS вложит даже больше, чем в индийский бизнес — ¥1,056 трлн ($12,7 млрд) до 2030 года. Судя по всему, японский рынок Amazon кажется более важным и перспективным. По оценкам компании, инвестиционный план обеспечит прирост ВВП Японии на 5,57 трлн иен ($37,58 млрд). Одновременно с AWS в ЦОД страны намерены инвестировать и конкуренты — Google и Microsoft, тоже рассчитывающие на рост спроса и распространение ИИ. Все три компании активно взаимодействуют с государственным сектором Японии. Например, их выбрали в качестве провайдеров «Правительственного облака». При этом локальные японские облачные игроки заметно отстают от глобальных. Масштабные проекты дата-центров необходимы для разработки и использования генеративного ИИ, причём крупные провайдеры лишь укрепят свои доминирующие позиции. В то же время по всему миру ужесточается контроль их деятельности со стороны локальных регуляторов. Например, в Евросоюзе только в 2024 году в полной мере вступит в силу закон Digital Markets Act, который будет регулировать деятельность крупных IT-компаний. В AWS не хотят, чтобы иностранные инвестиции рассматривались как угроза — в компании подчеркнули, что экспансия бизнеса Amazon позволит использовать японские данные в пределах страны, без их экспорта за рубеж. Кроме того, близость ЦОД к источникам данных существенно снизит задержки при обработке и отправке информации, говорит Amazon.

24.12.2023 [00:03], Сергей Карасёв

AWS открыла второй облачный регион в Канаде с тремя зонами доступностиПлатформа Amazon Web Services (AWS), по сообщению ресурса Datacenter Dynamics, запустила второй облачный регион в Канаде — площадку Canada West, расположенную в Калгари в провинции Альберта. В целом, AWS планирует инвестировать $17,9 млрд в Канаде до 2037 года — как в Западной, так и в Центральной областях страны. О планах по созданию региона Canada West было объявлено в ноябре 2021 года. Площадка заработала 20 декабря 2023-го. В Canada West входят три зоны доступности. Предлагаются традиционные сервисы AWS, включая анализ данных, средства безопасности, инструменты ИИ и машинного обучения и пр. Благодаря Canada West местным заказчикам стала доступна дополнительная инфраструктура для развёртывания приложений и рабочих нагрузок.

Источник изображения: AWS В число клиентов компании в Канаде входят Bell Canada, BlackBerry, Calgary Sports and Entertainment, CI Financial, Keyera, Kidoodle.tv, KOHO Financial, Maple Leaf Sports & Entertainment (MLSE), Национальная хоккейная лига (НХЛ), Natural Resources Canada (NRCan), Neo Financial, Nutrien, Sun Life, Telus, Университет Калгари и др. На сегодняшний день платформа AWS насчитывает 105 зон доступности в 33 географических регионах. Компания планирует запустить ещё 12 зон и четыре региона AWS в Малайзии, Новой Зеландии и Таиланде, а также европейское суверенное облако. Google Cloud имеет два облачных региона в Канаде — в Монреале и Торонто. У Microsoft есть регионы Azure в Торонто и Квебеке, которые открылись в 2016 году. В ноябре 2023 года Microsoft заявила, что инвестирует $500 млн в течение двух лет в строительство дата-центров в Квебеке.

21.12.2023 [17:34], Руслан Авдеев

Космический буксир Blue Ring будет подрабатывать орбитальным дата-центромОснователь Amazon Джефф Безос (Jeff Bezos) поделился информацией о планах курируемой им аэрокосмической группы Blue Origin, сообщает Datacenter Dynamics. Он обнародовал новые данные о проекте Blue Ring, впервые анонсированном в октябре 2023 года. По словам Безоса, Blue Ring будет очень интересным космическим аппаратом, предназначенным для вывода на геосинхронную орбиту или в окрестности Луны до 3 т полезной нагрузки. Буксир обеспечит как «химическую», так и «электрическую» тягу. При этом клиентам предлагаются особые услуги. В частности, аппарат будет контролировать температурные режимы, обеспечивать электропитание для выводимых в космос объектов, связь и вычисления. Другими словами, при разработке нагрузки потенциальные клиенты могут рассчитывать на определённые возможности Blue Ring. Особенный интерес представляют вычислительные мощности. По словам Безоса, речь идёт об устойчивом к воздействию космической радиации оборудовании — на борту Blue Ring его необычайно много. Отправляемые клиентами в космос объекты смогут пользоваться вычислительными мощностями перевозчика. Речь идёт об урезанном варианте Amazon Web Services (AWS), но в окрестностях Земли и Луны.

Источник изображения: Blue Ring Blue Origin — далеко не единственная компания, намеренная предлагать собственные космические буксиры. В число конкурентов входят Northrup Grumman, Rocket Lab, Momentus, Firefly Space и Astroscale. Но грузоподъёмность Blue Ring, как ожидается, будет самой высокой. Что касается вычислений на орбите, конкуренты имеются и здесь — буквально недавно Axiom Space, которая уже сотрудничает с AWS, подробно рассказала о планах строительства космического ЦОД. Соответствующие проекты изучают и в Евросоюзе, а Lonestar Data Holdings намерена развернуть хранилище на Луне. Blue Origin планирует как можно скорее представить космический буксир с ЦОД, поскольку, по словам самого Безоса, компания должна быстрее развиваться. Более того, миллиардер заявил, что желание уделять больше внимание новой компании стало одной из причин, по которой он покинул пост главы Amazon. В последние месяцы Blue Origin покинули несколько топ-менеджеров, включая её главу Боба Смита (Bob Smith), на место которого пришёл один из функционеров Amazon Дэйв Лимп (Dave Limp). Есть и позитивные новости — после нескольких отсрочек Blue Origin успешно завершила полёт ракеты New Shepard.

20.12.2023 [16:46], Руслан Авдеев

AWS реорганизует отдел продаж на фоне замедления роста доходовAmazon Web Services (AWS) намерена пойти на экстренные меры, реорганизовав отдел продаж, который насчитывают порядка 60 тыс. человек. Как сообщает Silicon Angle, в компании предполагают, что это поможет исправить ухудшившиеся показатели на рынке облачных сервисов — на фоне того, что Google Cloud и Microsoft только укрепили свои позиции в этой сфере. По последним данным, глава облачного подразделения Amazon по продажам и маркетингу Мэтт Гарман (Matt Garman) планирует объединить разные команды специалистов по продажам, разработавших «конфликтующие торговые стратегии». Изменится и механика назначения технических сотрудников для помощи клиентам. Последние уже жаловались на качество сервиса. Хотя AWS пока остаётся доминирующим игроком на рынке IaaS, на компанию негативно влияет замедление роста. Компания не смогла преуспеть минимум в двух ключевых сегментах, связанных со стартапами и малым бизнесом. По мнению экспертов, в 2023 году поставленных целей достичь вряд ли удастся.

Источник изображения: LYCS Architecture/unsplash.com Более того, обнародованные самой AWS данные свидетельствуют о том, что компания, хотя и является крупнейшим игроком на рынке, не в состоянии придерживаться темпов роста, характерных для двух главных конкурентов — Google и Microsoft. Впрочем, сравнивать результаты непросто, поскольку компании отчитываются по-разному. Тем не менее, AWS отчиталась о росте выручки на 12 % в III квартале, в то время как выручка Microsoft Azure году к году увеличилась на 29 %, а Google Cloud — на 22 %. По данным Business Insider, это не единственная проблема AWS, поскольку сотрудники обеспокоены текучкой кадров среди топ-менеджмента компании в последние пару лет. Выросло и количество увольняющихся менеджеров уровнями ниже, причём многие причиной увольнения называют «выгорание» — после серии увольнений в 2023 году нагрузка на оставшихся сотрудников увеличилась. Команды AWS, занимающиеся продажами и маркетингом, уже пережили в этом году крупные реорганизации — уволили сотрудников с «дублирующихся» позиций, а региональным управленцам дали больше полномочий при принятии решений. Тогда в AWS тоже заявляли, что реструктуризация отдела продаж должна пойти на пользу клиентам. |

|