Материалы по тегу: bloomberg

|

09.10.2025 [15:30], Руслан Авдеев

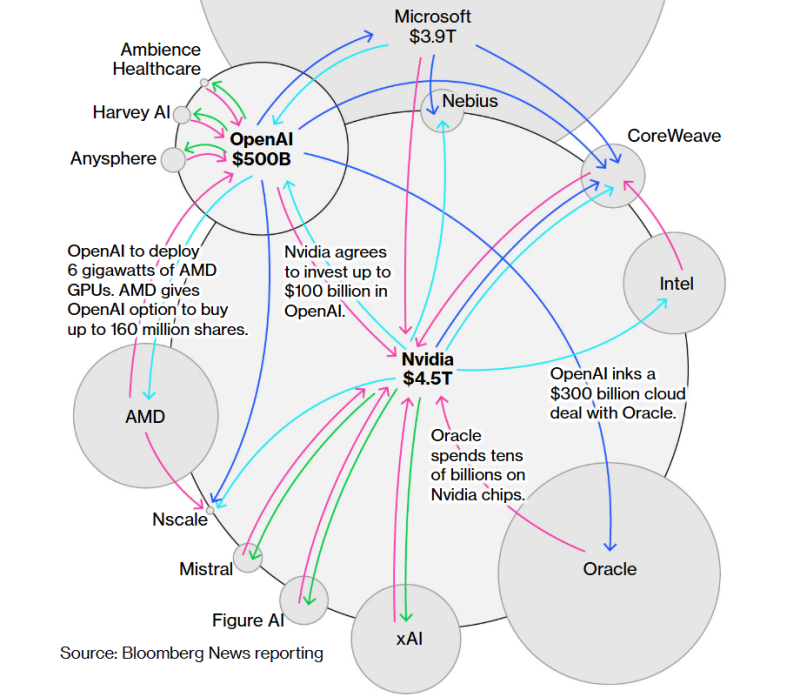

Круговая порука: всё больше аналитиков опасаются формирования «пузыря» на рынке ИИНесколько докладов аналитиков, опубликованных на текущей неделе, сообщают о потенциальных рисках, связанных с бумом на рынке искусственного интеллекта. Не исключается, что ситуация ведёт к возникновению пузыря в сфере ИИ, сообщает Silicon Angle. Так, Банк Англии (Bank of England) предупредил, что в данном сегменте возросла вероятность «резкой коррекции рынка». Одной из причин называются завышенные оценки фондового рынка по ряду показателей, особенно для технологических компаний, ориентирующихся на развитие бизнеса в сфере ИИ. Заявление последовало за публикацией материалов Bloomberg и NBC News, в которых анализировались «циклические сделки» между крупнейшими ИИ-компаниями. Особое внимание уделялось крупным инвестициям NVIDIA и AMD в стартапы.

Источник изображения: Alexas_Fotos/unsplash.com Зачастую выделенные гигантами средства используются для покупки стартапами ИИ-ускорителей тех же NVIDIA и AMD. Так NVIDIA использовала данную схему при работе с CoreWeave, Lambda и xAI. А OpenAI договорилась заключила соглашения на десятки миллиардов долларов с NVIDIA и AMD. Всего NVIDIA, согласно данным PitchBook, сделала 52 инвестиции в ИИ-компании в 2024 году, а в 2025-м — не менее 50. Если огромные расходы на ИИ ведут к возникновению пузыря, связанные с ним финансовые риски могут коснуться не только разработчиков ИИ-моделей и поставщиков чипов, но и повлияют на экономику в целом. Во вторник NBC News сообщила со ссылкой на аналитику Oxford Economics, что обвал рынка ИИ способен привести к «резкой коррекции» цены акций технологических компаний — это способно крайне негативно сказаться на реальной экономике. Подобные доклады о финансовых рисках в сфере ИИ появляются не впервые. В прошлом месяце экономист Джейсон Фурман (Jason Furman, бывший директор Совета экономических консультантов Белого дома США) опубликовал серию постов в X — по его расчётам, расходы на ИИ обеспечили 92 % роста ВВП США в I полугодии 2025 года. Эксперт считает, что без бума ИИ, вероятно, были бы более низкие процентные ставки и цены на электричество, что вызвало бы более активный рост в других секторах экономики. По «очень грубым» оценкам, речь могла бы идти об экономическом росте, сопоставимом с половиной того, что получено от бума ИИ. Ранее доклад Массачусетского технологического института (MIT) о трудностях получения «отдачи» от пилотных проектов в сфере генеративного ИИ привёл к падению индекса Nasdaq на 1,2 %. На это повлияло и высказывание главы OpenAI Сэма Альтмана (Sam Altman), заявившего в одном из интервью, что рынок ИИ, возможно, превращается в пузырь и сравнил его с пузырём доткомов. Это мнение поддержали некоторые деятели технологической отрасли. Сама OpenAI рассчитывает добиться положительного денежного потока к концу текущего десятилетия. NVIDIA заявила Bloomberg, что не требует от ИИ-стартапов покупок на свои инвестиции технологий самой компании, включая ускорители. Так или иначе, это далеко не первый прогноз такого рода. В сентябре Goldman Sachs заявила, что повсеместное внедрение ИИ может не оправдать ожиданий инвесторов. На китайской стороне председатель Alibaba Джо Цай (Joe Tsai) говорил о перегреве рынка ИИ ЦОД ещё в марте, предупредив, что текущие темпы строительства таких дата-центров могут опередить спрос.

30.09.2025 [14:53], Руслан Авдеев

Бум атомной энергетики из-за ИИ ЦОД в США обойдётся в $350 млрдПо прогнозам Bloomberg Intelligence, растущий спрос на электричество в итоге приведёт к буму расходов на атомную энергетику в США. Отрасль получит $350 млрд, а выработка энергии к 2050 году увеличится на 63 %, сообщает агентство. Основным драйвером роста сектора является появление энергоёмких ИИ ЦОД. Инвестиции добавят реакторы на 53 ГВт, а общая мощность АЭС составит 159 ГВт. Хотя спрос на ядерную «безуглеродную» энергию в США на подъёме, её стоимость остаётся относительно высокой, а строительство реакторов будет осуществляться медленно. Помимо прочего, развитие атомной энергетики сдерживается и нехваткой квалифицированных кадров, дефицитом собственного американского топлива и недостаточной нормативной базой. В XXI веке в США было построено всего три классических реактора, а сейчас они не строятся вообще. Тем не менее, в докладе сообщается, что атомная энергетика страны «готова к возрождению». Аналитики ожидают значительный рост отрасли, десятилетиями находившейся в состоянии стагнации. При этом он будет значительно ниже целей, установленных американскими властями. В 2024 году администрация президента США задумала втрое увеличить мощности АЭС к 2050 году, а действующий президент издал указ, предписывающий увеличить их вчетверо.

Источник изображения: Ajay Pal Singh Atwal/unsplash.com Bloomberg сообщает, что в первую очередь для расширения отрасли станут использовать малые модульные реакторы (SMR). Это новое поколение технологий АЭС, которое должно помочь сократить затраты и время строительства для обеспечения работы ЦОД. При этом коммерческие варианты реакторов подобного типа в США и мире пока отсутствуют. Ожидается, что мощности будут наращивать постепенно. В Bloomberg Intelligence утверждают, что в следующем десятилетии атомная отрасль прирастёт лишь на 9 ГВт (речь о реакторах всех типов). Широкое же внедрение SMR должно начаться не ранее 2035 года. Вопрос развития новых безуглеродных мощностей давно назрел. Совсем недавно сообщалось, что закрытие угольных электростанций в США фактически приостановлено — для того, чтобы обеспечить потребности ИИ ЦОД. В июле 2025 года Министерство энергетики США выделило бизнесу федеральные земли для ускоренного строительства ЦОД и электростанций. Ранее Deloitte сообщало, что АЭС смогут обеспечить 10 % будущего спроса ЦОД США на электроэнергию, но строить их придётся быстрее.

23.09.2025 [17:07], Руслан Авдеев

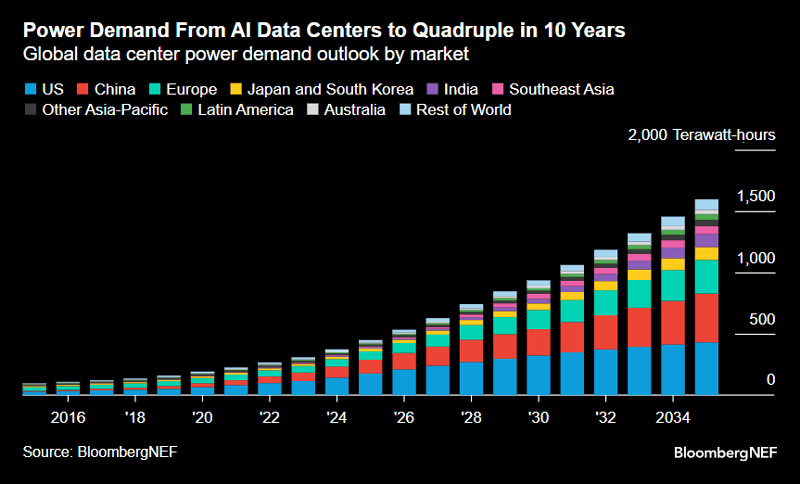

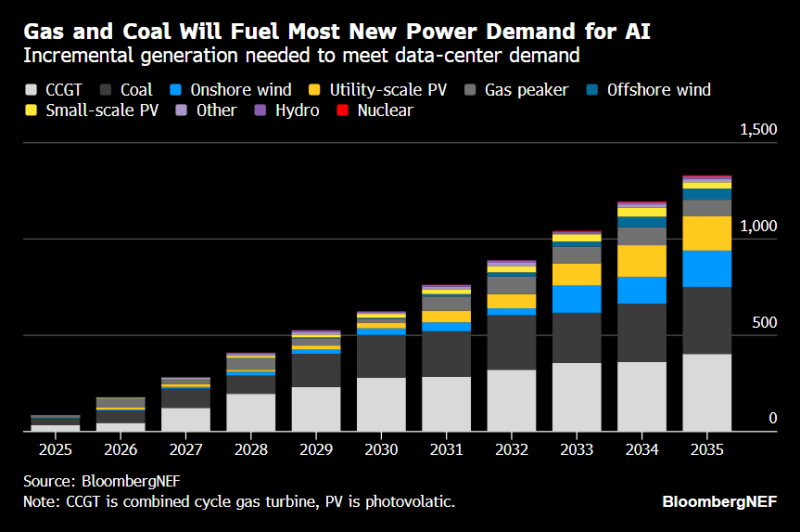

BloombergNEF: ИИ ЦОД способствуют ускорению роста спроса на электричествоУскоряющееся развитие ИИ-технологий превращает дата-центры в ключевых потребителей энергии. По мнению экспертов, связанный с обучением искусственного интеллекта и ИИ-сервисами спрос на электричество за десятилетие вырастет вчетверо, что сделает ЦОД одними из наиболее динамично растущих энергопотребителей в мире, Bloomberg. В краткосрочной перспективе нарастающий дефицит энергии, вероятно, поможет покрыть генерация на ископаемом топливе. В долгосрочной перспективе победителем, как ожидается, окажется «чистая» энергия, поскольку операторам ЦОД приходится учитывать давление политиков, заявленные цели по достижению нулевых выбросов и мнение собственных клиентов, требующих роста, но не желающих наносить лишний ущерб окружающей среде. К 2035 году энергопотребление ЦОД достигнет 1,6 тыс. ТВт∙ч, т.е. около 4,4 % от общемирового. Фактически, по уровню потребления речь идёт о четвёртом месте после Китая, США и Индии. Наибольшие изменения ожидаются в США — предполагается, что страна останется крупнейшим в мире рынком ЦОД в течение десятилетия. По темпам роста спроса на электричество в ключевых регионах США дата-центры, в частности, обгоняют электромобили и другие перспективные технологии.

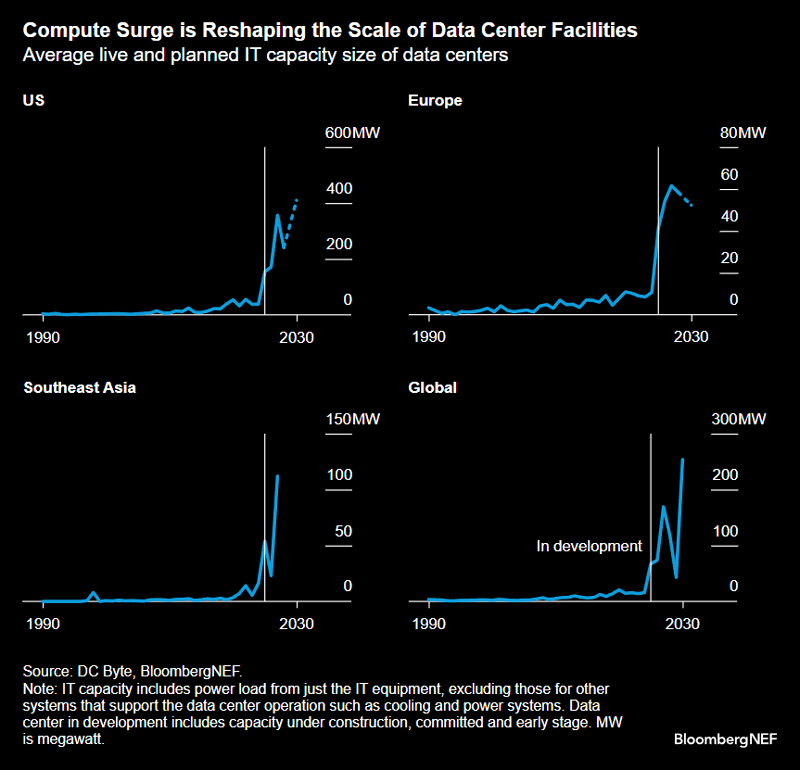

Источник изображения: BloombergNEF ИИ-инфраструктура стала самым значимым элементом энергетического ландшафта. Если ещё в 2010 года более половины всех ЦОД потребляли менее 5 МВт, то теперь стандартный планируемый дата-центр требует уже сотни мегаватт, а некоторые замахиваются и на гигаваттные масштабы. В то же время повышается эффективность оборудования. По прогнозам экспертов, к 2030 году средний коэффициент энергоэффективности (PUE) ЦОД должен уменьшиться с 1,4 до 1,2. Однако рост спроса на вычислительные мощности не позволит в полной мере компенсировать рост энергоэффективности.

Источник изображения: BloombergNEF Обучение ИИ-моделей требует высокой концентрации вычислительных мощностей, поэтому возникает новый класс ЦОД, преобразующих не только облака, но и сами электросети. Бум ИИ сегодня — не просто вычислительная задача, но и энергетическая гонка. Для передовых участников рынка доступ к электричеству жизненно необходим. Компании быстро строят объекты, часто ещё до появления поступлений от клиентов, причём приоритет отдаётся площадкам с быстрым доступом к электричеству, земле и разрешениям регуляторов. Лидерами в США традиционно выступают Вирджиния, Орегон, Техас и Огайо, но появляются и новые территории, поскольку скорость доступа к энергии и другим ресурсам иногда может быть важнее близости к конечным пользователям ИИ.

Источник изображения: BloombergNEF Удовлетворение спроса подразумевает использование существующих и новых энергосистем. В краткосрочной перспективе ставка делается на природный газ — именно газовые электростанции обеспечивают электроэнергией значительную часть новых ЦОД в Соединённых Штата, особенно там, где это топливо является ключевым энергоносителем. На днях появилась новость о том, что Meta✴ намерена стать энергокомпанией и самой продавать электричество для эффективного управления потребностями своих ЦОД, а AWS, Google и Microsoft уже делают то же самое. В начале сентября президент США Дональд Трамп (Donald Trump) пообещал операторам ЦОД решить проблемы с энергоснабжением дата-центров с помощью комплекса специальных мер.

17.03.2025 [17:23], Руслан Авдеев

Ежегодные расходы техногигантов на ИИ превысят $500 млрд, но большая часть денег пойдёт на инференс, а не на обучение моделейКрупнейшие IT-компании нарастят ежегодные расходы на ИИ-технологии — в совокупности они превысят $500 млрд уже в следующем десятилетии. Одной из причин роста инвестиций в ИИ станет новый подход к разработкам со стороны китайской DeepSeek и OpenAI, сообщает Bloomberg Intelligence. Группа гиперскейлеров, включая Microsoft, Amazon и Meta✴ намерена потратить $371 млрд на ЦОД и вычислительные ресурсы для ИИ в 2025 году, на 44 % больше, чем годом ранее. К 2032 году затраты вырастут до $525 млрд — быстрее, чем ожидали в Bloomberg Intelligence до того, как недавно «выстрелили» продукты DeepSeek. До недавних пор большая часть инвестиций в ИИ уходила на дата-центры и чипы, которые использовались для обучения или разработки новых, всё более крупных ИИ-моделей. Теперь компании намерены больше тратить на инференс. Изменение стратегии ускорилось после выпуска «рассуждающих» моделей компаний OpenAI и DeepSeek. У этих систем уходит больше времени на ответы на запросы пользователей, при этом они требуют больше ресурсов на инференс. Неожиданный для многих успех DeepSeek, которая, как утверждается, создала чрезвычайно недорогую и конкурентоспособную модель на уровне современных продуктов западных конкурентов (с оговорками), вызвал вопросы об эффективности инвестиций в США. Эксперты оценивают, стоило ли вкладывать огромные средства в укрупнение моделей. Некоторые компании уже стали внедрять эффективные LLM, работающие на относительно небольшом числе ускорителей.

Источник изображения: The Drink/unspalsh.com По данным Bloomberg, «рассуждающие» модели обеспечивают новые возможности для заработка на ПО и потенциально обходятся дороже на этапе инференса, чем на этапе обучения. Это, похоже, приведёт к наращиванию инвестиций в соответствии с новой концепцией и приведёт к росту вложений в ИИ в целом. Рост капитальных затрат на обучение ИИ, как считают в Bloomberg, может быть заметно медленнее, чем предсказывалось ранее. Огромное внимание, которое привлекла DeepSeek, вероятно, заставит технологические фирмы нарастить инвестиции в инференс — именно он станет самым быстрорастущим сегментом на рынке систем генеративного ИИ. Похожие прогнозы давала и Omdia. Хотя в текущем году затраты на связанные с обучением задачи, вероятно, составят более 40 % расходов гиперскейлеров на ИИ, сегмент, как ожидается, уменьшится к 2032 году до всего 14 %. В том же году связанные с инференсом инвестиции могут составить около половины всех расходов на ИИ. Как считают в Bloomberg, наилучшие позиции среди гиперскейлеров у Google. У неё TPU собственной разработки, которые можно использовать как для обучения, так и для инференса. Другие компании, вроде Microsoft и Meta✴, сильно зависят от NVIDIA и могут оказаться не столь гибкими в гонке по новым правилам. |

|