Облачная платформа AWS официально объявила о доступности инстансов EC2 P5, которые предназначены для работы с большими языковыми моделями и генеративным ИИ. Благодаря масштабируемости производительность кластеров P5 может достигать 20 Эфлопс (точность вычислений не указана), что позволит решать самые сложные вычислительные задачи.

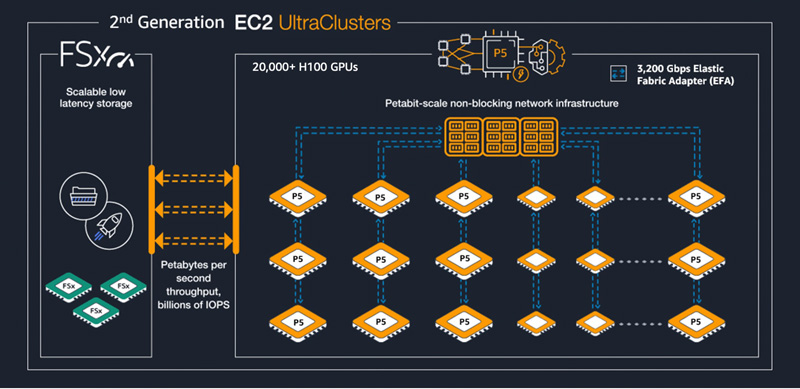

О подготовке инстансов EC2 P5 сообщалось в марте нынешнего года. В основу положены ускорители NVIDIA H100, количество которых в составе кластеров EC2 UltraClusters второго поколения может превышать 20 тыс.

Каждый инстанс P5 оснащён восемью ускорителями NVIDIA H100. Задействованы процессоры AMD EPYC Milan, а количество vCPU достигает 192. Общий объём системной памяти равен 2 Тбайт; локальное хранилище включает восемь SSD вместимостью 3,84 Тбайт каждый. Используются адаптеры AWS Elastic Fabric Adapter (EFA) второго поколения с низкой задержкой, агрегированной скоростью передачи данных 3200 Тбит/с и поддержкой NVIDIA GPUDirect RDMA.

Источник изображения: AWS

Заявленная производительность в расчёте на инстанс достигает 16 Пфлопс FP8 и 8 Пфлопс FP16. Утверждается, что при использовании EC2 P5 время тренировки моделей машинного обучения сокращается в шесть раз по сравнению с инстансами AWS предыдущего поколения. В настоящее время доступ к EC2 P5 предоставляется в регионах US East (Северная Вирджиния) и US West (Орегон).

Источник: