Материалы по тегу: ии

|

06.08.2024 [09:01], Руслан Авдеев

ИИ ЦОД понадобятся гигантские системы резервного питанияИИ-системам требуются огромные объёмы электроэнергии, что резко повышает требования к системам резервного питания ЦОД на случай сбоев, пишет EE Times. По данным СМИ, глобальный спрос со стороны критических IT-инфраструктур вырастет с 49 ГВт в 2023 году до 96 ГВт к 2026 году, на ИИ придётся порядка 40 ГВт. При этом ёмкость ИИ ЦОД, как ожидается, будет составлять 100 МВт. А общее потребление дата-центров может вырасти до более 1000 ТВт∙ч в 2026 году. Для ИИ ЦОД требуется доступность на уровне 99,99999 %, так что им нужно полномасштабное резервное энергоснабжение. Для этого обычно используются дизельные или газовые генераторы мощностью 1–2 МВт. Для защиты крупного ЦОД нужны десятки таких машин, готовых к пуску. Критически важной является скорость переключения на резервный источник питания — на старт генератора обычно требуется до нескольких минут, так что всё это время питание должно осуществляться от аккумуляторов. Кроме того, нужно распределительное устройство, а также система мониторинга и автоматизации, которая сделает для IT-нагрузки переход с одного источника на другой незаметным. Однако рост ёмкости ЦОД резко усложняет и удорожает создание систем резервного питания. Генератор мегаваттного класса весит около 5 т (без топлива), занимает не так уж мало места (добавьте сюда топливный бак объём от 1 м3) и стоит порядка $1–$2 млн без учёта доставки и установки. При этом аккумуляторная система — это ещё один отдельный комплекс с собственными проблемами установки. Так что не исключено, что недавно запущенный ИИ-кластер xAI, который пока что вынужден питаться как раз от генераторов, даже после подключения к энергосети оставит эти генераторы на площадке.

05.08.2024 [12:48], Руслан Авдеев

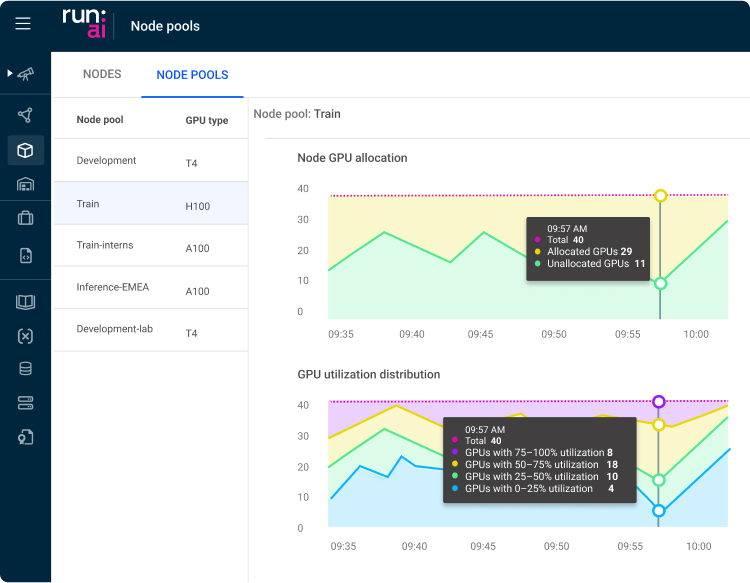

NVIDIA купила Run:ai, чтобы «похоронить» наработки стартапа, подозревает Минюст СШАПо данным Silicon Angle, американское Министерство юстиции взялось за сделку NVIDIA по покупке стартапа Run:ai, занимающегося разработкой софта для управления рабочими нагрузками ИИ. ПО позволяет более эффективно использовать вычислительные ресурсы при работе с ИИ-приложениями, что может оказаться помехой для бизнеса NVIDIA. Информация о расследовании появилась у СМИ на прошлой неделе. Пару месяцев назад источники уже сообщали, что министерство расследует доминирующее положение NVIDIA на рынке ИИ-чипов. По данным источников сделку будут рассматривать независимо от предыдущего расследования.

Источник изображения: Romain Dancre/unsplash.com NVIDIA купила стартап из Тель-Авива Run:ai (зарегистрированный как Runai Labs Ltd) в начале года за $700 млн. Ранее он уже привлёк от инвесторов порядка $118 млн. Предлагаемая им платформа позволяет расширить функциональность кластеров ускорителей и повысить их уровень утилизации. В Run:ai позволяет запускать на одном и том же ускорителе несколько задач. Также платформа позволит избегать конфликтов памяти, а также присущих ИИ-вычислениям ошибок. Выполнение рабочих нагрузок может быть ускорено другими методами. Например, для обучения языковой модели разработчики разбивают её на части, каждую из которых тренируют на отдельном ускорителе. Фрагменты регулярно обмениваются данными в ходе обучения, но работа настроена благодаря Run:ai таким образом, что обмен данными происходит быстрее, а сеансы обучения выходят короче. Другими словами, реализация ИИ-проектов может быть ускорена без добавления новых вычислительных ресурсов. Верно и обратное, задачи можно завершать с той же скоростью с использованием меньшего числа ускорителей. Как раз последний вариант привлёк внимание Министерства юстиции. Платформа, способная снизить количество необходимых ускорителей, может привести к тому, что некоторые клиенты станут покупать меньше продуктов NVIDIA. Чиновники подозревают IT-гиганта в том, что он намерен просто «похоронить» технологию, угрожающую её основному бизнесу.

Источник изображения: Run:ai Изучаются и другие аспекты деятельности компании. Например, в министерстве желают знать, не ставит ли NVIDIA условием для доступа к своим ускорителям покупку клиентами других своих продуктов или не ставит ли она условием обязательство не покупать оборудование у конкурентов. В NVIDIA утверждают, что лидируют на рынке совершенно заслуженно, соблюдая все законы, а продукты компании открыты и доступны любым бизнесам — клиенты могут сами принять решение, которое подходит им лучше всего. В прошлом месяце появлялась информация о том, что выдвинуть обвинения против NVIDIA намерен антимонопольный регулятор Франции. Вероятно, в поле зрения попадает набор инструментов CUDA для разработки ПО, используемого с ускорителями и видеокартами компании. Чиновников беспокоит и вложения NVIDIA в облачные компании, ориентирующиеся на ИИ, вроде CoreWeave, массово внедряющие ускорители компании в своей инфраструктуре. Предполагается, что инвестор сможет повлиять на предпочтения партнёров при покупке ускорителей и ПО.

05.08.2024 [10:34], Руслан Авдеев

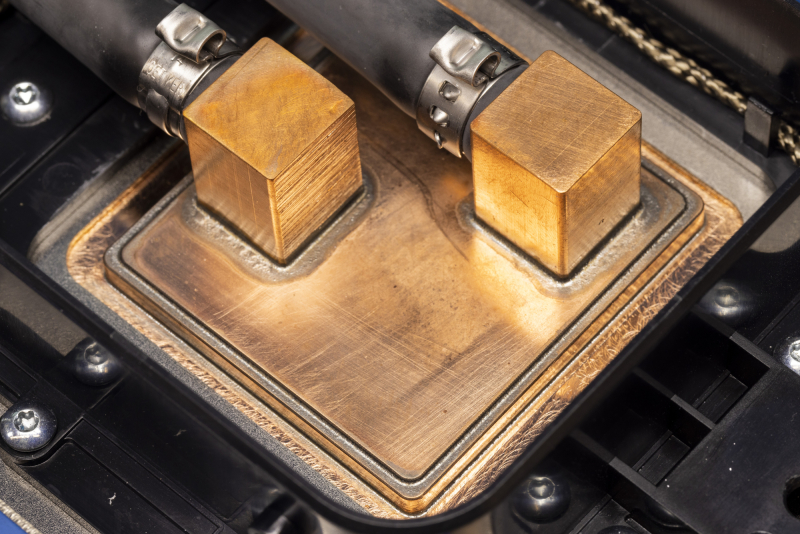

Microsoft начала активно внедрять прямое жидкостное охлаждение в своих ЦОД и приступила к прикладному изучению микрогидродинамикиКомпания Microsoft стала активно применять прямое жидкостное охлаждение чипов в серверах своих ЦОД. Datacenter Dynamics сообщает, что IT-гигант приступил и к изучению более передовой технологии, основанной на принципах микрогидродинамики. Как свидетельствует недавний пост в блоге компании, посвящённый использованию воды и применяемым СЖО разных поколений, сейчас разрабатывается новая архитектура дата-центров, оптимизированных для прямого жидкостного охлаждения чипов. Это требует переосмысления конструкции серверов и серверных стоек для внедрения новых методов терморегуляции и управления энергией. Компания уже использует sidekick-СЖО в действующих ЦОД. Впервые они были представлены во время анонса процессоров Cobalt и ИИ-ускорителей Maya. Последние будут развёрнуты в кастомных стойках и кластерах Ares. Серверы для них шире 19″ и даже OCP-стоек и нуждаются именно в жидкостном охлаждении — других конфигураций не предусмотрено. Каждый сервер получит по четыре ускорителя Maya, а стойка будет вмещать восемь серверов. А рядом с ней будет ещё одна стойка с компонентами охлаждения. Аналогичный дизайн использует Meta✴, которая также была вынуждена пересмотреть архитектуру своих ЦОД из-за ИИ. Не менее интересны и разработки в сфере микрогидродинамики. Этот подход предусматривает размещение микроканалов для подачи жидкости буквально внутри самих чипов, что обеспечивает ещё более высокую эффективность охлаждения. В компании утверждают, что все эти разработки оптимизированы для поддержки ИИ-нагрузок в ЦОД и в то же время дружественны к экологии. Благодаря инновациям можно значительно снизить потребление чистой воды, одновременно обеспечивая повышенную ёмкость серверных стоек, благодаря чему возрастает польза от каждого задействованного квадратного метра. Microsoft намерена стать «водно-положительной» к 2030 году. В ESG-докладе 2023 года компания заявила, что использовала в 2022 году 6,4 млн м3, преимущественно для своих ЦОД. В докладе 2024 года показатель увеличился уже до 7,8 млн м3 в 2023 году. Проблемы с потреблением воды вообще характерны для IT-гиганта и его партнёров. Запись в блоге Microsoft также свидетельствует о том, что компания расширила использование восстановленной и переработанной воды на площадках в Техасе, Вашингтоне, в Калифорнии и Сингапуре. В Нидерландах, Ирландии и Швеции компания собирает дождевую воду и намерена расширить эту практику на Канаду, Великобританию, Финляндию, Италию, Южную Африку и Австрию. В Нидерландах, правда, всё оказалось не так хорошо, как обещала компания. Как заявляют Microsoft, с первого поколения собственных дата-центров в начале 2000-х годов до текущего поколения в 2020-х, использование воды на кВт·ч снизилось более чем на 80 %. Ранее компания сотрудничала с разработчиком систем двухфазного погружного жидкостного охлаждения LiquidStack, который поддерживается одним из поставщиков Microsoft — Wiwynn. В прошлом году LiquidStack представила однофазную систему иммерсионного охлаждения для ИИ-систем, а также запустила в США производство СЖО, но для кого именно она их выпускает, не уточняется.

05.08.2024 [08:16], Сергей Карасёв

Новые кластеры Supermicro SuperCluster с ускорителями NVIDIA L40S ориентированы на платформу Omniverse

emerald rapids

hardware

intel

l40

nvidia

omniverse

sapphire rapids

supermicro

xeon

ии

кластер

сервер

Компания Supermicro расширила семейство высокопроизводительных вычислительных систем SuperCluster, предназначенных для обработки ресурсоёмких приложений ИИ/HPC. Представленные решения оптимизированы для платформы NVIDIA Omniverse, которая позволяет моделировать крупномасштабные виртуальные миры в промышленности и создавать цифровых двойников. Системы SuperCluster for NVIDIA Omniverse могут строиться на базе серверов SYS-421GE-TNRT или SYS-421GE-TNRT3 с поддержкой соответственно восьми и четырёх ускорителей NVIDIA L40S. Обе модели соответствуют типоразмеру 4U и допускают установку двух процессоров Intel Xeon Emerald Rapids или Sapphire Rapids в исполнении Socket E (LGA-4677) с показателем TDP до 350 Вт (до 385 Вт при использовании СЖО). Каждый из узлов в составе новых систем SuperCluster несёт на борту 1 Тбайт оперативной памяти DDR5-4800, два NVMe SSD вместимостью 3,8 Тбайт каждый и загрузочный SSD NVMe M.2 на 1,9 Тбайт. В оснащение включены четыре карты NVIDIA BlueField-3 (B3140H SuperNIC) или NVIDIA ConnectX-7 (400G NIC), а также одна карта NVIDIA BlueField-3 DPU Dual-Port 200G. Установлены четыре блока питания с сертификатом Titanium мощностью 2700 Вт каждый. В максимальной конфигурации система SuperCluster for NVIDIA Omniverse объединяет пять стоек типоразмера 48U. В общей сложности задействованы 32 узла Supermicro SYS-421GE-TNRT или SYS-421GE-TNRT3, что в сумме даёт 256 или 128 ускорителей NVIDIA L40S. Кроме того, в состав такого комплекса входят три узла управления Supermicro SYS-121H-TNR Hyper System, три коммутатора NVIDIA Spectrum SN5600 Ethernet 400G с 64 портами, ещё два коммутатора NVIDIA Spectrum SN5600 Ethernet 400G с 64 портами для хранения/управления, два коммутатора управления NVIDIA Spectrum SN2201 Ethernet 1G с 48 портами. При необходимости конфигурацию SuperCluster for NVIDIA Omniverse можно оптимизировать под задачи заказчика, изменяя масштаб вплоть до одной стойки. В этом случае применяются четыре узла Supermicro SYS-421GE-TNRT или SYS-421GE-TNRT3.

04.08.2024 [15:25], Сергей Карасёв

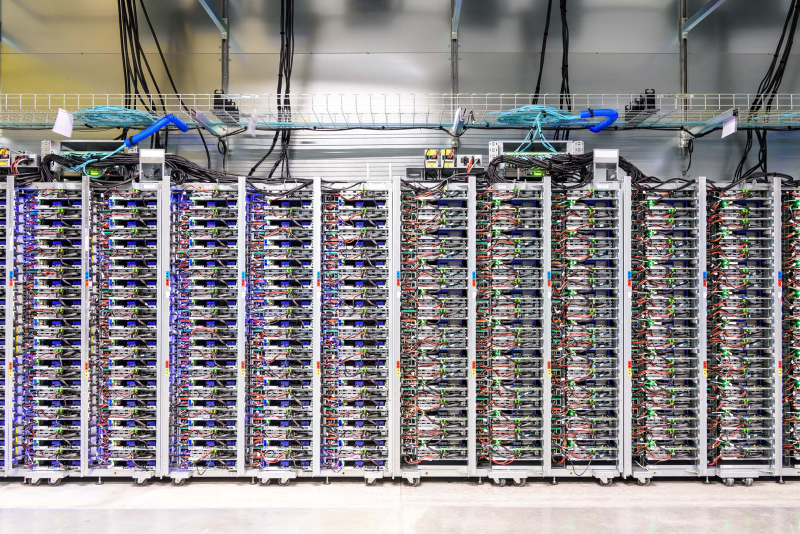

В Google Cloud появился выделенный ИИ-кластер для стартапов Y CombinatorОблачная платформа Google Cloud, по сообщению TechCrunch, развернула выделенный субсидируемый кластер для ИИ-стартапов, которые поддерживаются венчурным фондом Y Combinator. Предполагается, что данная инициатива поможет Google привлечь в своё облако перспективные компании, которым в будущем могут понадобиться значительные вычислительные ресурсы. Отмечается, что для ИИ-стартапов на ранней стадии одной из самых распространённых проблем является ограниченная доступность вычислительных мощностей. Крупные предприятия обладают достаточными финансами для заключения многолетних соглашений с поставщиками облачных услуг на доступ к НРС/ИИ-сервисам. Однако у небольших фирм с этим возникают сложности. Ожидается, что Google Cloud поможет в решении данной проблемы. Google предоставит выделенный кластер с приоритетным доступом для стартапов Y Combinator. Платформа базируется на ускорителях NVIDIA и тензорных процессорах (TPU) самой Google. Каждый участник программы получит кредиты на сумму $350 тыс. для использования облачных сервисов Google в течение двух лет. Кроме того, Google предоставит стартапам кредиты в размере $12 тыс. на расширенную поддержку и бесплатную годовую подписку Google Workspace Business Plus. Молодые компании также смогут консультироваться с экспертами Google в области ИИ. Оказав поддержку ИИ-стартапам, Google в дальнейшем сможет рассчитывать на заключение с ними долгосрочных контрактов на обслуживание. Говорится, что за последние 18 лет примерно 5 % стартапов Y Combinator стали единорогами с оценкой $1 млрд и более. Такие компании могут принести облачной платформе Google значительную выручку в случае заключения соглашения о сотрудничестве. С другой стороны, фонд Y Combinator сможет привлечь больше перспективных ИИ-проектов, предлагая вычислительные ресурсы Google вместе со своей поддержкой. Аналогичные программы есть и у других игроков. Так, венчурный инвестор Andreessen Horowitz (a16z) тоже запасается ИИ-ускорителями, чтобы стать более привлекательным для ИИ-стартапов. AWS предлагает ИИ-стартапам доступ к облаку и сервисам, а Alibaba Cloud готова предоставить ресурсы в обмен на долю в стартапе. Сама Google на днях наняла основателей стартапа Character.AI и лицензировал его модели. Стартапу, по-видимому, не хватило средств на ИИ-ускорители для дальнейшего развития.

02.08.2024 [18:01], Руслан Авдеев

ИИ и ЦОД: капитальные затраты Meta✴ во II квартале выросли до $8,5 млрдВ Meta✴ продолжают активно вкладывать средства в серверы, дата-центры и сетевую инфраструктуру — компания выстраивает экосистему для искусственного интеллекта. По информации Datacenter Dynamics, капитальные затраты во II квартале составили $8,5 млрд, ожидается, что они будут расти и в дальнейшем. Выручка за отчётный период превзошла прогнозы экспертов и составила $39,07 млрд, на 22 % больше в сравнении с аналогичным периодом прошлого года. Чистая прибыль в прошедшем квартале — $13,46 млрд, рост составил 73 %. Прогноз выручки на следующий квартал — $38,5-$41 млрд. Капитальные затраты оказались несколько ниже ($8,5 млрд), чем предполагали отраслевые эксперты ($9,51 млрд), тем не менее рост составил 32,8 % год к году. Компания ожидает и дальнейшего значительного роста капитальных вложений в 2025 году, при этом имеется достаточный запас гибкости. Та же инфраструктура, что построена для обучения генеративного ИИ, будет использована и для инференса. Кроме того, инфраструктуру можно будет модифицировать для других задач, включая ранжирование, рекомендательные системы и др. Как утверждают в Meta✴, несмотря на рост инвестиций, генеративный ИИ не должен стать значимым драйвером выручки в 2024 году. Впрочем, по словам главы компании Марка Цукерберга (Mark Zuckerberg), он скорее рискнёт создать лишнюю ёмкость до того, как она понадобится, чем станет добиваться её строительства с опозданием, с учётом довольно длительной реализации новых внутренних проектов. Ожидается, что для тренировки ИИ-модели Llama 4 понадобится почти в 10 раз больше вычислительных мощностей, чем было необходимо для Llama 3. Для последующих моделей потребуется ещё больше. К концу года компания будет использовать ускорители эквивалентные по вычислительной способности 600 тыс. экземпляров NVIDIA H100. По словам финансового директора Meta✴ Сьюзан Ли (Susan Li), компания применяет стратегию поэтапного строительства ЦОД, позволяющую быстро увеличивать общую ёмкость для удовлетворения спроса. При этом в будущем капитальные затраты снизятся, поскольку не будет необходимости сразу сдавать большие объекты.

01.08.2024 [15:32], Руслан Авдеев

У Twitter нашёлся заброшенный кластер из когда-то дефицитных NVIDIA V100Работавший в Twitter во времена продажи социальной сети Илону Маску (Elon Musk) разработчик Тим Заман (Tim Zaman), ныне перешедший в Google DeepMind, рассказал о необычной находке, передаёт Tom’s Hardware. По его словам, через несколько недель после сделки специалисты обнаружили кластер из 700 простаивающих ускорителей NVIDIA V100. Сам Заман охарактеризовал находку как «честную попытку построить кластер в рамках Twitter 1.0». Об этом событии Заману напомнили новости про ИИ-суперкомпьютер xAI из 100 тыс. ускорителей NVIDIA H100. Находка наводит на печальные размышления о том, что Twitter годами имел в распоряжении 700 высокопроизводительных ускорителей на архитектуре NVIDIA Volta, которые были включены, но простаивали без дела. Они были в дефиците на момент выпуска в 2017 году, а Заман обнаружил бездействующий кластер только в 2022 году. Нет ничего удивительного, что приблизительно тогда же было решено закрыть часть дата-центров социальной сети. Примечательно, что в кластере использовались PCIe-карты, а не SXM2-версии V100 с NVLink, которые намного эффективнее в ИИ-задачах. Заман поделился и соображениями об «ИИ-гигафабрике». Он предположил, что использование 100 тыс. ускорителей в рамках одной сетевой фабрики должно стать эпическим вызовом, поскольку на таких масштабах неизбежны сбои, которыми необходимо грамотно управлять для сохранения работоспособности всей системы. По его мнению, следует разделить систему на независимые домены (крупные кластеры так и устроены). Заман также задался вопросом, какое максимальное количество ускорителей может существовать в рамках одного кластера. По мере того, как компании создают всё более масштабные системы обучения ИИ, будут выявляться как предсказуемые, так и неожиданные пределы того, сколько ускорителей можно объединить.

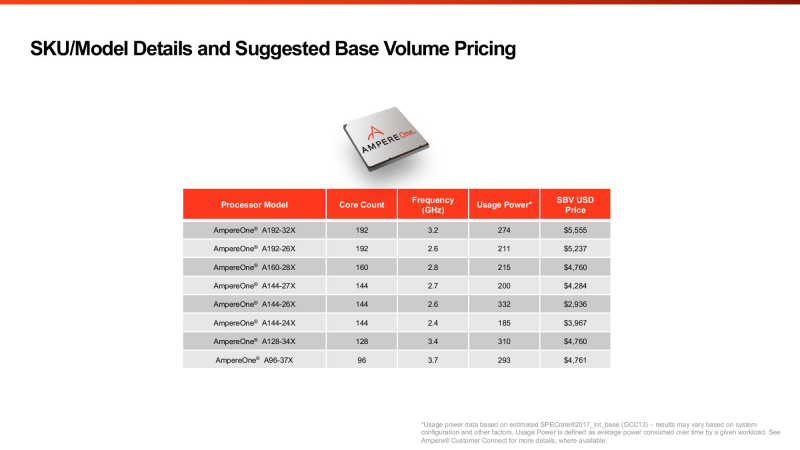

01.08.2024 [00:53], Игорь Осколков

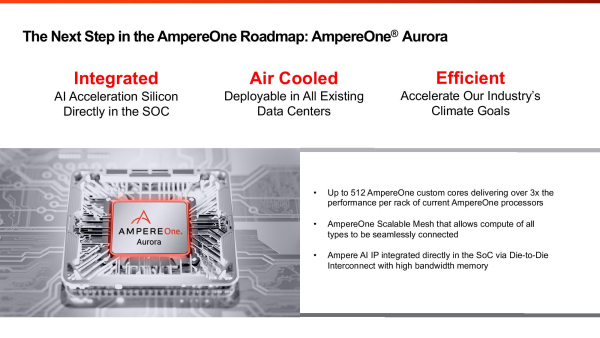

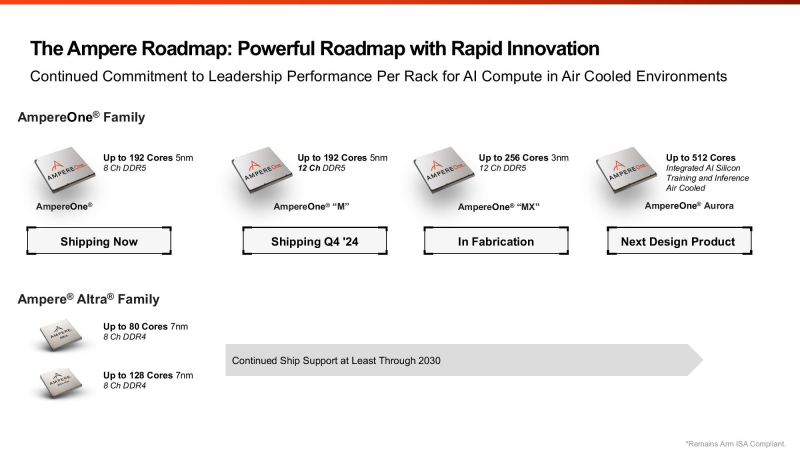

Ampere анонсировала 512-ядерные Arm-процессоры AmpereOne Aurora с HBM-памятью и встроенным ИИ-ускорителемAmpere Computing анонсировала процессоры AmpereOne Aurora, которые получат до 512 однопоточных Arm-ядер собственной разработки, набортную HBM-память и фирменные IP-блоки для обучения и инференса ИИ-моделей. Речь, судя по всему, идёт о чиплетной компоновке, поскольку компания говорит не только о фирменном меш-интерконнекте для вычислительных блоков, но и об объединении разных кристаллов в рамках SoC. Предполагается, что Aurora появятся где-то на рубеже 2025–2026 гг. Что интересно, для Aurora обещана возможность использования воздушного охлаждения. Для гиперскейлеров, на которых Ampere по-прежнему ориентируется, это важный пункт. Впрочем, больше никаких подробностей о новинках компания не сообщила, отметив лишь, что встроенный ускоритель сгодится для RAG и векторных баз данных. Ну и сообщив, что по количеству ядер и производительности её ещё не выпущенный чип обгоняет все остальные чипы: 144-ядерные Intel Xeon 6 (Sierra Forrest), которые вскоре станут 288-ядерными (при этом все варианты без Hyper-Threading), и 128-ядерные AMD EPYC Bergamo (256 потоков), которым на смену придут 192-ядерные EPYC Turin Dense (384 потока). До Aurora компания выпустит ещё две серии процессоров AmpereOne: M в конце 2024 года и MX в 2025 году. 5-нм AmpereOne M получат до 192 ядер и 12-канальный контроллер памяти DDR5. 3-нм AmpereOne MX получат такой же контроллер и до 256 ядер. Заодно компания опубликовала прайс-лист актуальных CPU. В нём нет изначально заявлявшихся 136- и 172-ядерных моделей. Кроме того, остальные процессоры несколько подорожали в сравнении с прошлым поколением Altra Max, но по цене всё ещё привлекательнее решений AMD и Intel — $5555 за 192 ядра. Следует учесть, что в таблице приведён не привычный показатель TDP, а усреднённое энергопотребление чипа, из-за чего сравнивать процессоры Ampere с другими чипами затруднительно. Насколько Aurora станет популярным у гиперскейлеров и других заказчиков, покажет время. У Ampere есть якорный заказчик в лице Oracle, но другие IT-гиганты уже сами разрабатывают собственные Arm-процессоры. AWS в Graviton4 довела количество ядер до 96, Microsoft анонсировала 128-ядерный Cobalt 100, Alibaba массово внедряет 128-ядерные Yitian 710, а Google готовит Axion. Fujitsu к 2027 году подготовит 144-ядерные MONAKA, которые тоже получат поддержку ИИ-нагрузок, но упор в них сделан не на HBM, а на SRAM. Собственно говоря, HBM есть только у HPC-процессоров: Fujitsu A64FX, SiPearl Rhea1 и C-DAC AUM. Даже NVIDIA Grace, которые в основном ассистируют ускорителям, обходятся LPDDR5x.

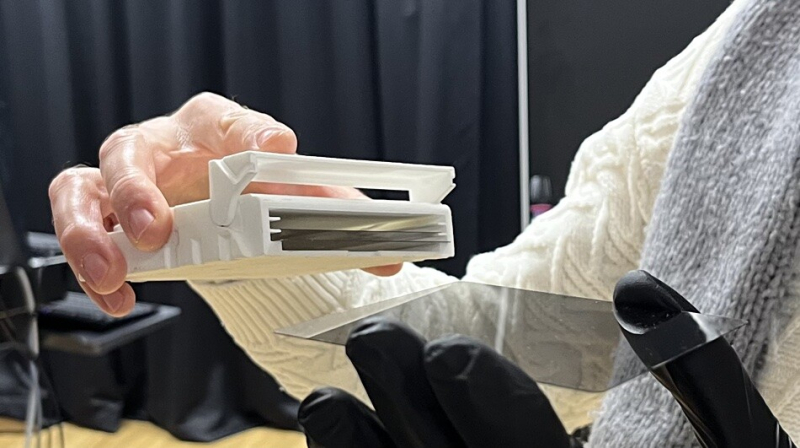

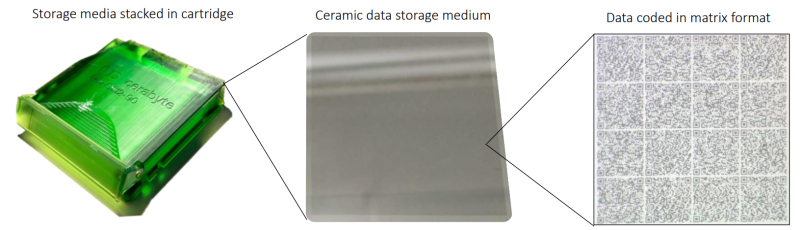

31.07.2024 [15:32], Руслан Авдеев

Разработчик «керамических» накопителей Cerabyte получил инвестиции от Pure Storage, занимающейся All-Flash СХДКомпания Pure Storage, разрабатывающая All-Flash СХД, инвестировала неназванную сумму в стартап Cerabyte, занимающийся созданием систем архивного хранения с использованием керамики. Основатель Pure Storage также получит место в совете директоров Cerabyte. В случае успеха новая технология сможет потеснить ленточные накопители, отгрузки которых в последние годы только растут. Сама Pure Storage тем временем намерена окончательно расправиться с HDD. Разработка Cerabyte предусматривает использование покрытого тонким слоем керамики стекла или плёнки. Информация записывается на керамический слой в виде «ямок», быстро наносимых на поверхность лазером. Фактически речь идёт о вариации QR-кодов, считывать которые тоже можно с помощью лазера. Накопители можно хранить в роботизированной библиотеке на манер тех, что используются для ленточных накопителей. Но если последние необходимо менять приблизительно каждые десять лет, данные на керамике хранятся практически вечно, говорят создатели. Кроме того, плотность записи выше, чем у LTO. Объём стратегических инвестиций не раскрывается, но известно, что в совет директоров Cerabyte войдёт основатель и директор по стратегии (Chief Visionary Officer) Pure Storage Джон Колгроув (John Colgrove). По его словам, партнёрство позволит предложить клиентам экобезопасные и надёжные решения для хранения данных, способные произвести революцию в индустрии. В Cerabyte рассчитывают, что партнёрство обеспечит её технологии коммерческое внедрение. В 2023 году компания начала работу в США и уже открыла офисы в Калифорнии и Колорадо. По мнению экспертов Furthur Market Research, мировой запрос на хранилища зеттабайтного уровня плохо удовлетворяется из-за дороговизны и высокого энергопотребления текущих решений. СХД на основе технологий Cerabyte обеспечат экономически и экологически целесообразные альтернативы LTO для корпоративных клиентов. Фактически новое решение в случае успеха может серьёзно подорвать рынок ленточных накопителей и сопутствующих технологий. Демонстрация полностью готовых продуктов (чтение/запись 1+ Гбайт/с, задержка первого обращения не более 15 с, 10–30 Пбайт на стойку) ожидается приблизительно в 2026 году. Пока что у Cerabyte есть только рабочий прототип.

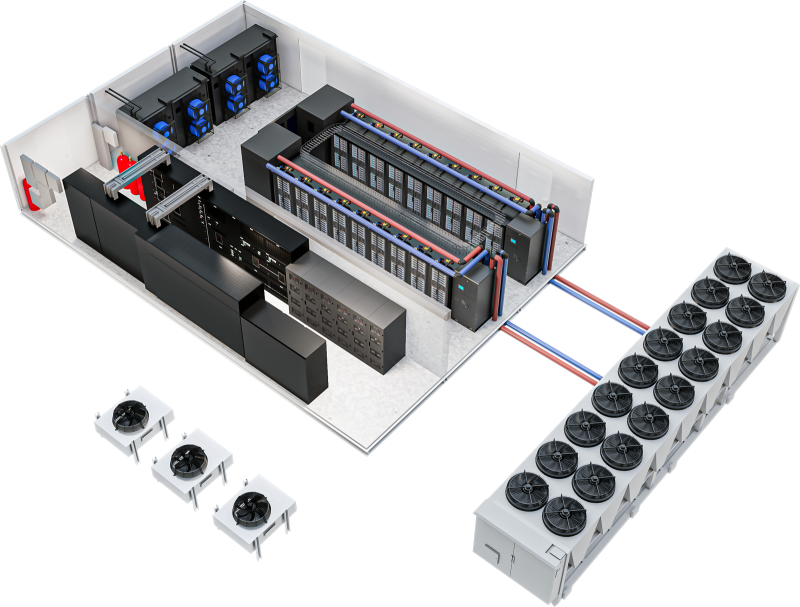

31.07.2024 [11:21], Сергей Карасёв

Vertiv представила модульные дата-центры высокой плотности для ИИ-нагрузокКомпания Vertiv представила модульную платформу MegaMod CoolChip, предназначенную для построения дата-центров высокой плотности для задач ИИ. Утверждается, что данное решение позволяет сократить время развёртывания вычислительных мощностей примерно в два раза по сравнению с традиционным строительством. Отмечается, что стремительное развитие генеративного ИИ, машинного обучения и НРС-приложений приводит к необходимости изменения обычной концепции ЦОД. Из-за большого количества мощных ускорителей требуется внедрение более эффективных систем охлаждения. В случае MegaMod CoolChip реализуется гибридный подход с воздушным и жидкостным охлаждением. Инфраструктура MegaMod CoolChip может включать в себя блоки распределения охлаждающей жидкости Vertiv XDU, стойки с поддержкой СЖО Vertiv Liquid-cooled Rack, решения Vertiv Air Cooling, стоечные блоки распределения питания Vertiv rPDU и пр. Модульная архитектура MegaMod CoolChip предусматривает возможность установки до 12 стоек в ряд. Мощность каждой из них может превышать 100 кВт. MegaMod CoolChip поставляется в виде отдельных блоков, которые монтируются непосредственно на месте размещения дата-центра. Возможны различные варианты организации воздушно-жидкостного охлаждения. Для СЖО используется технология однофазного прямого жидкостного охлаждения Direct-To-Chip. Возможно резервирование охлаждающих систем по схеме N+1. |

|